- 1开源PHP论坛HadSky本地部署与配置公网地址实现远程访问

- 2RoBERTa:一种稳健优化BERT的预训练方法_roberta预训练方法

- 3[Verilog语言入门教程] 乘法器(顺序 Booth & 并行 Wallace) 原理与实现_verilog多周期乘法器

- 4基于小程序的老孙电子点菜系统开发设计与实现+ssm

- 5线性回归模型

- 6海量数据处理之--哈希分治

- 7C++设计模式——桥接模式(bridge pattern)_c++桥接模式

- 8工具应用:使用JMeter实现Phpwind的性能测试!

- 9小白必备Stable diffusion30个插件,stable diffusion最全插件大全,新手必备指南!_stable diffusion 物品数量

- 10机器学习实践——预测数值型数据:回归_模型预测值为常数

【Python机器学习】感知器进行信用分类和使用KNN进行图书推荐实战(附源码和数据集)

赞

踩

需要源码和数据集请点赞关注收藏后评论区留言私信~~~

一、KNN进行图书推荐

KNN算法思想简介

KNN 可以说是最简单的分类算法之一,同时,它也是最常用的分类算法之一。注意:KNN 算法是有监督学习中的分类算法,它看起来和另一个机器学习算法 K-means 有点像(K-means 是无监督学习算法),但却是有本质区别的。

KNN 的全称是 K Nearest Neighbors,意思是 K 个最近的邻居。从这个名字我们就能看出一些 KNN 算法的蛛丝马迹了。K 个最近邻居,毫无疑问,K 的取值肯定是至关重要的,那么最近的邻居又是怎么回事呢?其实,KNN 的原理就是当预测一个新的值 x 的时候,根据它距离最近的 K 个点是什么类别来判断 x 属于哪个类别。

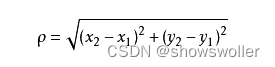

要度量空间中点距离的话,有好几种度量方式,比如常见的曼哈顿距离计算、欧式距离计算等等。不过通常 KNN 算法中使用的是欧式距离。这里只是简单说一下,拿二维平面为例,二维空间两个点的欧式距离计算公式如下:

该如何确定 K 取多少值好呢?答案是通过交叉验证(将样本数据按照一定比例,拆分出训练用的数据和验证用的数据,比如6:4拆分出部分训练数据和验证数据),从选取一个较小的 K 值开始,不断增加 K 的值,然后计算验证集合的方差,最终找到一个比较合适的 K 值。

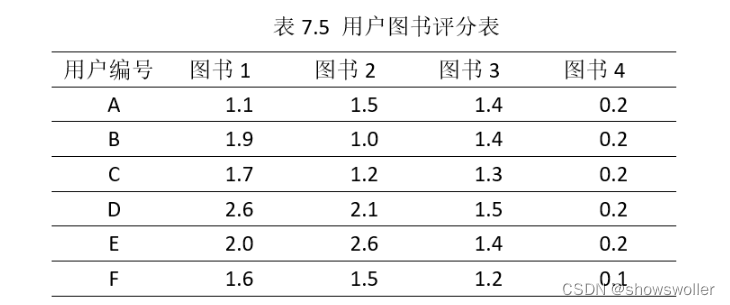

描述:下面比表7.5中是一个图书网站的数据,有5位用户对4本图书进行了评分。详细评分的值越大表示喜好越强烈。使用KNN模型找出与用户F最相似的用户。

预测结果如下 用户C与用户F喜好最为相似

![]()

部分代码如下

- # -*- coding: utf-8 -*-

- import numpy as np

- from sklearn import neighbors

- knn = neighbors.KNeighborsClassifier(1) #取得 knn 分类器

- data = np.array([[1.1, 1.5, 1.4, 0.2],

- [1.9, 1.0, 1.4 ,0.2],

- [1.7, 1.2, 1.3, 0.2],

- [2.6, 2..2]])

- labels = np.array(['A','B','C','D','E'])

- knn.fit(data)

- print("预测结果:",knn.predict(np.array([[1.6, 1.5, 1.2, 0.1]]).reshape(1,-1)))

二、使用感知器Perceptron进行信用分类

感知机(perceptron),又称“人工神经元”或“朴素感知机”,由Frank Rosenblatt于1957年提出。作为神经网络的起源算法,通过深入学习可以帮助我们更好的理解神经网络的部分工作原理。

感知机接受多个输入信号,输出一个信号。感知机的信号只有“0(不传递信号)”和“1(传递信号)”两种。

单个感知机的局限性就在于它只能表示由一条直线分割的空间,对于非线性问题(即线性不可分问题)仅用单个感知机无法解决。

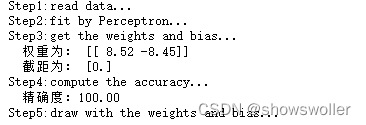

使用感知器对信用分类结果如下

可以看出有一条很明显的分界线将信用分成两个部分

部分代码如下

- # -*- encoding:utf-8 -*-

- from sklearn.linear_model import Perceptron

- from sklearn.cross_validation import train_test_split

- from matplotlib import pyplot as plt

- import numpy as np

- import pandas as pd

-

- def loaddata():

- people = pd.read_csv("credit-overdue.csv", header=0) # 加载数据集

- X = people[['debt','income']].values

- y = people['overdue'].values

- return X,y

-

- print("Step1:read data...")

- x,y=loaddata()

-

- #拆分为训练数据和测试数据

- print("Step2:fit by Perceptron...")

- x_train,x_test,y_train,y_test=train_test_split(x,y,test_size=0.2,random_state=0)

-

- #将两类值分别存放、以便显示

- positive_x1=[x[i,0]for i in range(len(y)) if y[i]==1]

- positive_x2range(len(y)) if y[i]==0]

-

- #定义感知机

- clf=Perceptron(n_iter=100)

- clf.fit(x_train,y_train)

- print("Step3:get the weights and bias...")

-

- #得到结果参数

- weights=clf.coef_

- bias=clf.intercept_

- print(' 权重为:',weights,'\n 截距为:',bias)

- print("Step4:compute the accuracy...")

-

- #使用测p5:draw with the weights and bias...")

- plt.scatter(positive_x1,positive_x2, marker='^',c='red')

- plt.scatter(negetive_x1,negetive_x2,c='blue')

- #显示感知机生成的分类线

- line_x=np.arange(0,4)

- line_y=line_x*(-weights[0][0]/weights[0][1])-bias

- plt.plot(line_x,line_y)

- plt.show()

创作不易 觉得有帮助请点赞关注收藏~~~