热门标签

热门文章

- 1底盘控制器与汽车VDSW系统:提升车辆性能与安全性的关键要素

- 210大常见网络安全攻击手段及防御方法总结_网络攻击技术的常见类型和手段

- 3三年测试,月薪才12k,想跳槽又不太敢....._三年工作经验要9k到12k还是10k到13k

- 4安全科普:什么是暴力破解攻击?如何检测和防御?_暴破攻击防护

- 5计算机基础学习

- 6Hadoop大数据平台搭建_hadoop大数据平台构建

- 7顺序循环队列的基本操作(C语言实现)_循环队列入队出队c语言

- 8深入分析 Android ContentProvider (三)_android contentprovider 权限

- 9关于什么是股指期货的知识普及篇

- 10AI安全帽识别/人脸识别智能分析网关如何配置告警信息推送_智能安全帽ai识别

当前位置: article > 正文

LLama的激活函数SwiGLU 解释_llama激活函数

作者:木道寻08 | 2024-08-13 04:22:23

赞

踩

llama激活函数

目录

Swish激活函数

Swish是一种激活函数,其计算公式如下:

1. Swish函数公式

Swish(x) = x * sigmoid(x)

其中,sigmoid(x)是sigmoid函数,计算公式为:

sigmoid(x) = 1 / (1 + exp(-x))

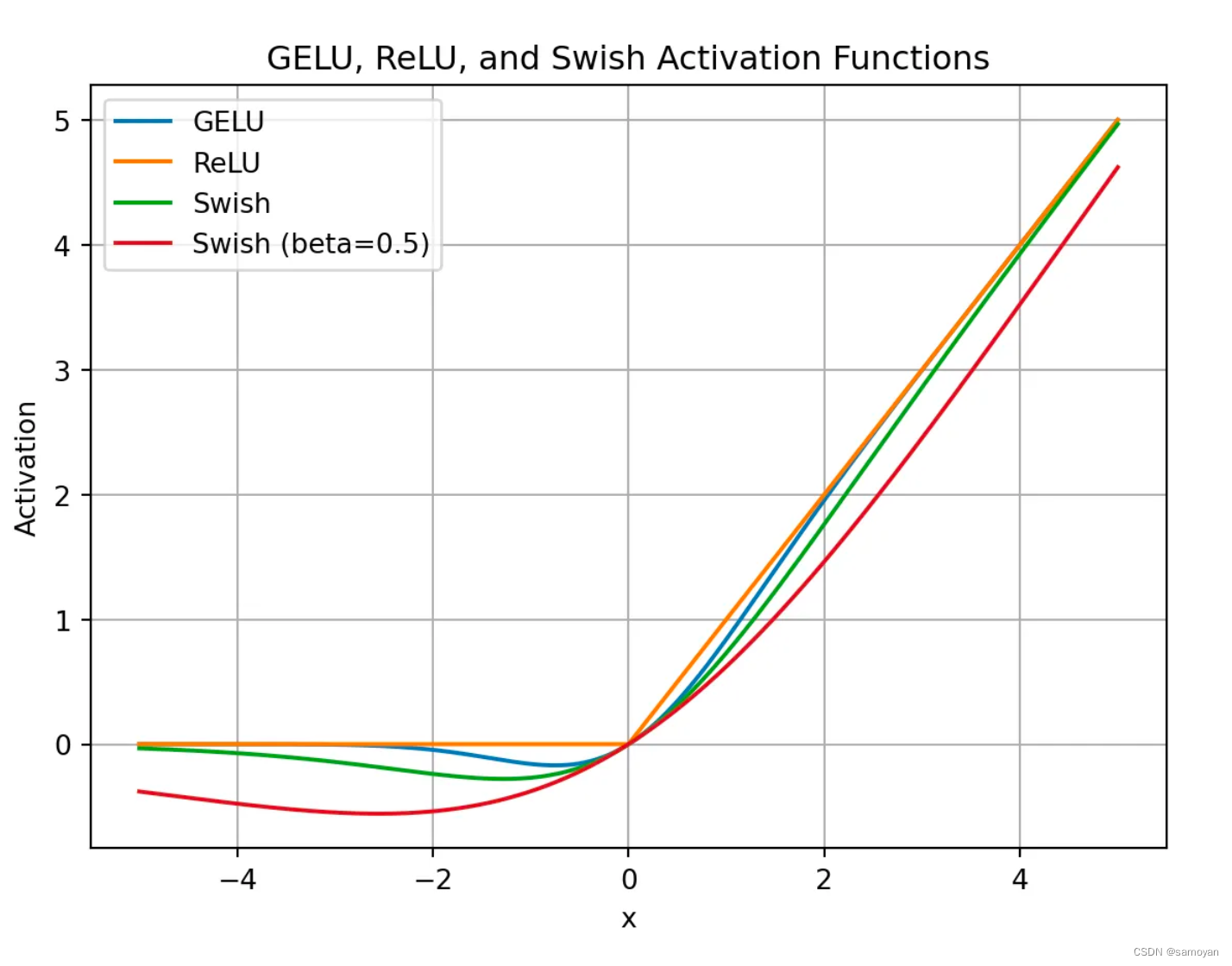

Swish函数结合了线性函数和非线性函数的特点,能够自适应地调整激活函数的形状,因此在某些深度学习模型中,Swish函数的表现优于常见的ReLU函数。

LLaMA模型中的激活函数

在LLaMA模型中,使用的激活函数是SwiGLU[1][2][3]。

1. SwiGLU激活函数

SwiGLU是LLaMA模型在前馈神经网络(FFN)阶段使用的激活函数[2:1]。它取代了ReLU非线性函数,以提高模型的性能[3:1]。

2. SwiGLU激活函数的表达式

SwiGLU是Gated Linear Units(GLU)激活函数的一种变体,其公式为:

SwiGLU(x,W, V, b, c) = Swish_1(xW + b) ⊗ (xV + c)

其中,Swish_β(x) = x σ(β x),σ为sigmoid函数,⊗为逐元素乘[1][2][3]。

3. SwiGLU激活函数的优势

SwiGLU的优势主要体现在以下几个方面:

3.1 提升性能:SwiGLU被应用于Transformer架构中的前馈神经网络(FFN)层,用于增强性能[1:1][2:1][3:1]。

3.2 可微性:SwiGLU是处处可微的非线性函数[1:2]。

3.3 自适应性:GLU是一种类似于长短期记忆网络(LSTM)带有门机制的网络结构,通过门机制控制信息通过的比例,来让模型自适应地选择哪些单词和特征对预测下一个词有帮助[3:2]。

- import numpy as np

- import matplotlib.pyplot as plt

- from scipy.stats import norm

-

- def gelu(x):

- return x * norm.cdf(x)

-

- def relu(x):

- return np.maximum(0, x)

-

- def swish(x, beta=1):

- return x * (1 / (1 + np.exp(-beta * x)))

-

- def swiglu(x, W, V, b, c):

- return swish(x*W + b) * (x*V + c)

-

- x_values = np.linspace(-5, 5, 500)

- gelu_values = gelu(x_values)

- relu_values = relu(x_values)

- swish_values = swish(x_values)

- swish_values2 = swish(x_values, beta=0.5)

- swiglu_values = swiglu(x_values, 1, 1, 0, 0) # Here you need to set the parameters W, V, b, and c according to your needs

-

- plt.plot(x_values, gelu_values, label='GELU')

- plt.plot(x_values, relu_values, label='ReLU')

- plt.plot(x_values, swish_values, label='Swish')

- plt.plot(x_values, swish_values2, label='Swish (beta=0.5)')

- plt.plot(x_values, swiglu_values, label='SwiGLU')

- plt.title("GELU, ReLU, Swish, and SwiGLU Activation Functions")

- plt.xlabel("x")

- plt.ylabel("Activation")

- plt.grid()

- plt.legend()

- plt.show()

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/木道寻08/article/detail/973125

推荐阅读

相关标签