热门标签

热门文章

- 1如何使用git上传本地代码到码云上(超详细的呦)_本地的代码仓库如何跟码云同步

- 2经典算法题汇总

- 3机器学习(五)Python+OpenCV+dlib实现人脸识别_python人脸识别门禁系统 opencv+dlib

- 4理论+实验:MySQL数据库基本概念和介绍_mysql的理论和实验的联系

- 5LeetCode70爬楼梯_line 8: char 16: runtime error: index -2 out of bo

- 6在图像中隐藏数据:用 Python 来实现图像隐写术_hugo隐写算法python实现

- 7leetocde662. 二叉树最大宽度,面试必刷题,思路清晰,分点解析,附代码详解带你完全弄懂

- 8Vue 实现电子签名_vue实现电子签名

- 9了解和使用 Docker 镜像仓库_docker 镜像库

- 10关系型数据库学习手记——初见倾心PostgreSQL、MySQL、SQLite、MongoDB_在 postgresql (pg) 中实现动态哈希分表

当前位置: article > 正文

CNN学习(4):前馈神经网络FNN、多层感知机MLP和反向传播推导_fnn神经网络

作者:正经夜光杯 | 2024-07-23 09:02:19

赞

踩

fnn神经网络

目录

一、前馈神经网络FNN

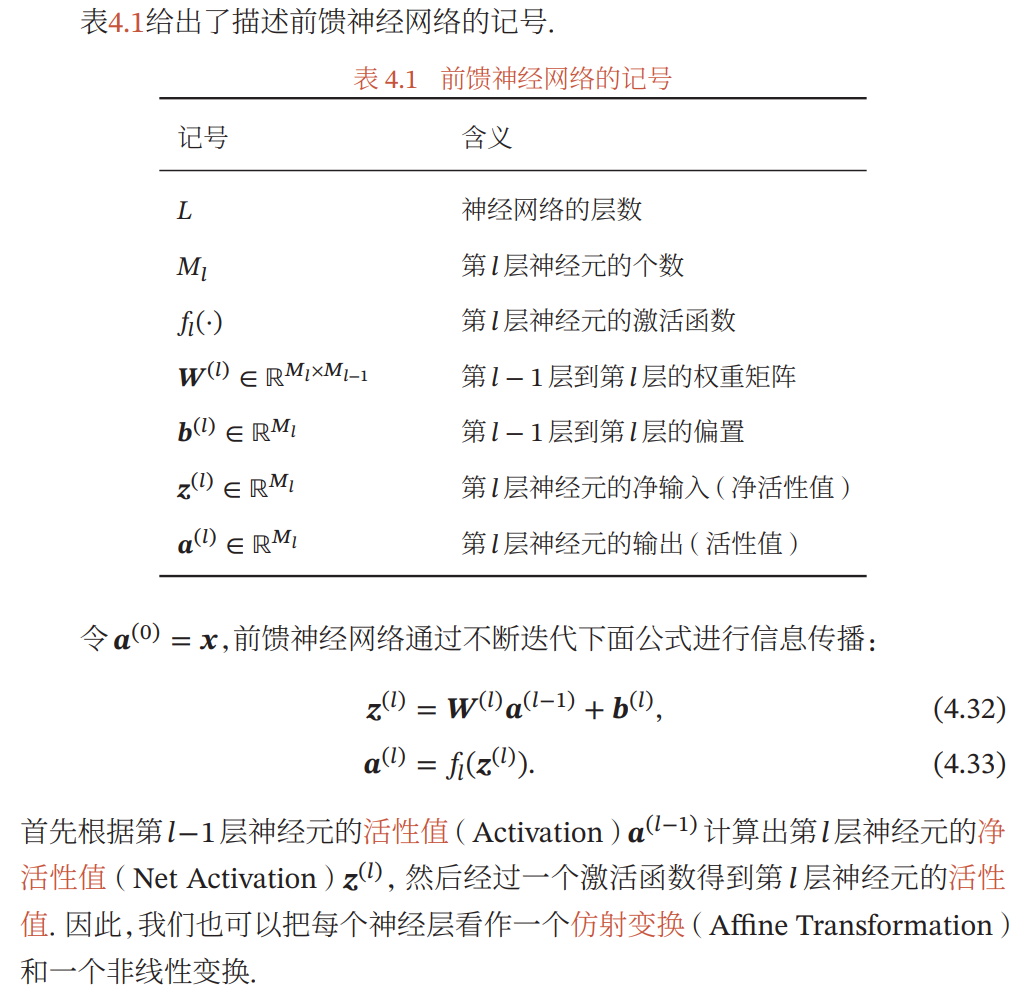

给定一组神经元,我们可以将神经元作为节点来构建一个网络。不同的神 经网络模型有着不同网络连接的拓扑结构。一种比较直接的拓扑结构是前馈网络。

前馈神经网络(Feedforward Neural Network,FNN)是最早发明的简单人工神经网络。前馈神经网络也经常称为多层感知器(Multi-Layer Perceptron,MLP)。但多层感知器的叫法并不是十分合理,因为前馈神经网络其实是由多层的 Logistic 回归模型(连续的非线性函数)组成,而不是由多层的感知器(不连续的非线性函数)组成。

在前馈神经网络中,各神经元分别属于不同的层。每一层的神经元可以接收前一层神经元的信号,并产生信号输出到下一层。第0层称为输入层,最后一层称为输出层,其他中间层称为隐藏层。整个网络中无反馈,信号从输入层向输出层单向传播,可用一个有向无环图表示。

激活函数的使用

在FNN中处理二维矩阵输入时,激活函数通常作用于每个元素上。也就是说,对于二维矩阵中的每个元素,都会独立地应用激活函数f。这个过程通常发生在网络的隐藏层,其中每个神经元接收来自前一层的加权输入,然后通过激活函数转换成一个新的矩阵,用作下一层的输入。

在实际的神经网络中,隐藏层的每个神经元通常会接收来自前一层所有神经元的加权和,然后通过激活函数。这意味着,虽然激活函数是逐元素应用的,但在计算每个隐藏层神经元的输出时,会先进行一个线性变换(即

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/正经夜光杯/article/detail/869166

推荐阅读

相关标签

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。