热门标签

热门文章

- 1第六篇【传奇开心果系列】Python文本和语音相互转换库技术点案例示例:深度解读Kaldi库个性化定制语音搜索引擎_kaldi python 本地文件 语音转文字

- 2Python训练的机器学习模型【保存】 和【加载】的方法?_python保存模型

- 3探索数据的无尽可能:Perspective 开源项目深度解析

- 4如何通过区块链撸毛获取收益_什么是撸毛

- 5激光SLAM-ch1 激光SLAM简要概述

- 6网易大模型 RAG 问答知识库开源,Star 超 6K!!_网易开源增强知识问答

- 7一位同学的Python大作业【分析当当网书籍价格、出版社、电子书版本占比数据】_数据分析与应用大作业当当网

- 8GPT引领前沿与应用突破之GPT4科研实践技术与AI绘图_gpt4 科研最新应用

- 9【Pytorch】神经网络搭建_神经网络搭建思路

- 10使用YOLO5进行模型训练机器学习【教程篇】

当前位置: article > 正文

Transformer的前世今生 day09(Transformer的框架概述)_alphago transformer

作者:煮酒与君饮 | 2024-07-11 03:13:38

赞

踩

alphago transformer

前情提要

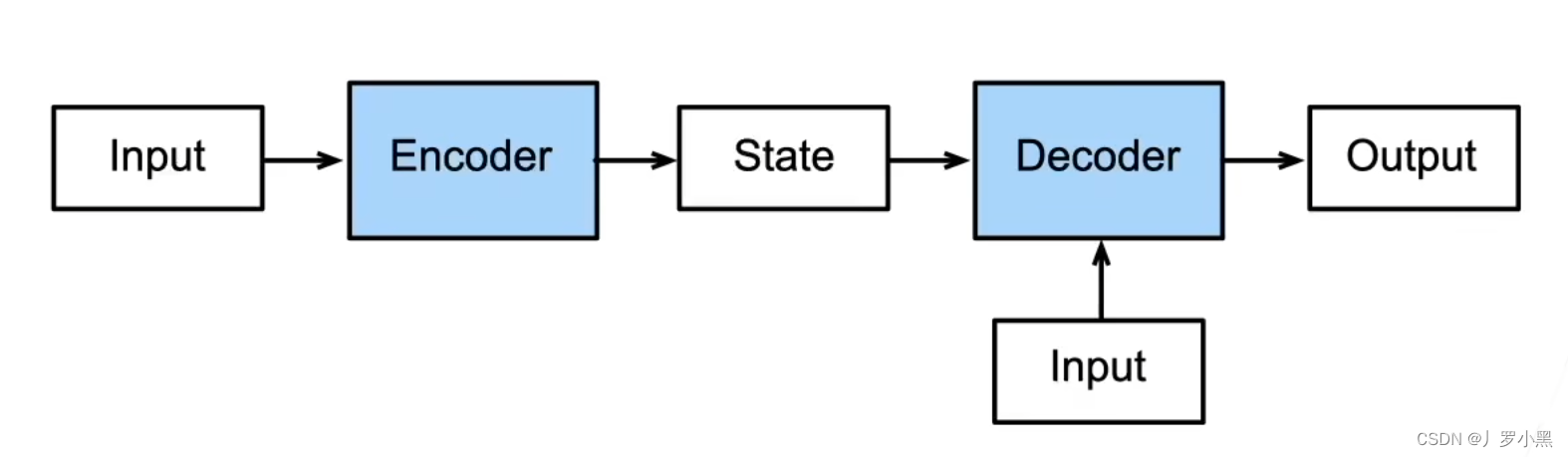

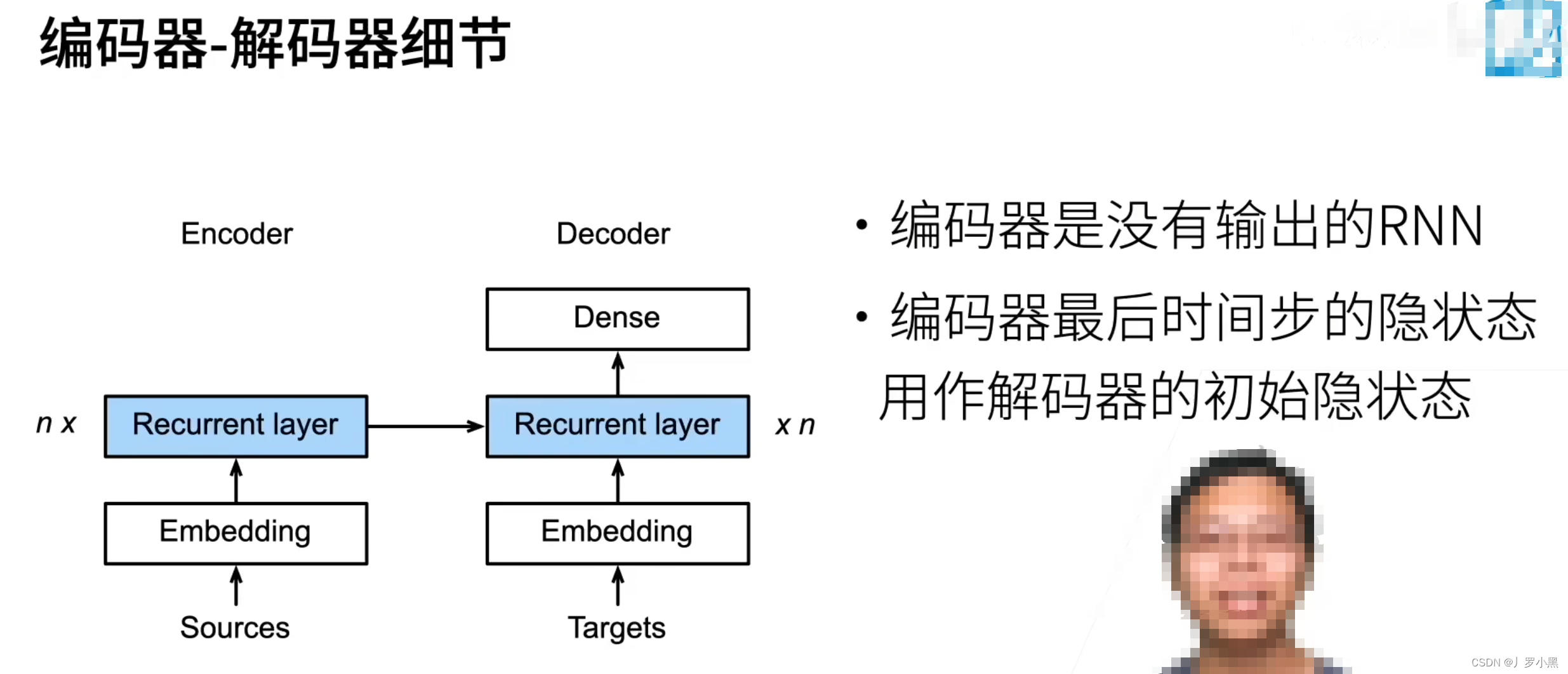

编码器-解码器结构

- 如果将一个模型分为两块:编码器和解码器

- 那么编码器-解码器结构为:编码器负责处理输入,解码器负责生成输出

- 流程:我们先将输入送入编码器层,得到一个中间状态state,并送入解码器层,和额外的输入一同处理后,得到模型的输出

- 在机器翻译中:人是由他的所有社会关系所决定的,那么词也是由它的所有语义关系所决定的,而这些语义关系组成了一个潜空间,编码器干的事就是找到一个能够很好表示这个词的潜空间,并把这个词编码成潜空间中的对象,解码器干的事就是将这个潜空间中的对象换一种语言解码出来

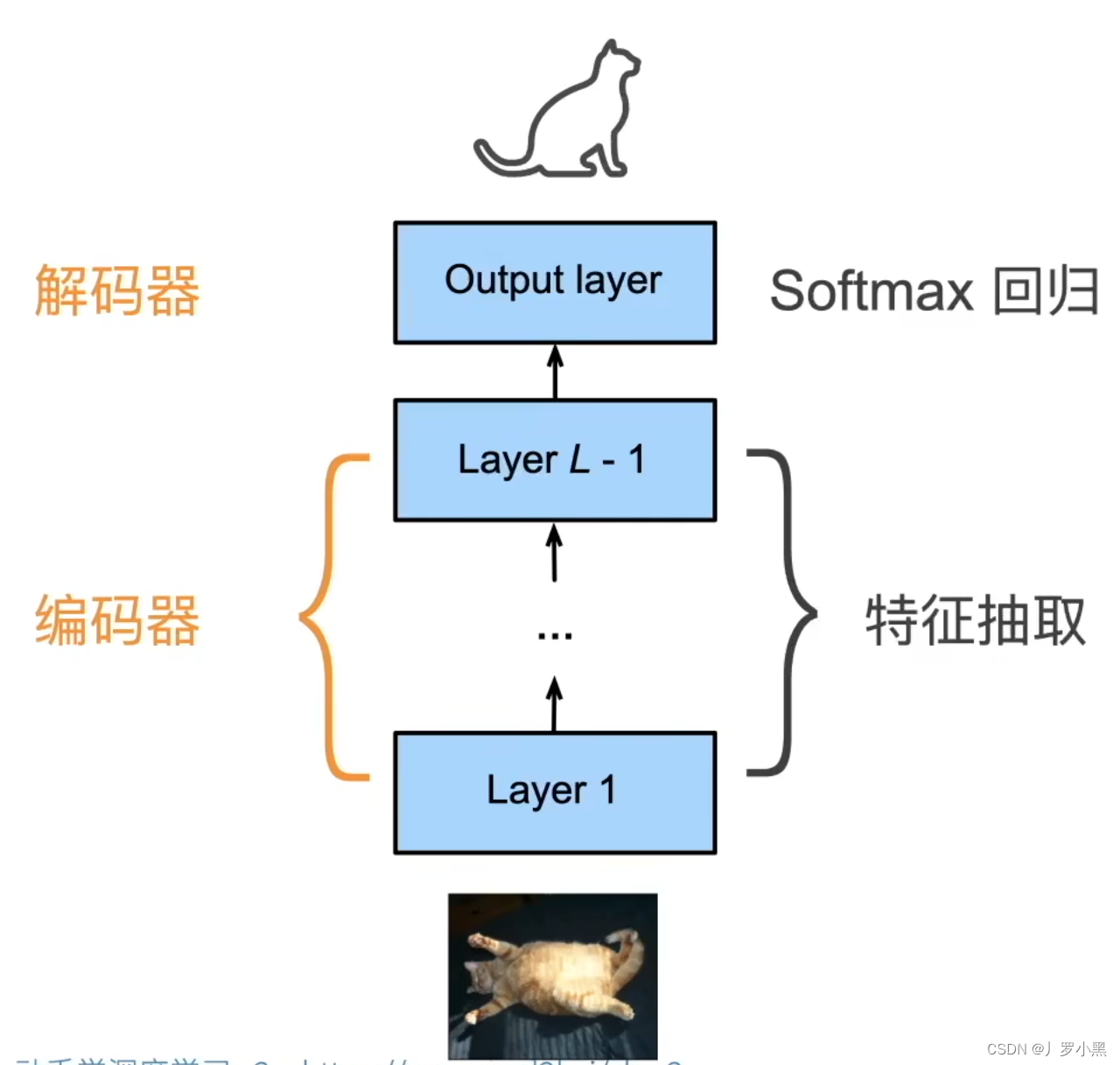

- CNN就可以重新表示为下图

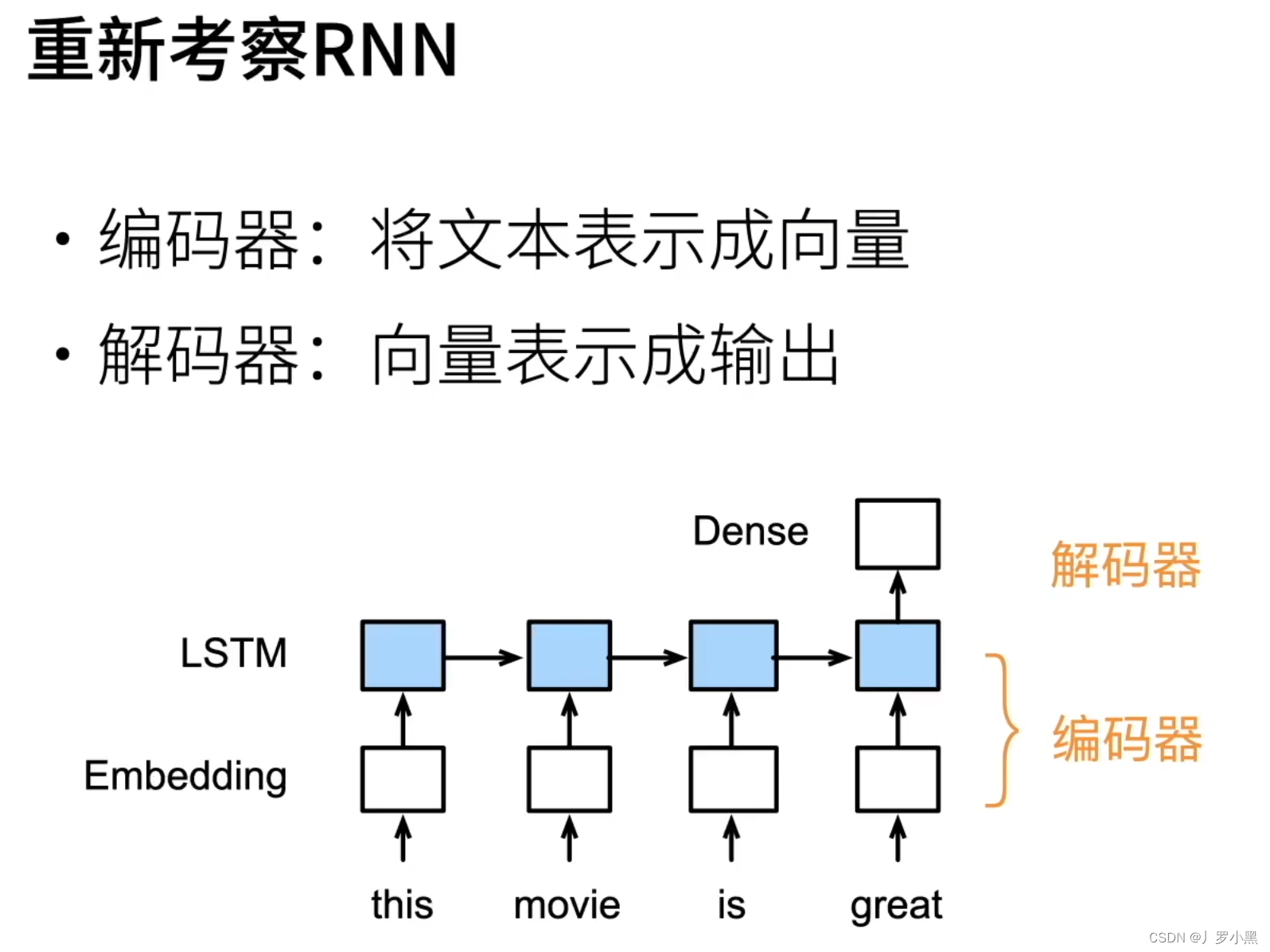

- RNN也可以表示为下图:

Seq2seq

- 序列到序列的模型:从一个句子生成到另一个句子

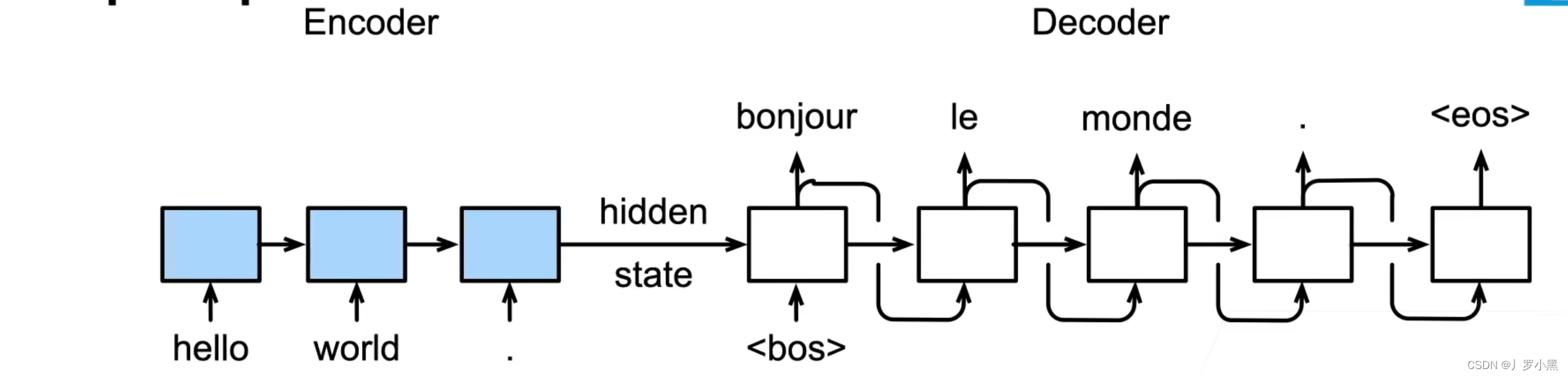

- 模型分为编码器、解码器两部分,其中,编码器可以是一个RNN,用来读取输入句子,解码器使用另外一个RNN来输出生成的句子

- 注意:由于在输入时,我们知道全部的输入句子,所以可以用两个RNN做双向,但是解码器是生成模型,不能看到完整的句子,所以不能做双向

- 注意:在编码器层,通过开始<bos>、结束<eos>来控制编码器的输出

- 编码器层的输出是不会作为模型的输出,相反它最后一层的输出作为编码器层输入的一部分,和编码器层额外的输入合并,整体作为编码器层的输入,即编码器层的最后隐藏状态,作为解码器的初始隐藏状态,如下:

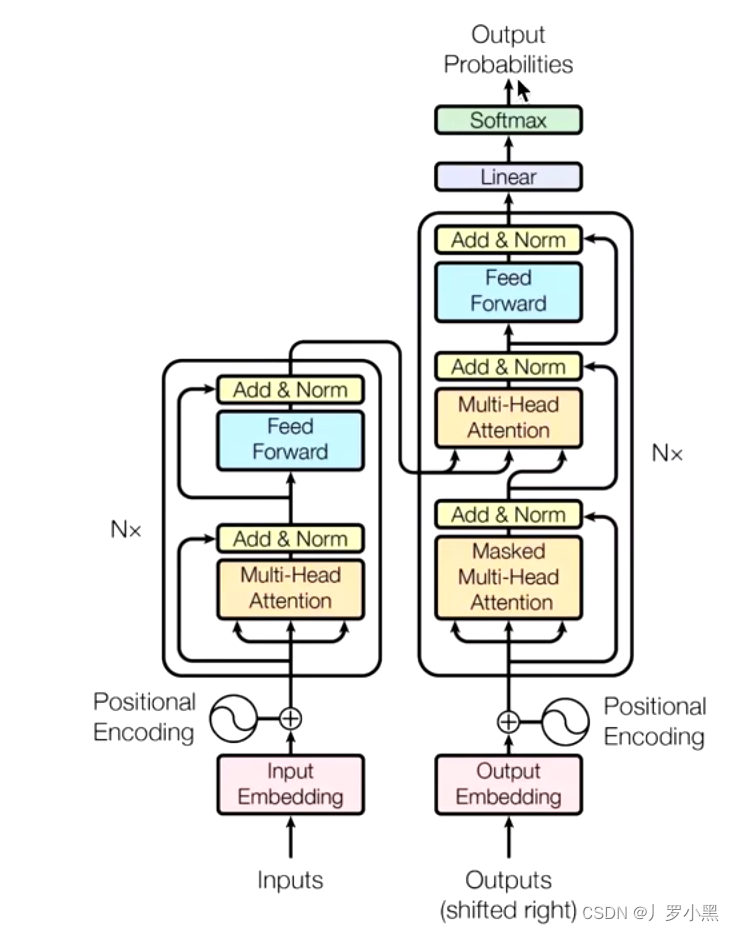

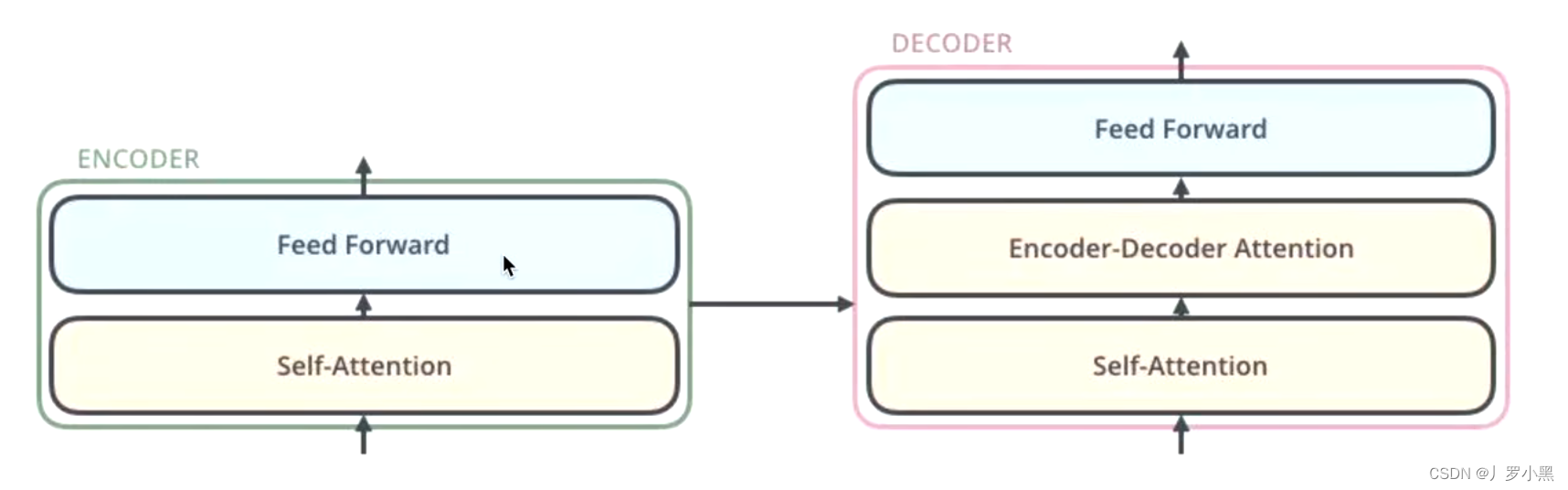

Transformer的框架概述

- NLP中预训练的目的:为了生成词向量

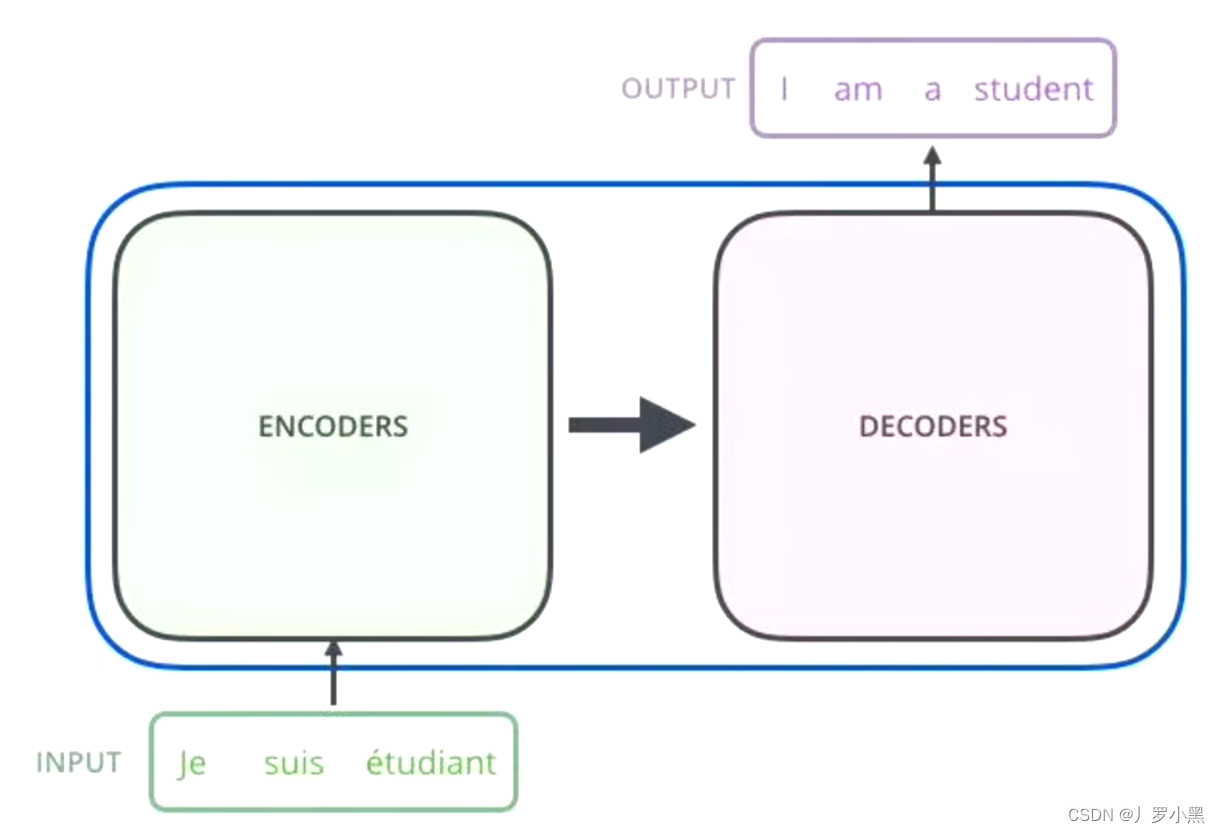

- Transformer采用了seq2seq(序列到序列)的模型,整体框架如下:

- seq2seq的模型基本都分为编码器层和解码器层,即从编码器到解码器的结构

- seq2seq的模型基本都分为编码器层和解码器层,即从编码器到解码器的结构

使用机器翻译的场景来解释

- 在机器翻译的场景中:

- 编码器层:把输入变成一个词向量

- 解码器层:得到编码器层输出的词向量后,生成翻译的结果

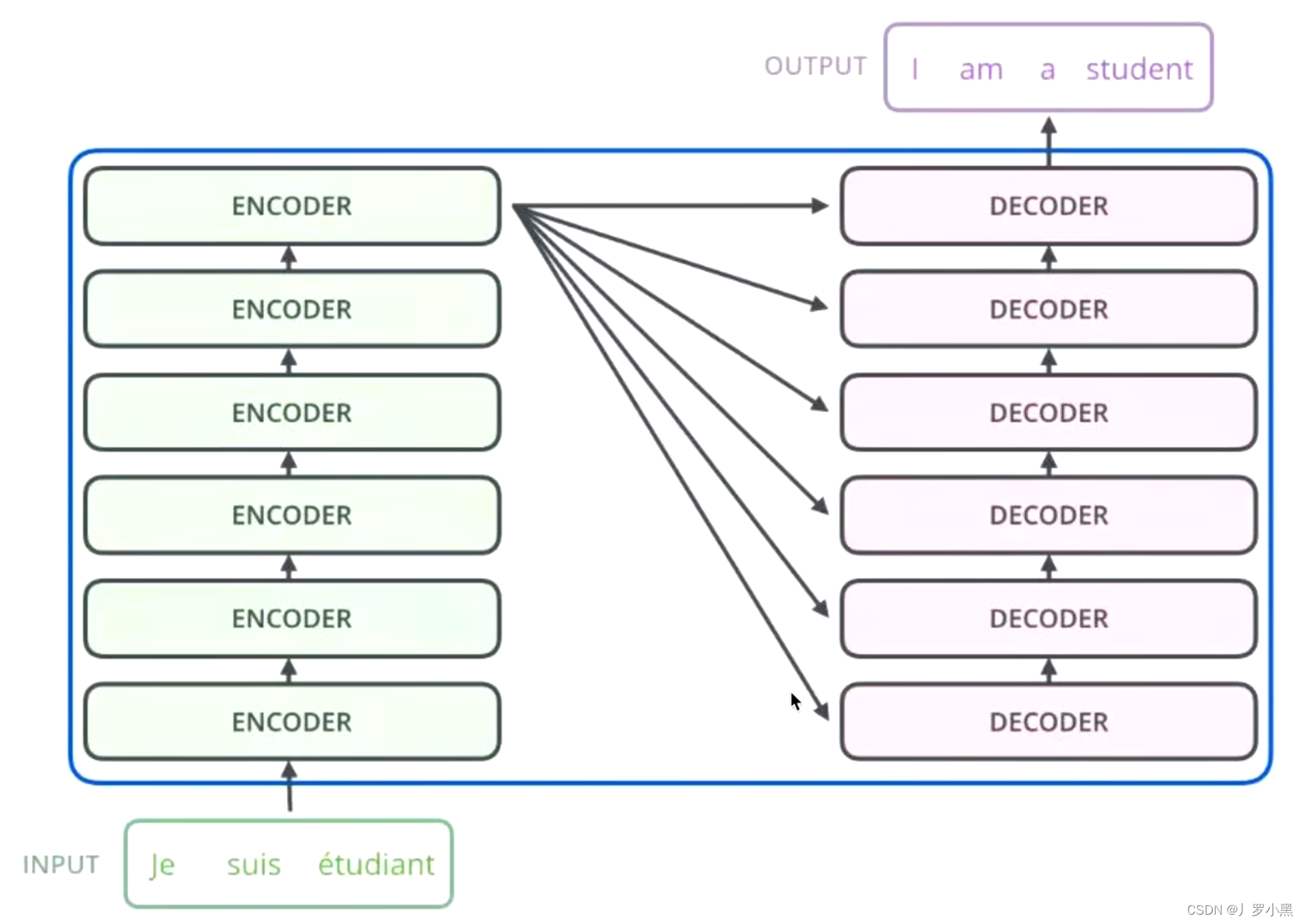

- 同时,N * 的意思是:编码器层里面又有N个小编码器(默认N=6),一个编码器可以看作Self-Attention,而Self-Attention会对词向量做增强,经过6个编码器,那就是增强了6次

- 编码器层最后的输出会分别给6个解码器

- 因此,Transformer的关键就在于编码器和解码器,如下:

参考文献

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/煮酒与君饮/article/detail/808559

推荐阅读

相关标签