热门标签

热门文章

- 1[转载]#人物表情的次级控制_huadingjin_新浪博客

- 2OpenCV学习笔记17_插值运算_opencv差值方法计算方法

- 3图像篡改数据集整理_图像篡改检测数据集

- 4哈工大人工智能研究院成立,四层次七方向引领AI发展

- 5Flink保姆级教程,超全五万字_flink 教程

- 6码农飞升记-04-OracleJDK 与 OpenJDK 的区别和联系以及 OracleJDK builds 与其他 OpenJDK builds 的选择问题_openjdk-6-src-b20-21_jun_2010

- 7【2023年算法比较】13种最新智能优化算法大比拼(Matlab代码实现)_最新的优化算法

- 8【论文解读】大模型事实性调查(上)

- 9达梦数据库DCP-索引管理_达梦数据库 强制走索引sql

- 10快速解决深度学习推理过程cuda或tensorRT推理速度变慢的办法【亲测有效】_nvidia-smi -lgc

当前位置: article > 正文

ABCNN基于注意力的卷积神经网络用于句子建模--模型介绍篇_基于注意力机制的卷积神经网络模型适合所有数据集吗

作者:盐析白兔 | 2024-04-25 10:24:49

赞

踩

基于注意力机制的卷积神经网络模型适合所有数据集吗

本文是Wenpeng Yin写的论文“ABCNN: Attention-Based Convolutional Neural Network for Modeling Sentence Pairs”的阅读笔记。其实该作者之前还发过一篇“Convolution Neural Network for Paraphrase Identification”。ABCNN是基于之前发的这篇论文加入了注意力机制。说到基于注意力的CNN,我们之前介绍过一篇Multi-Perspective CNN的论文。该论文也是在别的论文的基础上加入了注意力机制,但其实Attentin机制一般用于RNN模型会有比较好的效果,CNN的话也可以用==

相比这两篇Attention-based的论文,会发现,ABCNN提出了三个层面的Attention方法,有助于更加全面的理解attention在不同层面所能带来的不同作用。下面我们就来介绍一下该论文的模型。

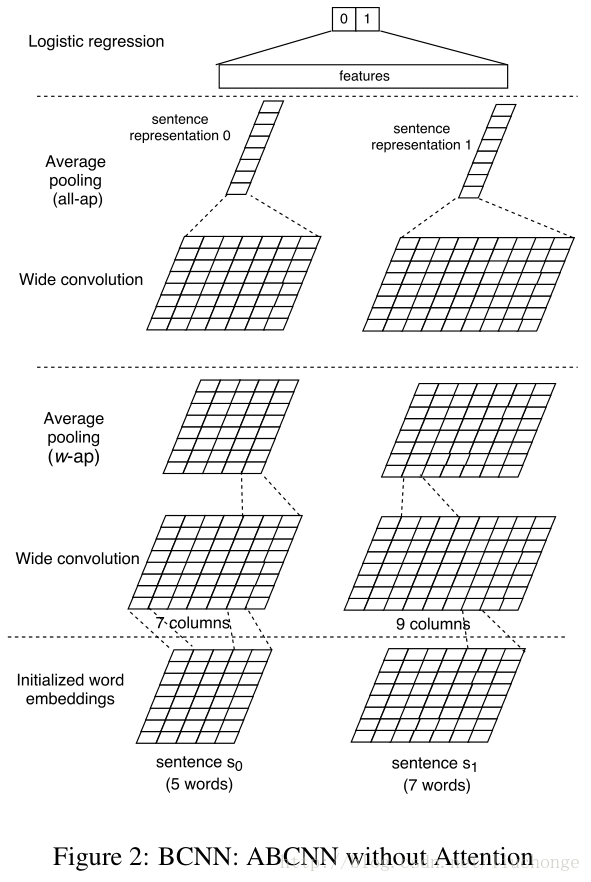

BCNN

BCNN就是ABCNN模型的基础,即没有添加Attention的模型结构。如下图所示:

1, 输入层:

就是将输入句子进行padding后转化成词向量即可。

2,卷积层:

当一开始看到这张结构图的时候我以为采用的是per-dim的卷积

推荐阅读

相关标签