热门标签

热门文章

- 1AXI Quad SPI IP核基于AXI接口的设计指南

- 2数据传输安全(为支付宝第三方做铺垫)

- 3解码2024:可解释人工智能的十大突破揭晓_2024年神经网络的可解释性这一大突破对于什么至关重要

- 4Android Gradle相关总结_gradle-6.7.1-all.zip

- 5Vue+OpenLayers 实现地图上添加 Echarts 环形图_openlayers在地图上添加效果

- 6毕业设计:基于深度学习的用户评价情感分析系统_怎么通过平均主题余弦相似度判断最优主题数

- 7vue3+vite+ts 使用webrtc-streamer播放海康rtsp监控视频_vue3 webrtc 播放

- 8NOI的1.5.39与7无关的数_noi与7无关的数csdn

- 9linux安装emqx_linux 更换emqx版本

- 10终于还是在上电时序问题上给自己挖了个坑

当前位置: article > 正文

粒子群算法优化支持向量机(pso-svm)

作者:盐析白兔 | 2024-06-17 12:04:21

赞

踩

pso-svm

粒子群优化SVM

其中代码部分经过测试,实测可用

步骤讲解

1、粒子群是优化的SVM的c和g,由于SVM中的c和g难以选择最优的,故选择PSO来优化,寻找最优的粒子点来作为SVM的c和g。

2、从随机解出发,通过迭代寻找最优解,通过适应度来评价解的质量(适应度函数中打印优化的准确度)。

3、PSO初始化为一群随机粒子(随机解),然后通过迭代找到最优解。所有的粒子具有位置(particle_position_vector)和速度(velocity_vector)两个属性。 在每一次迭代中,粒子通过粒子本身所找到的最优解pbest和整个种群目前找到的最优解全局极值gbest来更新。

4、适应度值(实际上是svm的一次运行)

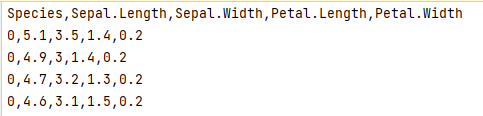

5、下面代码中的iris.csv前三行展示:

代码

import pandas as pd import numpy as np import random from sklearn.svm import SVC import matplotlib.pyplot as plt from sklearn.model_selection import cross_val_predict from sklearn.metrics import confusion_matrix from sklearn.preprocessing import StandardScaler from sklearn.model_selection import cross_val_score # 1.读取训练数据集 data = pd.read_csv(r"iris.csv") x = data.iloc[:, 1:] Y = data.iloc[:, 0] # print(x.shape) # 2.标准化 scaler = StandardScaler() X = scaler.fit_transform(x) # 3.初始化参数 W = 0.5 # 惯性因子 c1 = 0.2 # 学习因子 c2 = 0.5 # 学习因子 n_iterations = 10 # 迭代次数 n_particles = 50 # 种群规模 # 4.设置适应度值 输出分类精度得分,返回比较分类结果和实际测得值,可以把分类结果的精度显示在一个混淆矩阵里面 def fitness_function(position): # 输出 # 全局极值 svm分类器 核函数gamma 惩罚参数c svclassifier = SVC(kernel='rbf', gamma=position[0], C=position[1]) # 参数gamma和惩罚参数c以实数向量的形式进行编码作为PSO的粒子的位置 svclassifier.fit(X, Y) score = cross_val_score(svclassifier, X, Y, cv=10).mean() # 交叉验证 print('分类精度',score) # 分类精度 Y_pred = cross_val_predict(svclassifier, X, Y, cv=10) # 获取预测值 # 返回混淆函数,分类误差矩阵,分别是训练中的 测试中的 下面输出错误分类结果 return confusion_matrix(Y, Y_pred)[0][1] + confusion_matrix(Y, Y_pred)[0][2] + confusion_matrix(Y, Y_pred)[1][0] + \ confusion_matrix(Y, Y_pred)[1][2] + confusion_matrix(Y, Y_pred)[2][0] + confusion_matrix(Y, Y_pred)[2][1]\ , confusion_matrix(Y, Y_pred)[0][1] + confusion_matrix(Y, Y_pred)[0][2] + confusion_matrix(Y, Y_pred)[1][0] + \ confusion_matrix(Y, Y_pred)[1][2] + confusion_matrix(Y, Y_pred)[2][0] + confusion_matrix(Y, Y_pred)[2][1] # 5.粒子图 def plot(position): x = [] y = [] for i in range(0, len(particle_position_vector)): x.append(particle_position_vector[i][0]) y.append(particle_position_vector[i][1]) colors = (0, 0, 0) plt.scatter(x, y, c = colors, alpha = 0.1) # 设置横纵坐标的名称以及对应字体格式 #font2 = {'family': 'Times New Roman','weight': 'normal', 'size': 20,} plt.xlabel('gamma') # 核函数 plt.ylabel('C') # 惩罚函数 plt.axis([0, 10, 0, 10],) plt.gca().set_aspect('equal', adjustable='box') # #设置横纵坐标缩放比例相同,默认的是y轴被压缩了。 return plt.show() # 6.初始化粒子位置,进行迭代 # 粒子位置向量 particle_position_vector = np.array([np.array([random.random() * 10, random.random() * 10]) for _ in range(n_particles)]) pbest_position = particle_position_vector #个体极值等于最初位置 pbest_fitness_value = np.array([float('inf') for _ in range(n_particles)]) #个体极值的适应度值 gbest_fitness_value = np.array([float('inf'), float('inf')]) #全局极值的适应度值 gbest_position = np.array([float('inf'), float('inf')]) velocity_vector = ([np.array([0, 0]) for _ in range(n_particles)]) # 粒子速度 # 迭代更新 iteration = 0 while iteration < n_iterations: # plot(particle_position_vector) # 粒子具体位置 for i in range(n_particles): # 对每个粒子进行循环 fitness_cadidate = fitness_function(particle_position_vector[i]) # 每个粒子的适应度值=适应度函数(每个粒子的具体位置) # print("粒子误差", i, "is (training, test)", fitness_cadidate, " At (gamma, c): ", # particle_position_vector[i]) if (pbest_fitness_value[i] > fitness_cadidate[1]): # 每个粒子的适应度值与其个体极值的适应度值(pbest_fitness_value)作比较,如果更优的话,则更新个体极值, pbest_fitness_value[i] = fitness_cadidate[1] pbest_position[i] = particle_position_vector[i] if (gbest_fitness_value[1] > fitness_cadidate[1]): # 更新后的每个粒子的个体极值与全局极值(gbest_fitness_value)比较,如果更优的话,则更新全局极值 gbest_fitness_value = fitness_cadidate gbest_position = particle_position_vector[i] elif (gbest_fitness_value[1] == fitness_cadidate[1] and gbest_fitness_value[0] > fitness_cadidate[0]): gbest_fitness_value = fitness_cadidate gbest_position = particle_position_vector[i] for i in range(n_particles): # 更新速度和位置,更新新的粒子的具体位置 new_velocity = (W * velocity_vector[i]) + (c1 * random.random()) * ( pbest_position[i] - particle_position_vector[i]) + (c2 * random.random()) * ( gbest_position - particle_position_vector[i]) new_position = new_velocity + particle_position_vector[i] particle_position_vector[i] = new_position iteration = iteration + 1 # 7.输出最终结果 print("全局最优点的位置是 ", gbest_position, "在第", iteration, "步迭代中(训练集,测试集)错误个数:", fitness_function(gbest_position))

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

- 88

- 89

- 90

- 91

- 92

- 93

- 94

- 95

- 96

- 97

- 98

- 99

- 100

- 101

- 102

- 103

本文内容由网友自发贡献,转载请注明出处:https://www.wpsshop.cn/w/盐析白兔/article/detail/731125

推荐阅读

相关标签