热门标签

热门文章

- 1盘点一下全网最有趣的代码注释_▄█ █●

- 2用MySQL Workbench导出ER图和数据字典_mysql导出er图带注释

- 3安阳旅游地图规划(未完成)

- 4Git配置代理:fatal: unable to access*** github Failure when receiving data from_failure when receiving data from the peer

- 5RabbitMQ, DelayQueue, Redis的介绍以及IDEA的实现

- 6C++:map和set的使用

- 7Mysql之进阶查询语句

- 8【一文详解】知识分享:(MySQL关系型数据库快速入门)_关系型数据库基础

- 9k8s之helm入门

- 10MySql-增删查改及其他语法_mysql增删改查语法

当前位置: article > 正文

torch.mean 或 x.mean

作者:知新_RL | 2024-04-17 17:02:05

赞

踩

x.mean

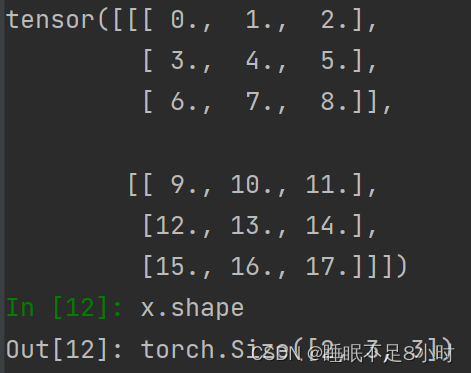

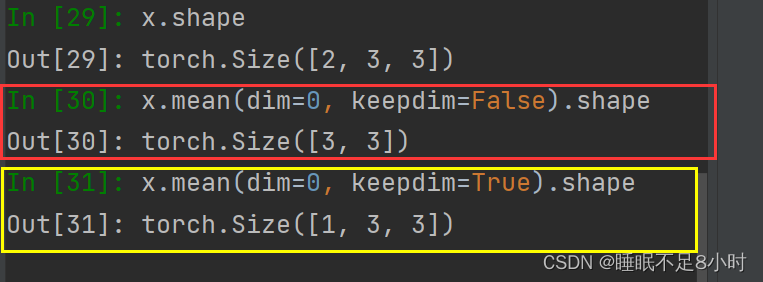

以shape为(2, 3, 3)的tensor为例,理解x.mean或torch.mean的用法

1. 创建tensor

import torch

x = torch.arange(18, dtype=torch.float32).view(2, 3, 3)

- 1

- 2

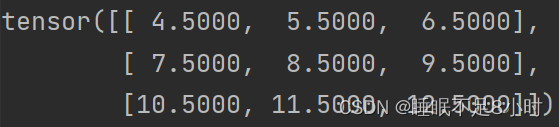

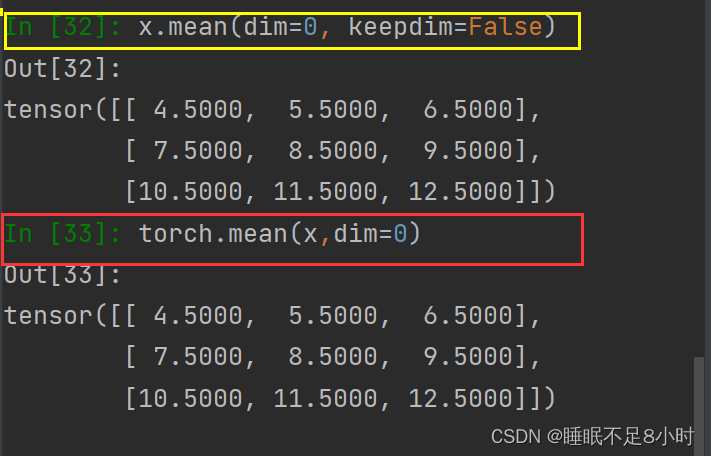

2. dim=0时

dim_0 = x.mean(dim=0)

print(dim_0)

- 1

- 2

输出结果:

可以看出,dim=0时,在x的通道维度进行了求平均,以dim_0[0][0]为例,dim_0[0][0] = (x[0][0][0]+x[1][0][0])/2。

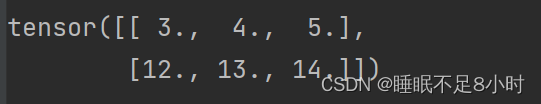

3. dim=1时

dim_1 = x.mean(dim=1)

print(dim_1)

- 1

- 2

输出结果:

可以看出,当dim=1时,在x的行方向(或者说高H方向)进行求平均,以dim_1[0][0]为例,dim_1[0][0] = (x[0][0][0]+x[0][1][0]+x[0][2][0])/3。

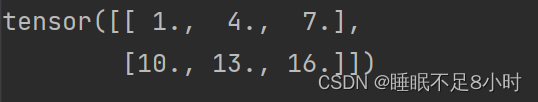

4. dim=2时

dim_2 = x.mean(dim=2)

print(dim_2)

- 1

- 2

可以看出,当dim=2时,在x的列方向(或者说宽W方向)进行求平均。

5. dim=[1, 2]

dim_1_2 = x.mean(dim=[1, 2])

print(dim_1_2)

- 1

- 2

输出结果:

![dim=[1, 2]](https://img-blog.csdnimg.cn/ba96989d19514890b2ae891fba7c19af.png)

在行方向求平均的结果上再沿列方向求平均

6. dim=[0, 1]

dim_0_1 = x.mean(dim=[0, 1])

print(dim_0_1)

- 1

- 2

输出结果:

可以看出,keepdim=True时维度保持不变

x.mean(dim)与torch.mean(x,dim)

x.mean(dim)与torch.mean(x,dim)能够实现相同的效果。

以上均为个人理解,如有错误或不妥之处,欢迎大家批评指正!!

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/知新_RL/article/detail/441252

推荐阅读

相关标签