- 1unbutu20.04搭建ardupilot环境_ubuntu20.04安装和配置ardupilot

- 2什么是NLP分词(Tokenization)

- 3mac切换root用户的方法_mac 免密切换root

- 4FFMPEG Mac版本编译

- 5动态计算el-table高度_el-table动态高度

- 6Flink高手之路:Flink的环境搭建_flink环境搭建

- 7fasttext工具的使用及迁移学习_fasttext 已有分类模型 迁移学习

- 8基于python+vue的ITS 信息平台的设计与实现flask-django-nodejs-php

- 9XPM小结_xpm fifo

- 10通俗易懂,车载显示屏简单介绍!_车载显示器结构图解

AI绘画的救星!手把手教你在ComfyUI玩转局部重绘!

赞

踩

我们在用AI创作图片的时候,通过模型和提示词,让AI有了很大的随意发挥空间,这种随意发挥带来了很多随机性和不确定性,大部分情况下会给我们带来更多的惊喜。但是总会有一些时候,有一些小细节不尽人意

这个时候,我们就需要一个很普通,却很重要的功能——局部重绘

我们可能会经常遇到以下几个场景

-

图片的某个细节有缺陷

-

提示词污染导致部分细节不准确

-

整体都很好,但是想换个发色/衣服/裙子

这些时候,就需要用到局部重绘

什么是局部重绘

在使用AI绘画时,尽管可以通过调整模型和参数来获得好的作品,但准确性问题仍然存在。AI的扩散算法虽然带来了无限可能,但也可能导致一些意料之外的结果,如不自然的四肢或元素的错误放置。幸运的是,Stable Diffusion的局部重绘功能可以解决这些问题。

为了方便演示,我们用以下参数先批量生产一堆美女

1. CheckPoint模型:XXMix_9realisticSDXL

2. Lora模型:无

3. 采样器:dpmpp 2m sde karras

4. 采样步数:30

5. 提示词:

Best quality, masterpiece, (photorealistic:1.5),8k, raw photo,xxmixgirl,wide shot, 1girl, offshoulder, bare shoulders,sexy, white dress,long hair,lie in bed,beautiful eyes,sunlight shining on hair,the window is covered in flowers,outside the window is nature,facing the camera,there are flowers on the hair

局部重绘操作

局部重绘类似于修正,可以直接覆盖并重绘图像的特定区域。例如,如果我想改变角色的头发颜色,可以通过在正向提示词中加入特定提示词,并调整重绘幅度来实现。这个过程在Stable Diffusion中可以实现,甚至现在Midjourney也开始支持局部重绘了,今天我们从ComfyUI的角度来讲如何实现局部重绘

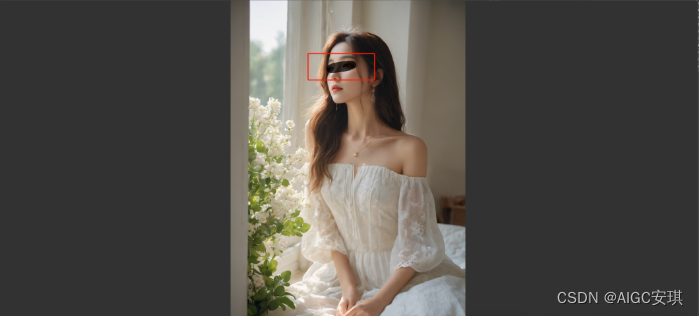

我们就拿其中一张画出来的美女图为例,整体都非常好,但是她的眼睛,看起来好像颜色不对,我们就用局部重绘来修正眼睛的缺陷

通常来说,ComfyUI中的局部重绘可以细分为以下几个步骤

1.搭建工作流

局部重绘整体的工作流其实就是一个图生图的工作流,只不过我们需要对图像加载的部分添加遮罩。

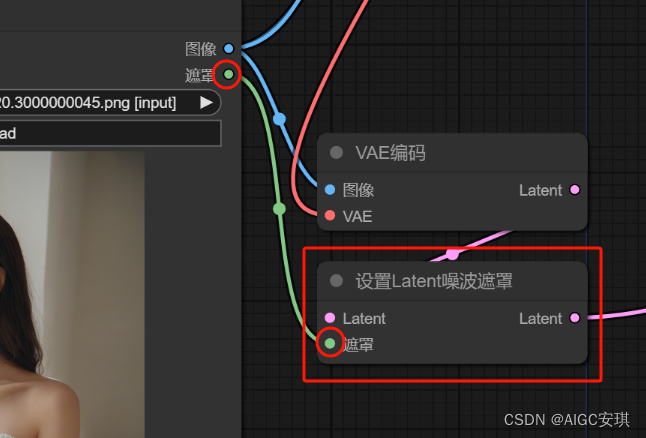

通常我们搭建一个图生图的工作流时,我们会用“VAE编码”节点来把图像进行像素空间到潜空间的转化,然后再链接传给KSampler采样器的Latent。

当我们要使用遮罩时,则需要在“VAE编码”节点和KSampler节点中间,再加一个“设置Latent噪波遮罩”节点来传递遮罩信息

设置Latent噪波遮罩

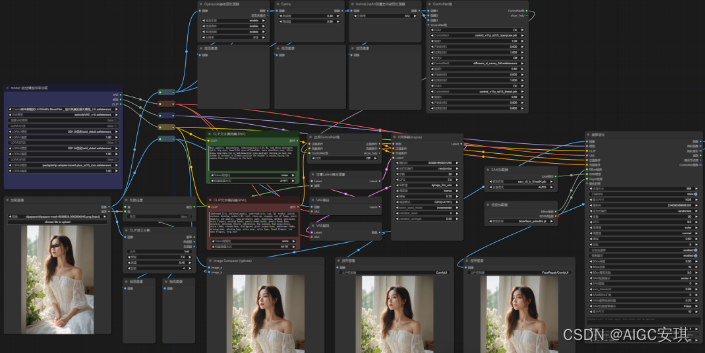

以上就是重绘的基础部分了,仅仅是在基础图生图的基础上加上遮罩即可。为了方便使用,我对工作流加了亿点点细节,加了ControlNet,加了ClipSeg语义分割,以及面部修复,这里我们先跳过,后面我会细讲。

文末可以获取完整工作流文件

工作流

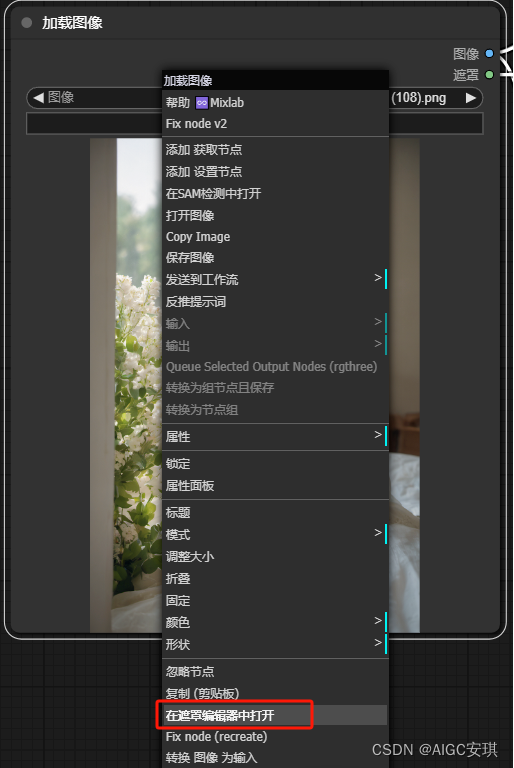

2.选择重绘区域

在WebUI中,可以用局部重绘功能,用画笔涂抹想要重绘的部分,而在ComfyUI中,其操作也类似,我们对图像加载节点右键就可以看到“在遮罩编辑器中打开”

遮罩编辑器

接下来,我们通过遮罩编辑器涂抹眼睛的部分,然后点击save to node,就可以保存你涂抹的区域

遮罩编辑器

3.修改重绘提示词

我们可以保留大部分的提示词,但是需要稍微修改一下,改成我们需要的提示词,比如我们想让她闭眼,则加上“closed eyes”,想要眼睛变成蓝色,则加上“blue eyes”

比如在上面的例子中,我分别尝试了用“closed eyes”,和“beautiful eyes”来分别尝试让人物闭眼,和直接修复眼睛,得到的结果如下图(左边是原图,中间是闭上眼睛,右边是修复眼睛)

眼睛修复

我个人认为直接闭眼的感觉更好

4.调整参数抽卡

对于局部重绘的图片,在模型选择上其实很简单,主要也就分为写实模型和动漫模式,依据你的原图选择模型即可。其他的如采样方法、采样步数、以及降噪参数等,就按照普通的图生图设置来就行。以下是我重绘的参数,仅作参考

1. CheckPoint模型:麦橘V7

2. Lora模型:无

3. 采样器:dpmpp 2m sde karras

4. 采样步数:30

5. 降噪:0.8

前面只是修改了一下眼睛,效果不是很明显,我们换个例子,直接换衣服来看看具体效果。对于以下提示词,我只需要不断修改“white dress”为各种颜色的衣服,就可以看到不同的换装效果

Best quality, masterpiece, (photorealistic:1.5),8k, raw photo,xxmixgirl,

1girl, solo, long hair, breasts, looking at viewer, (white dress:1.2), simple background, black hair, cleavage, bare shoulders, brown eyes, jewelry, medium breasts, collarbone, cowboy shot, earrings, grey background, necklace, off shoulder, bag, lips, realistic,

- 1

- 2

换装

进阶应用技巧

1.SAM检测获取蒙版

局部重绘除了使用画笔来绘制遮罩层以外,还有很多高级技巧来得到遮罩蒙版,比如ComfyUI中通过SAM检测来自动获取蒙版,而不需要我们手动绘制,它的效果很类似于WebUI中的inpaint anything插件。

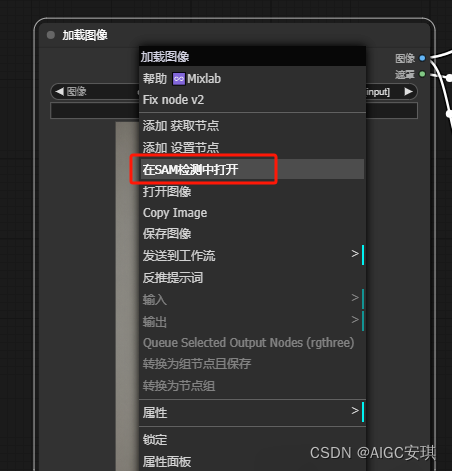

SAM检测的使用方式很简单,在加载图像节点右键就可以打开

SAM检测

然后我们只需要对想要选择的部分点几下即可,然后点击detect,就能自己检测选取,如果范围太大,就拉动下面的滑块来缩小选取范围(比如以下就是我选择上衣部分)

SAM检测

很多时候,SAM自动检测会有一些选不到或多选的地方,这时候,我们还可以关掉SAM之后,在遮罩编辑器中继续涂抹,组合使用,精准选取

2.提示词自动检测

很多时候,有人在使用ComfyUI时会追求全自动,如果你连遮罩选取这一步都不想手动操作怎么办?当然也可以了!

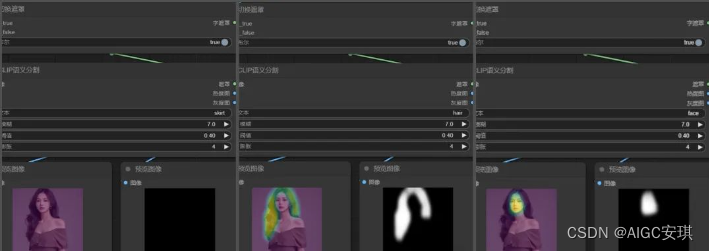

使用“CLIP语义分割”节点就可以实现这样的功能,我们添加“CLIP语义分割”节点,它就能根据你输入的提示词自动创建遮罩,我们通过简单的节点链接就可以把遮罩传递到下一步

如下图,我分别用“skirt”、“hair”和“face”提示词,就能自动检测到“裙子”、“头发”和“脸部”

提示词自动检测

遮罩都能做到自动创建了,那其他节点的自动化就更容易了!

3.结合ControlNet

前面讲工作流的时候可以看到我在里面加了ControlNet应用堆,用于添加多个ControlNet,你可能会有疑问,局部重绘,要ControlNet干什么呢?

原因很简单,如果你只是重绘眼睛,让人物睁眼闭眼,ControlNet的确没有什么作用。但如果你是换装操作,如果不做一些人物姿态或者线条的固定,人物很容易跑偏,造成重绘部分与整体不和谐的情况。所以我加入了lineart和openpose来进行一定的整体结构的控制

同理的还有工作流中的脸部修复,如果仅仅是想修复人物面部,完全可以用脸部修复节点直接修复即可

在ComfyUI中可以尽情组合各个节点,充分发挥节点工作流的优势!

ControlNet

结尾

以上就是在ComfyUI中进行局部重绘的方法了,相比于WebUI,它更加的灵活,我们可以把任何节点串起来,自由组合,只要足够有创意,就能做出各种各样的工作流。

局部重绘技术为AI艺术创作带来了新的可能,有了局部重绘,对很多应用场景都有实际意义:

-

修复常见的手崩,脸崩,多手,多脚等问题

-

对已有图像优化,如修改人物瞳孔颜色,发色等

-

对模特进行换装,常用于电商场景

感兴趣的小伙伴,赠送全套AIGC学习资料,包含AI绘画、AI人工智能等前沿科技教程和软件工具,具体看这里。

资料软件免费放送

次日同一发放请耐心等待

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

需要的可以扫描下方CSDN官方认证二维码免费领取【保证100%免费】

**一、AIGC所有方向的学习路线**

AIGC所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、AIGC必备工具

工具都帮大家整理好了,安装就可直接上手!

三、最新AIGC学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、AIGC视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

这份完整版的学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】