- 1使用码云提交文件操作步骤

- 2APOLLO 7.0安装编译_apollo 重编译

- 3分布式存储系统 | 纠删码(Erasure Coding),以Reed-Solomon(RS)码为例_纠删码和副本冗余的说法

- 4Python轴承故障诊断 (五)基于EMD-LSTM的故障分类_故障诊断与python学习视频

- 5【BMC】OpenBMC开发基础4:Web开发基础_openbmc用的什么web

- 6python入门小项目--石头剪刀布(人机对战)--图形化tkinter_python实现石头剪刀布图像化

- 7【原创】不想一轮游?大厂面试官教你怎么过笔试_蚂蚁笔试题没做出来

- 8PiflowX组件-WriteToUpsertKafka

- 9MySQL的下载安装以及环境配置---图文教程_mysql下载教程

- 102019年上半年软考信息安全工程师上午真题及答案解析_我国sm3算法被采纳为新一代宽带无线移动通信系统 (lte) 国际标准

Ubuntu下安装Hadoop所有步骤教程,从虚拟机安装到Hadoop测试_如何在ubuntu中解压hadoop

赞

踩

- 安装虚拟机VMware

注意: 1要选自定义高级

2第一次安装虚拟机,要选稍后安装操作系统

3选择Linux操作系统

4存储目录建议不要放在C盘

5处理器根据自己的电脑进行选择,电脑配置好,存储空间还很大的话可以改成2或4

6网络类型选择NAT;

7选择磁盘要选择创建新虚拟磁盘

8并选择将虚拟磁盘拆分成多个文件,有利于减少电脑的磁盘容量

9其他的都选默认模式即可

10完成虚拟机安装之后不要点击完成,点击自定义硬件进行Ubuntu的安装

- 下载ubuntu进行系统的安装

1在你点击自定义硬件之后选择左边菜单栏里的CD/DVD(SATA)

2然后看右边找到使用IOS映像文件(在这之前你已经把Ubuntu已经下载好了,下载一定要去官网下载)

3点击虚拟机进行运行,之后就是选择中文等待安装即可(如果提示要安装tools工具,建议不要安装)

- 进行防火墙的关闭

关闭防火墙命令:Sudo ufw disable

查看防火墙的状态的命令:sudo ufw status

显示为不活动说明防火墙已经关闭。

- 安装SSH

- Ubuntu是默认安装ssh客户端的,用命令:sudo dpkg- 1 | grep ssh进行查看。

如果返回包含“openssh-client”就表示已经安装了ssh客户端

- 安装SSH服务端软件,安装命令:sudo apt-get install openssh-server

- 重启ssh,命令:sudo /etc/init.d/ssh restart

- 下载Xshell和Xftp进行安装(安装到自己的电脑上,不是安装在虚拟机中)

- 在虚拟机看自己的IP地址的命令:ip addr,记住自己的ip地址,然后进行xshell的连接

- 之后在官网下载jdk和hadoop通过xshell中的xftp进行传输到虚拟机就行

注意:只需要传输到虚拟机的主目录就可以,这样方便查找

- 安装jdk并进行jdk环境的配置

1.进行解压有两种方法

第一种:如果对自己敲命令比较自信可以按照课本进行命令输入解压

第二种:在主目录找到传过来的解压包,点击右键,找到解压到此处即可,解压之后把文件名修改的简短一点,这样后期配置jdk环境的时候比较方便(建议修改时只留jdk三个字母,把后面的版本号删除即可)

2.建立jdk连接(看课本进行命令的输入),这一步看自己意愿,建立连接的意思就是创建一个快捷方式

3.配置JDK环境变量也是两种方法(这里主要说第二种)

第一种:照着课本进行输入,该方法进行环境变量的配置时比较麻烦

第二种如下图:找到画横线的那一句,之后就可以进入一个文本里进行编辑,这样比较方便

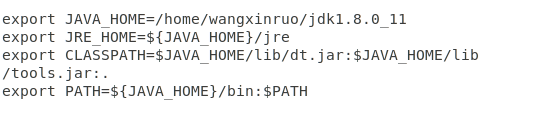

进入文本之后就进行环境的配置就可以。下图是我的配置可以进行借鉴

要注意这里的地址要根据自己的情况填写,如果你不知道路径是在哪里可以找到你解压的jdk文件右键点击属性进行查看

(1)使设置生效

命令:source ~/.bashrc

(2)配置完之后进行检验

命令:java -version

(注意:成功之后会显示版本号。如果提示没有成功,可能是你的权限太低通过输入:su这两个字母进行权限提升,如果认证失败,通过输入:sudo passwd(注意着两个字母中间有一个空格)进行密码的修改然后在通过:su进行权限提升即可。之后再通过课本中的命令进行检验。)

- Hadoop的安装与环境变量的配置,与JDK步骤一致:下图是我的hadoop环境配置

(注意:判断成功与否命令不一样,判断Hadoop是否环境搭配成功

命令:whereis hdfs

命令:whereis start-all.sh,这两种命令都要输一下)

- 再次克隆出两台主机:通过虚拟机找到上方菜单栏上的虚拟机—>管理——>点击克隆就可以了,一定要创建完整克隆,克隆出的电脑我在这里称作s1,s2主电脑称作m。你可以根据自己的意愿去配置。这样方便我下面的配置说明。

- Hadoop的安装与完全分布式的安装(只安装完全分布式模式就可以了)

- 通过命令:ip addr进行ip地址的获取(记住改地址,后面需要)

- 修改主机名:sudo vi /etc/hostname进入之后将原有内容删除并修改成node1

- 输入命令:sudo reboot进行重启使命令生效

- 重复步骤2,3修改另外两台主机,修改成node2,node3

- 映射ip地址及主机名(要在三台电脑都进行此操作)

通过命令:sudo vi /etc/hosts进入并在文件末尾添加:

Ip地址(m电脑的地址) node1

Ip地址(s1地址) node2

Ip地址(s2地址) node3

注意:这三行都要写上,地址就是你开头通过命令查找的地址

- 进行免密登陆:

(注意:这一步操作是基于你的三个虚拟机都打开的时候,如果你的电脑不能同时打开三个虚拟机就要看情况了。只能打开一个虚拟机,你就要找到电脑里的服务,关闭一些软件,再试一试,如果还是不行那只能加一个内存条了。如果你电脑能打开两个虚拟机,你就要两个两个的进行连接,比如你只打开了m和s1,那你只需现在这两台电脑输入一下命令,再换成m和s2,然后是s1,s2)

- 通过命令:ssh-keygen -t rsa生成秘钥对(要按三次回车)

- 通过命令:ls ~/.ssh进行查看

- 通过命令:(输入此命令是,你开的哪个虚拟机输入哪个命令,比如你只打开了m和s1,就只输入前两条就行)

ssh-copy-id -i ~/.ssh/id_rsa.pub node1

ssh-copy-id -i ~/.ssh/id_rsa.pub node2

ssh-copy-id -i ~/.ssh/id_rsa.pub node3

注意,是敲完一行执行完之后再敲,在执行的时候出现[yes/no],要选择输入yes,不要只输入一个y

- 输入命令:

ssh node1

ssh node1

ssh node1

查看主机的变化

- 安装NTP,这里需要在三台虚拟机上都要安装

安装NTP服务命令:sudo apt-get install ntp

查看是否运行成功命令:sudo dpkg-1 | grep ntp

- 设置hadoop配置文件也是有两种办法(这里也主要讲第二种方法)

1.按照课本进行修改

2.找到你解压的hadoop文件夹,点击进入etc在找到hadoop点击进入,根据需要配那些文件,点击进入进行修改就可以了。

(1)设置hadoop-env.sh,只需要配置这一句即可,根据自己的实际情况更改目录

(2)设置core-site.xml,只需要改划横线的地方。

第一个划横线地方,根据自己的实际情况,你通过命令设置的主机名是什么你就写什么。我这里写的主机名是node1,其他地方不要改。

(3)设置hdfs-site.xml,这个直接照着敲就可以,这个dfs,replication主要是你克隆了几个主机,就写几就行。这里咱们克隆了两个主机。

(4) 设置mapred-site.xml,文件夹里没有这个目录

- 设置yarn-site.xml

(6) 设置slavers文件。设置slaver文件,就是指定哪些主机是slavers。讲slavers文件中的原有内容全部删除。添加

node2

node3

- 分发配置(两种方法)

将node1的配置文件分发至node2,node3

第一种:通过命令发送

命令:cd ~/hadoop/etc(说明:根据你自己的地址进行编写)

命令:scp -r hadoop(这个写你自己的用户名) hadoop@ node2:~/hadoop/etc(这里写你自己的地址)

命令:scp -r hadoop(这个写你自己的用户名) hadoop@ node3:~/hadoop/etc(这里写你自己的地址)

第二种方法:通过你的Xftp,把你node1配置好的文件先通过虚拟机传送到你的本机上,再送本机传送到node2和node3.

- 格式化HDFS

在node1操作即可

命令:hdfs namenode -format

- 启动和关闭hadoop

全部启动和关闭命令:

启动命令:start-all.sh

关闭命令:stop-all.sh

分步开启和关闭:

启动HDFS和YARN

命令:start-hdfs.sh

命令:start-yarn.sh

关闭HDFS和YARN

命令:stop-hdfs.sh

命令: stop -yarn.sh

- 验证hadoop进程

命令:jps

如果出现:SecondaryNameNode

NameNode

ResouceManager

这三个进程,说明hadoop启动成功。

13,测试Hadoop

- 在Ubuntu操作系统的目录下,创建一个文本文件data.txt:

命令:cd ~

命令:vi data.txt

- 在data.txt文件中输入以下内容,保存并退出

Hello word

Hello hadoop

- 将data.txt上传到HDFS,命令如下:

命令:hafs dfs -put data.txt /input

- 查看是否上传成功,命令如下

命令:hafs dfs -ls /input

- 运行mapreduce,命令如下:

命令:cd ~/hadoop/share/hadoop/mapreduce

命令:cd (找到hadoop-mapreduce-examples,根据自己的环境查找) wordcount /input/data.txt /output

- 查看结果

命令:hafs dfs -cat /output/part-r-00000

出现:Hadoop 1

Hello 2

World 1

测试成功

十二.通过web访问Hadoop

1. HDFS Web界面:

查看namenode和datanode在window是浏览器输入:http://自己主机的IP地址:50070

查看SecondaryNameNode,在window是浏览器输入:http://自己主机的IP地址: 50090

2.YARN Web界面,在window是浏览器输入:http://自己主机的IP地址:8088