- 1【算法专题】动态规划之回文子串问题_回文子串个数动态规划

- 2在HTML页面中引入vue组件_在html文件中引入vue

- 3Java学习05--Java的输入和输出_编写一个控制台应用程序,输入一个整数,并输出该数

- 4把别人的远程仓库的代码下载下来 怎么上传到我的仓库的_怎么把别人的gitee仓库内容放在自己目录

- 5【大总结2】大学两年,写了这篇几十万字的干货总结_万字 cndn

- 6传感器行为识别论文

- 7unity到小游戏instantGame(流程演示,非内容制作 亲测可用)

- 8Qt Creator 11发布

- 92024年鸿蒙最全OpenHarmony开发实战:动画样式(JS)(4),蚂蚁金服四面

- 10如何在IDEA里面使用ElastSearch(创建索引库,建立映射关系)_idea给数据库字段加索引

Stable Diffusion高级教程 - 微调模型_stable diffusion 微调

赞

踩

Stable Diffusion高级教程 - 微调模型

前言

这节我们专门介绍 Stable Diffusion 里面各个微调模型。

为什么会有这么多类型的模型?

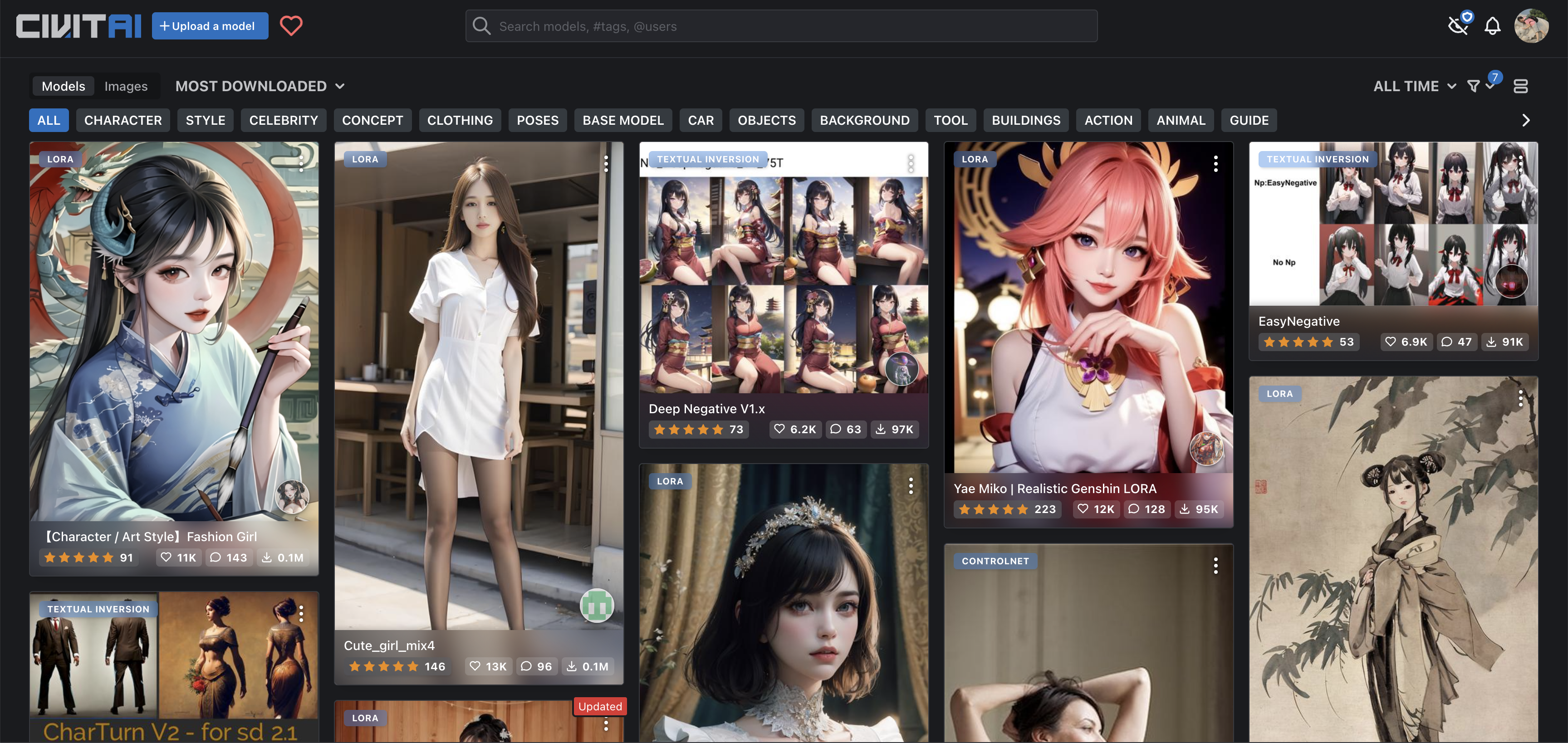

如果你点开 C 站的过滤器,你会发现模型的类型很多:

除了类型为 Checkpoint 的主模型,以外还有非常多的模型,有些你可能听过有些也是第一次看到,当然,未来还会出现更多类型的这种微调模型。根据我的学习,先解释下为什么会有这么多类型的模型。

这么多模型是模型发展历史的产物。在一开始,Stable Diffusion 是从无到有训练大模型,成本很高。因为训练通用大模型非常烧钱,之前我看其他文章,GPT-3 训练一次的成本约为 140 万美元,对于一些更大的 LLM(大型语言模型),训练成本介于 200 万美元至 1200 万美元之间。除了花钱,也非常耗时间,需要一个专门团队维护。

虽然这种基础模型并没不好用,但是他们打下了很好地基础,之后 Stable Diffusion 所有的模型都是在这种模型基础上微调出来的。不过随着 Stable Diffusion 越来越流行,大模型生成的图越来越不满意不同用户的需求,所以就开始诞生各种调整技术的出现。

一开始是对大模型的参数的训练,这就诞生了在 C 站看到的各个 Checkpoint 类型的模型,这种 Checkpoint 主模型需要的 GPU、时间、人员相对于大模型来说已经非常经济了,但是,Checkpoint 只满足一(多)个类用户的需求,但是细分下去还是细节和准确度不够,也不够灵活,势必出现非常垂直的解决方案。

接着出现了 Embedding 模型,由于它只训练负责的文本理解的模块,体积很小,训练也没什么门槛,效果却不错,逐渐被用户接受。然后相继出现了兼顾效果、文件体积、训练时间、训练难度等方面的 Lora、Hypernetwork。就是这样新模型不断涌现,最近几个月最热门的是 Lora,而最近一个月 Lycoris 效果也非常好。

Textual Inversion 之前已经专门写过一篇,而 Controlnet 之后会专门写,所以这篇仅介绍美学梯度、Lora、Hypernetworks、LyCORIS 这几个模型。

美学梯度 (Aesthetic Gradients)

它的思路是在通过一张或者几张参考图生成一个美学模型,最终对提示词进行调整和加权。