热门标签

热门文章

- 1人工智能(AI)技术作为当今科技创新的前沿领域,为创业者提供了广阔的机会和挑战_ai给创业带来的机遇与挑战2000字

- 2ChatGPT等大模型可以代替搜索引擎吗?

- 3关于海康工业相机连接电脑时出现链接速度低于1Ggps解决办法_海康mvs当前网络低于1gps

- 4SQL Server查询数据库表和数据库字段_sql server查询表及字段

- 5【ai】livekit:Agents 3 : pythonsdk和livekit-agent的可编辑模式下的安装_live kit agent

- 6自然语言处理的数据集分析:IMDB与WikiText

- 7c语言----队列

- 8CNN FPGA加速器实现(小型)CNN FPGA加速器实现(小型)_fpga加速cnn

- 9MudBlazor组件意思及对应的标签

- 10各版本Sql Server下载地址全

当前位置: article > 正文

毕业设计 lstm与attention机制的中文情感分析系统_引入attention机制的lstm文本情感分析

作者:繁依Fanyi0 | 2024-06-14 02:44:06

赞

踩

引入attention机制的lstm文本情感分析

0 前言

基于lstm与attention机制的中文情感分析系统

提示:适合用于课程设计或毕业设计,工作量达标,源码开放

1 简介

在线评论的细粒度情感分析对于深刻理解商家和用户、挖掘用户情感等方面有至关重要的价值,并且在互联网行业有极其广泛的应用,主要用于个性化推荐、智能搜索、产品反馈、业务安全等。本次比赛我们提供了一个高质量的海量数据集,共包含6大类20个细粒度要素的情感倾向。参赛人员需根据标注的细粒度要素的情感倾向建立算法,对用户评论进行情感挖掘,组委将通过计算参赛者提交预测值和场景真实值之间的误差确定预测正确率,评估所提交的预测算法。

2 实验环境

tensorflow 1.8.0-gpu, python-3.5.6

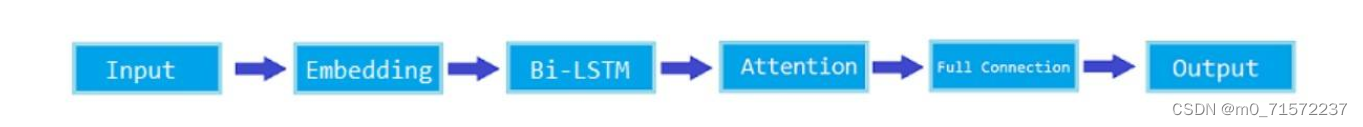

3 模型架构

4 参数设置

- 学习率: 3e-4

学习率尝试过1e-4、3e-4、1e-3等,发现取3e-4时F1值和1e-3差不多,但是取3e-4时模型的最终loss更低。 - dropout: 1.0

dropout尝试过0.5、0.75以及1.0,发现取1.0的时候效果最好,0.5的时候效果最差。 - 句子截断长度:350个词语 句子截断长度取350个词语时,仅5%的评论被截断,其余不足350个词语的评论在词嵌入的时候补0。

- 词向量维度:300

词向量维度尝试过250、300、350等,但是对模型的性能提升不大,一般都选用300。(维度过高会延长训练时间) - batchSize:32

5 完成情况

单个模型最好的F1指标为:75.04

整体20个模型的综合F1指标为:68

6 最后

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/繁依Fanyi0/article/detail/715936

推荐阅读

相关标签