- 1[保姆级教程]解决Centos 8下无法更新的问题 (附无痕迁徙到Rocky Linux的方法)_centos不更新

- 2JavaScript 中从数组中删除元素_javascript 数组删除元素

- 3iPhone & iPad 移动端使用 Obsidian_working copy obsidian

- 4机器学习笔记——数据集分割

- 5Learn to earn,Move星航计划第三期邀请你探索编程和区块链的乐趣

- 6JAVA ———变量和数据类型与运算符_在以下转换中,分别属于哪种类型:(1)double a=10;(2)double b=20.5; i

- 7Spark—— DAG 如何划分stage?_dag为什么要划分stage

- 82024年大数据最全2024新版Git教程 从入门到实战(一)安装Git_git 2(2)_git 2.2.4

- 9idea上传代码到github (图文并茂)

- 10移动开发最新Android自定义属性TypedArray详解,2024年最新面试完资料要拿回来吗_android 自定义属性

ChatGLM4重磅开源! 连忙实操测试一波,效果惊艳,真的好用!_chatglm4 开源发布时间

赞

踩

GLM4重磅开源啦

GLM-4-9B是智谱AI在24年6月5日推出的开源预训练模型,属于GLM-4系列。之前已开源chatglm1~chatglm3等多个版本。

GLM4在语义理解、数学、推理、编程和知识等领域的测试中表现优异。GLM-4-9B-Chat是其人类偏好对齐版本,支持多轮对话、网页浏览、代码执行、自定义工具调用(function call)以及长文本推理(最大128K上下文)。该系列模型还支持26种语言,包括日语、韩语和德语,并推出了支持1M上下文长度(约200万中文字符)的版本。

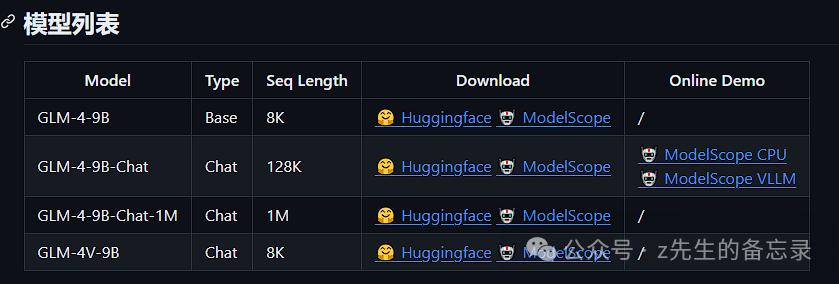

GLM-4系列版本介绍

GLM-4-9B 系列模型主要包含:

GLM-4-9B 系列模型主要包含:

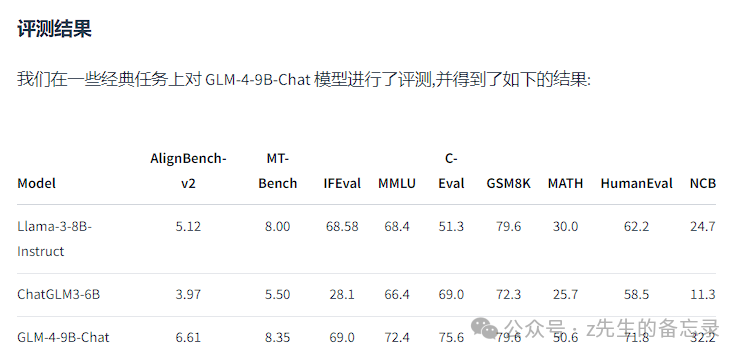

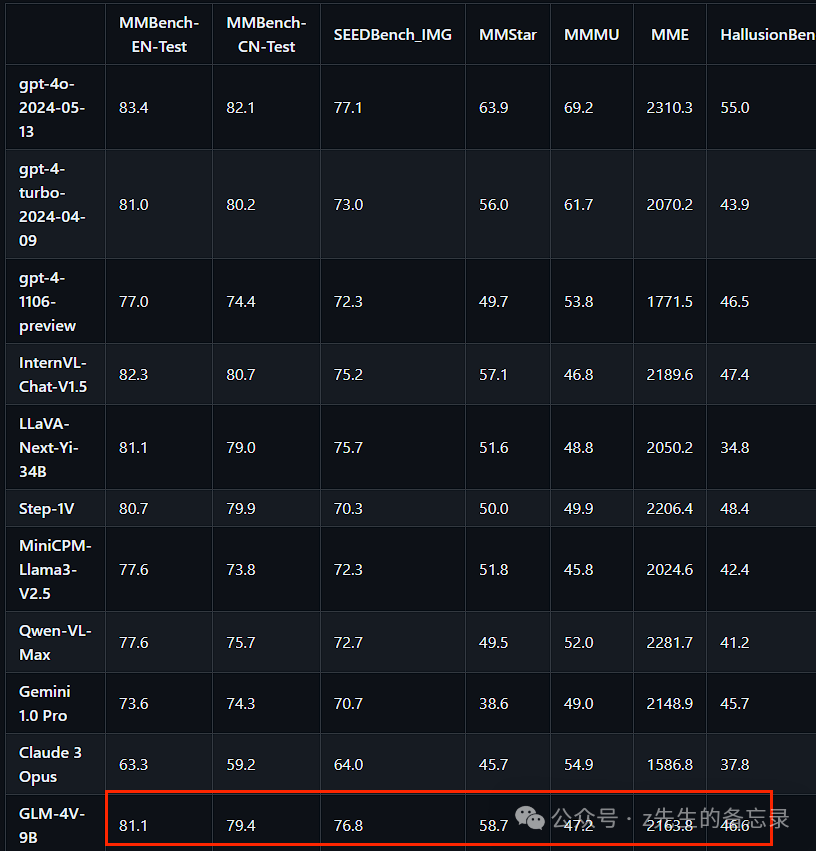

glm4大模型能力测评结果

经典测评任务结果

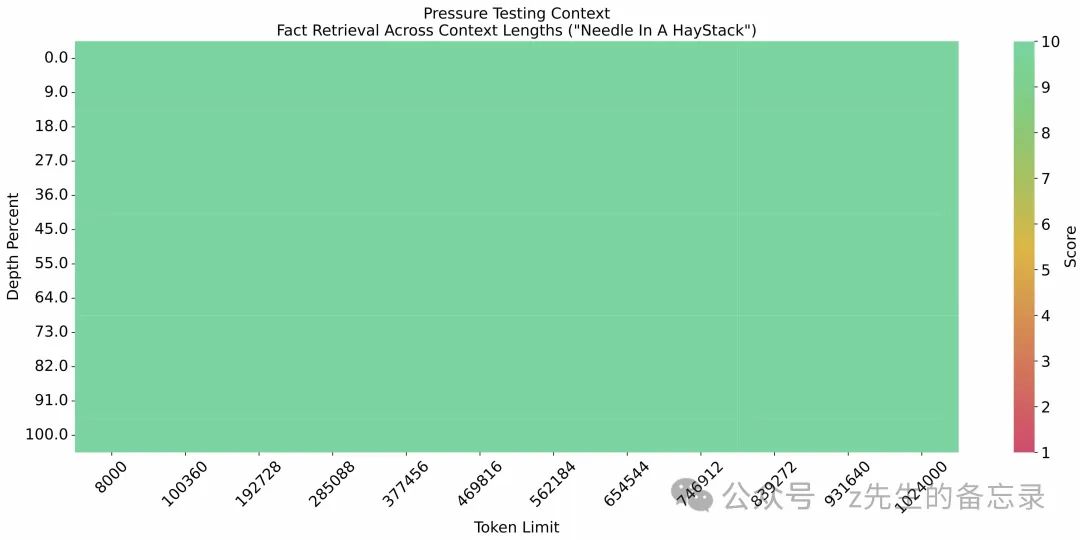

长文本能力

在1M的token上下文长度进行大海捞针实验,

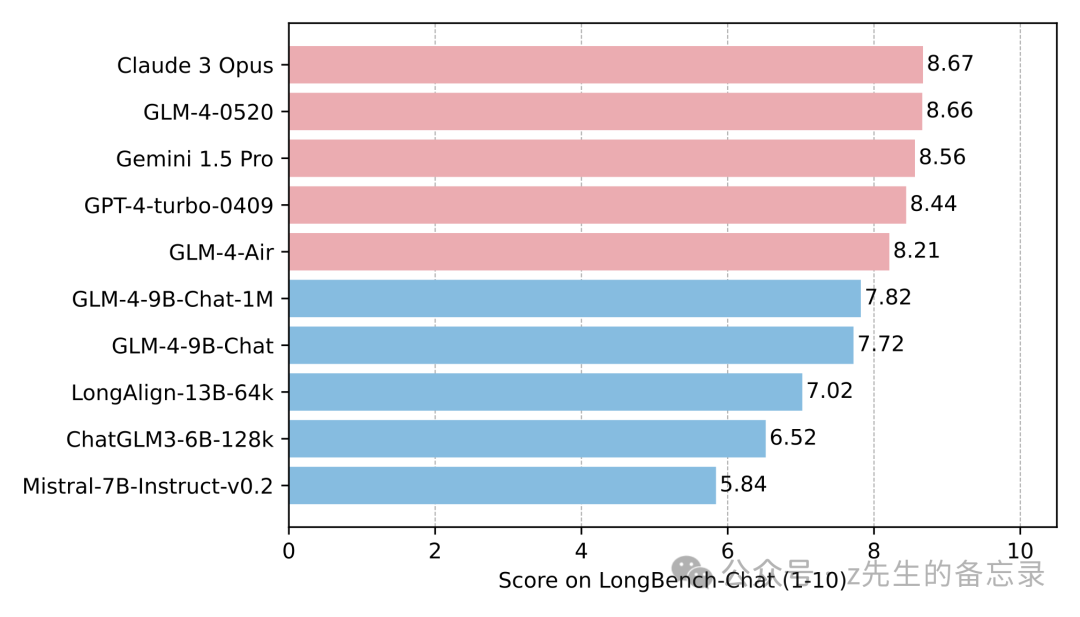

在 LongBench-Chat 上对长文本能力进行了进一步评测,结果如下:

在 LongBench-Chat 上对长文本能力进行了进一步评测,结果如下:

工具调用能力

多模态能力

GLM-4V-9B 是一个多模态语言模型,具备视觉理解能力,其相关经典任务的评测结果如下:

可以看出GLM4的性能相比GLM3-6b,有着大幅度提升,具有以下亮点:

- 上下问长度最高支持1M。

- 支持多达26种语言。

- 工具调用能力(function call)提升巨大,逼近GPT4。

- 从评测的结果来看,基础通用能力超越llama3 ,提升40%。

下面我将给大家实操利用对话版本 GLM-4-9B-Chat(128K)和多模态版本 GLM-4V-9B-Chat来进行模型的推理和效果展示;

手把手实操GLM-4-9B-Chat推理预测&&效果展示

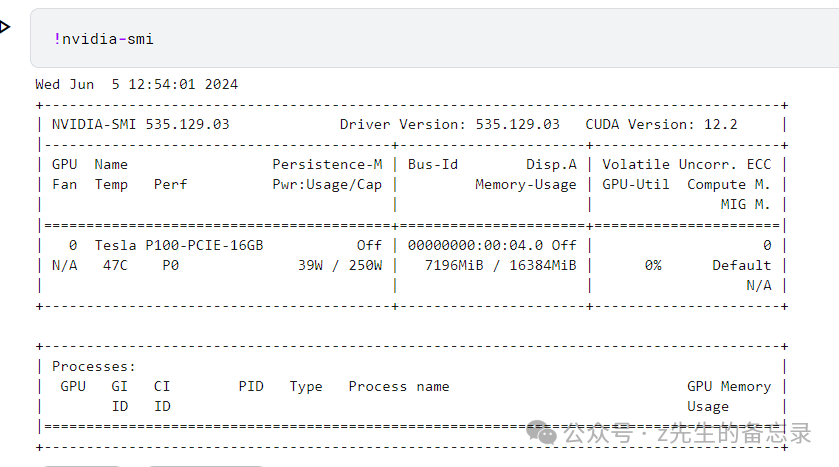

GLM4运行硬件和环境要求

下图是glm4对应不同输入token的显存占用情况。 为了能够更好的节省资源,这里我将采用4位量化的方式来GLM4进行推理测试。

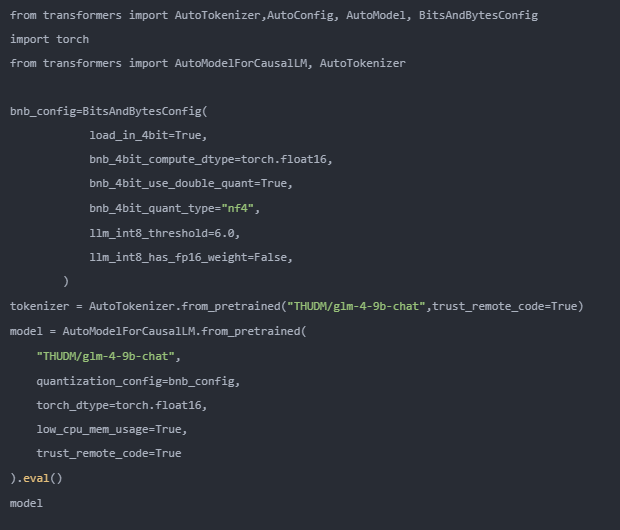

为了能够更好的节省资源,这里我将采用4位量化的方式来GLM4进行推理测试。

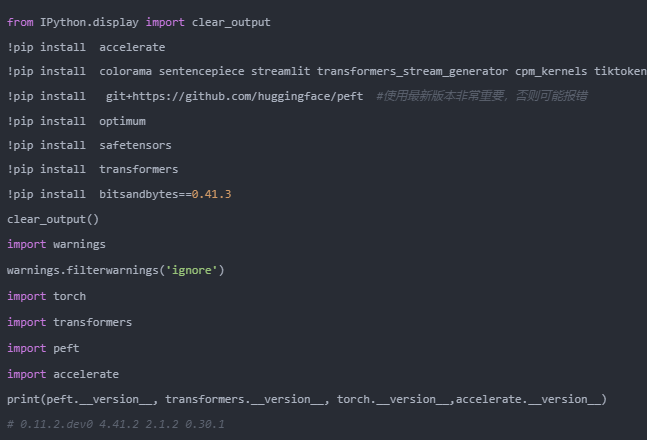

配置对应的库环境

编写代码小技巧: 在运行大模型前先把各个库对应的版本信息进行打印,避免环境不兼容,节约调试的时间。

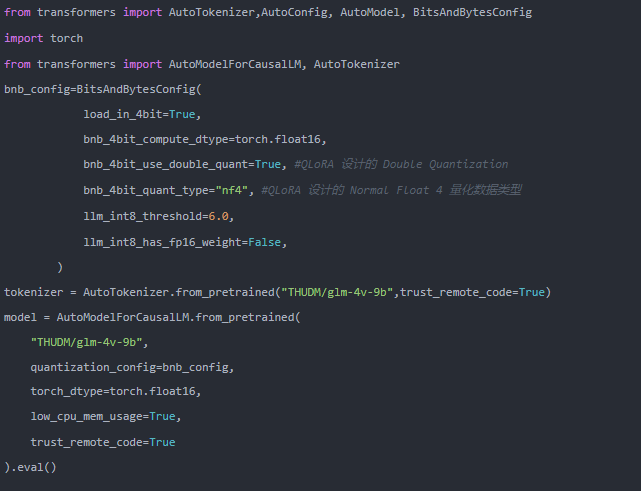

使用peft+bitsandbytes 进行4位量化推理

其中glm4_6b的网络框架如下:

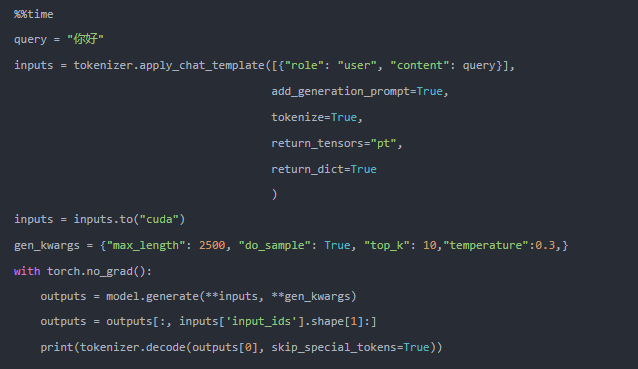

进行大模型的推理测试

问题1:简单问好

输出效果:

问题2: 鲁迅为什么暴打周树人?

问题3: 长江和嘉陵江相汇在什么地方?

问题4:树上有10只鸟,开枪打死了2只,树上还剩下几只?

可以看出上面的几个问题,GLM4都回答的不错,没有掉进我们设置的陷阱中,非常不错。

可以看出上面的几个问题,GLM4都回答的不错,没有掉进我们设置的陷阱中,非常不错。

显存占用情况

手把手实操 多模态版本GLM-4V-9B-Chat推理预测&&效果展示

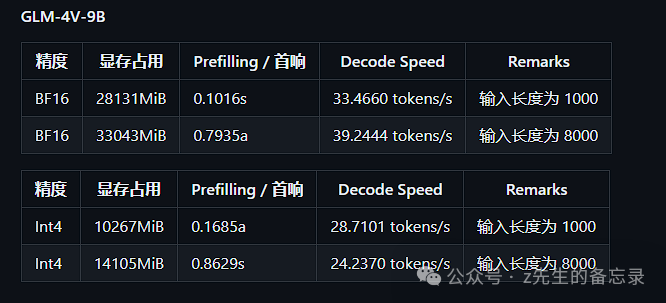

多模态GLM-4V-9B对应的硬件资源

下图是glm4对应不同输入token的显存占用情况。

进行4位量化加载

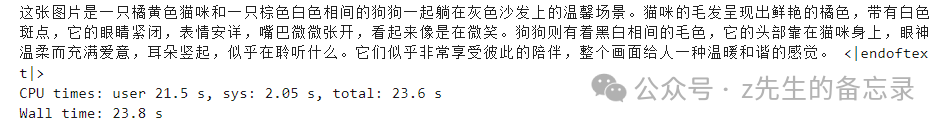

准备测试图片

这是待理解的图片

进行推理预测

%%time

import torch

from PIL import Image

query = '描述这张图片'

image = Image.open("426a8f2904bd65bab5eee5474b769374.jpg").convert('RGB')

inputs = tokenizer.apply_chat_template([{"role": "user", "image": image, "content": query}],

add_generation_prompt=True, tokenize=True, return_tensors="pt",

return_dict=True) # chat mode

inputs = inputs.to("cuda")

gen_kwargs = {"max_length": 2500, "do_sample": True, "top_k": 10,}

with torch.no_grad():

outputs = model.generate(**inputs, **gen_kwargs)

outputs = outputs[:, inputs['input_ids'].shape[1]:]

print(tokenizer.decode(outputs[0]))

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

多模态GLM4输出的效果:

可以看出非常准确地识别出图片的内容,并做出合理解释,太酷啦!

如何学习AI大模型?

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。