- 1SpringBoot接口 - 如何对参数进行校验_sprting boot rest 参数校验

- 2YOLOv5分割训练,从数据集标注到训练一条龙解决_yolov5 分割标注

- 3中文医疗信息处理评测基准CBLUE_cmeee数据集

- 4时间序列预测实战(二十六)PyTorch实现Seq2Seq(LSTM)(结果可视化+自动保存结果)_def predict(model, args, device, scaler): # 预测未知数据

- 5计算机网络知识点全面总结(有这一篇就够了,附36张图)

- 6Unity websocket

- 7zookeeper机制及消息队列kafka集群部署_kafka zookeeper集群部署

- 8ubuntu 编译安装支持CUDA的OpenCV+其他opencv细节(需要特定版本gcc)_ubuntu opencv cuda

- 9docker-compose.yaml文件配置详解_parsing /media/data/onboard2/gerrit/docker-compose

- 10点击按钮,显示弹窗,再次点击他处,弹窗关闭的插件vue-clickaway

【2021.07】datawhale组队学习李宏毅 总结

赞

踩

对这一期的组队学习内容进行总结梳理。

01机器学习介绍

【2021.07】datawhale组队学习李宏毅task01

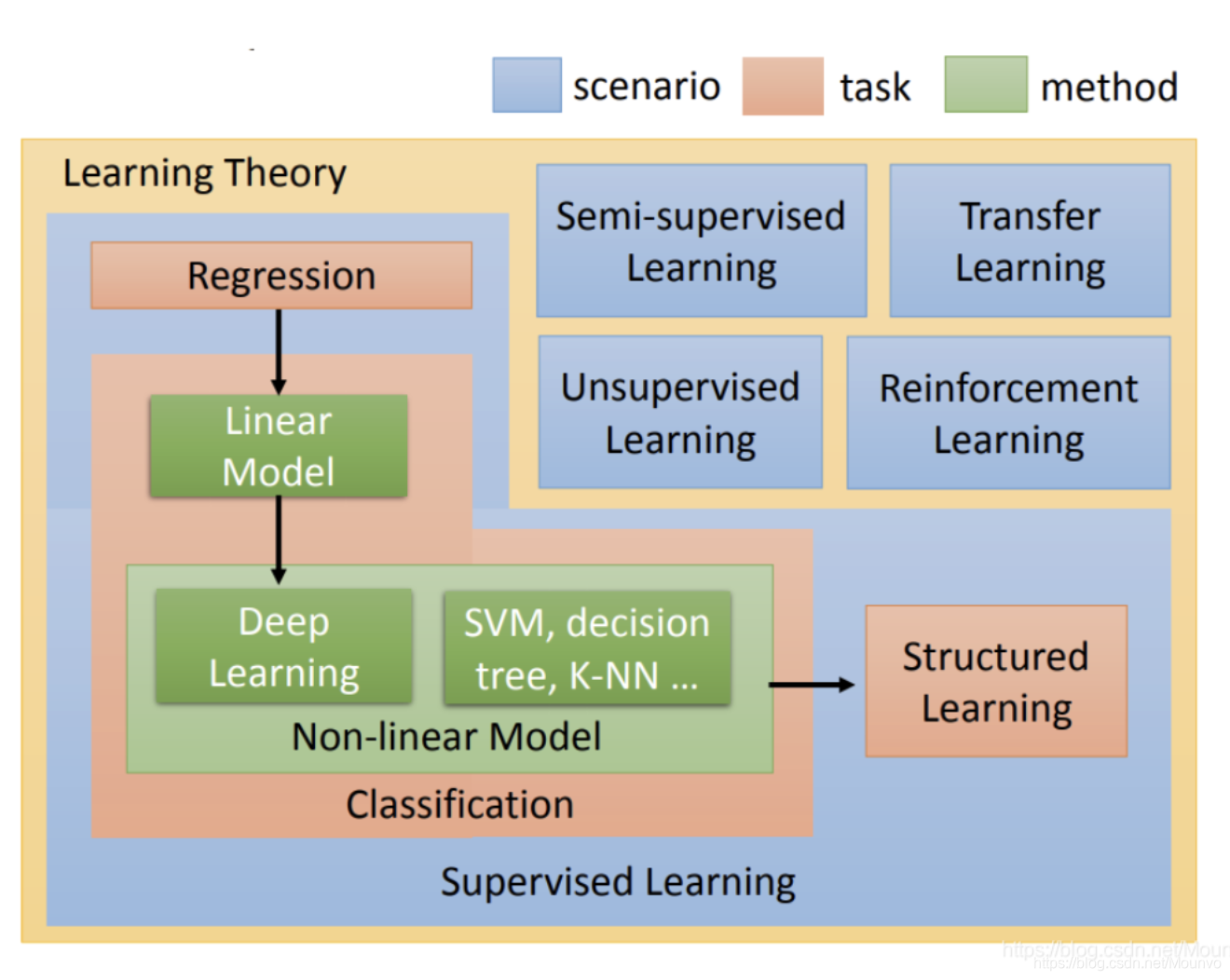

这一节关于机器学习的介绍可以直接用下面这张图概括。

蓝色的方块指的是学习的场景,红色的指的是你的task,你要解决的问题,不同的task又可以使用不同的method来完成。

02 回归

【2021.07】datawhale组队学习李宏毅task02

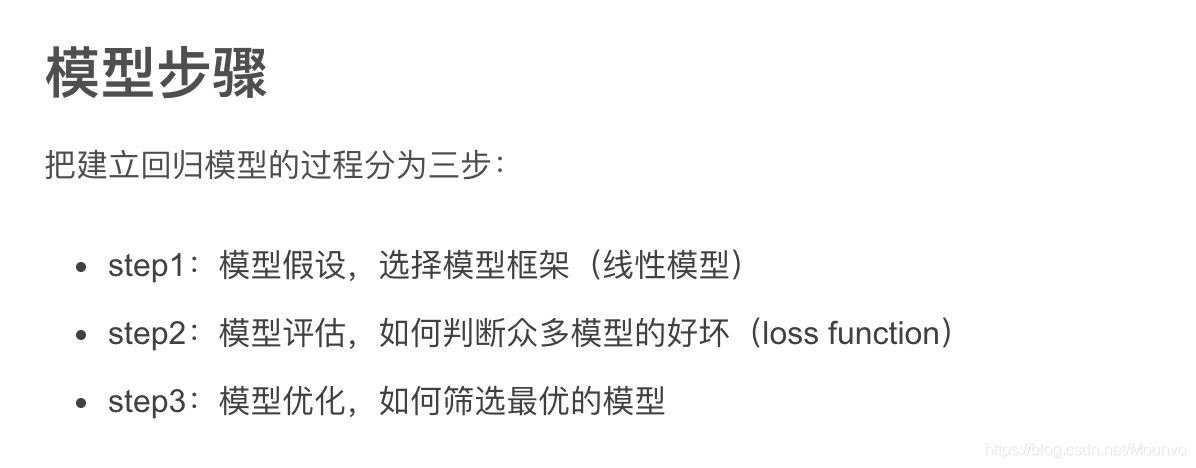

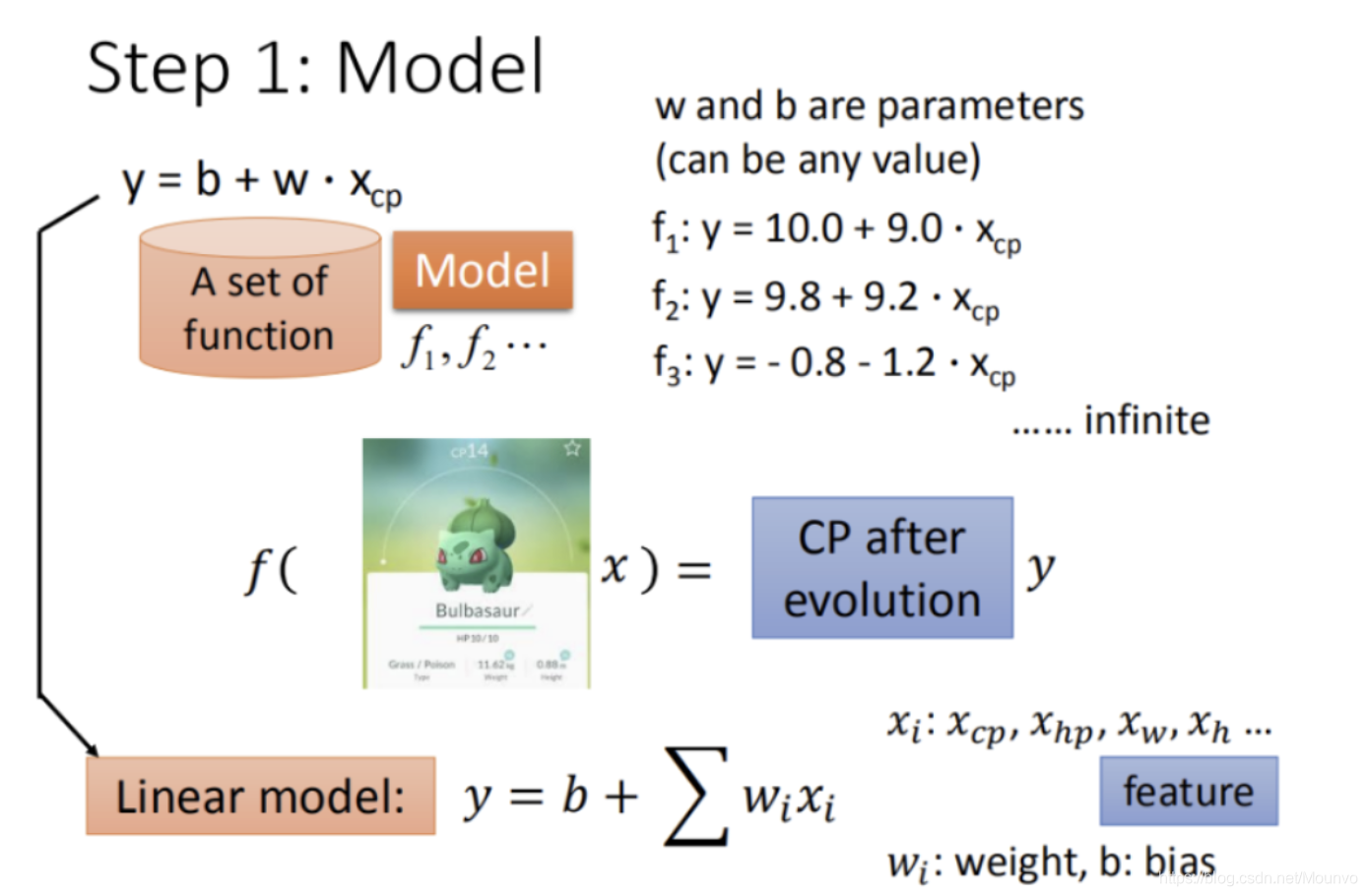

以宝可梦cp值预测为例,分别介绍了单个特征和多个特征的模型假设,模型评价集模型优化。

step1:model

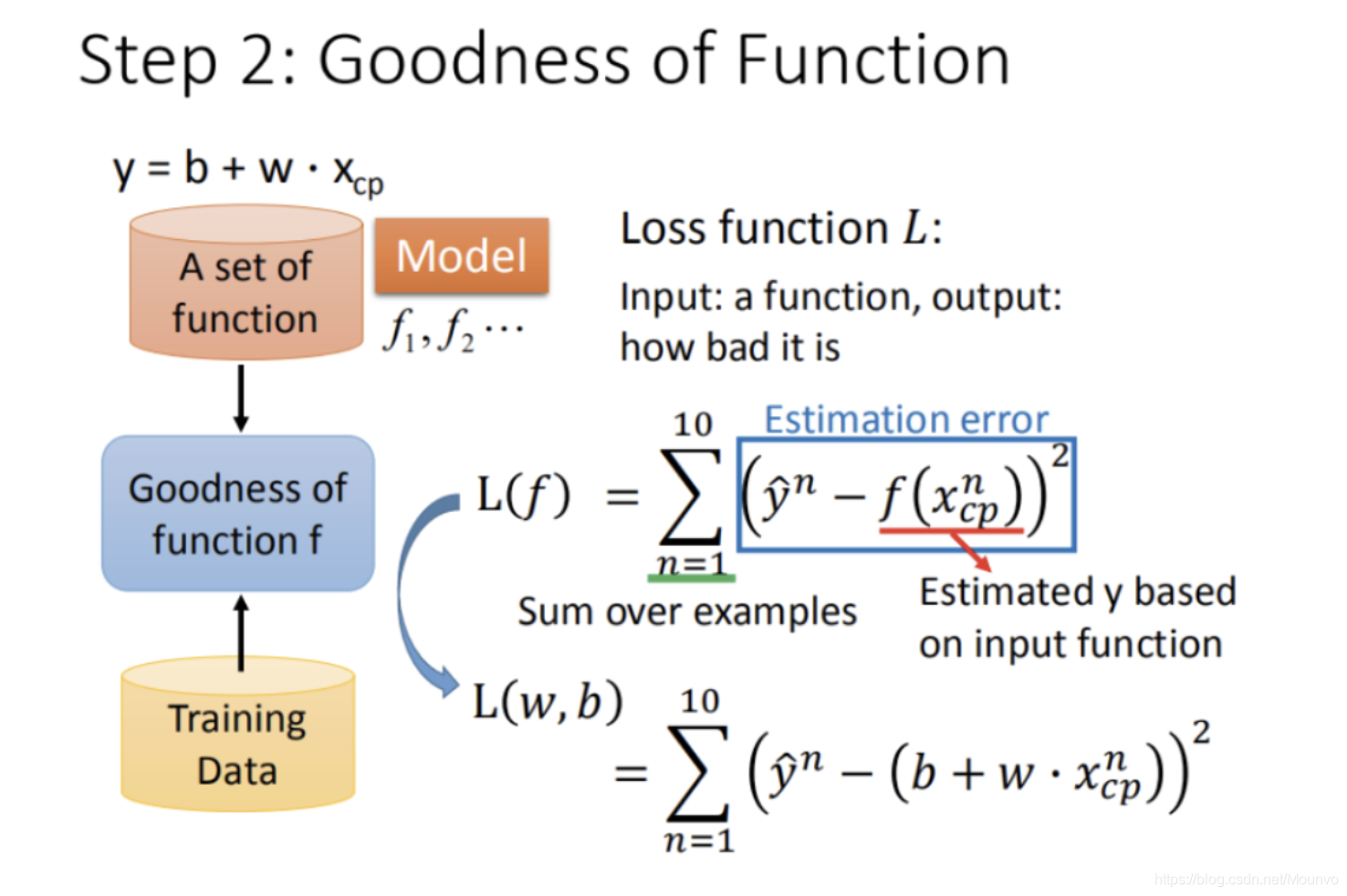

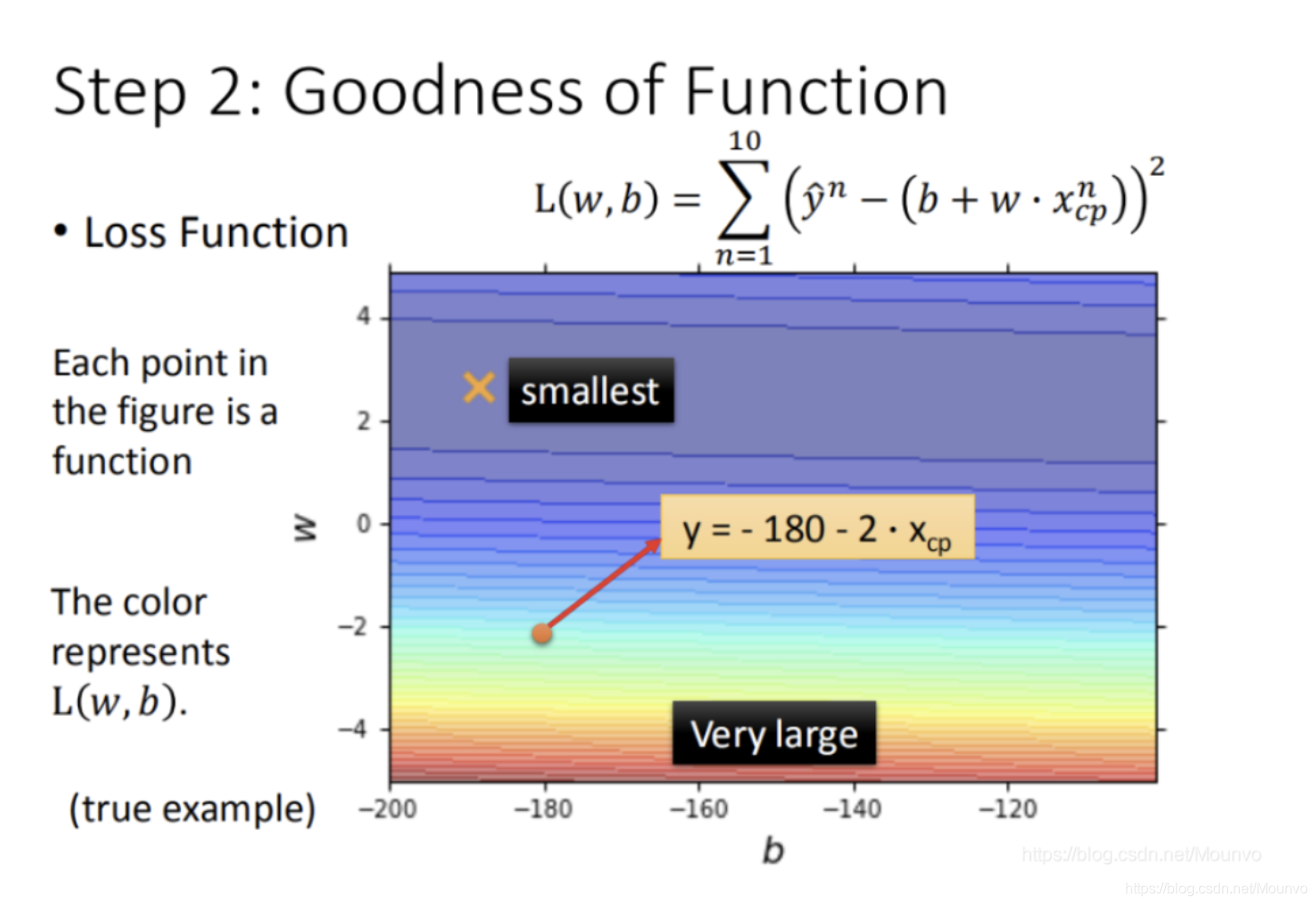

step2:评价一个模型的好坏

- 上图中的每一个点都代表一组(w, b),也就是对应着一个function

- 该点的颜色对应loss function的结果L(w,b),它表示该点对应的function的表现效果,颜色越红,代表loss的数值越大,这个function的表现越不好

step3:使用gradient descent进行优化

计算方法:

1.随机选取一个w;

2.计算w=w0时L对w的微分,也就是当前的斜率;

如果斜率为负,则说明该点左侧的loss值更高,需要增加w的值;

3.根据学习率移动;

如何确定移动多少步长?1.微分的大小,2.learning rate。

优化

更多的input & 正则化

03 误差

03、04、05的内容都在【2021.07】datawhale组队学习李宏毅task03

误差的主要来源有bias和variance

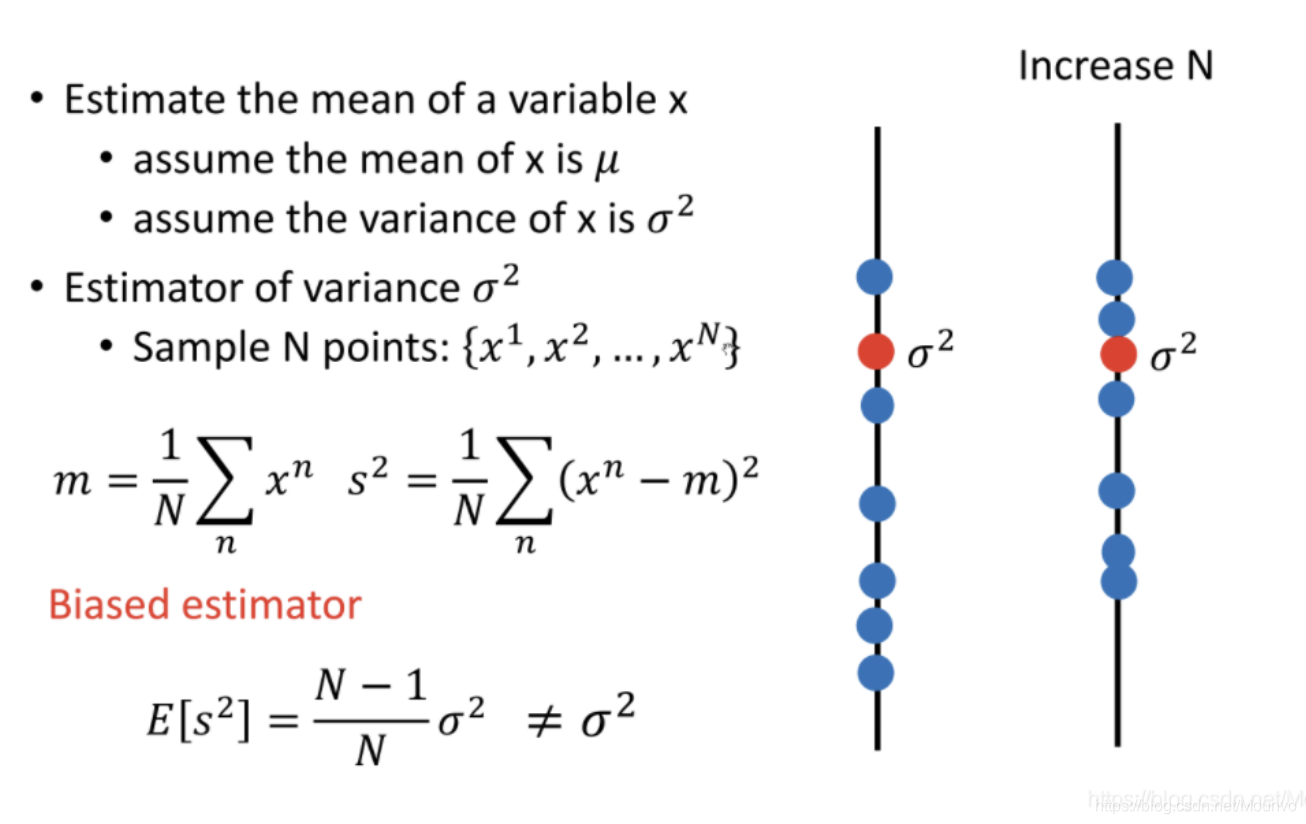

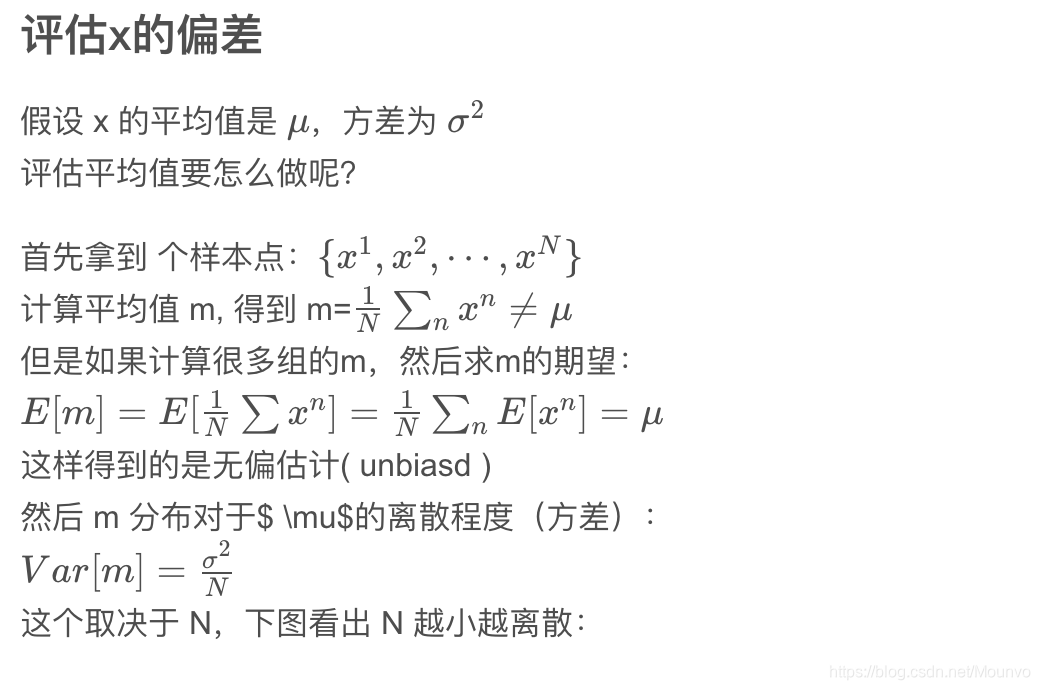

估测方差和偏差

偏差 v.s. 方差

- 如果模型并不能很好的适应训练集,那么存在很大的偏差

- 如果模型很好的适用训练集,但在测试集上的效果差强人意,那么存在很大的方差

欠拟合和过拟合要用不同的方式来处理

04 训练集划分

交叉验证

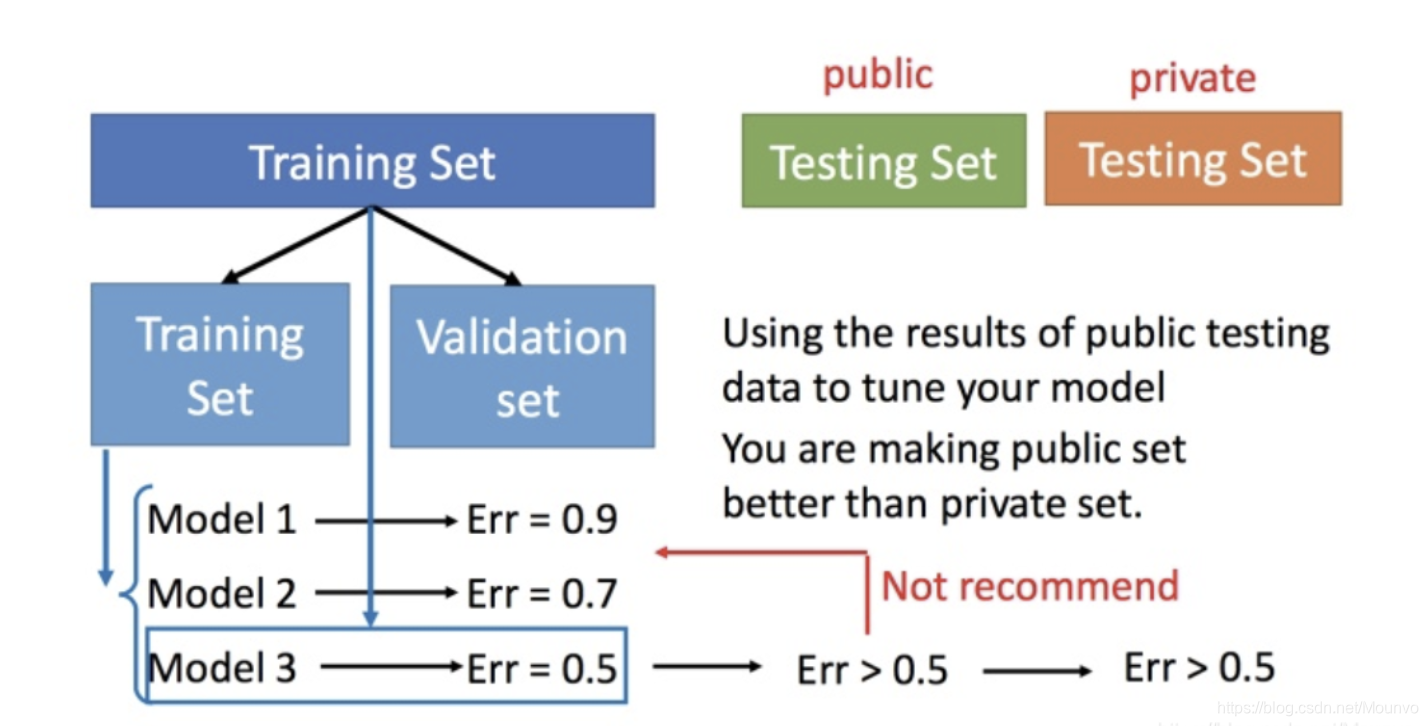

将验证集分为training set(训练集)和validation set(验证集)两个部分,用训练集来构造每个model最好的function,使用验证集来选择model

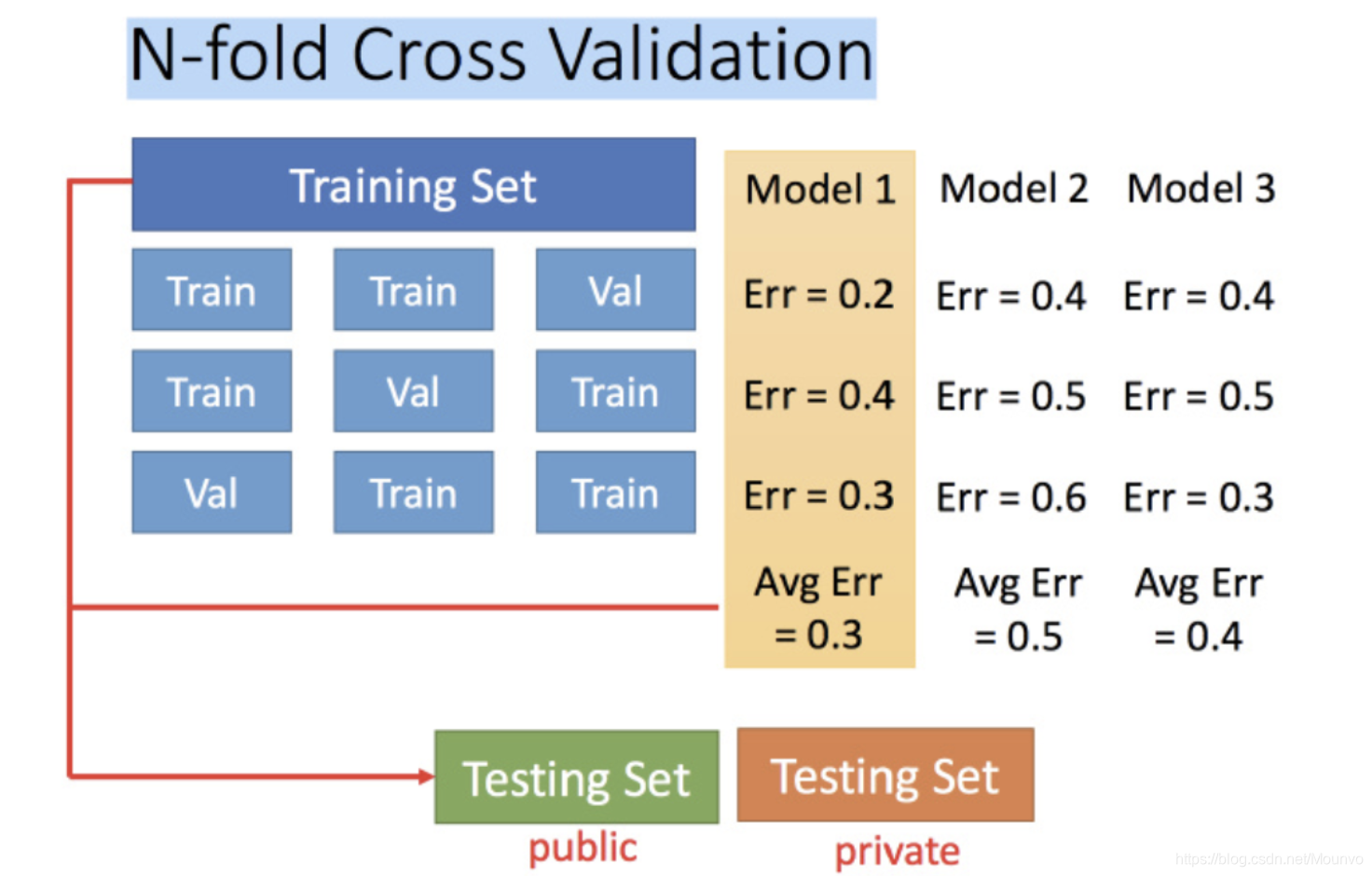

N-fold cross validation

将训练集分成N份,比如分成3份。一次使用一份当作验证集,另外两份当作训练集,分别计算每次的average error,得到model1最佳,再用完整的training data重新训练参数。

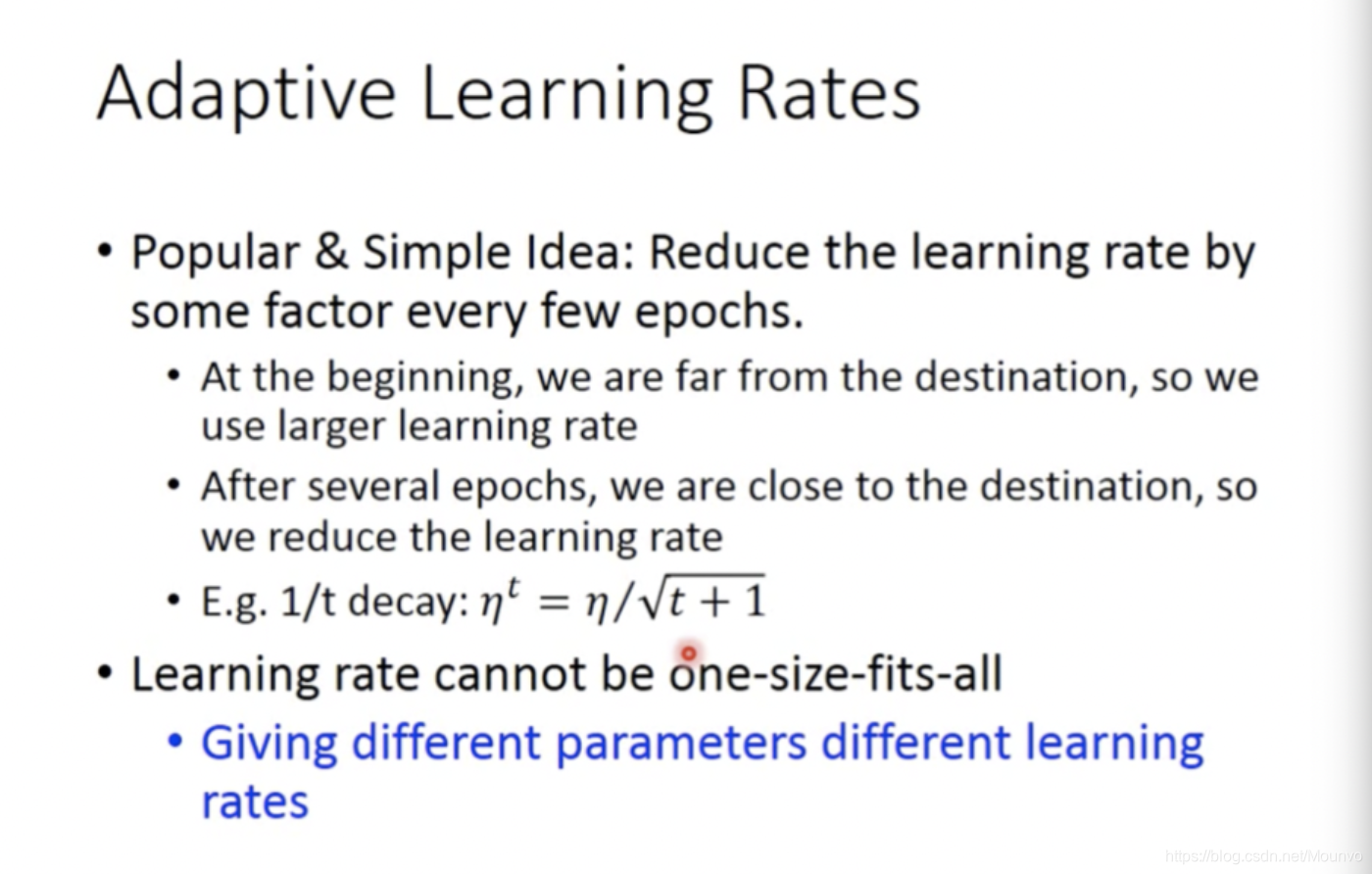

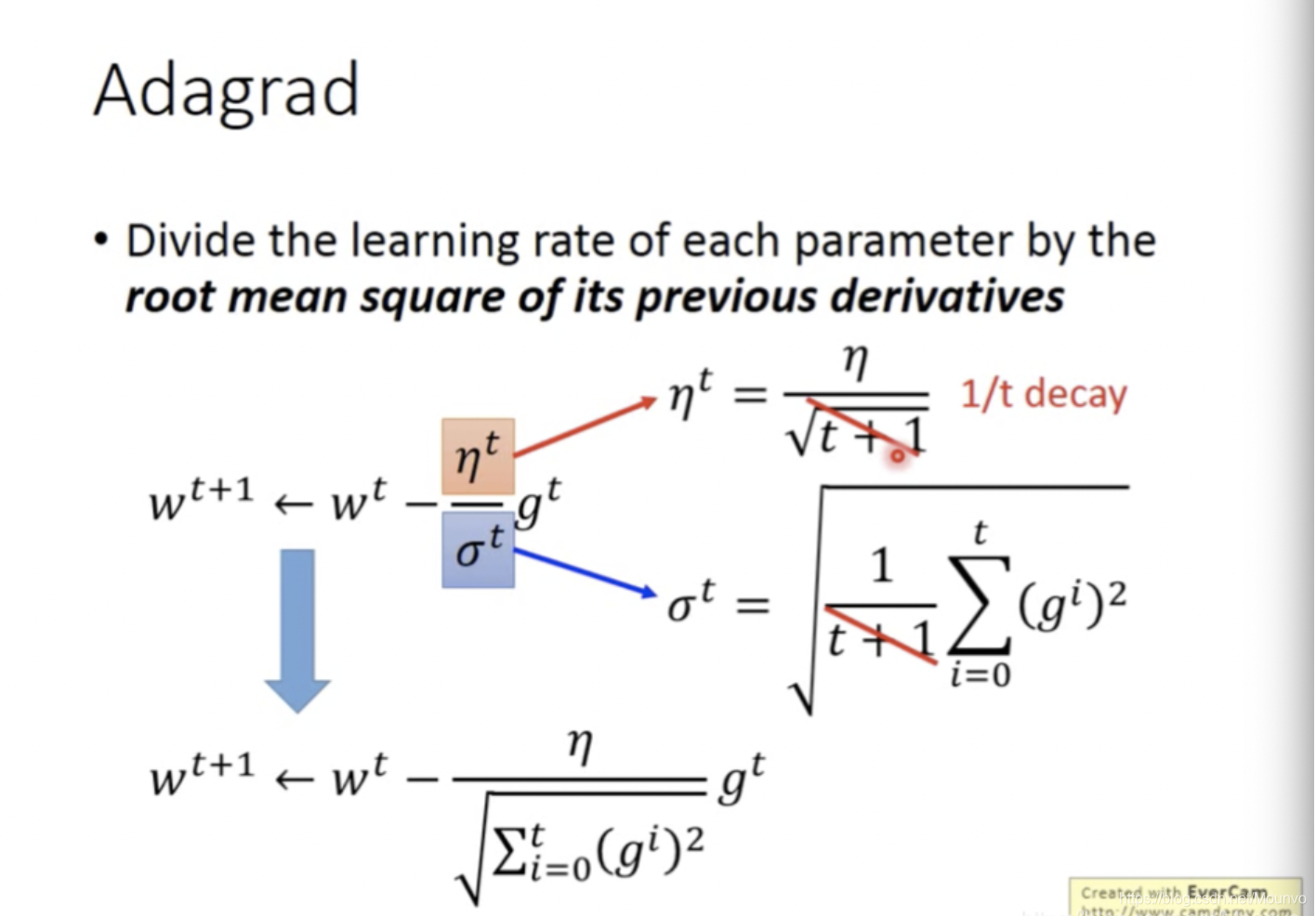

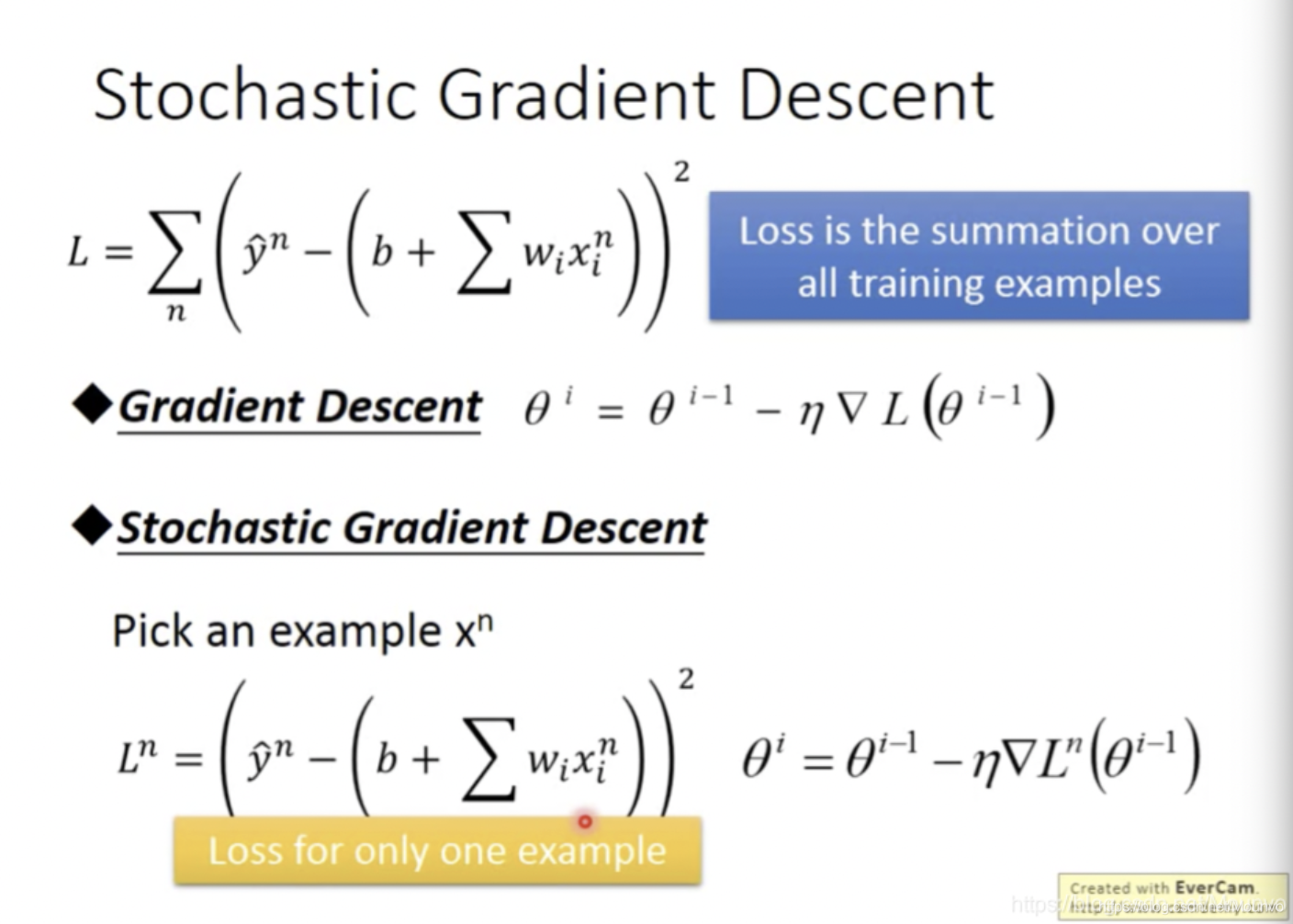

05 gradient descent

这里是对之前介绍的内容进一步的扩展,主要包括一些自动调参的方法

06 深度学习

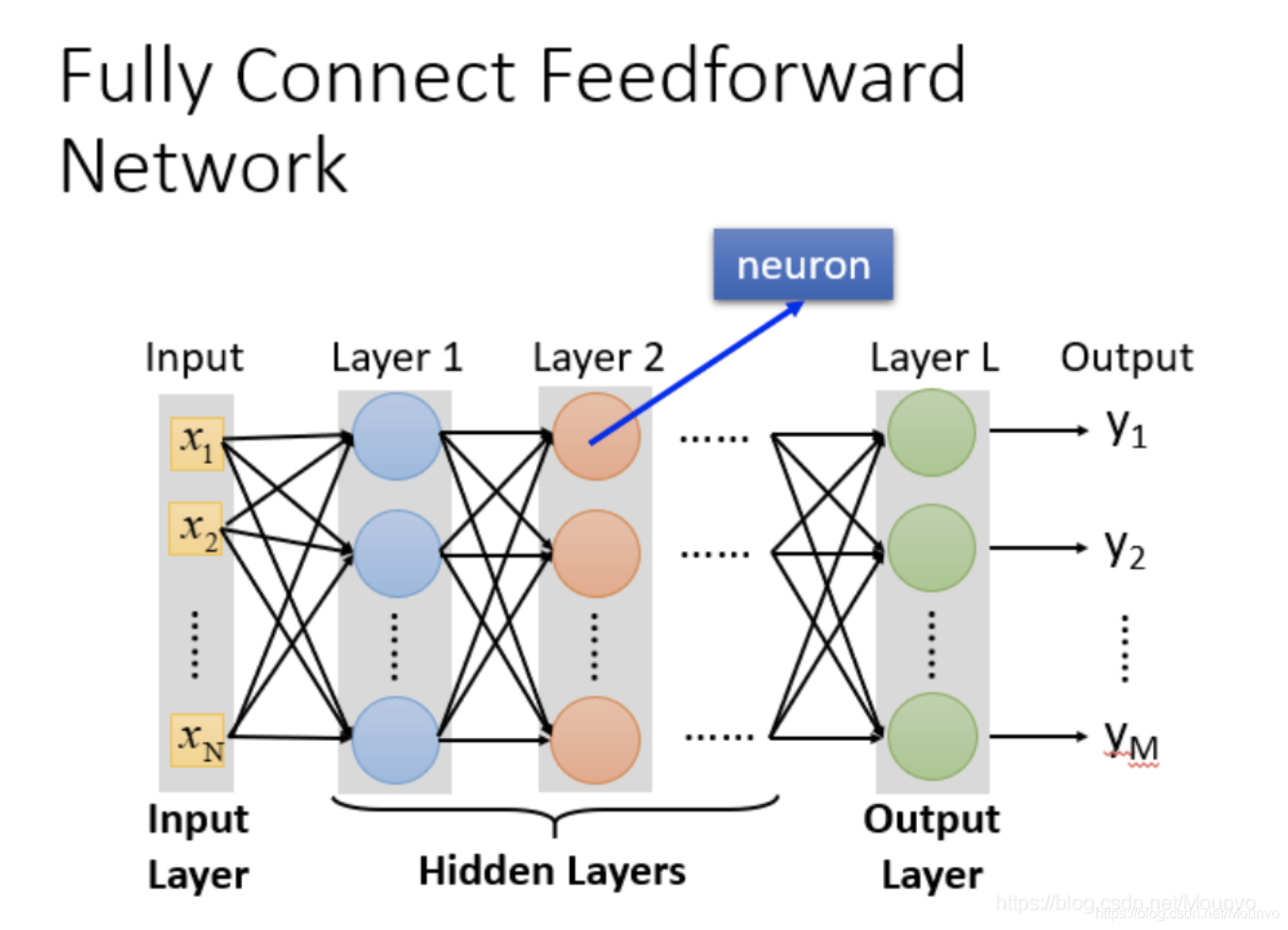

深度学习也可以分为三个步骤:

- step1:define a function,其实就是神经网络(Neural network)

- step2:模型评估(Goodness of function)

- step3:选择最优函数(Pick best function)

step1:神经网络

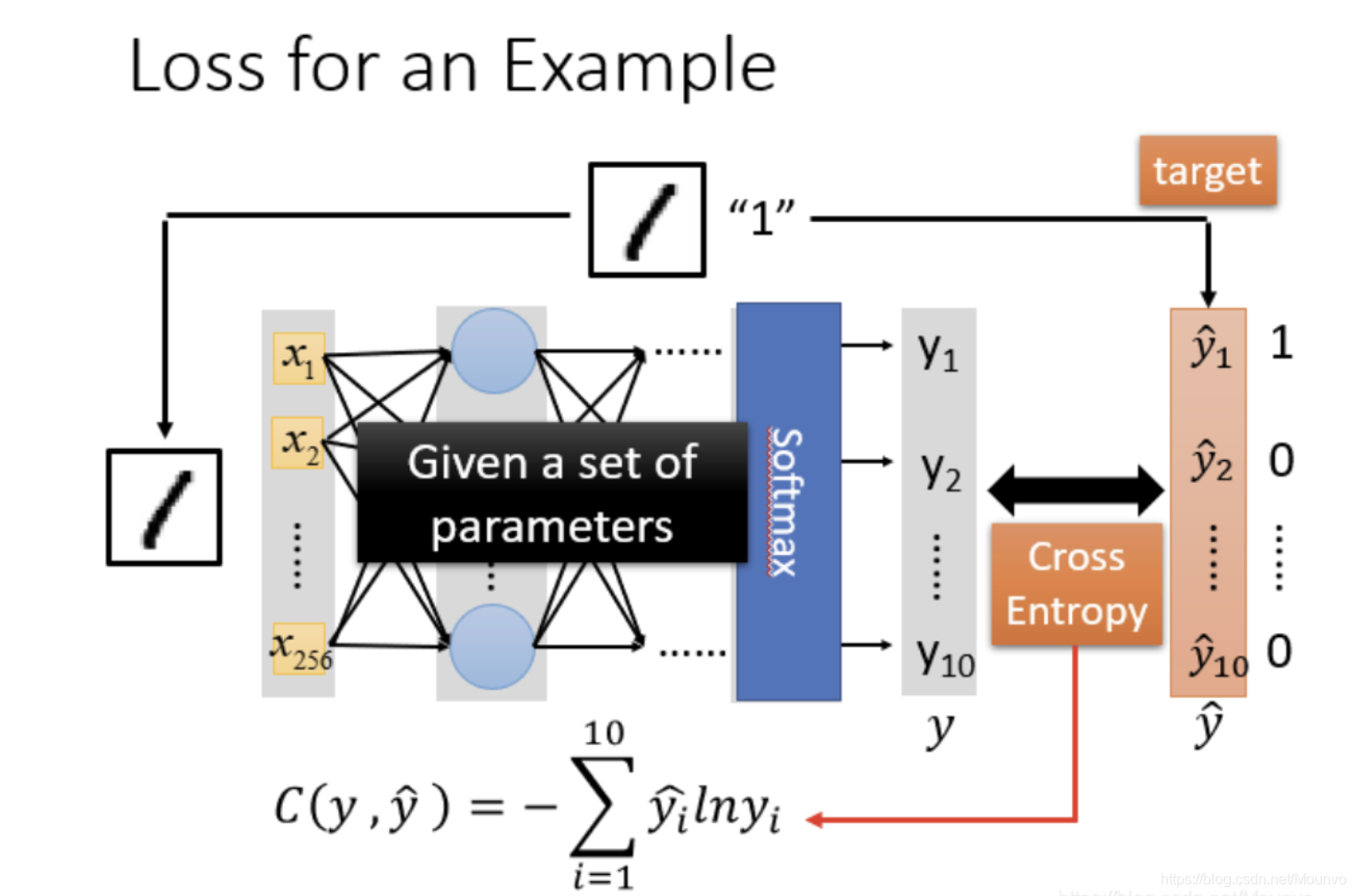

step2:模型评估

我们仍然用损失函数来反应模型的好坏,对于神经网络,我们采用交叉熵(cross entropy)函数来对y和

y

^

\hat y

y^的损失进行计算,接下来我们就是调整参数,让交叉熵越小越好。

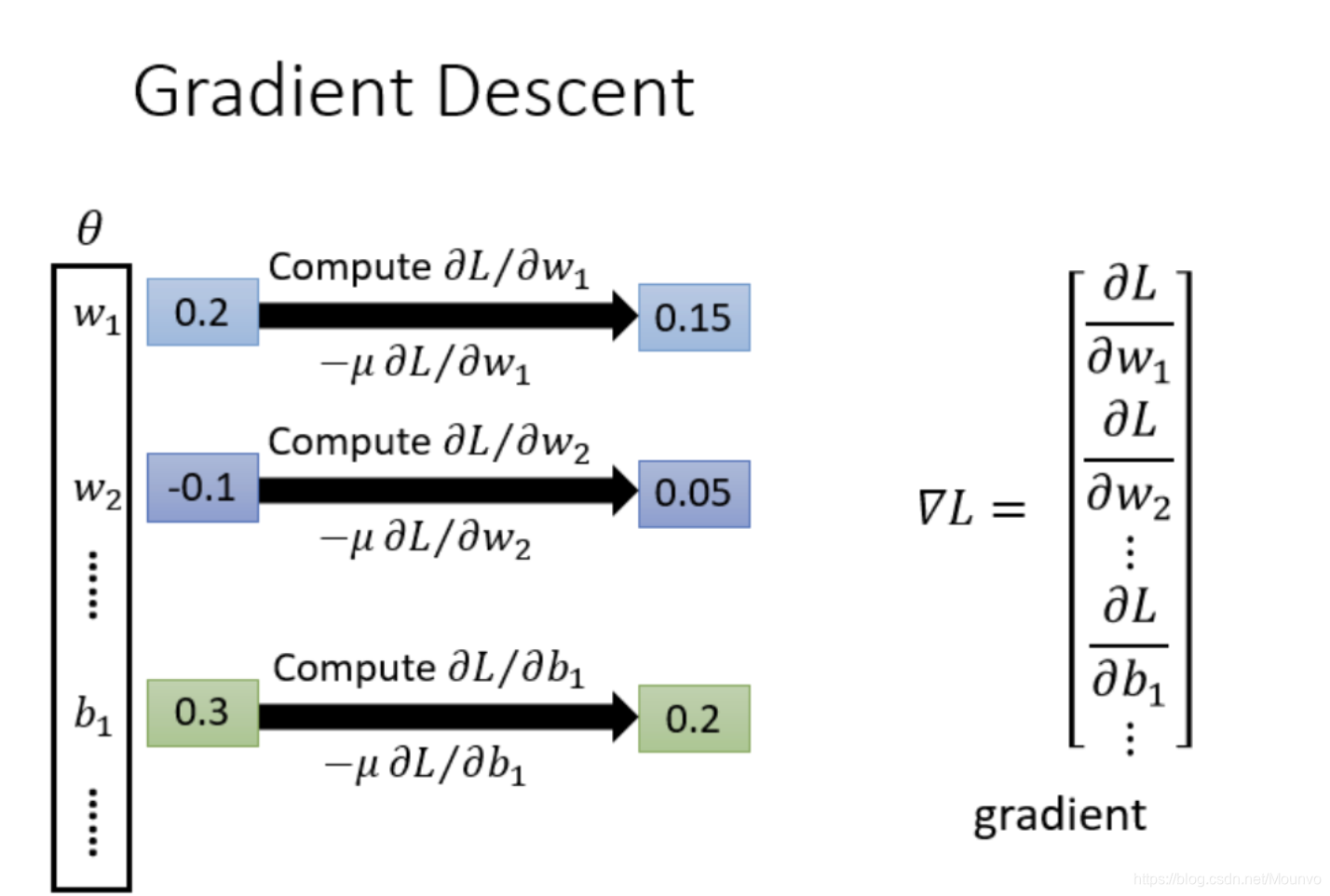

step3:选择最优函数

07

【2021.07】datawhale组队学习李宏毅task05

这一部分的内容还没有补完,先空着。

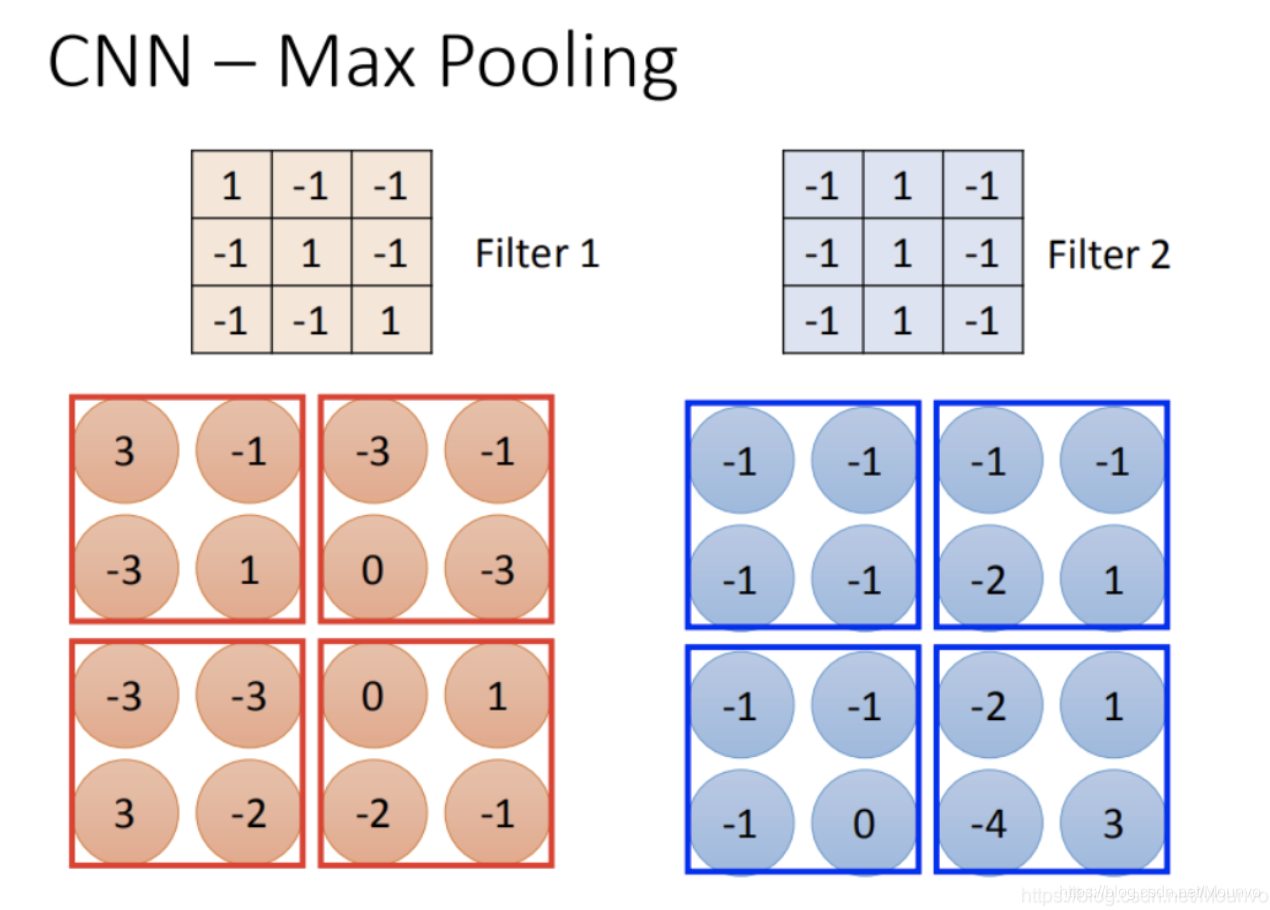

08 卷积神经网络

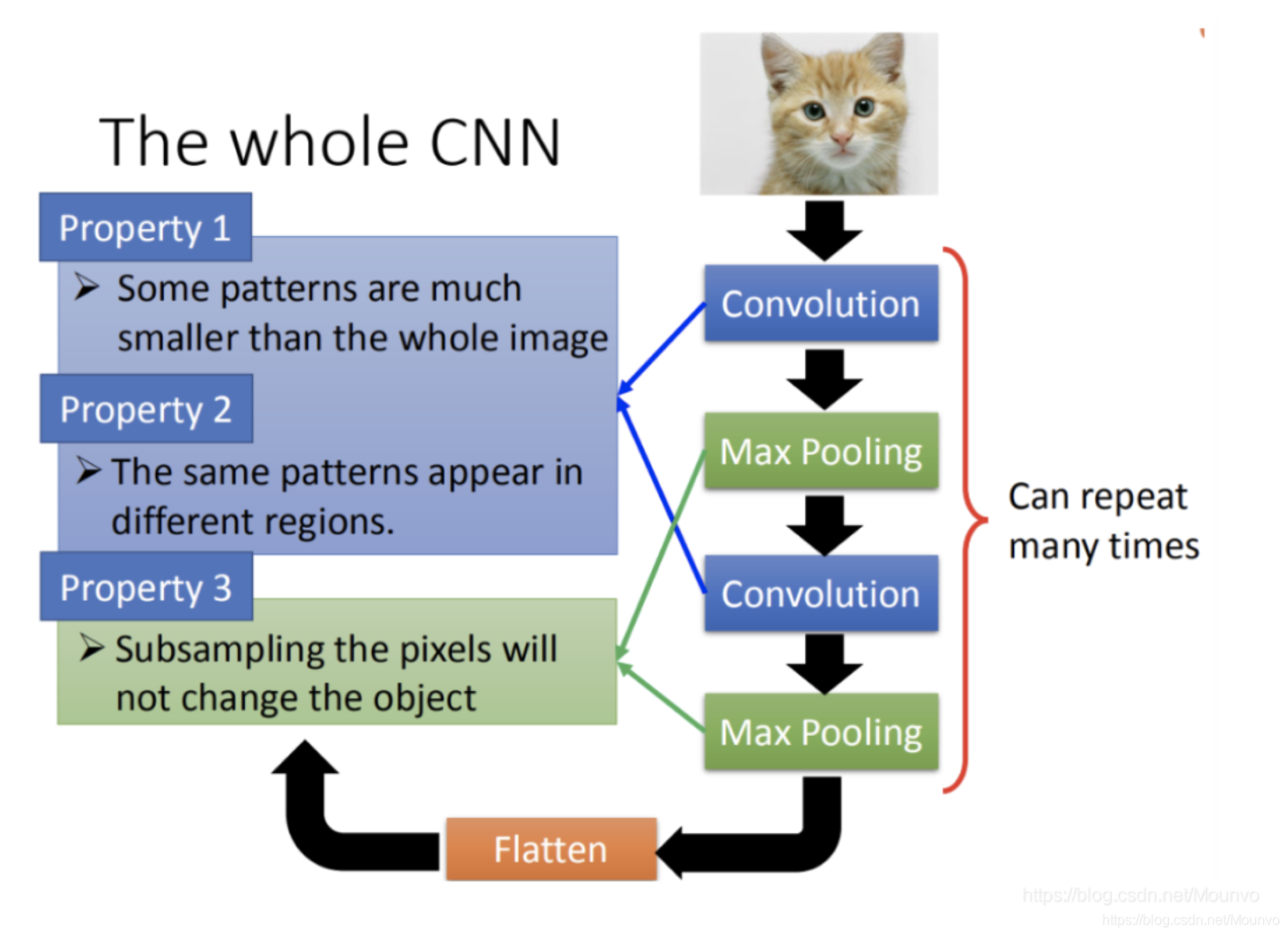

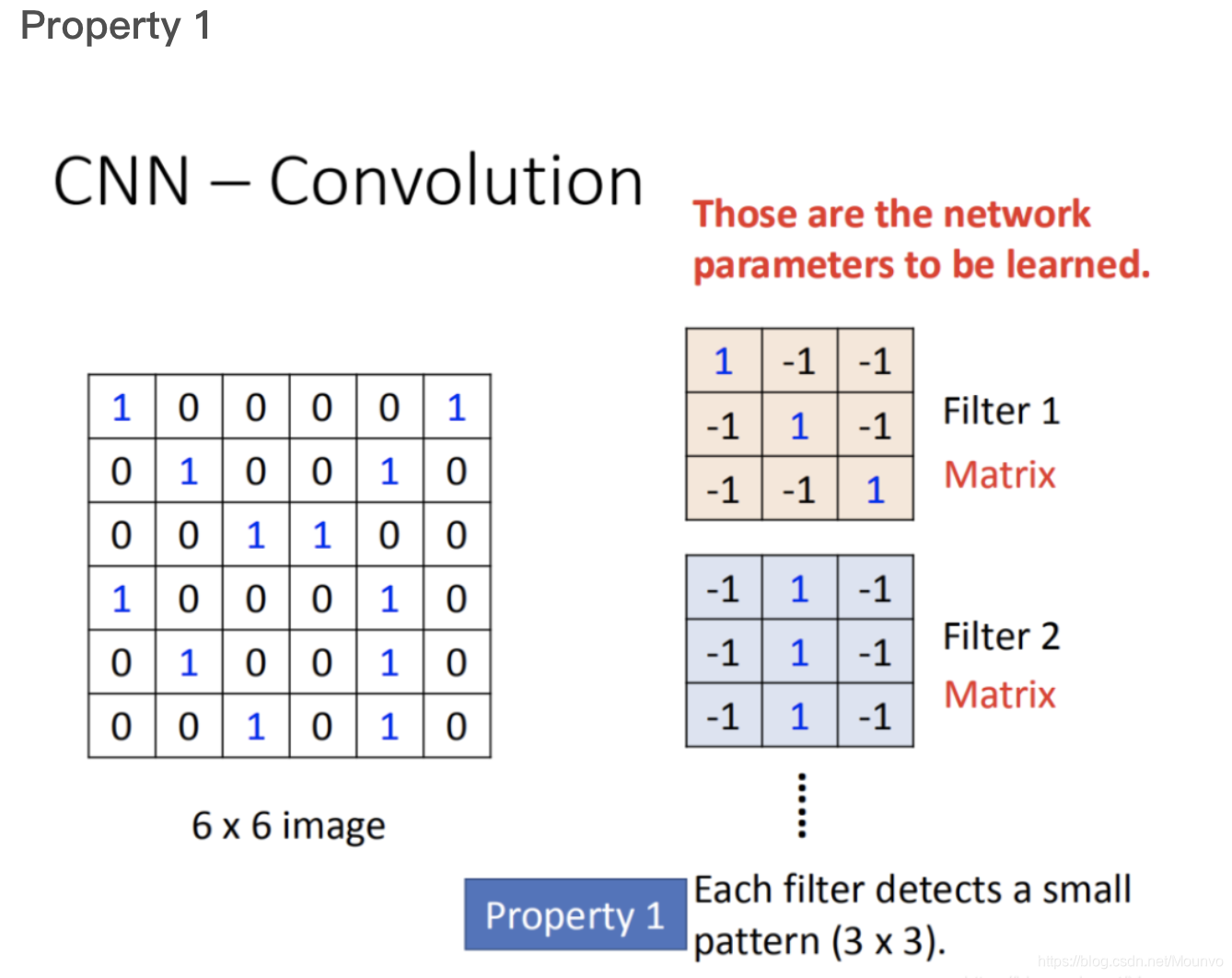

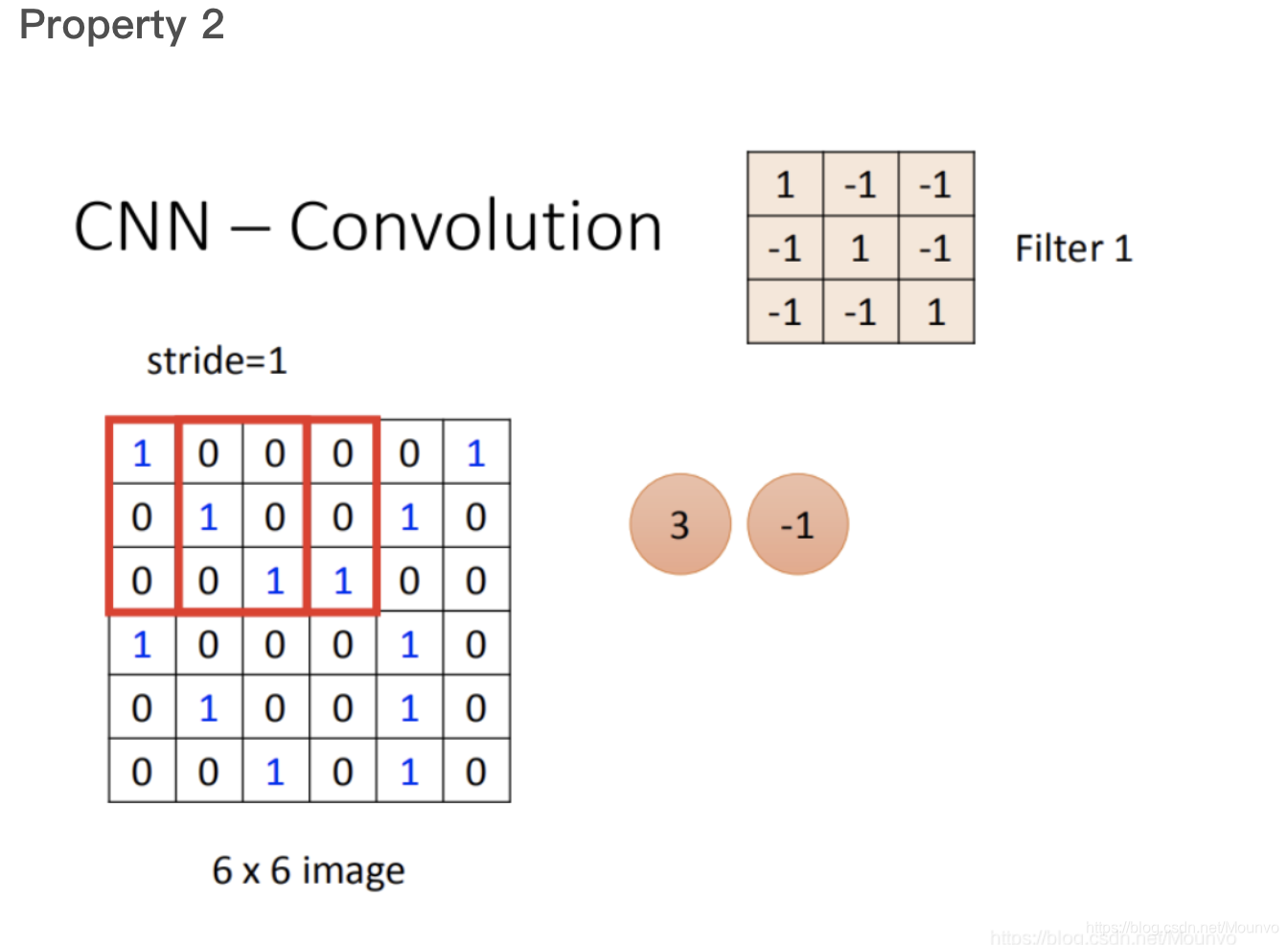

CNN特征

- small region:比图片小的pattern可以脱离图片被识别;

- same pattern:相同的pattern可能出现在不同位置;

- subsampling:缩小图像并不会改变结果。

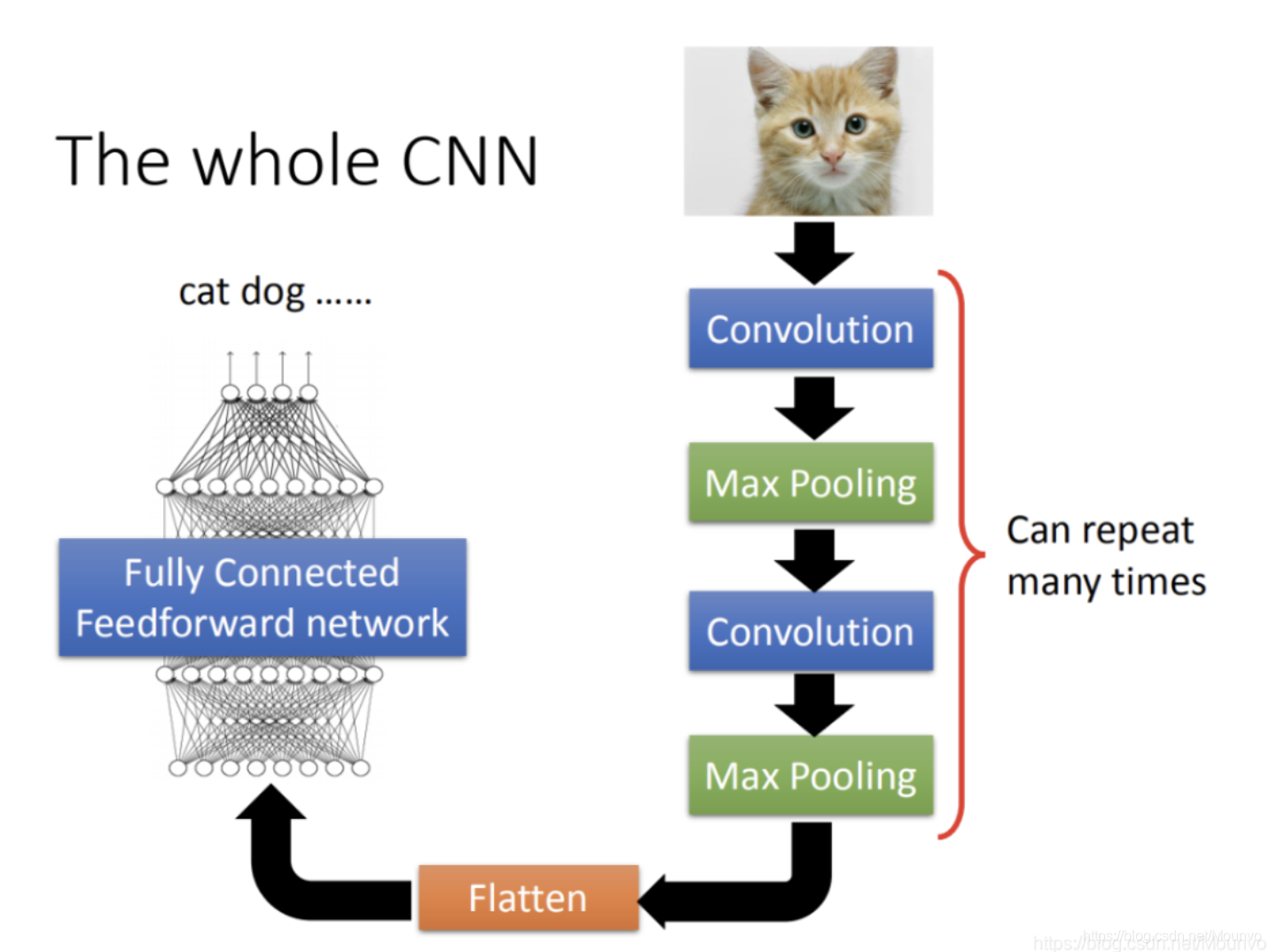

CNN架构