热门标签

热门文章

- 1在VMware ESXi虚拟机上设置静态MAC地址_虚拟机mac地址怎设置

- 2用python做舆情分析系统_如何用Python做舆情时间序列可视化?

- 3ChatGLM-6B部署和微调实例_调试chatglm-6b

- 4计算机视觉技术难点有哪些?还需要突破什么?_智能视觉识别技术的难点:标准掌握难度大

- 5transformer解码器输入问题和简化版递归预测方法--自回归生成()_自回归解码器

- 6python实现逻辑回归三种方法,Python中机器学习的逻辑回归,之,python,实现

- 7【2024美赛】C题 Problem C: Momentum in Tennis网球运动中的势头 网球问题一python代码_2024美赛c 题目

- 8就在今晚!技术如何赋能跨境电商?微软研发专家与你分享!

- 9java 过期策略实现_java 从零开始手写 redis(五)过期策略的另一种实现思路

- 10车道线检测——概述

当前位置: article > 正文

【LLM】Windows10环境部署阿里通义千问大模型(Qwen-14B-Chat-Int4)

作者:花生_TL007 | 2024-04-08 13:39:05

赞

踩

qwen-14b-chat-int4

环境

系统版本:Windows 10 企业版

版本号:20H2

系统类型:64 位操作系统, 基于 x64 的处理器

处理器:Intel® Core™ i7-13700K CPU @ 3.40GHz

机带 RAM:16.0 GB

显卡:NVIDIA RTX 4080(16G)

Python版本:3.10.11

文件准备

项目代码

Git地址:https://github.com/QwenLM/Qwen

创建好归档的文件夹,直接克隆即可:

git clone https://github.com/QwenLM/Qwen.git

- 1

模型相关文件

地址:https://huggingface.co/Qwen/Qwen-14B-Chat-Int4

注意:从huggingface.co上克隆,需要魔法、cmd命令行设置代理

魔法软件端口信息:

在cmd命令行执行:

set https_proxy=https://127.0.0.1:8001

- 1

完成上述配置后可以开始克隆了

模型文件比较大,需要使用git-lfs,下载git-lfs并安装:https://git-lfs.com,安装完配置好环境变量,

完成上述配置后,执行:

git lfs install

git clone https://huggingface.co/Qwen/Qwen-14B-Chat-Int4

- 1

- 2

运行

准备工作

安装所需的依赖,进入下载好的项目代码代码根目录,执行:

pip install -r requirements.txt

- 1

pip install auto-gptq optimum

- 1

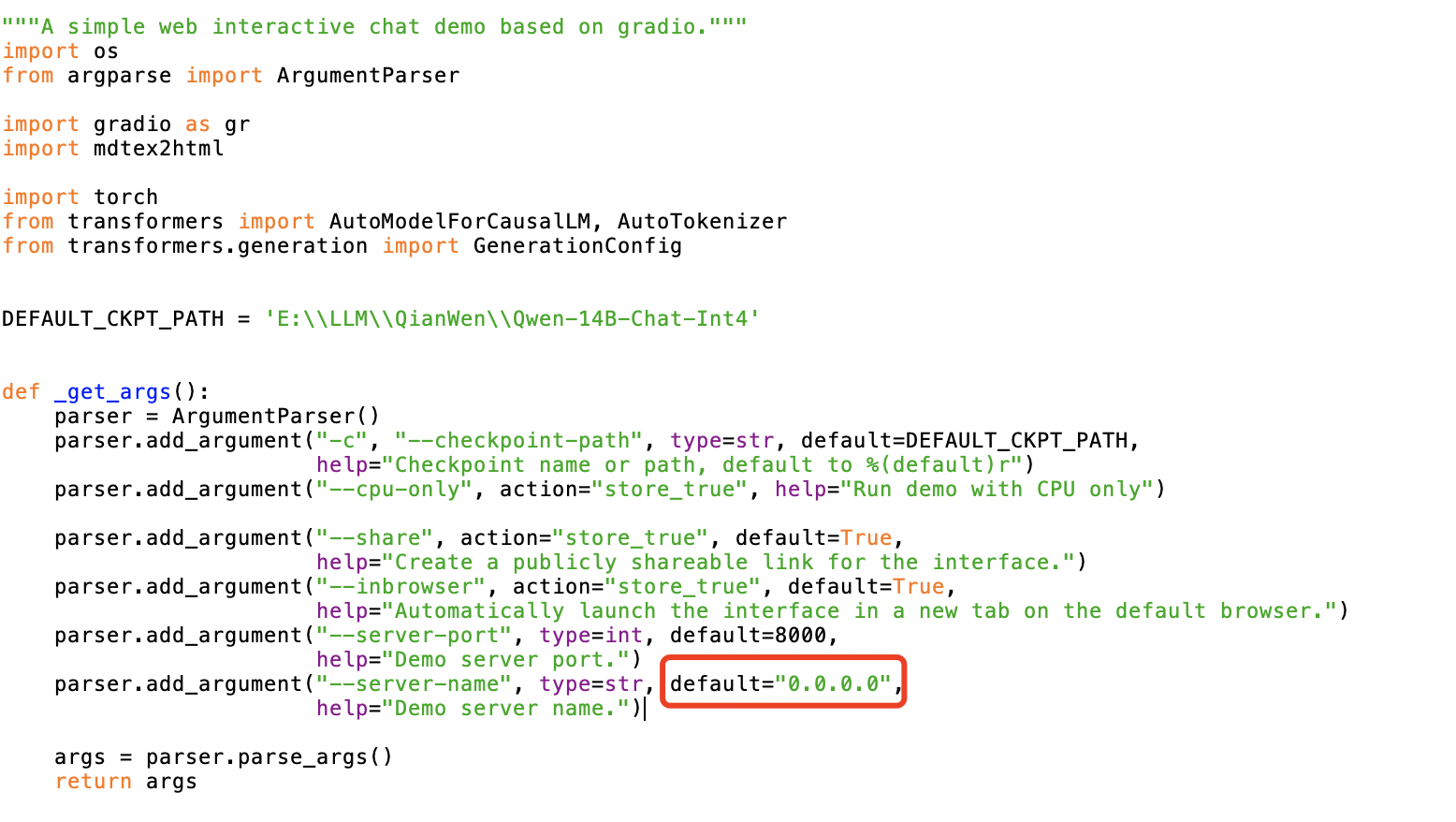

所有文件下载完成后,修改web_demo.py中模型文件路径:

运行demo

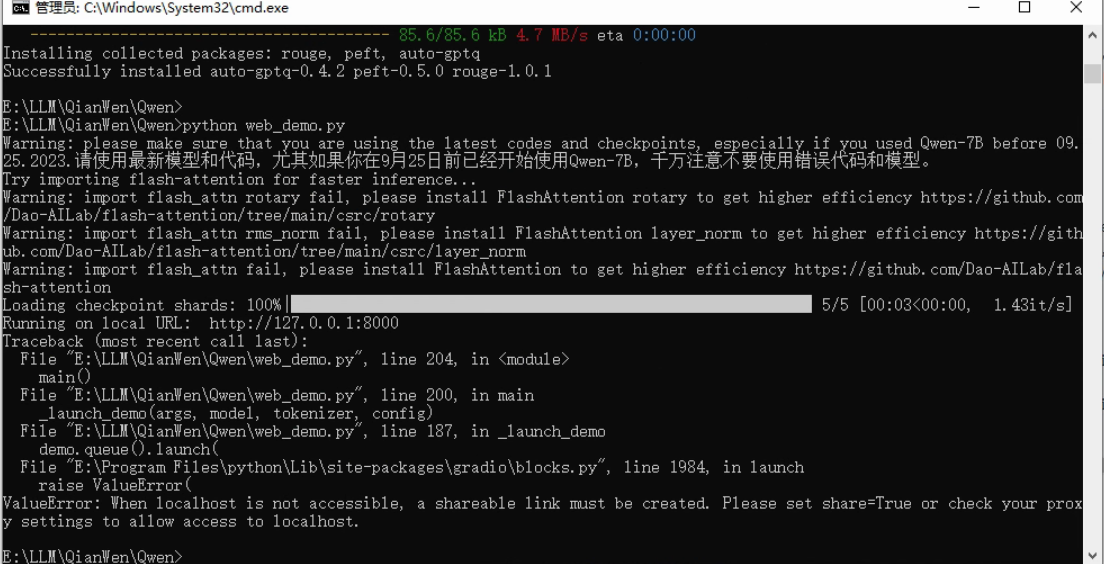

尝试执行:python web_demo.py,看看是否会报错,如果报错,就根据提示改:

提示需要设置share=True,在web_demo.py中找到对应位置:

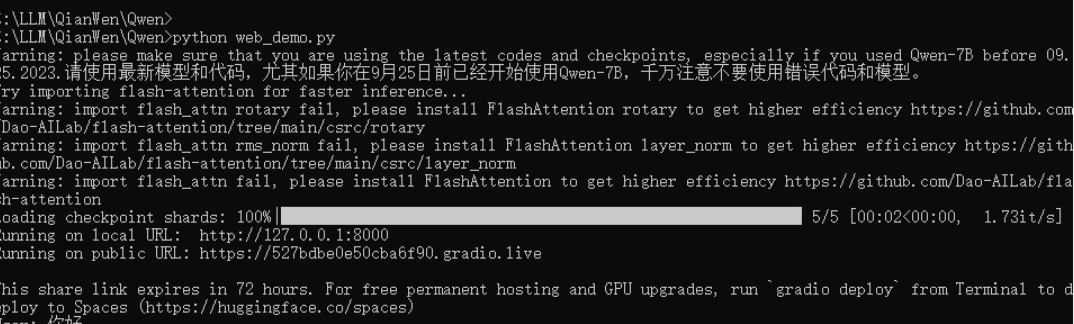

再运行试试:

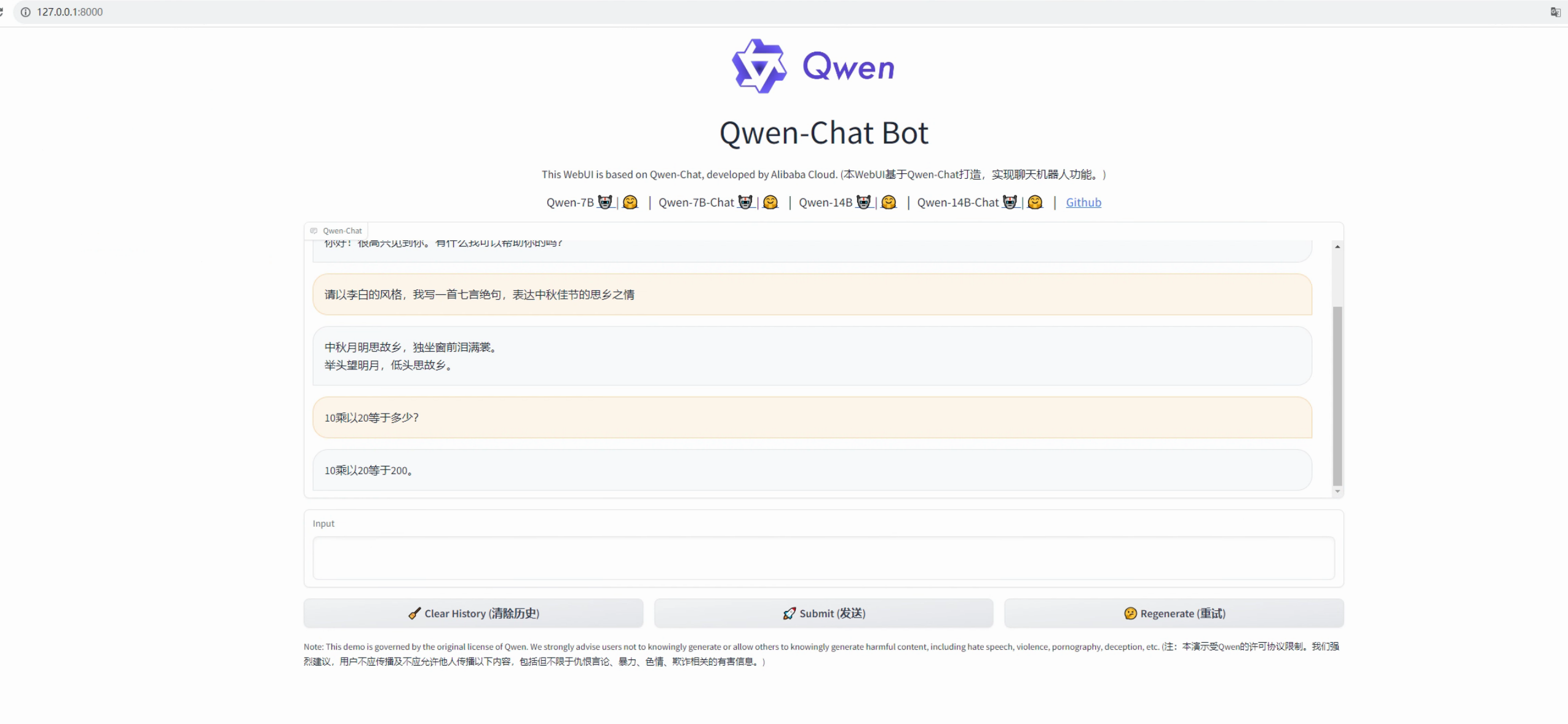

日志显示已启动成功,打开页面,可以正常进行问答,运行比较流畅:

Tips

从别的机器上访问,连接是拒绝的,查看日志,生成了一个临时的分享地址,可以提供给局域网内其他人使用

Running on local URL: http://127.0.0.1:8000

Running on public URL: https://527bdbe0e50cba6f90.gradio.live

This share link expires in 72 hours. For free permanent hosting and GPU upgrades, run `gradio deploy` from Terminal to deploy to Spaces (https://huggingface.co/spaces)

- 1

- 2

- 3

- 4

经过后续测试,将–server-name指定的参数修改为“0.0.0.0”即可。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/花生_TL007/article/detail/385849

推荐阅读

相关标签