- 1零一万物黄文灏:没有做出Sora的几点反思;大模型一千零一问;Mistral不愧欧洲之光;在巴黎与梵高聊聊艺术人生;微软生成式AI入门课(第2版) | ShowMeAI日报

- 2AD7606时序分析与verilog HDL实现_ad7606 verilog

- 3【Python学习教程】Python列表(list)、元组(tuple)、字典(dict)和集合(set)详解_python中的列表,元组,字典,集合

- 4最新2024为什么那么难找工作?_2024程序员面试机会一下少了很多,面试精选题_2024找工作

- 5mysql和oracle有什么区别_oracle和mysql5.0以后的版本有什么不同吗?

- 6【Hbase】Master startup cannot progress, in holding-pattern until region onlined.

- 7Git:分布式版本控制系统

- 8设计模式解析:适配器模式_接口适配器设计模式

- 9mysql基础理论知识_mysql数据库基础理论知识

- 10IEEE顶刊!中科院2区TOP,影响因子逐年上涨!同领域IEEE-Trans,仅47天录用!_ieee tro送审时间

白看不如一练!分享10个Python爬虫入门案例

赞

踩

昨天带伙伴们学习python爬虫,准备了几个简单的入门实例,分享给大家。

涉及主要知识点:

1.web是如何交互的

2.requests库的get、post函数的应用

3.response对象的相关函数,属性

4.python文件的打开,保存

代码中给出了注释,并且可以直接运行哦

如何安装requests库(安装好python的朋友可以直接参考,没有的,建议先装一哈python环境)

windows用户,Linux用户几乎一样:

打开cmd输入以下命令即可,如果python的环境在C盘的目录,会提示权限不够,只需以管理员方式运行cmd窗口

pip install -i https://pypi.tuna.tsinghua.edu.cn/simple requests

- 1

- 2

Linux用户类似(ubantu为例): 权限不够的话在命令前加入sudo即可

sudo pip install -i https://pypi.tuna.tsinghua.edu.cn/simple requests

- 1

- 2

1. 爬取强大的BD页面,打印页面信息

# 第一个爬虫示例,爬取百度页面

import requests #导入爬虫的库,不然调用不了爬虫的函数

response = requests.get("http://www.baidu.com") #生成一个response对象

response.encoding = response.apparent_encoding #设置编码格式

print("状态码:"+ str( response.status_code ) ) #打印状态码

print(response.text)#输出爬取的信息

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

2. 常用方法之get方法实例,下面还有传参实例

# 第二个get方法实例

import requests #先导入爬虫的库,不然调用不了爬虫的函数

response = requests.get("http://httpbin.org/get") #get方法

print( response.status_code ) #状态码

print( response.text )

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

3. 常用方法之post方法实例,下面还有传参实例

# 第三个 post方法实例

import requests #先导入爬虫的库,不然调用不了爬虫的函数

response = requests.post("http://httpbin.org/post") #post方法访问

print( response.status_code ) #状态码

print( response.text )

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

4. put方法实例

# 第四个 put方法实例

import requests #先导入爬虫的库,不然调用不了爬虫的函数

response = requests.put("http://httpbin.org/put") # put方法访问

print( response.status_code ) #状态码

print( response.text )

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

5. 常用方法之get方法传参实例(1)

如果需要传多个参数只需要用&符号连接即可如下:

# 第五个 get传参方法实例

import requests #先导入爬虫的库,不然调用不了爬虫的函数

response = requests.get("http://httpbin.org/get?name=hezhi&age=20") # get传参

print( response.status_code ) #状态码

print( response.text )

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

6. 常用方法之get方法传参实例(2)

params用字典可以传多个

# 第六个 get传参方法实例

import requests #先导入爬虫的库,不然调用不了爬虫的函数

data = {

"name":"hezhi",

"age":20

}

response = requests.get( "http://httpbin.org/get" , params=data ) # get传参

print( response.status_code ) #状态码

print( response.text )

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

7. 常用方法之post方法传参实例(2) 和上一个有没有很像

# 第七个 post传参方法实例

import requests #先导入爬虫的库,不然调用不了爬虫的函数

data = {

"name":"hezhi",

"age":20

}

response = requests.post( "http://httpbin.org/post" , params=data ) # post传参

print( response.status_code ) #状态码

print( response.text )

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

8. 关于绕过反爬机制,以zh爸爸为例

# 第好几个方法实例 import requests #先导入爬虫的库,不然调用不了爬虫的函数 response = requests.get( "http://www.zhihu.com") #第一次访问知乎,不设置头部信息 print( "第一次,不设头部信息,状态码:"+response.status_code )# 没写headers,不能正常爬取,状态码不是 200 #下面是可以正常爬取的区别,更改了User-Agent字段 headers = { "User-Agent":"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/80.0.3987.122 Safari/537.36" }#设置头部信息,伪装浏览器 response = requests.get( "http://www.zhihu.com" , headers=headers ) #get方法访问,传入headers参数, print( response.status_code ) # 200!访问成功的状态码 print( response.text )

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

9. 爬取信息并保存到本地

因为目录关系,在D盘建立了一个叫做爬虫的文件夹,然后保存信息

注意文件保存时的encoding设置

# 爬取一个html并保存 import requests url = "http://www.baidu.com" response = requests.get( url ) response.encoding = "utf-8" #设置接收编码格式 print("\nr的类型" + str( type(response) ) ) print("\n状态码是:" + str( response.status_code ) ) print("\n头部信息:" + str( response.headers ) ) print( "\n响应内容:" ) print( response.text ) #保存文件 file = open("D:\\爬虫\\baidu.html","w",encoding="utf") #打开一个文件,w是文件不存在则新建一个文件,这里不用wb是因为不用保存成二进制 file.write( response.text ) file.close()

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

10. 爬取图片,保存到本地

#保存百度图片到本地

import requests #先导入爬虫的库,不然调用不了爬虫的函数

response = requests.get("https://www.baidu.com/img/baidu_jgylogo3.gif") #get方法的到图片响应

file = open("D:\\爬虫\\baidu_logo.gif","wb") #打开一个文件,wb表示以二进制格式打开一个文件只用于写入

file.write(response.content) #写入文件

file.close()#关闭操作,运行完毕后去你的目录看一眼有没有保存成功

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

关于Python技术储备

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

今天小编也给大家分享一份Python学习资料,里面的内容都是适合零基础小白的笔记和资料,不懂编程也能听懂、看懂。如果需要的话直接划到文末免费获得,让我们一起学习!

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

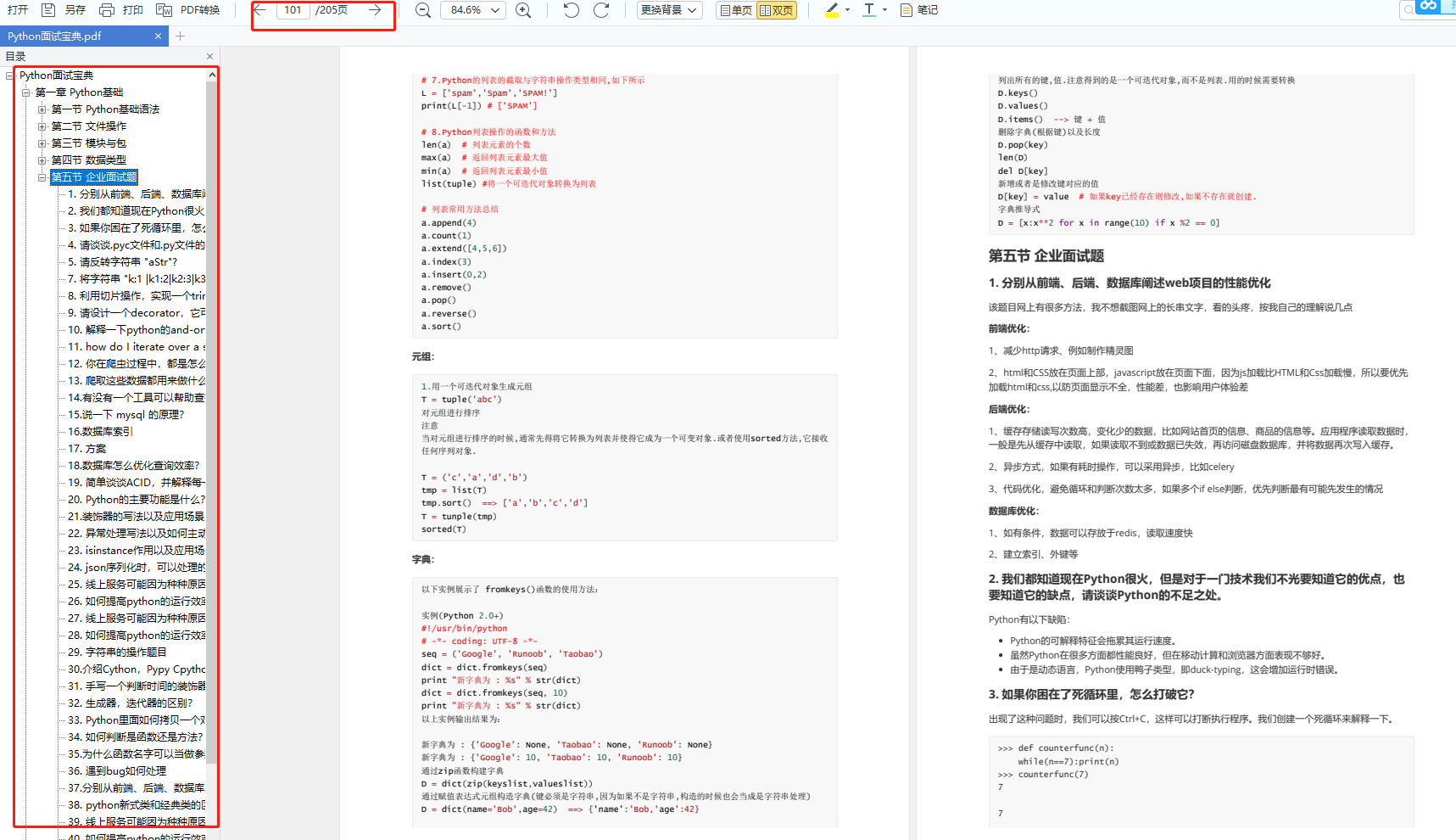

三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

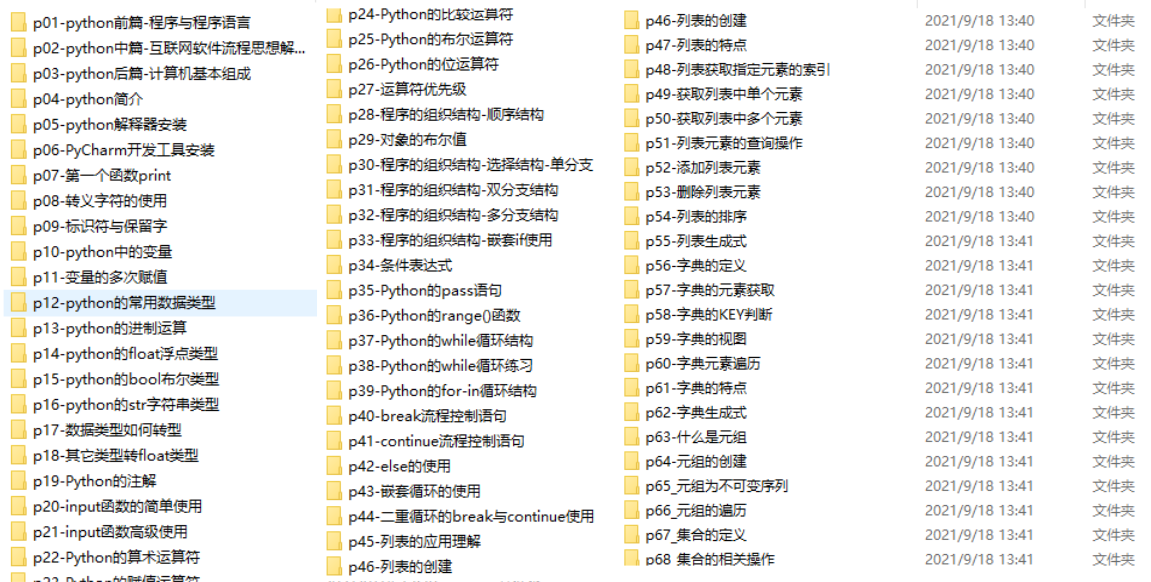

四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

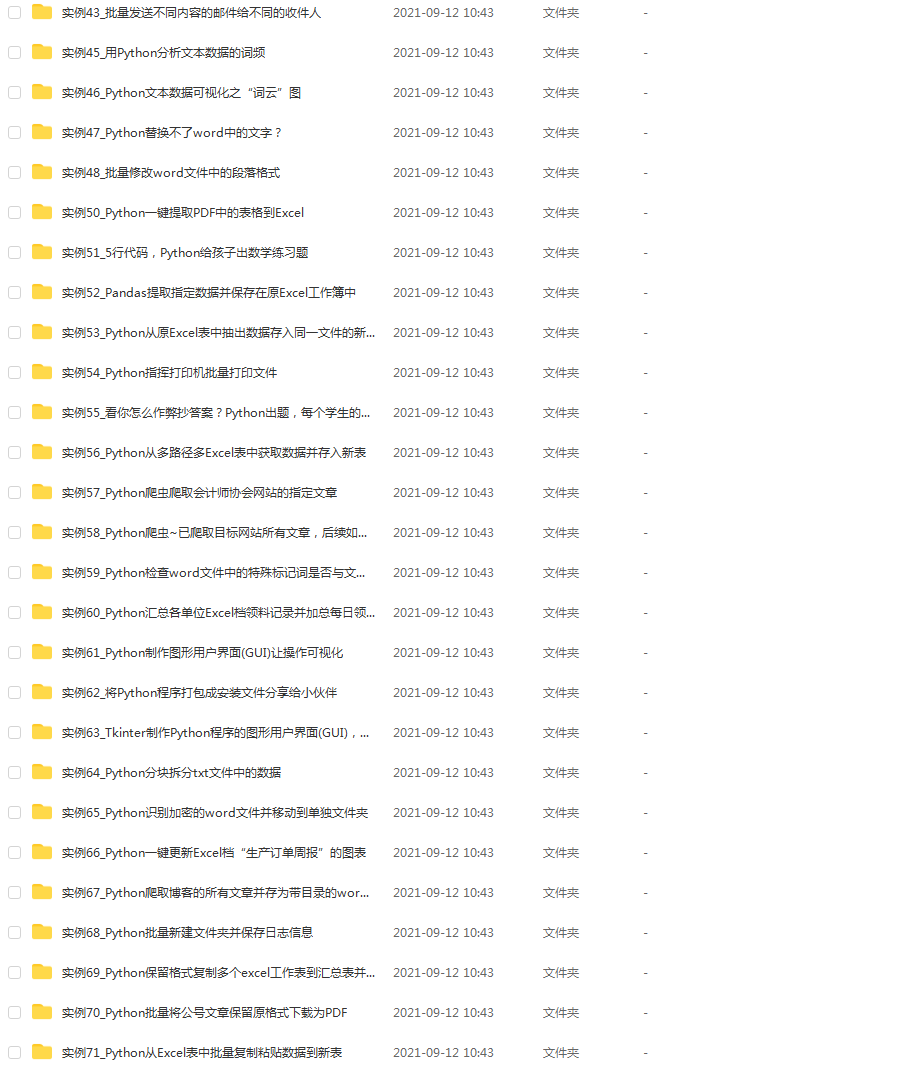

四、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

五、清华编程大佬出品《漫画看学Python》

用通俗易懂的漫画,来教你学习Python,让你更容易记住,并且不会枯燥乏味。

配套600集视频:

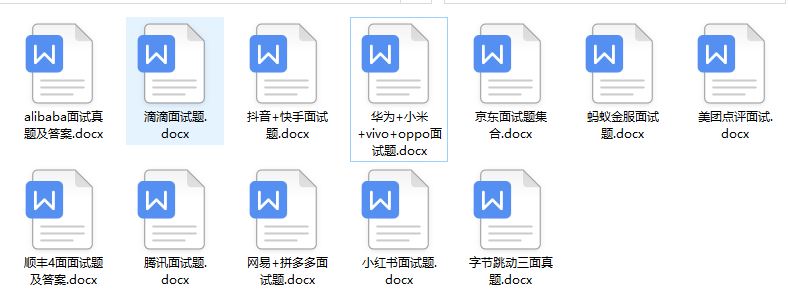

六、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

如果你也想和我一起学习Python,欢迎关注我

点击下方链接即可免费获取Python全套资料,学习视频,热门书籍PDF版本

声明:本文内容由网友自发贡献,转载请注明出处:【wpsshop】

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。