- 1hbase regionserver总出现自动down的情况排查_ailed to write trailer, non-fatal, continuing... o

- 2【C数据结构】解决动态顺序表以及常见问题_顺序表常见错误

- 3android12.0(S) Launcher3 导入 AndroidStudio 调试编译_android launcher3 放到android studio方法

- 4(25)采集微信实时消息(基于聊天记录窗体)-微信UI自动化(.Net+C#)

- 5关于uniapp打包后ios端高德地图的chooseLocation无法搜索地址问题_ios uni.chooselocation 选择地址错误

- 6单目深度估计基础理论和论文学习总结_基于深度学习的深度估计综述

- 7Python文件读取和写入_py文件读写

- 8提升编程效率的利器: 解析Google Guava库之常用工具类-40个示例(七)_guava工具类

- 9rabbitmq集群创建admin用户之后,提示can access virtual hosts是No access状态_rabbitmq admin can access virtual

- 10FFmpeg最常用命令参数详解及应用实例_ffmpeg -an

【技术干货】教你如何基于华为昇腾CANN架构快速实现模型推理应用_华为昇腾 显卡 深度学习推理库

赞

踩

昇腾的AI全软件栈平台、开源框架、CANN、MindSpore、MindX 等工具,可以让开发者实现「统一端边云,全端自动部署」,开启了机器学习开发的新时代,一直被人们寄予厚望。但正因为资源极其丰富,浩如星辰,想要快速寻找,到摸索清楚其中的原理,并最终结合自己手上的项目实现应用部署,人力成本、时间成本将增加不少,不利于快速推进项目。

现在~好消息来了!

经过英码科技工程师们的认真梳理,本篇文章,我们以英码科技EA500I边缘计算盒子为例,为大家介绍在昇腾CANN架构下,基于PyTorch框架的ResNet50模型,以及基于YOLOV7网络模型如何快速实现模型推理应用。

CANN架构介绍

01 样例1介绍(ResNet50模型)

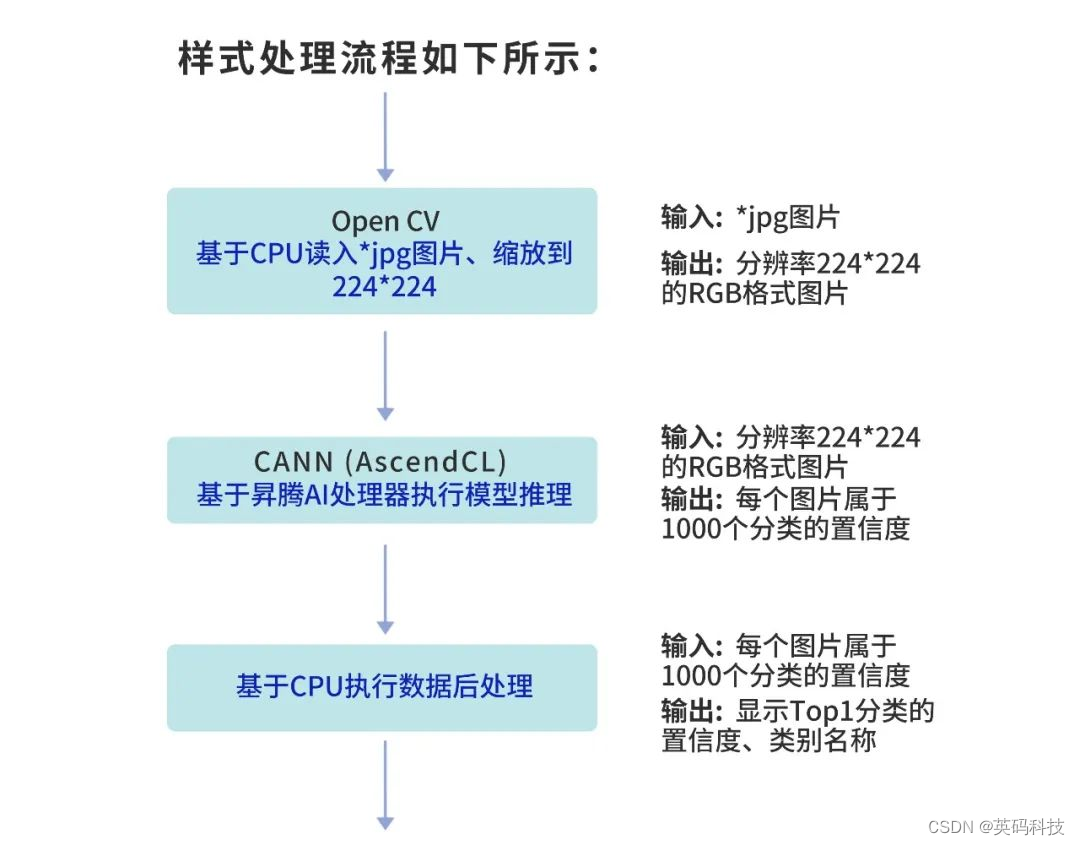

▍基于PyTorch框架的ResNet50模型,对*.jpg图片分类,输出各图片所属分类的编号、名称。

样例的处理流程如下图所示:

1 样例下载

命令行方式下载(下载时间较长,需稍作等待)。

# 开发环境,非root用户命令行中执行以下命令下载源码仓。cd ${HOME}

cd ${HOME}

git clone https://gitee.com/ascend/samples.git

注: 如果需要切换到其它tag版本,以v0.9.0为例,可执行以下命令。

git check out v0.9.0

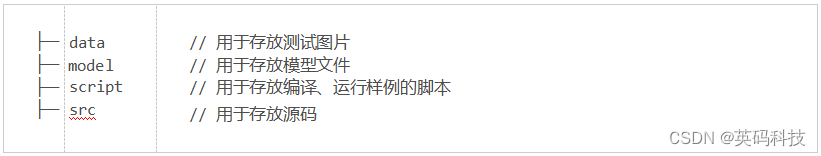

样例的代码目录说明如下:

2 准备环境

(1)安装CANN软件

最新版本的CANN软件安装指南请戳→安装指南

注:英码科技EA500I智能工作站系统环境中已适配该软件,无需另行下载安装。

(2)设置环境变量

注:“$HOME/Ascend”请替换“Ascend-cann-toolkit”包的实际安装路径。

# 设置CANN依赖的基础环境变量

. ${HOME}/Ascend/ascend-toolkit/set_env.sh

#如果用户环境存在多个python3版本,则指定使用python3.7.5版本

export PATH=/usr/local/python3.7.5/bin:$PATH

#设置python3.7.5库文件路径

export LD_LIBRARY_PATH=/usr/local/python3.7.5/lib:$LD_LIBRARY_PATH

# 配置程序编译依赖的头文件与库文件路径

export DDK_PATH=$HOME/Ascend/ascend-toolkit/latest

export NPU_HOST_LIB=$DDK_PATH/runtime/lib64/stub

(3)安装OpenCV

执行以下命令安装opencv ,须确保是3.x版本;

sudo apt-get install libopencv-dev

3 样例运行

(1)获取PyTorch框架的ResNet50模型(*.onnx),并转换为昇腾AI处理器能识别的模型(*.om)

注:此处以昇腾310 AI处理器为 例,针对其它昇腾AI处理器的模型转换,需修改atc命令中的-- soc_version参数值。

# 为方便下载,这里直接给出原始模型下载及模型转换命令,可以直接拷贝执行。

cd $HOME/samples/inference/modelInference/sampleResnetQuickStart/

cpp/model wget https://obs-9be7.obs.cn-east- 2.myhuaweicloud.com/003_Atc_Models/resnet50/resnet50.onnx

atc --model=resnet50.onnx --framework=5 --output=resnet50 --

input_shape="actual_input_1:1,3,224,224" --soc_version=Ascend310

atc命令中各参数的解释如下,详细约束说明请参见《ATC模型转换指南》。

-

--model :ResNet-50网络的模型文件的路径

-

--framework:原始框架类型。5表示ONNX。

-

--output:resnet50.om模型文件的路径。请注意,记录保存该om模型文件的路径,后续开发应用时需要使用。

-

--input_shape:模型输入数据的shape。

-

--soc_version:昇腾AI处理器的版本。

说明:如果无法确定当前设备的soc_version,则在安装驱动包的服务器执行npu-smi info 命令进行查询,在查询到的“Name“前增加Ascend信息,例如“Name“对应取值为_xxxyy_ , 实际配置的soc_version值为Ascend_xxxyy_。

(2)获取测试图片数据

请从以下链接获取该样例的测试图片dog1_ 1024_683.jpg,放在data目录下。

cd $HOME/samples/inference/modelInference/

sampleResnetQuickStart/cpp/data wget

https://obs-9be7.obs.cn-east-

2.myhuaweicloud.com/models/aclsample/dog1_1024_683.jpg

注:若需更换测试图片,则需自行准备测试图片,并将测试图片放到data目录下。

(3)编译样例源码

执行以下命令编译样例源码:

cd $HOME/samples/inference/modelInference/

sampleResnetQuickStart/

cpp/scripts bash sample_build.sh

(4)运行样例

执行以下脚本运行样例:

bash sample_run.sh

执行成功后,在屏幕上的关键提示信息示例如下,提示信息中的label表示类别标识、conf表示该分类的 最大置信度,class表示所属类别。这些值可能会根据版本、环境有所不同,请以实际情况为准:

[INFO] The sample starts to run

out_dog1_1024_683.jpg

label:162 conf:0.902209 class:beagle

[INFO] The program runs successfully

图片结果展示:

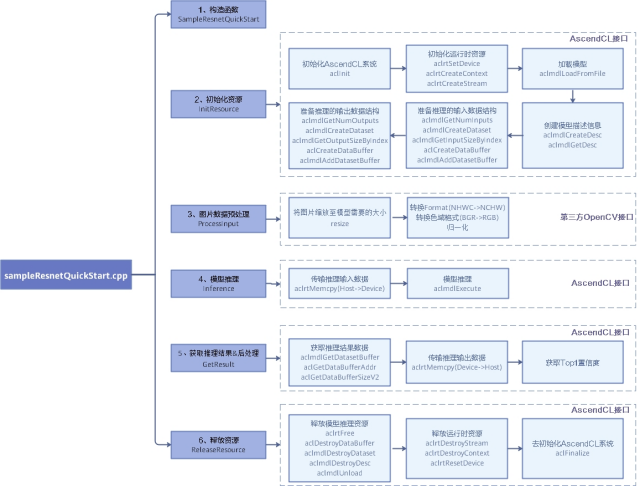

4 代码逻辑详解(C&C++语言)

样例中的接口调用流程如下图所示:

在此样例基础上:

若想要更换测试图片,只需自行准备好新的jpg图片并存放到样例的data目录下,图片数据预处理时会自 动从该目录下读取图片数据、再缩放至模型所需的大小。

若想要更换模型,则需关注以下修改点:

1.准备模型:需自行准备好原始模型并存放到样例的model目录下,再参考《ATC模型转换指南》转换模型;

2. 加载模型:在aclmdlLoadFromFile接口处加载转换后的模型;

3. 准备模型输入/输出数据结构:根据新模型的输入、输出个数准备;

4. 获取推理结果&后处理:根据新模型的输出数据进行后处理。

须知: 一般来说,更换其它图片分类模型(例如resnet50- >resnet101) ,由于同类模型的输入、输出类 似,在此样例基础上改动较小,但如果更换为其它类型的模型(例如目标检测模型),由于不同类型模 型的输入、输出差别较大,在此样例基础上数据预处理、模型输入&输出准备以及数据后处理等改动很大,建议在Ascend Sample仓先找到目标检测类的样例,再基于目标检测样例修改。

02 样例2介绍(YOLOV7模型)

以YOLOV7网络模型为例,使能Acllite对图片进行预处理,并通过模型转换使能静态AIPP功能,使能AIPP功能后,YUV420SP_U8格式图片转化为RGB,然后减均值和归一化操作,并将该信息固化到转换后的离线模型中,对YOLOV7网络执行推理,对图片进行物体检测和分类,并给出标定框和类别置信度。

样例输入:图片。

样例输出:图片物体检测,并且在图片上给出物体标注框,类别以及置信度。

1 获取源码包

可以使用以下两种方式下载,请选择其中一种进行源码准备。

命令行方式下载(下载时间较长,但步骤简单):

# 开发环境,非root用户命令行中执行以下命令下载源码仓。

cd ${HOME}

git clone https://gitee.com/ascend/samples.git

注:如果需要切换到其它tag版本,以v0.5.0为例,可执行以下命令。

git checkout v0.5.0

压缩包方式下载(下载时间较短,但步骤稍微复杂)。

注:如果需要下载其它版本代码,请先请根据前置条件说明进行samples仓分支切换。

# 1. samples仓右上角选择【克隆/下载】下拉框并选择【下载ZIP】。

# 2. 将ZIP包上传到开发环境中的普通用户家目录中,

【例如:${HOME}/ascend-samples- master.zip】。

# 3. 开发环境中,执行以下命令,解压zip包。

cd ${HOME}

unzip ascend-samples-master.zip

2 第三方依赖安装

设置环境变量,配置程序编译依赖的头文件,库文件路径。“$HOME/Ascend”请替换“Ascend-cann-toolkit”包的 实际安装路径。

export DDK_PATH=$HOME/Ascend/ascend-toolkit/latest

export NPU_HOST_LIB=$DDK_PATH/runtime/lib64/stub

export THIRDPART_PATH=${DDK_PATH}/thirdpart

export LD_LIBRARY_PATH=${THIRDPART_PATH}/lib:$LD_LIBRARY_PATH

创建THIRDPART_PATH路径:

mkdir -p ${THIRDPART_PATH}

acllite

注:源码安装ffmpeg主要是为了acllite库的安装 执行以下命令安装x264

# 下载x264

cd ${HOME}

git clone https://code.videolan.org/videolan/x264.git

cd x264

# 安装x264

./configure --enable-shared --disable-asm

make

sudo make install

sudo cp /usr/local/lib/libx264.so.164 /lib

执行以下命令安装ffmpeg:

# 下载ffmpeg

cd ${HOME}

wge thttp://www.ffmpeg.org/releases/ffmpeg-4.1.3.tar.gz --no-check- certificatetar -zxvf ffmpeg-4.1.3.tar.gz

cd ffmpeg-4.1.3

# 安装ffmpeg

./configure --enable-shared --enable-pic --enable-static --disable-x86asm -- enable-libx264 --enable-gpl --prefix=${THIRDPART_PATH}

make -j8

make install

执行以下命令安装acllite:

cd ${HOME}/samples/inference/acllite/cplusplus

make

make install

安装opencv

执行以下命令安装opencv(注:须确保是3.x版本)

sudo apt-get install libopencv-dev

3 样例运行

(1)数据准备

请从以下链接获取该样例的输入图片,放在data目录下。

cd $HOME/samples/inference/modelInference/sampleYOLOV7/data

wget https://obs-9be7.obs.cn-east-

2.myhuaweicloud.com/models/aclsample/dog1_1024_683.jpg

(2)ATC模型转换

将YOLOV7原始模型转换为适配昇腾310处理器的离线模型(*.om文件),放在model路径下。

#为了方便下载,在这里直接给出原始模型下载及模型转换命令,可以直接拷贝执行。

cd $HOME/samples/inference/modelInference/

sampleYOLOV7/model

wget https://obs-9be7.obs.cn-east-

2.myhuaweicloud.com/003_Atc_Models/yolov7/yolov7x.onnx

wget https://obs-9be7.obs.cn-east-

2.myhuaweicloud.com/003_Atc_Models/yolov7/aipp.cfg

atc --model=yolov7x.onnx --framework=5 --output=yolov7x --

input_shape="images:1,3,640,640" --soc_version=Ascend310 --

insert_op_conf=aipp.cfg

样例编译

执行以下命令,执行编译脚本,开始样例编译。

cd $HOME/samples/inference/modelInference/

sampleYOLOV7/scripts

bash sample_build.sh

样例运行

执行运行脚本,开始样例运行。

bash sample_run.s

(3)样例结果展示

运行完成后,会在样例工程的out目录下生成推理后的图片,显示对比结果如下所示。

结语

![]()

以上内容详细介绍了在昇腾CANN架构下,基于PyTorch框架的ResNet50模型,以及基于YOLOV7网络模型如何快速实现模型推理应用的主要流程,尤其方便已购买英码科技EA500I边缘计算盒子的开发者朋友们快速实现推理应用。

下期将会继续更新关于昇腾开发工具的其他详细使用教程,欢迎关注!