- 1Python--初识_python中的penup和pendown

- 2Mysql各种类型字段长度_mysql字段类型长度

- 3nlohmann 最优秀的C 序列化工具库 详细入门教程_nlohamann 教程

- 4Python3网络爬虫(一):利用urllib进行简单的网页抓取_python3 爬虫

- 5什么是微服务?_n微服务

- 6基于JSP物流信息网设计与实现 源码+论文_物流信息提交网站源码

- 7书生浦语训练营2期-第四节课—XTuner微调LLM:1.8B多模态Agent实践笔记及作业

- 815个nosql数据库_nosql数据库有哪些

- 9Arduino利用NTPClient库获取网络时间,显示时间与实时时间不同步_arduino ntpclient

- 10最新AI创作系统ChatGPT网站源码Midjourney-AI绘画系统,GPT4-All联网搜索提问模型,Suno-v3-AI音乐生成大模型

西电数据挖掘大作业_大数据,Hadoop生态详解

赞

踩

1、为什么会有大数据

随着信息技术的发展,各行各业产生的数据越多越多,数据量越来越大,传统数据处理模式已经满足不了大数据的增长。

1)存储问题

数据库存储:假设每天每个人访问简书,浏览5文章,如果有1亿人浏览,简书后台会产生5亿左右的记录,如果这些记录存到数据库,存放这些数据的数据库服务器性能要非常高,往往这样的服务器价格要比普通服务器贵很多倍。

按照各个来算,每天增加一台高性能服务器用来存储新数据,并且也解决不了根本问题。

大数据存储:可以作用在低成本的硬件上,服务器不需要很高的性能,并且会把数据存到磁盘上,并且可以备份。 如果磁盘空间满了,就增加磁盘,再存储即可。

2)分析数据问题

大数据分析:分布式计算,实时处理技术。磁盘计算:在计算过程中,多次落地磁盘,离线计算,mapreduce。内存计算:在内存中进行计算,类似实时处理技术,spark。

2、什么是hadoop

Hadoop 是Apache的顶级项目。

Apache:APACHE软件基金会,支持Apache的开源软件社区项目,为公众提供好的软件产品。Apache项目主页:http://hadoop.apache.org

Hadoop项目是以可靠、可扩展和分布式计算为目的而发展而来的开源软件。

可靠:存储可靠,数据有备份。优点:某个磁盘或机器坏了,数据不会丢失,可以从备份的机器上拿数据。

可以横向扩展:扩展存储空间,扩展磁盘,扩展机器磁盘;可以扩展计算节点,加机器,扩展计算内存。

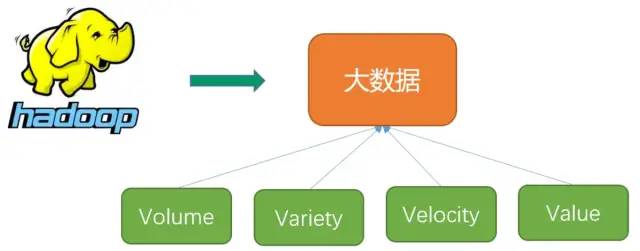

3、大数据的主要特点(4V)

第一, 数据容量大(Volume)。从TB级别,跃升到PB级别。

第二, 数据类型繁多(Variety)。相对于以往便于存储的以文本为主的结构化数据,非结构化数据越来越多,包括网络日志、音频、视频、图片、地理位置信息等,这些多类型的数据对数据的处理能力提出了更高要求。

第三, 商业价值高(Value)。客户群体细分,提供定制化服务;发掘新的需求同时提高投资的回报率;降低服务成本。

第四, 处理速度快(Velocity)。这是大数据区分于传统数据挖掘的最显著特征。根据IDC的“数字宇宙”的报告,预计到2020年,全球数据使用量将达到35.2ZB。在如此海量的数据面前,处理数据的效率就是企业的生命。

4、hadoop的历史起源

创始人: Doug Cutting 和 Mike Cafarella2002开始,两位创始人开发开源搜索引擎解决方案: Nutch2004年受Google Lab 开发的 Map/Reduce 和 Google File System(GFS) 的启发,NDFS( Nutch Distributed File System )引入Nutch2006年 在Yahoo! 工作的Doug Cutting将这套大数据处理软件命名为Hadoop

5、hadoop核心组件

hadoop主要用于解决两个核心问题:存储和计算。

1)Hadoop Common:一组分布式文件系统和通用I/O的组件与接口(序列化、Java RPC和持久化数据结构)。2)Hadoop Distributed FileSystem(Hadoop分布式文件系统HDFS)3)Hadoop MapReduce(分布式计算框架)4)Hadoop YARN(分布式资源管理器)

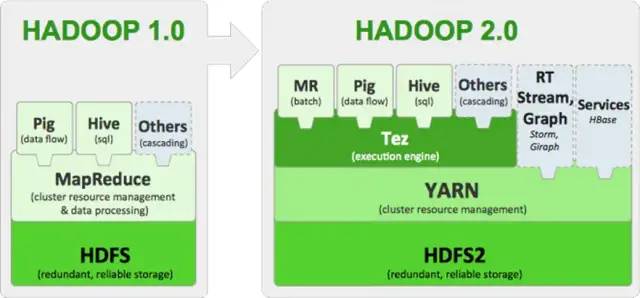

6、hadoop的框架演变

Hadoop1.0 的 MapReduce(MR1):集资源管理和任务调用、计算功能绑在一起,扩展性较差,不支持多计算框架。

Hadoop2.0 的Yarn(MRv2):将资源管理和任务调用两个功能分开,提高扩展性,并支持多计算框架 。

7、hadoop生态圈

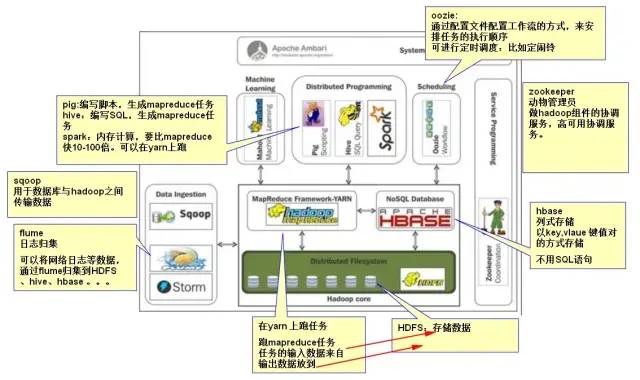

1)HDFS(Hadoop分布式文件系统)HDFS是一种数据分布式保存机制,数据被保存在计算机集群上。数据写入一次,读取多次。HDFS 为HBase等工具提供了基础。

2)Hadoop YARN(分布式资源管理器)YARN是下一代MapReduce,即MRv2,是在第一代MapReduce基础上演变而来的,主要是为了解决原始Hadoop扩展性较差,不支持多计算框架而提出的。其核心思想:将MR1中JobTracker的资源管理和作业调用两个功能分开,分别由ResourceManager和ApplicationMaster进程来实现。1)ResourceManager:负责整个集群的资源管理和调度。2)ApplicationMaster:负责应用程序相关事务,比如任务调度、任务监控和容错等。

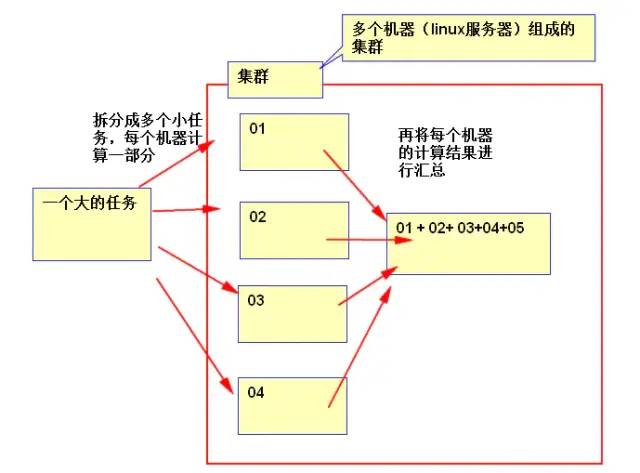

3)MapReduce(分布式计算框架)MapReduce是一种分布式计算模型,用以进行大数据量的计算,是一种离线计算框架。这个 MapReduce 的计算过程简而言之,就是将大数据集分解为成若干个小数据集,每个(或若干个)数据集分别由集群中的一个结点(一般就是一台主机)进行处理并生成中间结果,然后将每个结点的中间结果进行合并, 形成最终结果。

4)Spark(内存计算模型)Spark提供了一个更快、更通用的数据处理平台。和Hadoop相比,Spark可以让你的程序在内存中运行时速度提升100倍,或者在磁盘上运行时速度提升10倍。

5)Storm(流示计算、实时计算)Storm是一个免费开源、分布式、高容错的实时计算系统。Storm令持续不断的流计算变得容易,弥补了Hadoop批处理所不能满足的实时要求。Storm经常用于在实时分析、在线机器学习、持续计算、分布式远程调用和ETL等领域。

6)HBASE(分布式列存数据库)HBase是一个建立在HDFS之上,面向列的NoSQL数据库,用于快速读/写大量数据。HBase使用Zookeeper进行管理,确保所有组件都正常运行。

7)Hive(数据仓库)Hive定义了一种类似SQL的查询语言(HQL),将SQL转化为MapReduce任务在Hadoop上执行。通常用于离线分析。HQL用于运行存储在Hadoop上的查询语句,Hive让不熟悉MapReduce开发人员也能编写数据查询语句,然后这些语句被翻译为Hadoop上面的MapReduce任务。

8)Zookeeper(分布式协作服务)Hadoop的许多组件依赖于Zookeeper,它运行在计算机集群上面,用于管理Hadoop操作。作用:解决分布式环境下的数据管理问题:统一命名,状态同步,集群管理,配置同步等。

9)Sqoop(数据ETL/同步工具)Sqoop是SQL-to-Hadoop的缩写,主要用于传统数据库和Hadoop之间传输数据。

10)flume(分布式日志收集系统)Flume是一个分布式、可靠、和高可用的海量日志聚合的系统,如日志数据从各种网站服务器上汇集起来存储到HDFS,HBase等集中存储器中。

11)Pig(ad-hoc脚本)Pig定义了一种数据流语言—Pig Latin,它是MapReduce编程的复杂性的抽象,Pig平台包括运行环境和用于分析Hadoop数据集的脚本语言(Pig Latin)。其编译器将Pig Latin 翻译成MapReduce 程序序列将脚本转换为MapReduce任务在Hadoop上执行。通常用于进行离线分析。

12)Oozie(工作流调度器)Oozi可以把多个Map/Reduce作业组合到一个逻辑工作单元中,从而完成更大型的任务。

13)Mahout(数据挖掘算法库)Mahout的主要目标是创建一些可扩展的机器学习领域经典算法的实现,旨在帮助开发人员更加方便快捷地创建智能应用程序。

14)Tez(DAG计算模型)一个运行在YARN之上支持DAG(有向无环图)作业的计算框架。Tez的目的就是帮助Hadoop处理这些MapReduce处理不了的用例场景,如机器学习。