- 1记录mac环境下,最简单的手动安装nvm方式,看完秒会_mac安装vnm

- 2Python学习---Pandas_python pandas example

- 3使用uniapp编写的微信小程序进行分包

- 4Python PyInstaller安装和使用教程(详解版)_neokylin 安装pyinstaller

- 5躺平吧,平铺的窗口「GitHub 热点速览 v.21.47」

- 6AI人工智能机器学习的类型:监督学习、无监督学习、半监督学习、增强学习和深度学习_algc技术中的机器学习类型之一是

- 7Linux下做一个简单的进度条_linux 终端进度图标

- 8Mac版sublime Text格式化json、压缩json_sublime json压缩

- 9python flask创建服务器实现文件的上传下载,已获千赞_python flask建一个服务接受上传视频和音频

- 10基于django图书管理系统_基于django的图书管理系统

【matlab】LSTM/GRU网络回归/分类预测改进与优化合集(持续更新)_matlab多任务lstm

赞

踩

目录

一、进化算法-LSTM

概述:

1.原理:通过进化算法寻找LSTM网络最优超参数。

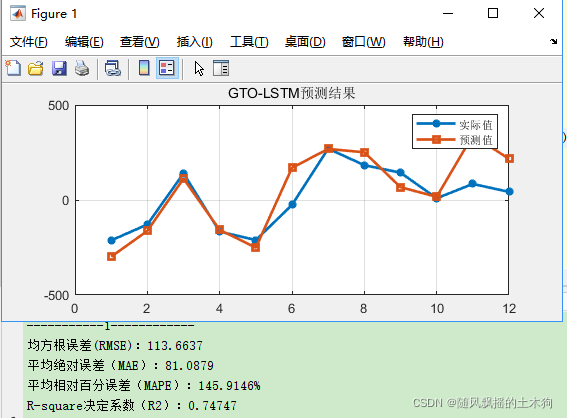

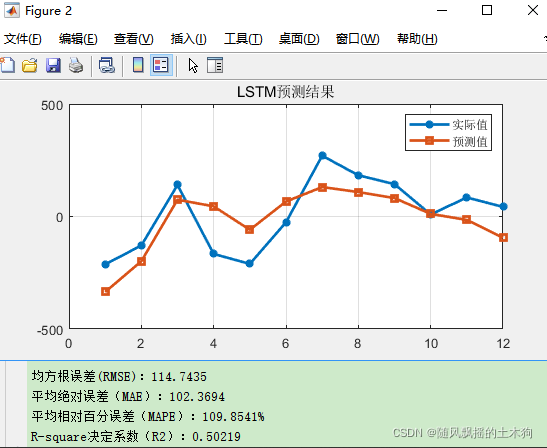

2.本文测试数据为12输入单输出,解决回归问题。

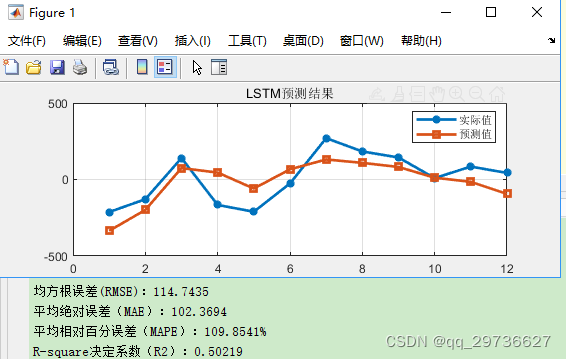

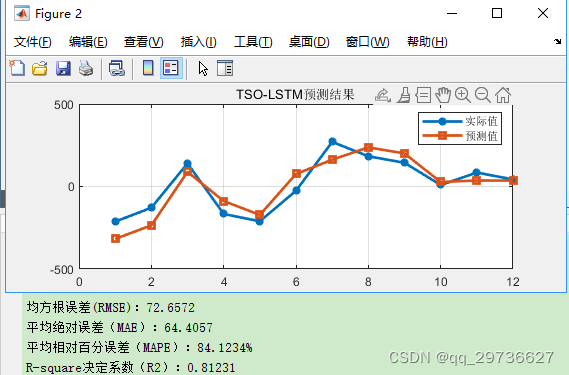

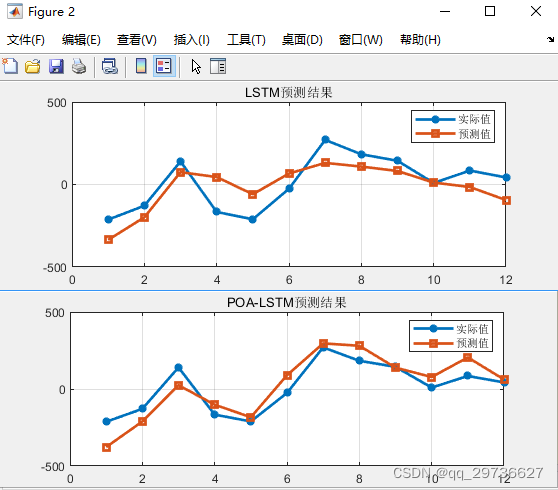

3.评价指标:测试集实际值与预测值对比,目标函数为rmse,另外附MAE、MAPE、R2计算值

4.优化LSTM三个参数,即隐含层神经元数,学习率,训练次数

5.本代码进化算法为测试参数,为了提高运算速度,迭代次数为3,种群数量为5,可自行修改

1.金枪鱼算法TSO-LSTM

%TSO_LSTM

clear all;

close all;

clc;

Particles_no = 10; % 种群数量 50

Function_name=‘LSTM_MIN’;

Max_iter = 3; % 迭代次数 10

Low = [10 0.001 10 ];%三个参数的下限

Up = [200 0.02 200 ];%三个参数的上限

Dim = 3;%待优化参数数量

fobj = @(x)LSTM_MIN(x);

train_x=input(:,1:n);

train_y=output(:,1:n);

test_x=input(:,n+1:end);

test_y=output(:,n+1:end);

method=@mapminmax;

% method=@mapstd;

[train_x,train_ps]=method(train_x);

test_x=method(‘apply’,test_x,train_ps);

[train_y,output_ps]=method(train_y);

test_y=method(‘apply’,test_y,output_ps);

XTrain = double(train_x) ;

XTest = double(test_x) ;

YTrain = double(train_y);

YTest = double(test_y);

numFeatures = size(XTrain,1); %输入特征维数

numResponses = size(YTrain,1);%输出特征维数

layers = [ …

sequenceInputLayer(numFeatures)%输入层,参数是输入特征维数

lstmLayer(Tuna1(1,1))%lstm层,如果想要构建多层lstm,改几个参数就行了

fullyConnectedLayer(numResponses)%全连接层,也就是输出的维数

regressionLayer];%该参数说明是在进行回归问题,而不是分类问题

options = trainingOptions(‘adam’, …%求解器设置为’adam’

‘MaxEpochs’,Tuna1(1,3), …%这个参数是最大迭代次数,即进行200次训练,每次训练后更新神经网络参数

‘MiniBatchSize’,16, …%用于每次训练迭代的最小批次的大小。

‘InitialLearnRate’,Tuna1(1,2), …%学习率

‘GradientThreshold’,1, …%设置梯度阀值为1 ,防止梯度爆炸

‘Verbose’,false, …%如果将其设置为true,则有关训练进度的信息将被打印到命令窗口中。

‘Plots’,‘training-progress’);%构建曲线图

%对每个时间步进行预测,对于每次预测,使用前一时间步的观测值预测下一个时间步。

net = trainNetwork(XTrain,YTrain,layers,options);

numTimeStepsTest = size(XTest,2);

for i = 1:numTimeStepsTest

[net,YPred(:,i)] = predictAndUpdateState(net,XTest(:,i),‘ExecutionEnvironment’,‘cpu’);

end

% 结果

% 反归一化

predict_value=method(‘reverse’,YPred,output_ps);

predict_value=double(predict_value);

true_value=method(‘reverse’,YTest,output_ps);

true_value=double(true_value);

for i=1

figure

plot(true_value(i,:),‘-‘,‘linewidth’,2)

hold on

plot(predict_value(i,:),’-s’,‘linewidth’,2)

legend(‘实际值’,‘预测值’)

grid on

title(‘TSO-LSTM预测结果’)

ylim([-500 500])

rmse=sqrt(mean((true_value(i,:)-predict_value(i,:)).^2));

disp([‘-----------’,num2str(i),‘------------’])

disp([‘均方根误差(RMSE):’,num2str(rmse)])

mae=mean(abs(true_value(i,:)-predict_value(i,:)));

disp([‘平均绝对误差(MAE):’,num2str(mae)])

mape=mean(abs((true_value(i,:)-predict_value(i,:))./true_value(i,:)));

disp([‘平均相对百分误差(MAPE):’,num2str(mape100),’%'])

r2=R2(true_value(i,:),predict_value(i,:));

disp([‘R-square决定系数(R2):’,num2str(r2)])

end

实际效果以自己的数据为准,本文测试结果并不代表算法最终效果。不同数据,数据处理方式,待优化参数等均不同。

2.孔雀优化算法(POA)-LSTM

与上文同数据、同进化算法设置参数。效果仅供参考

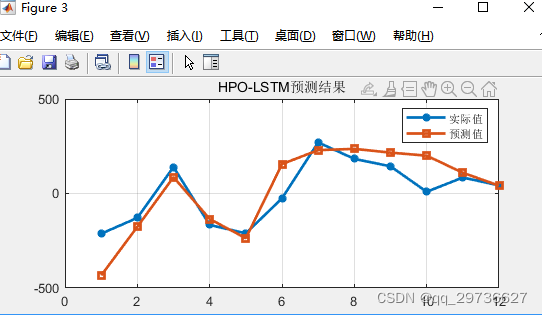

3.猎人优化算法(HPO)-LSTM

1.2021年Iraj Naruei等人提出的猎人优化算法,Hunter–prey optimization, 与LSTM网络结合,优化LSTM超参数。

2.该算法的灵感来自狮子、豹子和狼等捕食性动物以及雄鹿和瞪羚等猎物的行为。动物狩猎行为的场景有很多,其中一些已经转化为优化算法。本文使用的场景与之前算法的场景不同。在提议的方法中,猎物和捕食者种群以及捕食者攻击远离猎物种群的猎物。猎人向着这个远处的猎物调整自己的位置,而猎物则向着安全的地方调整自己的位置。作为适应度函数最佳值的搜索代理的位置被认为是安全的位置。在几个测试函数上实现的 HPO 算法以评估其性能。此外,对于性能验证,所提出的算法被应用于几个工程问题。结果表明,所提出的算法在解决测试功能和工程问题方面表现良好。

3.本文为测试数据,12输入,单输出,回归问题。与上文同数据、同进化算法设置参数。效果仅供参考

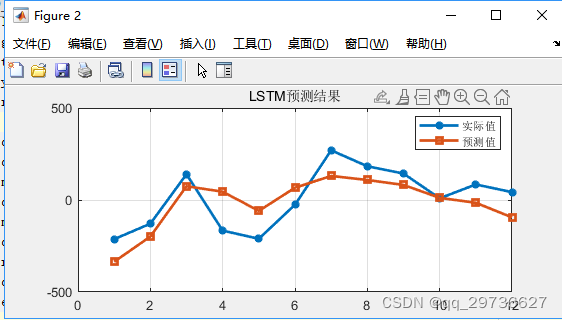

4.人工大猩猩部队优化算法(GTO)-LSTM

本文为测试数据,12输入,单输出,回归问题。与上文同数据、同进化算法设置参数。效果仅供参考

二、进化算法(改进)-LSTM

1.混沌映射Tent

2.收敛因子

3.多算法组合

4.基于levy飞行

本文将Levy飞行应用于鲸鱼的位置更新中,在算法进行更新后再进行一次Levy飞行更新个体位置,可以实现跳出局部最优解,扩大搜索能力的效果。位置更新的方式为:

X(t+1)=X(t)+α⊕Levy(λ)

其中,α \alphaα为步长缩放因子,本文取值为1;

Levy飞行的具体机制:

“莱维Levy飞行”以法国数学家保罗·莱维命名,指的是步长的概率分布为重尾分布的随机行走,也就是说在随机行走的过程中有相对较高的概率出现大跨步。莱维飞行的名称来源于本华·曼德博(Benoît Mandelbrot,莱维的学生)。他用“柯西飞行”来指代步长分布是柯西分布的随机行走,用“瑞利飞行”指代步长分布是正态分布(尽管正态分布没有重尾)的随机行走(瑞利分布是二维独立同方差正态变量模长的分布)。后来学者还进一步将莱维飞行的概念从连续空间推广到分立格点上的随机运动。