热门标签

热门文章

- 1运维笔记:inotify+rsync实现实时监控备份_centos 实时同步备份

- 2【栈】无法吃午餐的学生数量(leetcode1700)_无法吃午餐的学生数量 leetcode python

- 3Socket编程详解

- 4Ubuntu20.04下安装QtCreator 5.14.2(安装/卸载/创建快捷键/添加收藏)_ubuntu20.04 qtcreator

- 5Linux—root密码丢失重置_linux系统忘记root密码

- 6Java实现简易UDP客户端、服务器端通信程序_java 创建一个udp服务

- 7【原创】程序员必备的10大健康装备!——我们要工作更要健康!

- 8最细致讲解yolov8模型推理完整代码--(前处理,后处理)_yolov8推理

- 924个提高知识和技能极限的机器学习项目_有点难度的机器学习项目

- 1052-Android之内置应用_libcrashpad_handler_trampoline

当前位置: article > 正文

pytorch的显存机制torch.cuda.empty_cache()_orch.cuda.empty_cache() cpu

作者:2023面试高手 | 2024-02-21 23:55:06

赞

踩

orch.cuda.empty_cache() cpu

参考 pytorch的显存机制torch.cuda.empty_cache() - 云+社区 - 腾讯云

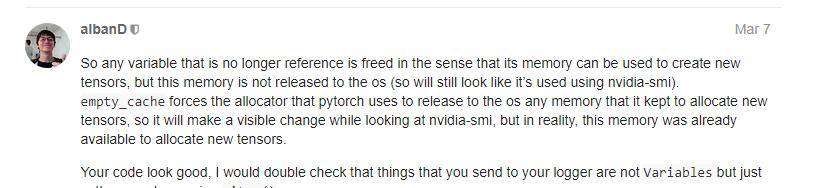

Pytorch已经可以自动回收我们不用的显存,类似于python的引用机制,当某一内存内的数据不再有任何变量引用时,这部分的内存便会被释放。但有一点需要注意,当我们有一部分显存不再使用的时候,这部分释放的显存通过Nvidia-smi命令是看不到的,举个例子:

- device = torch.device('cuda:0')

- # 定义两个tensor

- dummy_tensor_4 = torch.randn(120, 3, 512, 512).float().to(device) # 120*3*512*512*4/1000/1000 = 377.48M

- dummy_tensor_5 = torch.randn(80, 3, 512, 512).float().to(device) # 80*3*512*512*4/1000/1000 = 251.64M

-

- # 然后释放

- dummy_tensor_4 = dummy_tensor_4.cpu()

- dummy_tensor_2 = dummy_tensor_2.cpu()

- # 这里虽然将上面的显存释放了,但是我们通过Nvidia-smi命令看到显存依然在占用

- torch.cuda.empty_cache()

- # 只有执行完上面这句,显存才会在Nvidia-smi中释放

Pytorch的开发者也对此进行说明了,这部分释放后的显存可以用,只不过不在Nvidia-smi中显示罢了。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/2023面试高手/article/detail/127399

推荐阅读

相关标签