- 1Python 读取PDF、Word文档_python 读取pdf 和word

- 2好用的IDEA插件之Git Commit Template_idea git commit template

- 3Web开发进化史!

- 4wireshark-协议分析【初见】(NBNS协议,SSDP协议、IGMPv2)

- 5python3开发-AI智能联系人管理系统_.python3开发-ai智能联系人管理系统

- 6基于YOLOv7算法的高精度实时水上漂浮物目标检测识别系统(PyTorch+Pyside6+YOLOv7)_yolo水论文

- 7Git上传文件不能超过100M 解决方案_git上传文件大小限制

- 8使用git reset --hard 命令后,怎么再恢复你的数据_add git reset --hard head~1 怎么恢复

- 9Android开发——SQLite数据库(二)android studio创建数据库,进行插入、删除、更新、查询操作_android studio mdatabase.delete

- 10完善我的大津法代码:#include

#include #include #define MAX_GRAY_LEVEL 256 // 图...

1-- 线性神经网络(线性回归)_线性回归神经网络

赞

踩

1.1线性回归

我理解的就是对方程: 根据现有的数据来求解该方程中的w和b。但由于实际问题中的数据x和y并不是都能被这个方程所描述,就像二维的散点图中,不能用一条直线来穿过所有的点,所以我们的目标是要让这条直线能够穿过尽可能多的点,不在该直线上的点也能让它尽可能的离这条直线近。即我们要找到合适的w和b使得计算出来的y'与真实的y误差最小化。

给定训练数据特征X和对应的已知标签y, 线性回归的目标是找到一组权重向量w和偏置b: 当给定从X的同分布中取样的新样本特征时, 这组权重向量和偏置能够使得新样本预测标签的误差尽可能小。

损失函数(loss function)能够量化目标的实际值与预测值之间的差距。 通常会选择非负数作为损失,且数值越小表示损失越小,完美预测时的损失为0。 回归问题中最常用的损失函数是平方误差函数。 当样本i的预测值为y^(i),其相应的真实标签为y(i)时, 平方误差可以定义为以下公式:

由于平方误差函数中的二次方项, 估计值y^(i)和观测值y(i)之间较大的差异将导致更大的损失。为了度量模型在整个数据集上的质量,我们需计算在训练集n个样本上的损失均值(也等价于求和)。

不难看出线性回归的解可以用一个公式简单地表达出来, 这类解叫作解析解(analytical solution)。当无法得到解析解的情况下,我们可以使用梯度下降(gradient descent)的方法, 这种方法几乎可以优化所有深度学习模型, 它通过不断地在损失函数递减的方向上更新参数来降低误差。

在每次需要计算更新的时候随机抽取一小批样本, 这种变体叫做小批量随机梯度下降(minibatch stochastic gradient descent)每次迭代中,我们首先随机抽样一个小批量B, 它是由固定数量的训练样本组成的。 然后,我们计算小批量的平均损失关于模型参数的导数(也可以称为梯度)。 最后,我们将梯度乘以一个预先确定的正数η,并从当前参数的值中减掉。

1.2 实现线性回归

- !pip install git+https://github.com/d2l-ai/d2l-zh@release # installing d2l

- #导入各个模块

- %matplotlib inline

- import random

- import torch

- from d2l import torch as d2l

- import matplotlib.pyplot as plt

-

- #这里我们使用确定好的w、b以及随机的x来生成对应y

- #最后看该经过线性回归计算得到的w和b与实际的w和b是否一致

- def synthetic_data(w,b,num_examples):#根据设置的w和b来得到随机数据x以及对应的y

- X = torch.normal(0, 1, (num_examples, len(w)))

- y = torch.matmul(X, w) + b

- y += torch.normal(0, 0.01, y.shape)#这里为了不让数据完全拟合于线性模型 对y加入噪声

- return X, y.reshape((-1,1))

-

- true_w = torch.tensor([2, -3.4])

- true_b = 4.2

- features, labels = synthetic_data(true_w, true_b, 1000)#得到生成的x以及y

- print('features:', features[0], '\nlable:',labels[0])#这里是检查features, labels的数据是否正常

- #下面是可视化当前的数据 但这里有时候会报错 就不画了

- #d2l.set_figsize()

- #d2l.plt.scatter(features[:, (1)].detach().numpy(), labels.detach().numpy(), 1);

-

-

- def data_iter(batch_size, features, labels):#该函数用来返回固定批量(batch_size大小)的样本数据

- num_examples = len(features)

- indices = list(range(num_examples))

- random.shuffle(indices)#这里将特征的下标打乱 随机小批量中的“随机”

- for i in range(0, num_examples, batch_size):

- batch_indices = torch.tensor(indices[i: min(i+batch_size, num_examples)])

- yield features[batch_indices], labels[batch_indices]#返回数据 一批一批的返回

-

- batch_size = 10

-

- for X, y in data_iter(batch_size, features, labels):#简单的输出看一下 每批量的样本

- print(X, '\n', y)

- break

-

- def linreg(X, w, b):#建立模型

- return torch.matmul(X, w) + b

-

- def squared_loss(y_hat, y):#损失函数

- return (y_hat - y.reshape(y_hat.shape))**2/2

-

- def sgd(params, lr, batch_size):#优化算法

- #并不是所有的操作都需要进行计算图的生成,只是想要网络结果的话就不需要后向传播

- #如果你想通过网络输出的结果去进一步优化网络的话 就需要后向传播了。

- with torch.no_grad():#表明当前计算不需要反向传播,使用之后,强制后边的内容不进行计算图的构建

- for param in params:

- param -= lr * param.grad / batch_size#更新参数 这里÷batch_size是因为前面计算的是小批量的全部损失 而我们是要用平均损失来优化

- param.grad.zero_()

-

- lr = 0.03 #学习率

- num_epochs = 5

- net = linreg

- loss = squared_loss

-

- #这里是随机初始化w和b的值 因为后续会对其进行更新 这里初始值不影响

- w = torch.normal(0, 0.01, size=(2,1), requires_grad=True)#从N~(0,0.01)分布中随机返回大小为2✖1大小的矩阵

- b = torch.zeros(1, requires_grad=True)

-

- for epoch in range(num_epochs):

- for X, y in data_iter(batch_size, features, labels):

- l = loss(net(X, w, b), y)# x和y的小批量损失

- l.sum().backward()

- sgd([w, b], lr, batch_size)#使用优化算法 对w和b进行更新

- with torch.no_grad():

- train_l = loss(net(features, w, b), labels)

- print(f'epoch {epoch+1}, loss {float(train_l.mean()):f}')

-

- #看一下最终结果与最开始设定的w、b的误差

- print(f'w的估计误差: {true_w - w.reshape(true_w.shape)}')

- print(f'b的估计误差: {true_b - b}')

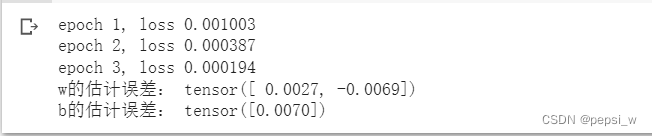

运行结果:

1.3 简洁实现

- !pip install git+https://github.com/d2l-ai/d2l-zh@release # installing d2l

-

- import numpy as np

- import torch

- from torch.utils import data

- from d2l import torch as d2l

-

- true_w = torch.tensor([2, -3.4])

- true_b = 4.2

- features, labels = d2l.synthetic_data(true_w, true_b, 1000)#生成数据集

-

- def load_array(data_arrays, batch_size, is_train=True):

- #is_train表示是否希望数据迭代器对象在每个迭代周期内打乱数据。

-

- dataset = data.TensorDataset(*data_arrays)

- return data.DataLoader(dataset, batch_size, shuffle=is_train)

-

- batch_size = 10

- data_iter = load_array((features, labels), batch_size)

- next(iter(data_iter)) #使用next从迭代器中获取第一项

-

- from torch import nn

- #定义模型

- net = nn.Sequential(nn.Linear(2, 1))

-

- net[0].weight.data.normal_(0, 0.01)#张量a,那么a.normal_()就表示用标准正态分布填充a

- net[0].bias.data.fill_(0)# b.fill_(0)就表示用0填充b

-

- loss = nn.MSELoss()

- trainer = torch.optim.SGD(net.parameters(), lr=0.003)

-

- num_epochs = 3

- for epoch in range(num_epochs):

- for X, y in data_iter:

- l = loss(net(X), y)

- trainer.zero_grad()

- l.backward()

- trainer.step()

- l = loss(net(features), labels)

- print(f'epoch {epoch + 1}, loss {l:f}')

-

- w = net[0].weight.data

- print('w的估计误差:', true_w - w.reshape(true_w.shape))

- b = net[0].bias.data

- print('b的估计误差:', true_b - b)

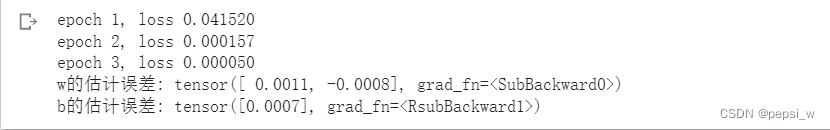

运行结果: