热门标签

热门文章

- 1网易区块链,网易区块链赋能赣州脐橙数字藏品,数字指纹解决方案

- 2Classical Maths Books Intro_analysis now

- 3【SpringCloud】6.RabbitMQ消息队列_之前说过,我们现在基于openfeign的调用都属于是同步调用,那么这种方式存在哪些问

- 4水资源管理:云计算在水资源管理中的优势

- 5【计算机毕业设计】springboot电子文档交易系统-04928,毕设开题选题+程序定制+论文书写+答辩ppt书写-原创(题目+编号)的定制程序

- 6微信小程序开发——上传图片_微信小程序开发上传图片

- 7大数据笔记-NIFI(第一篇)_apache nifi下载

- 8强化学习方法归纳_基于价值的强化学习方法

- 92024最新算法:河马优化算法(Hippopotamus optimization algorithm,HO)求解23个基准函数,提供MATLAB代码_河马优化算法python

- 10C#(C Sharp)学习笔记_If条件判断语句【五】_c#if判断语句

当前位置: article > 正文

llama_index微调BGE模型

作者:AllinToyou | 2024-05-16 15:32:50

赞

踩

llama_index微调BGE模型

微调模型是为了让模型在特殊领域表现良好,帮助其学习到专业术语等。

本文采用llama_index框架微调BGE模型,跑通整个流程,并学习模型微调的方法。

已开源:https://github.com/stay-leave/enhance_llm

一、环境准备

Linux环境,GPU L20 48G,Python3.8.10。

pip该库即可。

二、数据准备

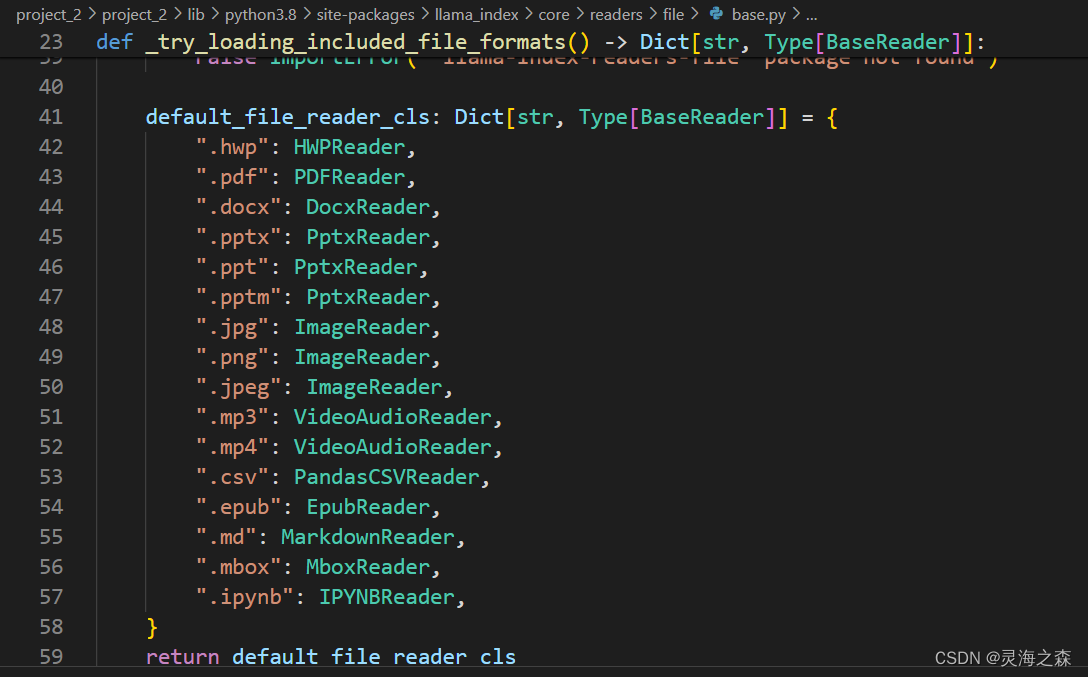

该框架实现了读取各种类型的文件,给的示例就是pdf。

因此准备了一些网络舆情相关的论文pdf,选择70%作为训练数据,剩下作为验证数据。都放在data文件夹下。

三、微调脚本编写

1.读取数据

使用SimpleDirectoryReader类读取文件。

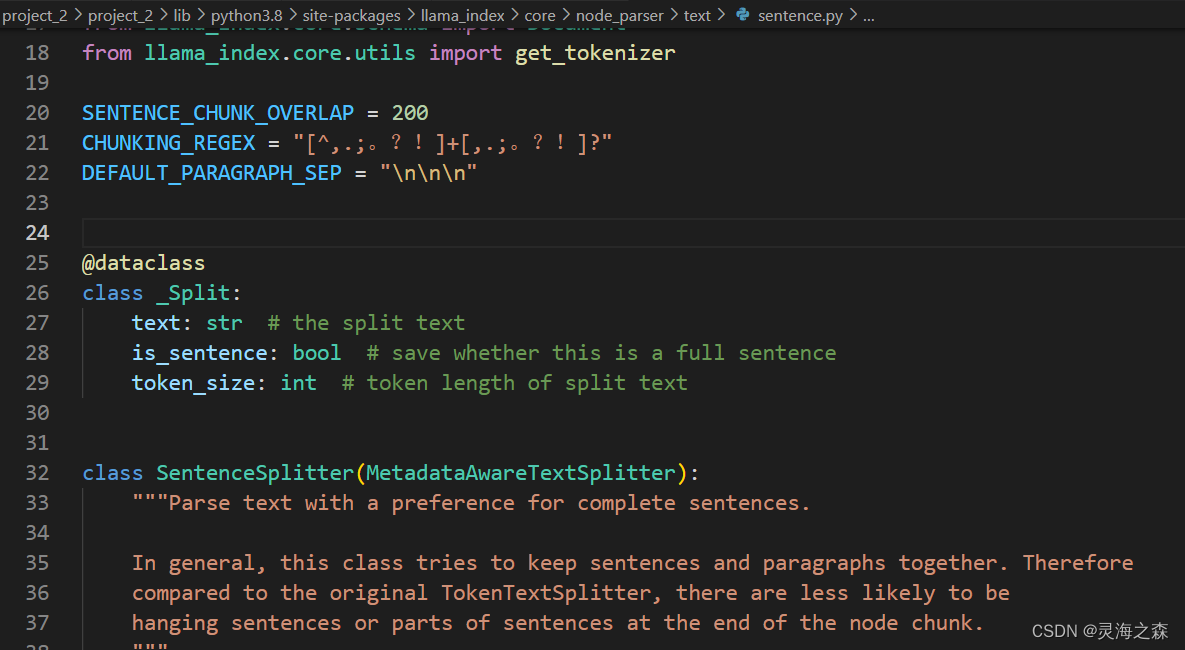

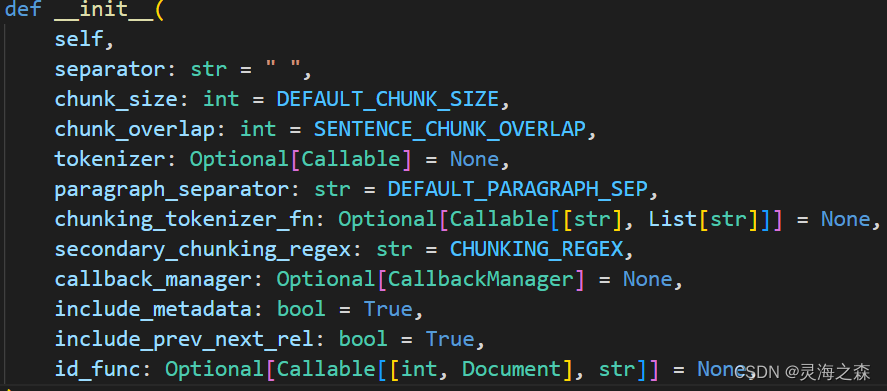

读取到文本后,使用SentenceSplitter将一个很长的文档切分为若干块。

每一块设置的有token数和重叠token数,在

可以自选,默认的chunk_size大小没找到在哪,重叠的是200.

可以自选,默认的chunk_size大小没找到在哪,重叠的是200.

以上是库的源码实现,我们调用是很简单的。VAL_CORPUS_FPATH 我一开始以为是在load_corpus里的某个类自动保存,结果根本没有。所以自己写了导出为json的函数,是将其text数据保存了。

以上是库的源码实现,我们调用是很简单的。VAL_CORPUS_FPATH 我一开始以为是在load_corpus里的某个类自动保存,结果根本没有。所以自己写了导出为json的函数,是将其text数据保存了。

# 源文件 列表 my_list = [i for i in os.listdir('project_2/data') if i.endswith('pdf')] # 随机抽取70%的数据,作为训练集 random.shuffle(my_list) # 打乱 num_to_sample = int(len(my_list) * 0.7) # 阈值 # 构造本地文件路径 training_set = [f"project_2/data/{ file}" for file in my_list[:num_to_sample]] # 训练集文件list validation_set = [f"project_2/data/{ file}" for file in my_list[num_to_sample:]] # 验证集文件list # 最终形成的训练和验证语料 TRAIN_CORPUS_FPATH = 'project_2/data/corpus/train_corpus.json' VAL_CORPUS_FPATH = 'project_2/data/corpus/val_corpus.json' # 读取pdf数据,节点 def load_corpus(files, verbose=False): if verbose: print(f"正在加载文件 { files}") reader = SimpleDirectoryReader(input_files=files) docs = reader.load_data() if verbose: print(f"已加载 { len(docs)} 个文档") parser = SentenceSplitter() nodes = parser.get_nodes_from_documents(docs, show_progress=verbose) if verbose: print(f"已解析

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/AllinToyou/article/detail/579442

推荐阅读

相关标签