- 1Node-导入导出/npm/包/Express - 框架/同源策略/解决跨域_npm时候ecmascript导入

- 2(Unity)UI上的轮转图(3D效果)_unity3d中ui弧形轮番旋转(ui 3d旋转)

- 3matlab中关于双重积分的问题_matlab求复杂函数的二重积分

- 4浅谈——触发器

- 52024年Go最新使用Golang Web3库进行区块链开发_go语言有web3库吗,2024年最新金九银十正确打开方式

- 6python用pd.read_csv()方法来读取csv文件_pd 读csv

- 7智能自助终端主板RK3288/RK3568在酒店前台自助机方案的应用,支持鸿蒙,支持免费定制

- 8vue3+vite 代码混淆插件_rollup-plugin-obfuscator

- 9如何删除Git本地仓库和删除GitHub上的Git远程仓库Repository_本地git仓库远程地址删除

- 10GIT error: You have not concluded your merge (MERGE_HEAD exists)_git : you have not concluded your merge ( merge he

hadoop HA高可用集群实战_hadoop高可用集群

赞

踩

1 概述

- HA(high available),即高可用(24h不中断服务)

- 实现高可用最关键的策略是消除单点故障。HA严格来说是应该分成各个组件的HA机制

- hadoop2.0之前,在HDFS集群中NamNode存在单点故障(SPOF)

- NameNode主要存在以下两个方敏影响HDFS集群。

- NameNode机器发生意外,如宕机,集群无法使用,直到管理员重启。

- NameNode机器需要升级,包括软件,硬件升级,此时集群也将无法使用。

HDFS HA功能通过配置Active/Standby两个nameNode实现在集群中对NameNode的热备份来解决上述问题。如果机器出现故障,这是可通过此种方式将NameNode很快切换到另一台机器。

2 HDFS-HA工作机制

通过双NameNode消除单点故障

2.1 HDFS-HA工作要点

1、元数据管理方式需要改变

- 内存中各自保存一份元数据;

- Edits日志只有Active状态的NameNode节点可以做写操作。

- 两个NameNode都可以读取Edits

- 共享的Edit放在一个共享存储中管理(qjournal和NFS两个主流实现)

2、需要一个状态管理功能模块

- 实现了一个zkfailover,常驻在每一个namenode所在的节点,每一个zkfailover负责监控自己所在NameNode节点,利用zk进行状态表示,当需要进行装填切换时,由zkfaiover来负责切换,切换时需要防止brain split想想发生。

3、必须保证两个 NameNode 之间能欧ssh无密码登录

4、隔离(Fence),即同一时刻仅仅有一个 NameNode对外提供服务。

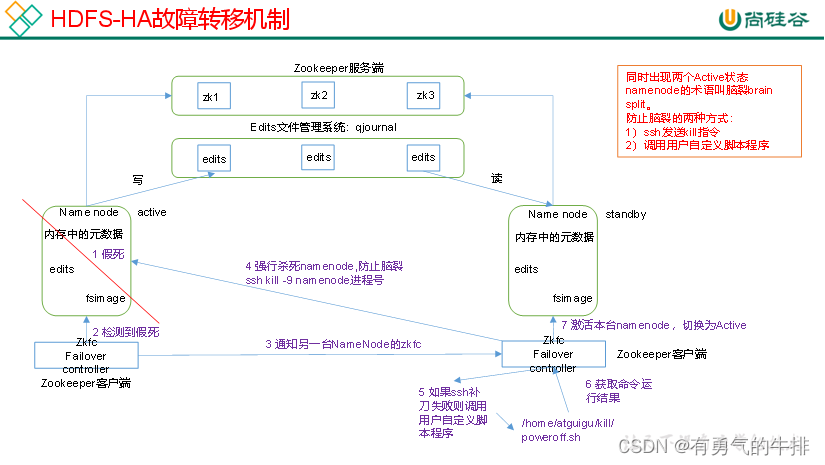

2.2 HDFS 自动故障转移工作

通过命令 hdfs haadmin -failover 进行手动故障转移的模式下,即使现役 NameNode已经失效,系统也不会自动从现役 NameNode转移到待机NameNode,因而下面介绍自动故障转移。

自动故障颛臾为HDFS部署增加了两个新组件:

- ZooKeeper进程

- ZKFailoverController(ZKFC)进程

其中ZK负责维护少量协调数据,通知客户端这些数据的改变和客户端故障的高可用服务。HA的自动故障转移依赖于ZK以下功能:

1、故障检测

集群中每个 NameNode 在Zookeeper 中维护了一个持久回话,如果机器崩溃,ZK中的会话将终止,ZK通知另一个NameNode需要除法故障转移。

2、现役 NameNode选择

ZooKeeper提供了一个简单的机制用于唯一的选择一个节点为 active 状态。如果目前现役 NameNode崩溃,另一个节点可能从 ZK获得特殊的排外锁,以表名它应该称为现役 NameNode。

ZKFC是自动故障转移中的另一个新组建,是ZK的客户端,也监视和管理 NameNode的装填

3、健康检测

ZKFC使用一个健康检查命令定期地ping与之在相同主机的NameNode,只要该NameNode及时回复健康状态,ZKFC认为该节点是健康的。如果该节点崩溃、冻结或进入不健康状态,健康检测器标识该节点为非健康的。

4、ZooKeeper会话管理

当本地NameNode是将康的,ZKFC保持一个在ZooKeeper中打开的会话。如果本地NameNode处于active状态,ZKFC也保持一个特殊的znode锁,该锁使用了ZooKeeper对对该节点的支持,如果会话终止,锁节点将自动删除。

5、基于 ZooKeeper的选择

如果本地 NameNode是健康的,且ZKFC发现没有其他节点持有znode锁,它将为自己获取该锁。如果成功,则它已经赢得了选择,并负责运行故障转移进程以使它的本地 NameNode为Active。故障转移进程与前面描述的手动付账转移相似,首先如果必要保护之前的嫌疑NameNode,然后本地NameNode转换为Active状态。

3 HDFS-HA集群配置

3.1 环境准备

-

映射主机ip、 安装jdk、ssh免密、防火墙(按具体情况配置,安全第一)

-

搭建 ZooKeeper集群

3.2 搭建ZooKeeper集群

详细请阅读ZK秘籍8.2节:古传送阵

启动

$ZK_HOME/bin/zkServer.sh start $ZK_HOME/conf/zoo.cfg

- 1

3.3 配置 HDFS-HA集群

3.3.1 配置环境

# hadoop-HA

export $HADOOP_HA_HOME=/usr/local/hadoop-HA/hadoop-2.8.4

export PATH=$PATH:$HADOOP_HA_HOME/bin:$HADOOP_HA_HOME/sbin

# hadoop

#export HADOOP_HOME=/usr/local/hadoop-2.8.4

#export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

- 1

- 2

- 3

- 4

- 5

- 6

- 7

vim $HADOOP_HA_HOME/etc/hadoop/hadoop-env.sh

- 1

export JAVA_HOME=/usr/local/jdk1.8.0_151

export HADOOP_CONF_DIR=/usr/local/hadoop-HA/hadoop-2.8.4/etc/hadoop

- 1

- 2

- 3

scp -r $HADOOP_HA_HOME/etc/hadoop/hadoop-env.sh root@slave1:$HADOOP_HA_HOME/etc/hadoop/

scp -r $HADOOP_HA_HOME/etc/hadoop/hadoop-env.sh root@slave2:$HADOOP_HA_HOME/etc/hadoop/

- 1

- 2

- 3

3.3.2 配置core-site.xml

mkdir /usr/local/hadoop-HA/data

- 1

vim $HADOOP_HA_HOME/etc/hadoop/core-site.xml

- 1

<configuration>

<!-- 把两个 NameNode 的地址组装成一个集群 mycluster -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://mycluster</value>

</property>

<!-- 指定 hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/hadoop-HA/data</value>

</property>

</configuration>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

3.3.3 配置 hdfs-site.xml

NameNode:master、slave1

DataNode:master、slave1、slave2

mkdir /usr/local/hadoop-HA/data/jn

- 1

vim $HADOOP_HA_HOME/etc/hadoop/hdfs-site.xml

- 1

<configuration>

<!-- 完全分布式集群名称 -->

<property>

<name>dfs.nameservices</name>

<value>mycluster</value>

</property>

<!-- 集群中 NameNode节点都有哪些 -->

<property>

<name>dfs.ha.namenodes.mycluster</name>

<value>nn1,nn2</value>

</property>

<!-- nn1的 RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.mycluster.nn1</name>

<value>master:9000</value>

</property>

<!-- nn2的 RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.mycluster.nn2</name>

<value>slave1:9000</value>

</property>

<!-- nn1的 http 通信地址 -->

<property>

<name>dfs.namenode.http-address.mycluster.nn1</name>

<value>master:50070</value>

</property>

<!-- nn2的 http 通信地址 -->

<property>

<name>dfs.namenode.http-address.mycluster.nn2</name>

<value>slave1:50070</value>

</property>

<!-- 指定 NameNode元数据在 JournalNode上的存放位置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://master:8485;slave1:8485;slave2:8485/mycluster</value>

</property>

<!-- 配置隔离机制,即同一时刻只能有一台服务器对外响应 -->

<property>

<name>dfs.ha.fencing.methods</name>

<value>sshfence</value>

</property>

<!-- 使用隔离机制时需要 ssh无秘钥登录-->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>~/.ssh/id_rsa</value>

</property>

<!-- 声明 journalnode 服务器存储目录-->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/usr/local/hadoop-HA/data/jn</value>

</property>

<!-- 关闭权限检查-->

<property>

<name>dfs.permissions.enable</name>

<value>false</value>

</property>

<!-- 访问代理类:client,mycluster,active配置失败自动切换实现方式-->

<property>

<name>dfs.client.failover.proxy.provider.mycluster</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

</configuration>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

配置发送到其他机器

scp -r /usr/local/hadoop-HA/ root@slave1:/usr/local/

scp -r /usr/local/hadoop-HA/ root@slave2:/usr/local/

- 1

- 2

3.3.4 启动 HDFS-HA集群

在各个JournalNode节点商,输入以下命令启动journalnode服务

1、在各个 JournalNode 节点上,输入以下命令启动 journalnode 服务

$HADOOP_HA_HOME/sbin/hadoop-daemon.sh start journalnode

- 1

2、在[nn1]上,对其进行格式化,并启动

# 格式化

$HADOOP_HA_HOME/bin/hdfs namenode -format

- 1

- 2

$HADOOP_HA_HOME/sbin/hadoop-daemon.sh start namenode

- 1

3、在[nn2]上,同步nn1的元数据信息

$HADOOP_HA_HOME/bin/hdfs namenode -bootstrapStandby

- 1

4、启动[nn2]

$HADOOP_HA_HOME/sbin/hadoop-daemon.sh start namenode

- 1

5、查看web页面(此时2个NameNode均为standby状态)

http://192.168.56.20:50070

http://192.168.56.21:50070

- 1

- 2

6、在 [nn1] 上,启动所有 datanode

# 配置节点域名

vim $HADOOP_HA_HOME/etc/hadoop/slaves

master

slave1

slave2

- 1

- 2

- 3

- 4

- 5

$HADOOP_HA_HOME/sbin/hadoop-daemons.sh start datanode

- 1

7、将 [nn1] 切换为 Active

$HADOOP_HA_HOME/bin/hdfs haadmin -transitionToActive nn1

- 1

8、查看是否Active

$HADOOP_HA_HOME/bin/hdfs haadmin -getServiceState nn1

- 1

3.3.5 配置 HDFS-HA自动故障转移

1 具体配置

在hdfs-site.xml 增加

vim $HADOOP_HA_HOME/etc/hadoop/hdfs-site.xml

- 1

<!-- 配置 HDFS-HA自动故障转移 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

- 1

- 2

- 3

- 4

- 5

在core-site.xml 增加

vim $HADOOP_HA_HOME/etc/hadoop/core-site.xml

- 1

<!-- 配置 HDFS-HA自动故障转移 -->

<property>

<name>ha.zookeeper.quorum</name>

<value>master:2181,slave1:2181,slave2:2181</value>

</property>

- 1

- 2

- 3

- 4

- 5

2 同步配置

scp -r $HADOOP_HA_HOME/etc/hadoop/hdfs-site.xml root@slave1:$HADOOP_HA_HOME/etc/hadoop/

scp -r $HADOOP_HA_HOME/etc/hadoop/core-site.xml root@slave1:$HADOOP_HA_HOME/etc/hadoop/

- 1

- 2

3 启动

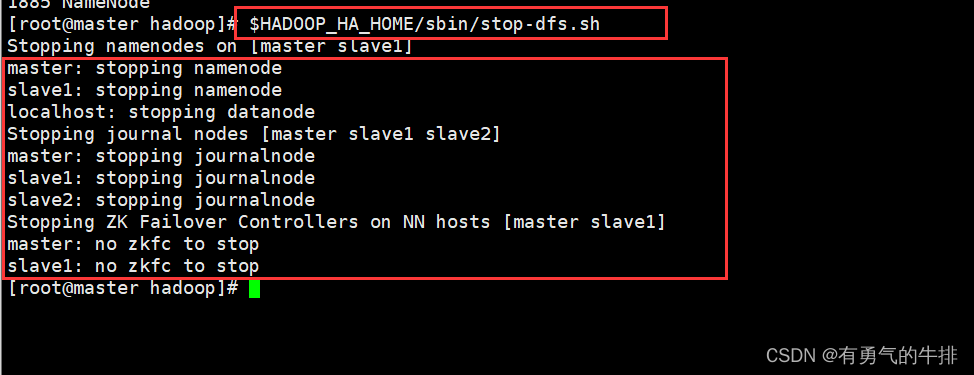

1、关闭所有 HDFS服务

$HADOOP_HA_HOME/sbin/stop-dfs.sh

- 1

2、启动 ZooKeeper集群

$ZK_HOME/bin/zkServer.sh start $ZK_HOME/conf/zoo.cfg

- 1

3、初始化 HA 在 ZooKeeper 中状态(NameNode节点)

$HADOOP_HA_HOME/bin/hdfs zkfc -formatZK

- 1

4、启动 HDFS 服务

$HADOOP_HA_HOME/sbin/start-dfs.sh

- 1

5、在各个 NameNode节点上启动 DFSZK Failover Controller,先在哪台机器启动,哪个机器的 NameNode就是Active NameNode

$HADOOP_HA_HOME/sbin/hadoop-daemon.sh start zkfc

- 1

4 验证

1、将 Active NameNode 进程 kill

kill -9 (namenode进程id)

- 1

2、恢复NameNode

$HADOOP_HA_HOME/sbin/hadoop-daemon.sh start namenode

- 1

5 其他处理

1、Standby所在的namenode不会自动切换为active状态。

检查服务器时间是否同步,同步需要在root用户下。

hdfs namenode -initializeSharedEdits

- 1

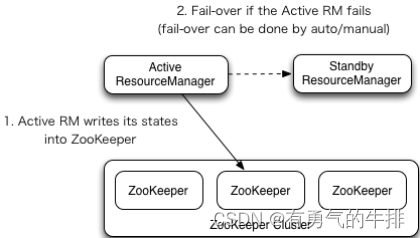

3.4 YARN-HA配置

工作机制

3.4.1 yarn-site.xml

vim $HADOOP_HA_HOME/etc/hadoop/yarn-site.xml

- 1

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!--启用 resourcemanager ha-->

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!--声明两台 resourcemanager 的地址-->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>cluster-yarn1</value>

</property>

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>master</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>slave1</value>

</property>

<!--指定 zookeeper 集群的地址-->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>master:2181,slave1:2181,slave2:2181</value>

</property>

<!--启用自动恢复-->

<property>

<name>yarn.resourcemanager.recovery.enabled</name>

<value>true</value>

</property>

<!--指定 resourcemanager 的状态信息存储在 zookeeper集群-->

<property>

<name>yarn.resourcemanager.store.class</name>

<value>org.apache.hadoop.yarn.server.resourcemanager.recovery.ZKRMStateStore</value>

</property>

</configuration>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

同步更新其他节点的配置信息

scp -r $HADOOP_HA_HOME/etc/hadoop/yarn-site.xml root@slave1:$HADOOP_HA_HOME/etc/hadoop/

scp -r $HADOOP_HA_HOME/etc/hadoop/yarn-site.xml root@slave2:$HADOOP_HA_HOME/etc/hadoop/

- 1

- 2

- 3

- 4

3.4.2 启动hdfs

1、关闭所有 HDFS服务

$HADOOP_HA_HOME/sbin/stop-dfs.sh

- 1

1、在各个 JournalNode节点上,输入以下命令启动 journalnode服务:

$HADOOP_HA_HOME/sbin/hadoop-daemon.sh start journalnode

- 1

2、在 [nn1] 上,对其进行格式化,并启动

$HADOOP_HA_HOME/bin/hdfs namenode -format

$HADOOP_HA_HOME/sbin/hadoop-daemon.sh start namenode

- 1

- 2

3、在 [nn2] 上,同步 nn1 的元数据信息

$HADOOP_HA_HOME/bin/hdfs namenode -bootstrapStandby

- 1

4、启动 [nn2]

$HADOOP_HA_HOME/sbin/hadoop-daemon.sh start namenode

- 1

5、启动所有 DataNode

$HADOOP_HA_HOME/sbin/hadoop-daemons.sh start datanode

- 1

6、将 [nn1]切换为 Active

$HADOOP_HA_HOME/bin/hdfs haadmin -transitionToActive nn1

- 1

3.4.3 启动 YARN

进程:ResourceManager、NodeManager、NodeManager

$HADOOP_HA_HOME/sbin/start-yarn.sh

- 1

slave2执行(非NameNode节点)

$HADOOP_HA_HOME/sbin/yarn-daemon.sh start resourcemanager

- 1

3、查看服务状态

$HADOOP_HA_HOME/bin/yarn rmadmin -getServiceState rm1

- 1

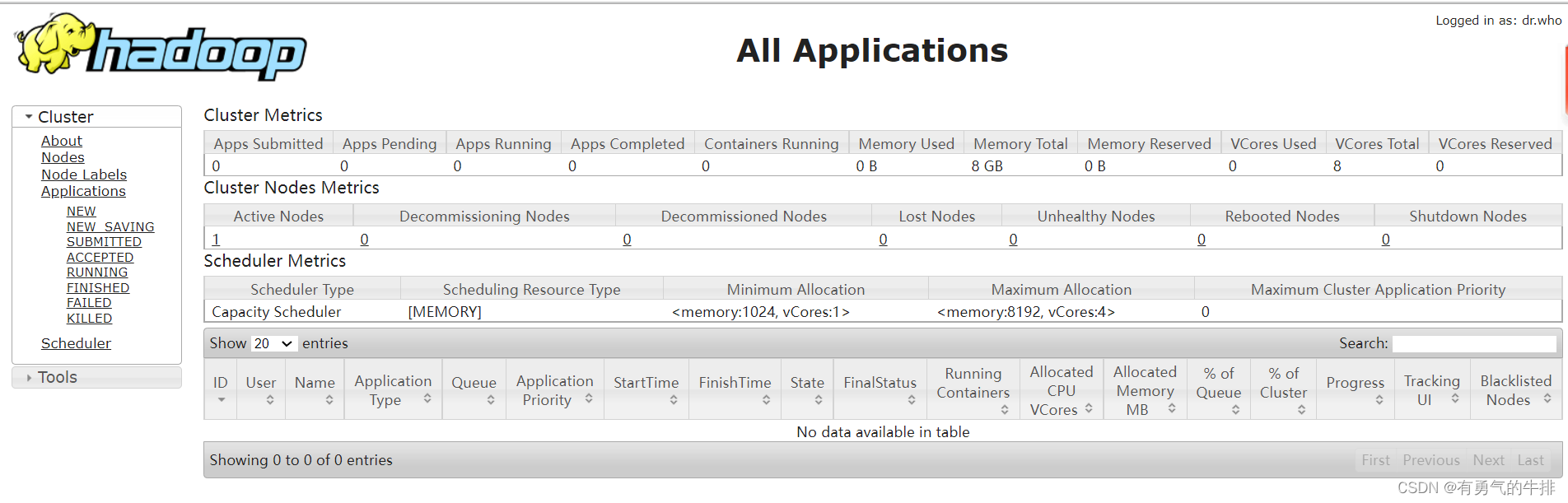

3.5 查看集群

http://192.168.56.20:8088/cluster

- 1

报错处理

重新格式化

1、查看hdfs-site.xml:

<!-- 指定 hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/hadoop-HA/data</value>

</property>

- 1

- 2

- 3

- 4

- 5

将 dfs.name.dir所指定的目录删除、dfs.data.dir所指定的目录删除

rm -rf /usr/local/hadoop-HA/data/dfs/name/*

rm -rf /usr/local/hadoop-HA/data/dfs/data/*

- 1

- 2

2、查看core-site.xml:

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/hadoop-HA/data</value>

<description>namenode上本地的hadoop临时文件夹</description>

</property>

- 1

- 2

- 3

- 4

- 5

将Hadoop.tmp.dir所指定的目录删除。

rm -rf /usr/local/hadoop-HA/data/jn/*

- 1

致谢:

感谢尚硅谷教程