- 1LeetCode算法题解(动态规划、股票买卖)|LeetCode123. 买卖股票的最佳时机 III、LeetCode188. 买卖股票的最佳时机 IV_给你一个整数数组 prices 和一个整数 k ,其中 prices[i] 是某支给定的股票在第 i

- 2mysql存时间戳报错 Out of range value for column ‘create_time‘ at row 1_timestamp out of range

- 3Cause: java.sql.SQLSyntaxErrorException: Unknown column ‘xxxxx‘ in ‘field

- 4【python】零基础从入门到精通(四)

- 5计算机程序文献类别代码,论文参考文献类型代码参考

- 6Vue常用Ui框架App端和Web端_web ui vue

- 7通过串口中断的方式进行ASRPRO模块与STM32通信(问题与解决)_lu-asr01与stm32如何通信

- 8c++ inlineing内联函数不要使用static对象_inline为什么不能用static

- 9Selenium上传图片(python+Selenium+AutoIT)_pythonselenium上传图片

- 10VMware虚拟机下载安装教程【详细步骤 - 图文结合】

使用 Docker 搭建 Hadoop 分布式环境_windows系统docker怎么搭建hadoop框架(3)

赞

踩

该命令执行完成之后使用 docker container ls 命令查看被启动的容器,我们可以看到如下 5 个节点

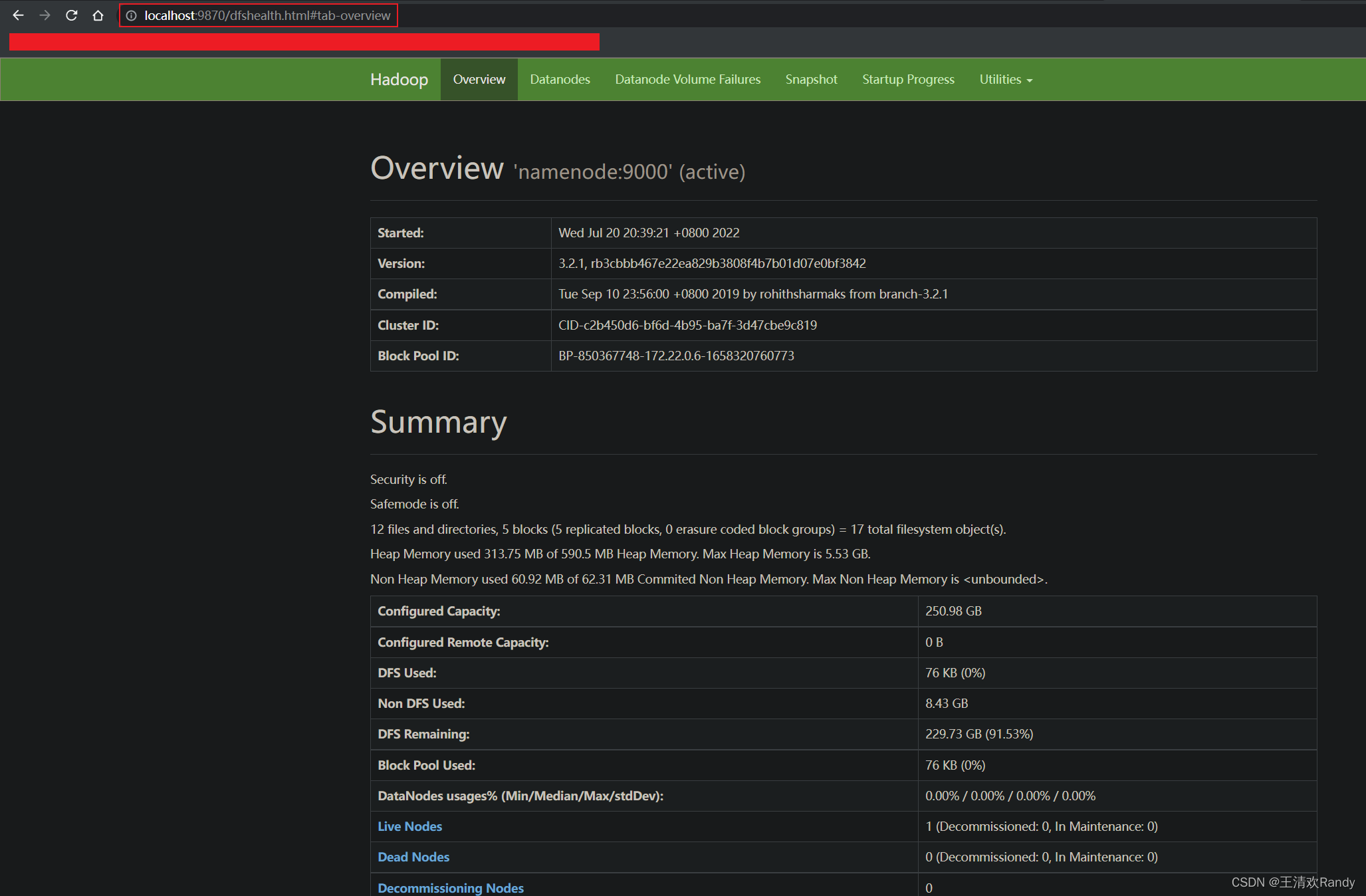

Hadoop 集群被成功启动后,可以通过如下 URL 访问各节点

Namenode: http://<dockerhadoop_IP_address>:9870/dfshealth.html#tab-overview

History server: http://<dockerhadoop_IP_address>:8188/applicationhistory

Datanode: http://<dockerhadoop_IP_address>:9864/

Nodemanager: http://<dockerhadoop_IP_address>:8042/node

Resource manager: http://<dockerhadoop_IP_address>:8088/

- 1

- 2

- 3

- 4

- 5

- 6

通过浏览器访问 Namenode 可以看到如下 Hadoop 集群管理页面

增加数据节点

到这里 Hadoop 集群已经创建完成了,如果想增加节点,可以通过修改 docker-hadoop 中的 docker-compose.yml 文件来实现。

例如,我们给当前集群增加两个数据节点 datanode 对 docker-compose.yml 文件修改如下:

datanode: image: bde2020/hadoop-datanode:2.0.0-hadoop3.2.1-java8 container\_name: datanode restart: always volumes: - hadoop_datanode:/hadoop/dfs/data environment: SERVICE\_PRECONDITION: "namenode:9870" env\_file: - ./hadoop.env datanode2: image: bde2020/hadoop-datanode:2.0.0-hadoop3.2.1-java8 container\_name: datanode2 restart: always volumes: - hadoop_datanode2:/hadoop/dfs/data environment: SERVICE\_PRECONDITION: "namenode:9870" env\_file: - ./hadoop.env datanode3: image: bde2020/hadoop-datanode:2.0.0-hadoop3.2.1-java8 container\_name: datanode3 restart: always volumes: - hadoop_datanode3:/hadoop/dfs/data environment: SERVICE\_PRECONDITION: "namenode:9870" env\_file: - ./hadoop.env

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

然后重新执行 docker-compose up -d 增加节点

03 测试 Hadoop 集群

测试准备

我们使用简单的词频统计 mapreduce 任务来测试 Hadoop 集群

首先下载 hadoop-mapreduce-examples jar 包

然后使用如下命令将这个 jar 包拷贝到 namenode 节点

docker cp .\hadoop-mapreduce-examples-2.7.1.jar namenode:/tmp/

- 1

- 2

然后我们创建一个 input.txt 测试文件,并输入文字内容

We can only go faster, we can only aim higher, we can only become stronger by standing together — in solidarity.

然后也将这个输入文件拷贝到 namenode 节点中

docker cp .\input.txt namenode:/tmp/

- 1

- 2

开始测试

首先使用如下命令进入到 namenode 容器中,并进入到 tmp 目录

docker exec -it namenode /bin/bash

cd tmp/

- 1

- 2

- 3

然后使用如下命令在 HDFS 中创建一个 input 目录

hdfs dfs -mkdir -p /user/root/input

- 1

- 2

将输入文件 input.txt 存储到 HDFS 中

hdfs dfs -put input.txt /user/root/input

# 查看输入文件内容

hdfs dfs -cat /user/root/input/input.txt

- 1

- 2

- 3

- 4

Tips:可以将文件通过如下命令添加到指定的 Datanode 节点中

hdfs dfs -put Input.txt the-datanode-id

最后使用如下命令在 Hadoop 集群中运行 wordcount 词频统计 mapreduce 任务

hadoop jar hadoop-mapreduce-examples-2.7.1.jar wordcount input output

# 查看运行结果

hdfs dfs -cat output/part-r-00000

- 1

- 2

- 3

- 4

输入文字内容的词频统计结果如下所示

We can only go faster, we can only aim higher, we can only become stronger by standing together — in solidarity.

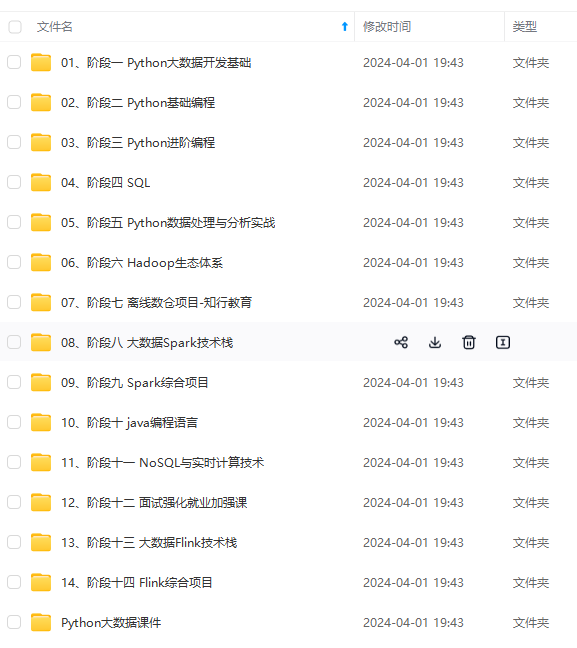

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

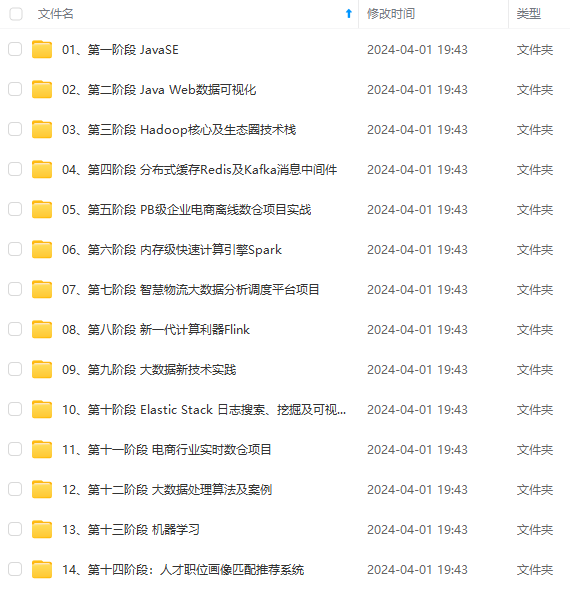

零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新