- 1bootsrap之data-toggle=""_data-toggle=tab

- 2NLP中各种常用数据集_sst-2数据集

- 3iOS:详解MJRefresh刷新加载更多数据的第三方库_ios 无痕加载更多数据

- 4linux无线网卡monitor模式,ubuntu下开启无线网卡的monitor mode

- 5git合并提交记录

- 6Vue3之ElementPlus中Table选中数据的获取与清空方法

- 7Bootstrap警告框、弹出提示层、模态框的js插件效果总结_boostrap警告框使用js调用

- 8送书|“零基础学机器学习”作者创作手记

- 9vscode 日志文件_VS Code 有哪些必不可少的设置项?

- 10巴特沃斯滤波器python_python – 如何使用Scipy.signal.butter实现带通Butterworth滤波器...

两大可商用开源大模型同时发布!性能不输LLaMA,羊驼家族名字都不够用了

赞

踩

梦晨 发自 凹非寺

量子位 | 公众号 QbitAI

从Meta的LLaMA发展出的羊驼家族一系列大模型,已成为开源AI重要力量。

但LLamA开源了又没全开,只能用于研究用途,还得填申请表格等,也一直被业界诟病。

好消息是,两大对标LLaMA的完全开源项目同时有了新进展。

可商用开源大模型来了,还一下来了俩:

MosaicML推出MPT系列模型,其中70亿参数版在性能测试中与LLaMA打个平手。

Together的RedPajama(红睡衣)系列模型,30亿参数版在RTX2070游戏显卡上就能跑。

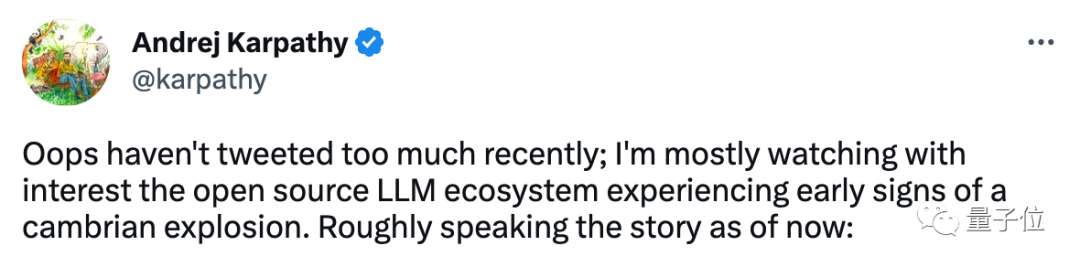

对于这些进展,特斯拉前AI主管Andrej Karpathy认为,开源大模型生态有了寒武纪大爆发的早期迹象。

MPT,与LLaMA五五开

MPT系列模型,全称MosaicML Pretrained Transformer,基础版本为70亿参数。

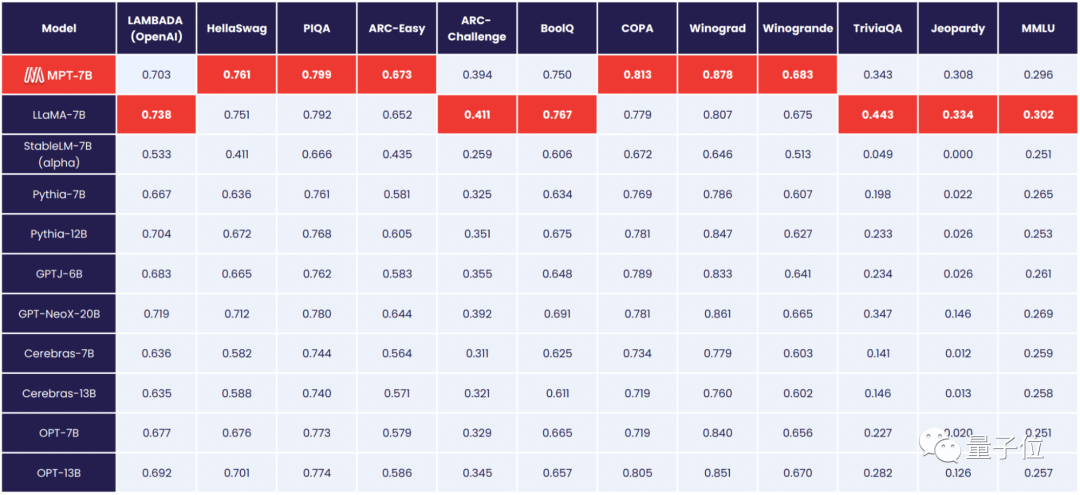

MPT在大量数据(1T tokens)上训练,与LLaMA相当,高于StableLM,Pythia等其他开源模型。

支持84k tokens超长输入,并用FlashAttention和FasterTransformer方法针对训练和推理速度做过优化。

在各类性能评估中,与原版LLaMA不相上下。

除了MPT-7B Base基础模型外还有三个变体。

MPT-7B-Instruct,用于遵循简短指令。

MPT-7B-Chat,用于多轮聊天对话。

MPT-7B-StoryWriter-65k+,用于阅读和编写故事,支持65k tokens的超长上下文,用小说数据集微调。

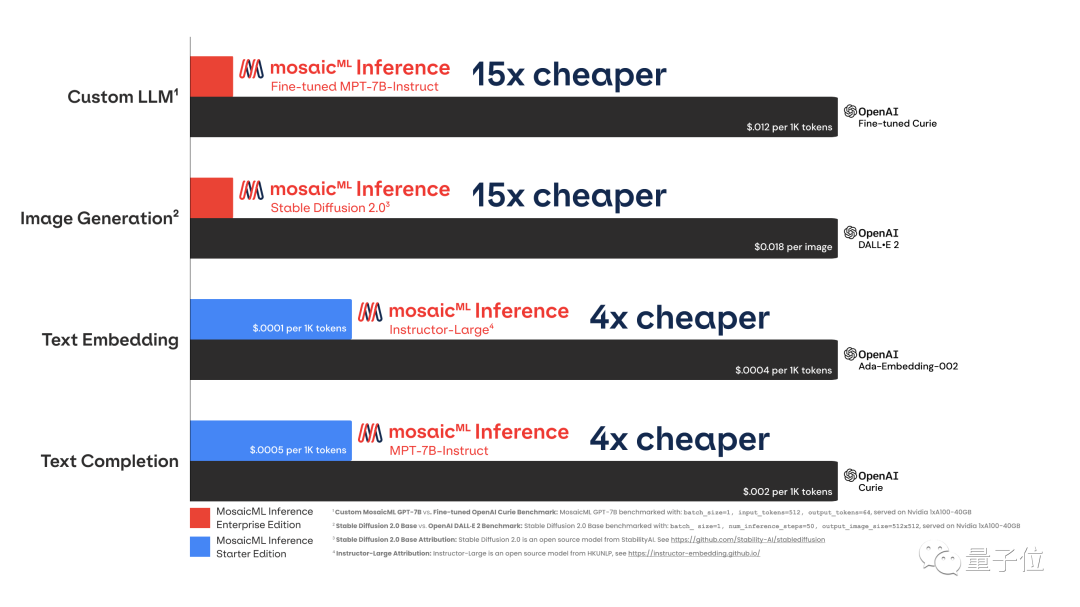

MosaicML由前英特尔AI芯片项目Nervana负责人Naveen Rao创办。

该公司致力于降低训练神经网络的成本,推出的文本和图像生成推理服务成本只有OpenAI的1/15。

RedPajama,2070就能跑

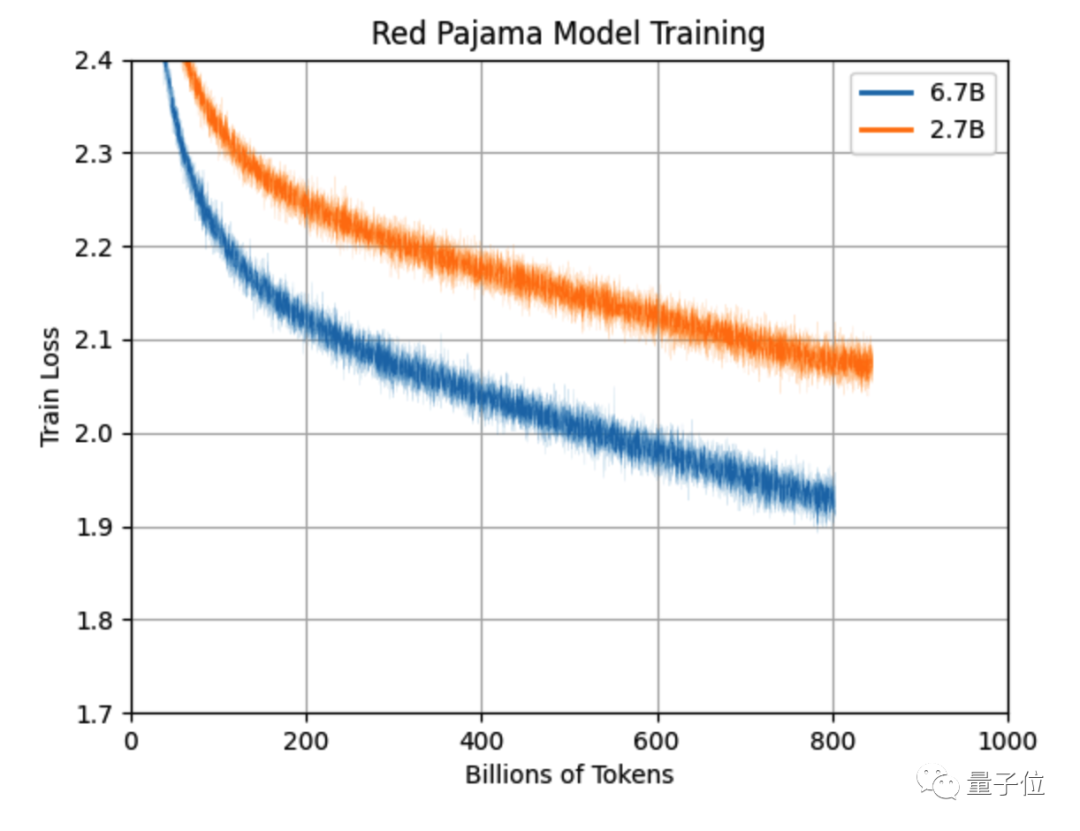

RedPajama系列模型,在5TB的同名开源数据上训练而来(前面提到的MPT也是用此数据集训练)。

除70亿参数基础模型外,还有一个30亿参数版本,可以在5年前发售的RTX2070游戏显卡上运行。

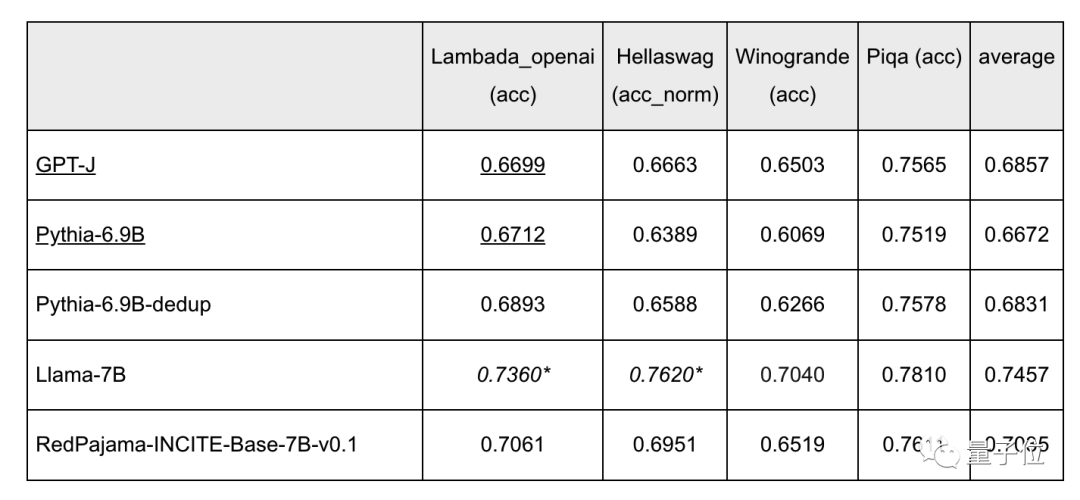

目前70亿版本完成了80%的训练,效果已经超过了同规模的Pythia等开源模型,略逊于LLamA。

预计在完成1T tokens的训练后还能继续改进。

背后公司Together,由苹果前高管Vipul Ved Prakash,斯坦福大模型研究中心主任Percy Liang,苏黎世联邦理工大学助理教授张策等人联合创办。

开源模型发布后,他们的近期目标是继续扩展开源RedPajama数据集到两倍规模。

One More Thing

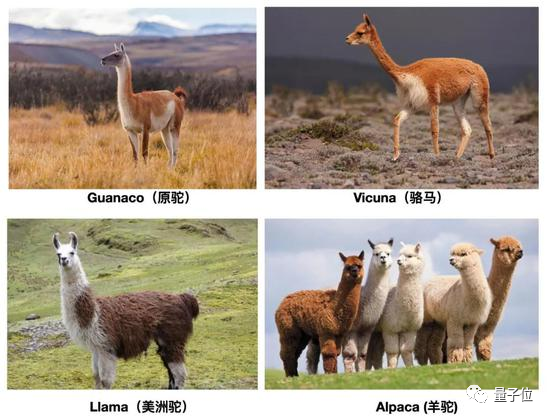

来自南美洲的无峰驼类动物一共4种,已被各家大模型用完了。

Meta发布LLaMA之后,斯坦福用了Alpaca,伯克利等单位用了Alpaca,Joseph Cheung等开发者团队用了Guanaco。

以至于后来者已经卷到了其他相近动物,比如IBM的单峰骆驼Dromedary,Databricks的Dolly来自克隆羊多莉。

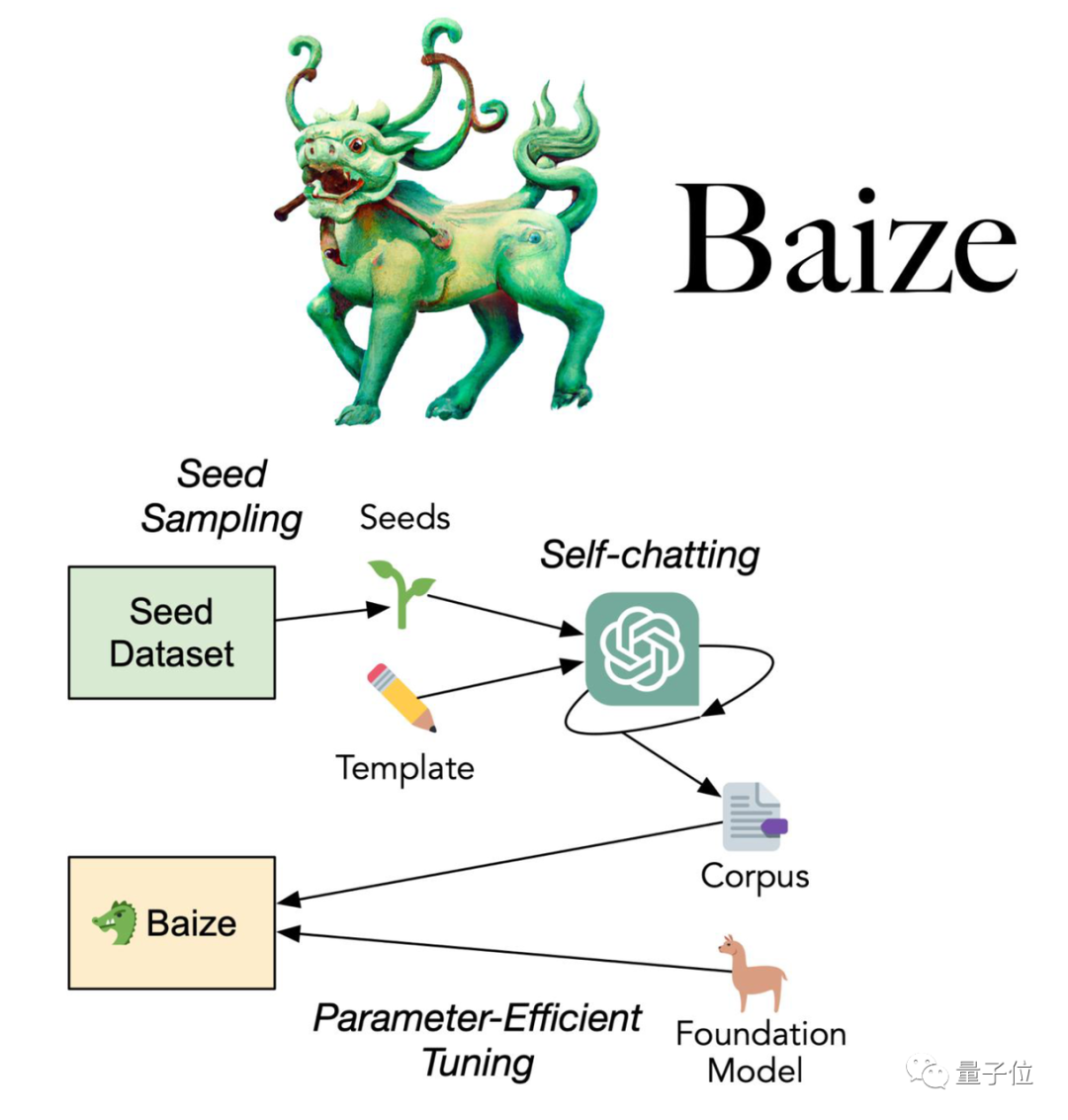

国人研究团队也热衷于用古代传说中的神兽,如UCSD联合中山大学等推出的白泽。

港中文等推出的凤凰……

最绝的是哈工大基于中文医学知识的LLaMA微调模型,命名为华驼。

参考链接:

[1] https://www.mosaicml.com/blog/mpt-7b

[2]https://www.together.xyz/blog/redpajama-models-v1

[3]https://twitter.com/karpathy/status/1654892810590650376?s=20

— 完 —

「人工智能」、「智能汽车」微信社群邀你加入!

欢迎关注人工智能、智能汽车的小伙伴们加入交流群,与AI从业者交流、切磋,不错过最新行业发展&技术进展。

PS. 加好友请务必备注您的姓名-公司-职位噢 ~

点这里

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。