热门标签

热门文章

- 1Android Studio使用Kotlin开发Android入门_android studio 的kotlin

- 2Ollama--本地大语言模型LLM运行专家_ollama 模型

- 3无需租云服务器,Linux本地搭建web服务,并内网穿透发布公网访问_linux apache2 .内网穿透

- 4文本向量表征工具,实现了Word2Vec、RankBM25、Sentence-BERT、CoSENT,开箱即用

- 5IntelliJ IDEA常用插件 提高开发效率_sonarlint 卡顿

- 6缓存踩踏:Facebook史上最严重的宕机事件分析

- 7【网络】gateway 可以提供的一些功能之一 “ 提供web静态资源服务 ”

- 8解决MATLAB显示failed to initialize java

- 9计算机应用技术的历史与现状,浅析计算机应用技术的现状及发展趋势

- 10vue2 el-select 改造成下拉树,支持数据回显_el-tree-select vue 2

当前位置: article > 正文

llama2模型下载

作者:Cpp五条 | 2024-05-07 23:14:48

赞

踩

llama2模型下载

介绍

LLaMA 2-CHAT与OpenAI ChatGPT效果一样好。LLaMA 2与LLaMA 1架构相同,LLaMA 2训练数据是2000000000000个tokens,还是用了1000000个人类新标注的数据。上下文长度由2048提升为4096。

本教程提供两种下载方式:

1官方下载脚本下载

2hugging face网站下载

官网资格申请

https://ai.meta.com/resources/models-and-libraries/llama-downloads/

我申请后秒通过,邮件中会有一个很长的URL。https://download.llamameta.net/ 开头。

方法一:官方脚本下载模型

首先下载下官方代码

https://github.com/facebookresearch/llama

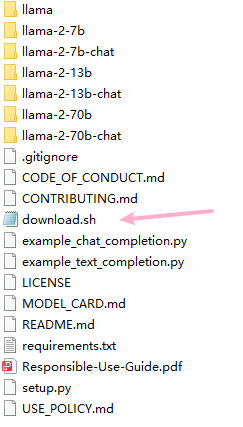

下载后如下图所示,其中有download.sh,就是我们下载模型使用的Linux shell 脚本

在Linux终端中进入llama目录,输入./download.sh

</

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/Cpp五条/article/detail/551728

推荐阅读

相关标签