热门标签

热门文章

- 1java字符串忽略大小写_Java 8忽略大小写排序字符串

- 2大数据技术原理与应用第7讲:MapReduce_mapreduce在map阶段helllo world

- 3虚拟机安装教程(全CSDN最细)

- 4等级保护介绍_等保测评二级系统需要做渗透测试码

- 5案例|以钢铁行业为例,分享区块链在仓储领域的应用实践

- 6芯片后仿_innovus配置tempus

- 7[LLM-Llama]在 MAC M1上体验Llama.cpp和通义千问Qwen 1.5-7B_m1 pro qwen

- 8机器学习_深度学习毕设题目汇总——数据分析_数据挖掘_机器学习论文题目

- 9可用MinGW编译的win32绘图框架_mingw编译win32

- 10入职后的代码拉取及运行:_第一天上班git怎么拉项目

当前位置: article > 正文

海思SD3403,SS928/926,hi3519dv500,hi3516dv500移植yolov7,yolov8(8)_海思ss928 摄像头yolo实时检测

作者:IT小白 | 2024-06-15 22:17:23

赞

踩

海思ss928 摄像头yolo实时检测

配置好环境的虚拟机,需要可私信联系。

| SD3403/SS928/926 SDK环境虚拟机 | 160G 移动硬盘,可直接拷贝到本地VMware直接打开 |

| SD3403/SS928/926 模型转换虚拟机 | 160G 移动硬盘,可直接拷贝到本地VMware直接打开 |

| Hi3516dv500/Hi3519DV500 SDK环境虚拟机 | 160G 移动硬盘,可直接拷贝到本地VMware直接打开 |

| Hi3516dv500/Hi3519DV500 模型转换虚拟机 | 160G 移动硬盘,可直接拷贝到本地VMware直接打开 |

目前为止yolov7算法在海思hi3519dv500.3516dv500下的移植已经说完了,后面开始讲 yolov8的移植。过程基本上是一样的,只是在训练和转换过程中会和yolov7有区别。

本章先说一下训练的部分。

1.库依赖

我这里使用的python3.8

yolov8可以直接通过从PyPI安装ultralytics包

pip install ultralyticsUltralytics requirements里有说明需要哪些环境配置,这里列出来,请仔细对照,建议是手动安装,避免别的应用环境之间有冲突。

- Example: pip install -r requirements.txt

-

- Base ----------------------------------------

-

- matplotlib>=3.3.0

-

- numpy>=1.22.2 # pinned by Snyk to avoid a vulnerability 1.19.5--->1.24.4

-

- opencv-python>=4.6.0

-

- pillow>=7.1.2

-

- pyyaml>=5.3.1

-

- requests>=2.23.0

-

- scipy>=1.4.1

-

- torch>=1.8.0

-

- torchvision>=0.9.0

-

- tqdm>=4.64.0

-

- Logging -------------------------------------

-

- tensorboard>=2.13.0

-

- dvclive>=2.12.0

-

- clearml

-

- comet

-

- Plotting ------------------------------------

-

- pandas>=1.1.4

-

- seaborn>=0.11.0

-

- Export --------------------------------------

-

- coremltools>=7.0 # CoreML export

-

- onnx>=1.12.0 # ONNX export

-

- onnxsim>=0.4.1 # ONNX simplifier

-

- nvidia-pyindex # TensorRT export

-

- nvidia-tensorrt # TensorRT export

-

- scikit-learn==0.19.2 # CoreML quantization

-

- tensorflow>=2.4.1 # TF exports (-cpu, -aarch64, -macos)

-

- tflite-support

-

- tensorflowjs>=3.9.0 # TF.js export

-

- openvino-dev>=2023.0 # OpenVINO export

-

- Extras --------------------------------------

-

- psutil # system utilization 5.9.0

-

- py-cpuinfo # display CPU info none

-

- thop>=0.1.1 # FLOPs computation 0.1.1

-

- ipython # interactive notebook 8.8.0

-

- albumentations>=1.0.3 # training augmentations 1.3.0

-

- pycocotools>=2.0.6 # COCO mAP 2.0.6

-

- roboflow none

这里logging部分和extras部分我都没有装, 如果需要可以自行安装。不影响训练。

2.训练前准备

2.1 数据集准备

按正确的文件夹结构排列您的数据集。您应该有 train/ 和 val/ 顶级目录,在每个目录内,有 images/ 和 labels/ 子目录。

1)数据JPEGIamges和Annotations放置到 data/***/VOCdevkit/VOC2007/ 中

2)两个运行程序放置到data/***/中,修改yolov8_s1_xml2txt.py中的目标类型。

3)运行yolov8_s1_xml2txt.py和yolov8_s2_split_data.py

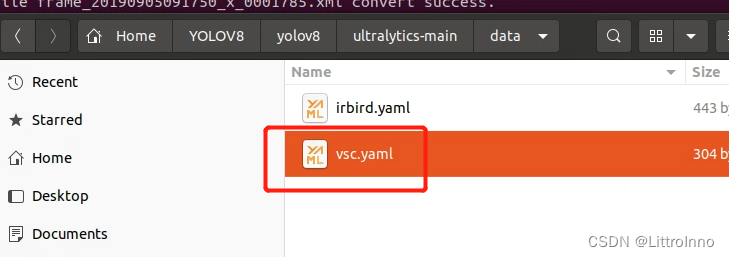

4)数据yaml写到data文件夹下

- train: /home/littro/darknet/data/vsc/images/train # train images

- val: /home/littro/darknet/data/vsc/images/val # val images

- test: /home/littro/darknet/data/vsc/images/test # test images

-

- # Classes

- names: 0: person 1: car

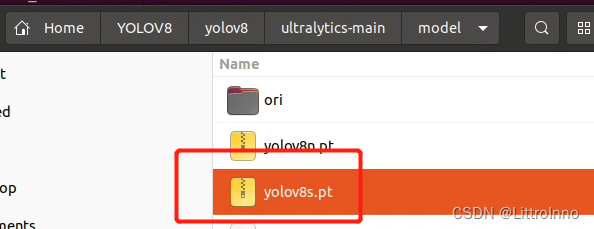

5)模型文件放到model文件夹下,用预训练模型

模型yaml网络文件也放置到这个文件中。

- # Ultralytics YOLO 声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/IT小白/article/detail/724064推荐阅读

相关标签

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。