- 1王道数据结构——线性表和单链表操作_王道数据结构相线性表和链表

- 2使用Flink实现MySQL到Kafka的数据流转换_flink 消费mysql到kafka

- 3天池NLP新闻文本分类学习赛心得-Task2_新闻文本分类项目难吗

- 4专访微软战略安全官裔云天:做好网站安全的纵深防御

- 5Nat. Rev. Genet. | 通过可解释人工智能从深度学习中获得遗传学见解

- 62024年最新猿创征文|我的技术成长之路&;&;C++_c++抽奖程序,2024年最新从零开始学大数据开发编程

- 72024简约唯美的个人引导页源码

- 8Hadoop伪分布式集群搭建_在sbin目录中vim start-dfs.sh

- 9软件测试中年危机?30岁大关?“我“该如何破局...

- 10机器学习-KNN最近邻算法原理及实践_knn算法实验原理

白话深度学习架构入门:循环神经网络(RNN)、生成对抗网络(GAN)、卷积神经网络(CNN)、变换器及编码器-解码器架构_编码器解码器神经网络

赞

踩

每周跟踪AI热点新闻动向和震撼发展 想要探索生成式人工智能的前沿进展吗?订阅我们的简报,深入解析最新的技术突破、实际应用案例和未来的趋势。与全球数同行一同,从行业内部的深度分析和实用指南中受益。不要错过这个机会,成为AI领域的领跑者。点击订阅,与未来同行! 订阅:https://rengongzhineng.io/

循环神经网络(RNN)

循环神经网络(RNNs)是一种旨在处理序列数据的人工神经网络,如时间序列、语音和自然语言。想象RNN像是一条传送带,一次处理一个元素,允许它“记住”前一个元素的信息,以预测下一个元素。

设想你有一个词序列,你希望电脑生成序列中的下一个词。RNN通过一次处理序列中的每个词,并使用前几个词的信息来预测下一个词来工作。

RNN的关键组成部分是循环连接,它允许信息从一个时间步骤流到下一个时间步骤。循环连接是在一个神经元内部的连接,它“记住”了上一个时间步骤的信息。

RNN可以分为三个主要部分:输入层、循环层和输出层。

- 输入层:输入层在每个时间步接收信息,如序列中的一个词。

- 循环层:循环层处理来自输入层的信息,使用循环连接“记住”前几个时间步的信息。循环层包含一组神经元,每个神经元都有一个循环连接到自身和一个连接到当前时间步的输入。

- 输出层:输出层根据循环层处理的信息生成预测。在生成序列中的下一个词的情况下,输出层会预测最有可能跟在前几个词后面的词。

总之,RNN是一种旨在处理序列数据的神经网络类型。它通过一次处理一个元素,使用循环连接“记住”前一个元素的信息。循环层使网络能够处理整个序列,使其非常适合语言翻译、语音识别和时间序列预测等任务。

卷积神经网络(CNN)

卷积神经网络(CNN)是一种旨在处理和分析具有网格状拓扑结构的数据(如图像和视频)的人工神经网络。想象一下,CNN是一个多层过滤器,它处理图像以提取有意义的特征并做出预测。

设想你有一张手写数字的照片,你希望电脑能识别这个数字。CNN通过在图像上应用一系列过滤器,逐渐提取越来越复杂的特征来工作。最初的过滤器检测简单的特征,如边缘和线条,而后期的过滤器则检测更复杂的模式,如形状和数字。

卷积神经网络的层可以分为三种主要类型:卷积层、池化层和全连接层。

- 卷积层:这些层应用称为内核的过滤器到图像上。每个过滤器在图像上滑动,计算过滤器与其覆盖的像素之间的点积。这个过程生成一个新的特征图,突出显示图像中的特定模式。这个过程会用不同的过滤器重复多次,创建一组捕捉图像不同方面的特征图。

- 池化层:池化层对特征图执行下采样操作,减少数据的空间维度,同时保留重要特征。这有助于减少计算复杂性并防止过拟合。最常见的池化类型是最大池化,它从像素的小邻域中选择最大值。

- 全连接层:这些层类似于传统神经网络中的层。它们将一个层中的每个神经元连接到下一个层中的每个神经元。卷积层和池化层的输出被展平并通过一个或多个全连接层,使网络能够做出最终预测,如识别图像中的数字。

总之,CNN是一种旨在处理网格状数据的神经网络类型,如图像。它通过对图像应用一系列过滤器或内核,逐渐提取更复杂的特征。输出然后通过池化层传递以减少空间维度并防止过拟合。最后,输出通过全连接层进行最终预测。

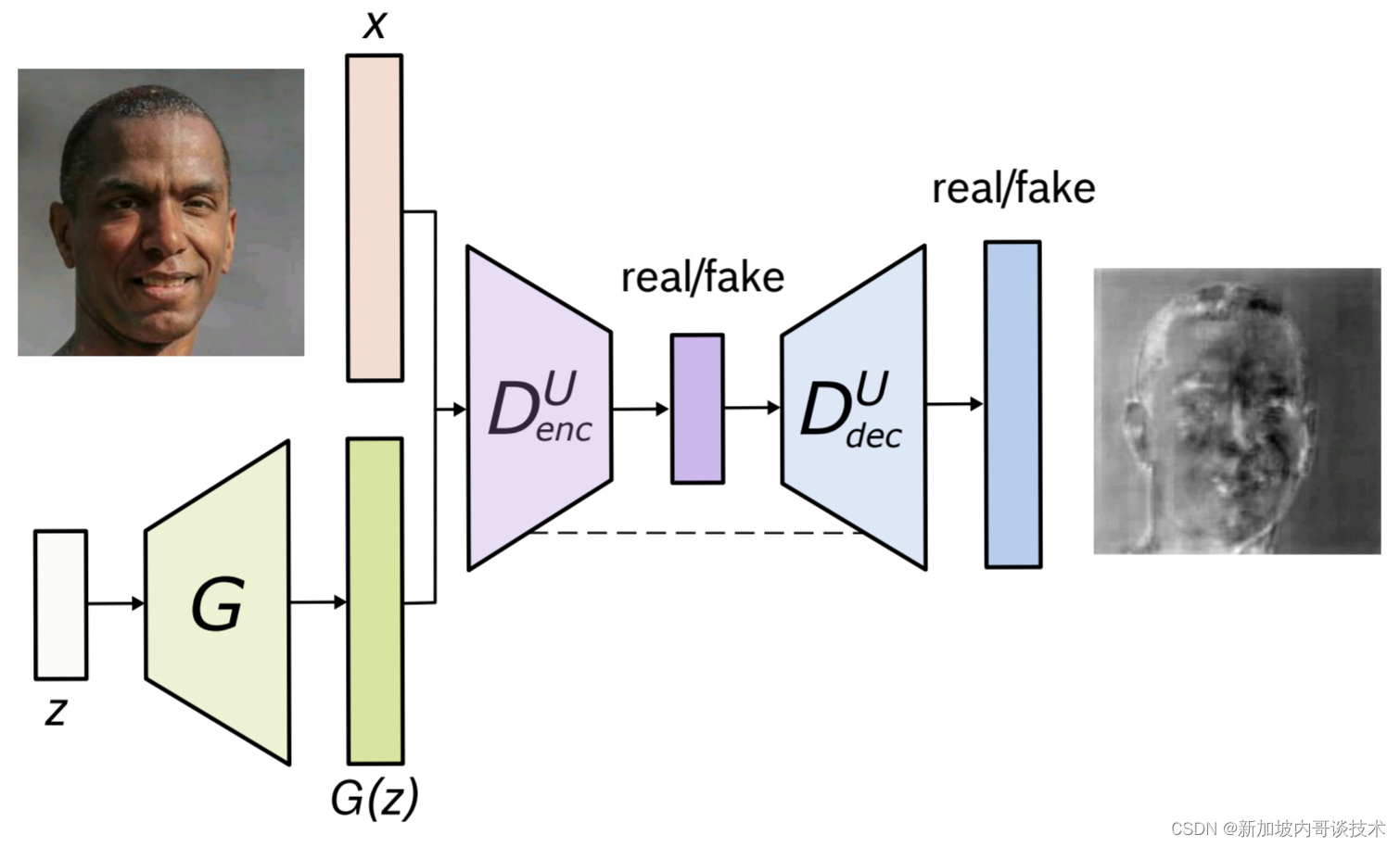

生成对抗网络(GAN)

生成对抗网络(GANs)是一种深度学习架构,使用两个神经网络——生成器和鉴别器——来创造新的、逼真的数据。想象GANs就像两个竞争的艺术家,一个创造假艺术品,另一个试图区分真假。

GANs的目标是在各种领域生成高质量、逼真的数据样本,如图像、音频和文本。生成器网络创造新样本,而鉴别器网络评估生成样本的真实性。这两个网络同时以对抗的方式训练,生成器试图产生更逼真的样本,而鉴别器则变得更擅长检测假冒。

GAN的两个主要组成部分是:

- 生成器:生成器网络负责创建新样本。它以随机噪声向量为输入,并生成输出样本,如图像或句子。生成器通过最小化度量生成样本与真实数据之间差异的损失函数来训练,以产生更逼真的样本。

- 鉴别器:鉴别器网络评估生成样本的真实性。它接受一个样本作为输入,并输出一个概率,表明该样本是真是假。鉴别器通过最大化度量真实样本与生成样本概率之间差异的损失函数来训练,以区分真假样本。

GANs的对抗性质源于生成器和鉴别器之间的竞争。生成器试图产生更逼真的样本以欺骗鉴别器,而鉴别器则试图提高其区分真假样本的能力。这一过程持续进行,直到生成器产生高质量、逼真的数据,这些数据难以与真实数据区分开来。

总之,GANs是一种使用两个神经网络——生成器和鉴别器——来创造新的、逼真的数据的深度学习架构。生成器创建新样本,鉴别器评估它们的真实性。这两个网络以对抗的方式进行训练,生成器产生更逼真的样本,而鉴别器提高其检测假冒的能力。GANs在多个领域都有应用,如图像和视频生成、音乐合成和图文合成。

变换器(Transformers)

变换器是一种在自然语言处理(NLP)任务中广泛使用的神经网络架构,如翻译、文本分类和问答。它们在2017年Vaswani等人的开创性论文《Attention Is All You Need》中首次提出。

想象变换器是一个复杂的语言模型,它通过将文本分解成更小的片段并分析它们之间的关系来处理文本。这个模型然后可以生成对广泛查询的连贯流畅的回应。

变换器由几个重复的模块组成,称为层。每层包含两个主要组成部分:

- 自注意力机制:自注意力机制允许模型分析输入文本的不同部分之间的关系。它通过为输入序列中的每个词分配一个权重来工作,表明它与当前上下文的相关性。这使模型能够关注重要词汇并降低不太相关词汇的重要性。

- 前馈神经网络:前馈神经网络是处理自注意力机制输出的多层感知机。它们负责学习输入文本中词汇之间的复杂关系。

变换器的关键创新是使用自注意力机制,这使得模型能够高效地处理长序列文本,无需昂贵的循环或卷积操作。这使变换器在广泛的NLP任务中计算效率高且效果显著。

简而言之,变换器是一种强大的针对自然语言处理任务设计的神经网络架构。它通过将文本分解成更小的片段并通过自注意力机制分析这些片段之间的关系来处理文本。这使模型能够生成对各种查询的连贯流畅的回应。

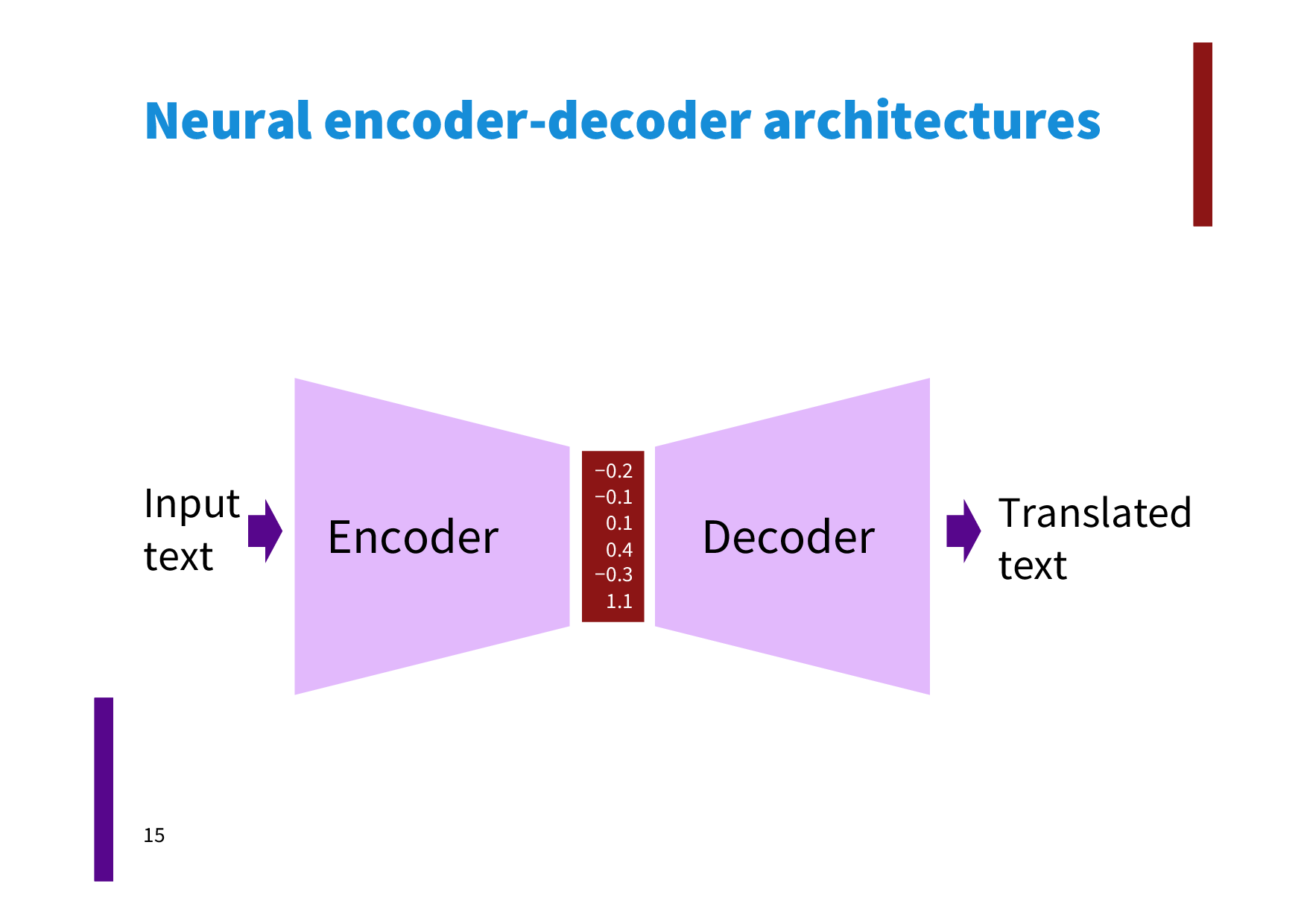

编码器-解码器架构

编码器-解码器架构在自然语言处理(NLP)任务中非常流行。它们通常用于序列到序列的问题,如机器翻译,其目标是将一种语言(源语言)的输入文本转换为另一种语言(目标语言)的对应文本。

想象编码器-解码器架构就像一个翻译者,他听一个人用外语讲话,同时将其翻译成听众的母语。

编码器-解码器架构

这种架构由两个主要组件组成:

- 编码器:编码器接收输入序列(源文本)并顺序处理,生成一个紧凑的表示,通常称为“上下文向量”或“上下文嵌入”。这种表示总结了输入序列并包含关于其语法、语义和上下文的信息。根据具体任务和实现,编码器可以是循环神经网络(RNN)或变换器。

- 解码器:解码器接收编码器生成的上下文向量,并一次生成一个元素的输出序列(目标文本)。解码器通常是循环神经网络或变换器,与编码器类似。它通过基于之前的单词和上下文向量中包含的信息预测目标序列中的下一个单词来生成输出序列。

在训练期间,解码器接收真实的目标序列,其目标是预测序列中的下一个单词。在推断阶段(模型生成响应时),解码器接收到那一点的生成文本,并使用它来预测下一个单词。

总之,编码器-解码器架构是自然语言处理任务中常用的方法,特别适用于机器翻译等序列到序列的问题。这种架构包括一个处理输入序列并生成紧凑表示的编码器,以及一个基于此表示生成输出序列的解码器。这使得模型能够将一种语言的输入文本翻译成另一种语言的对应文本。