- 1MySQL面试篇章——MySQL核心SQL(基本语法)

- 2渗透测试-获取系统FOFA关键字来刷洞_fofa搜漏洞

- 3springboot026基于SpringBoot的在线文档管理系统的设计与实现_springboot 怎么管理 文档和代码

- 4超详细的VSCode下载和安装教程(非常详细)从零基础入门到精通,看完这一篇就够了。_怎么下载vscode

- 5香橙派python编程_香橙派Orange Pi 4开发板在Ubuntu系统下使用python 控制GPIO

- 6centos yum问题 :cannot find a valid baseurl for repo的原因及解决方案_cannot find a valid baseurl for repo:appstream

- 735岁程序员职场危机?为啥美国还有那么多50岁+的老码农。

- 8Hexo+GitHub+Netlify:打造高效个性化博客的完整指南_netlify部署hexo静态网站

- 9eui加载时间长_只需要3招将你的Vue项目访问时间从1分钟缩短到3秒以内

- 10基于人工智能(AI)的蛋白结构预测工具合集

基于依赖性的词嵌入(Dependency-based word embedding)[Part I]_dependency based word embeddings

赞

踩

作者 Omer Levy and Yoav Goldberg (CS department, Bar-Ilan University)

原文地址

摘要

尽管目前连续向量的词嵌入技术逐渐变得热门,然而已有的模型都是只是单单基于线性的上下文环境(context)。本文工作推广了采用 negative-sampling 技术的 skip-gram 模型(由 Mikolov 等人提出)到任意的上下文环境场景。特别地,我们做了基于依赖性的上下文环境,发现获得的嵌入具有非常不同的效果。基于依赖性的词嵌入更加非局部化(topical)并展示了比原始的 skip-gram 更具功能性的相似性。

不同的上下文环境产生了明显的词嵌入结果,并导致不同的词的相似性。特别地,上下文环境的 BOW 本质会促成宽泛的局部相似性,而基于依赖的上下文环境则会产生更加具有功能性的比如说上义词这样的相似性。这个效果从定性和定量的角度都做了介绍。

神经网络词嵌入常常被认为是含糊不清的,因为很难确定导出的表示的维度的真正含义。在第五部分,我们将展示Skip-gram 模型可以做到一些相关的观察,通过查询由一个目标词激活的上下文环境。这就使得我们有了一种了解学到的表示的能力,并通过学习过程发现那些最具区分能力的词(或者词的群组)。据我们所知,这是从未有学者涉足的工作。

在 skip-gram 模型中,每个词

更加准确地说,negative-sampling 的目标假设一个观测值对

其中

该目标函数有一个易见的解就是对每个

为了避免出现这样的一种易见的情形,目标函数被扩展出那些使得

当然也可以写作:

其中

反例

优化这个目标函数使得观测到得词-上下文对有相似的嵌入,对未观测到的对则会分散化。直觉上看,出现在相似的上下文环境中的词应当由相似的嵌入,尽管现在我们还没有对 skipgram 事实上最大化了相似词之间的点乘值进行正式的证明。

任意上下文环境的嵌入

在 Skipgram 嵌入算法中,一个词的上下文环境是这个词周围的词。上下文环境表

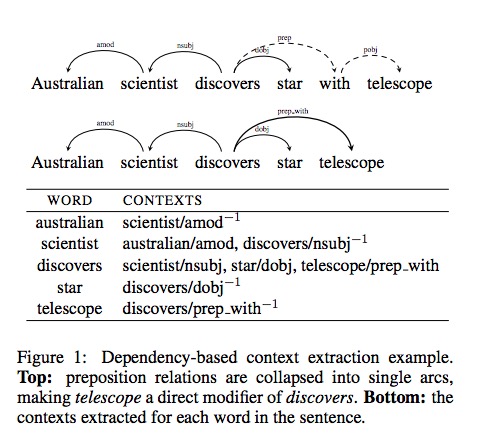

本文工作采用了语法上下文环境进行了实验。语法环境描述了跟BOW环境不同的信息,正如我们在句子“Australian scientist discovers star with telescope.”展示的那样。

Linear BOW contexts

这就是 word2vec 和其他一些神经网络嵌入方法所采用的上下文环境。使用一个大小为

注意大小为

Dependency-Based contexts

BOW之外的一种观点是采用基于参与词的语法关系的上下文环境。我们之前的关于parsing的技术对这个工作有很大的便利。parsing 技术可以用来高速并准确地解析出语法依赖关系。

在对每个句子进行parsing后,我们按照如下的方式导出词的环境:对目标词

Relations that include a preposition are “collapsed” prior to context extraction, by directly connecting the head and the object of the preposition, and subsuming the preposition itself into the dependency label. An example of the dependency context extraction is given in Figure 1.

注意到语法依赖性是比 BOW 更加 inclusive 和 focused的。它们获取了只用小得窗口无法得到的词之间的关系(如 discover 的工具 是 telescope),同样可以过滤出那些偶然的上下文关系(只是位于窗口内,而不是真正直接关联于目标词,如 Australian 不该是用作 discovers 的上下文环境)。另外,上下文环境是有类型的,表示出 stars 是发现的对象且 scientist 是发现主体。所以我们期待语法环境可以得出更加聚焦的嵌入,刻画出更加功能性和准确的相似性。