- 1【华为OD机试真题 C语言】211、最优资源分配、芯片资源占用 | 机试真题+思路参考+代码解析_路灯照明问题华为od

- 2Docker的安装和镜像管理并利用Docker容器实现nginx的负载均衡、动静分离

- 340岁失业了,如何调整自己心态?_失业了我该怎样调整自己

- 4typora+picgo+git实现markdown文档图片在线插入_markdown(typora)中如何插入删除源文件后仍存在的图片?

- 5python用户价值分析_python客户价值分析

- 6[AIGC] 深入了解标准与异常重定向输出

- 7一个简单的自然语言处理例子_自然语言算法举例

- 8Upload-labs 1-21关 靶场通关笔记(含代码审计)_uploadlabs 最新通关攻略

- 9如何一眼分辨是C还是C++_如何看是vc还是tc

- 10论文笔记:Semantic Compositional Networks for Visual Caption_scn lstm rnn

OpenCV 入门(五) —— 人脸识别模型训练与 Windows 下的人脸识别_vs人脸识别训练模型

赞

踩

OpenCV 入门系列:

OpenCV 入门(一)—— OpenCV 基础

OpenCV 入门(二)—— 车牌定位

OpenCV 入门(三)—— 车牌筛选

OpenCV 入门(四)—— 车牌号识别

OpenCV 入门(五)—— 人脸识别模型训练与 Windows 下的人脸识别

OpenCV 入门(六)—— Android 下的人脸识别

OpenCV 入门(七)—— 身份证识别

本文主要内容:

- 如何训练 OpenCV 的人脸识别模型

- 如何在 Windows 下利用 OpenCV 进行人脸识别

1、概述

人脸识别需要人脸模型(特征集合)的支持,人脸定位的速度与准确度取决于模型。

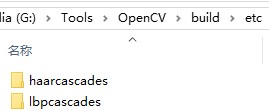

OpenCV 提供了已经训练好的模型,无论是 Windows 版本还是 Android 版本的 SDK,都在 etc 目录下提供了两种级联分类器模型:

“Haarcascades” 和 “Lbpcascades” 都是级联分类器模型,用于目标检测和识别,特别是在人脸检测领域中常被使用:

- Haarcascades 基于 Haar-like 特征(哈尔特征)的级联分类器。Haar-like 特征是一种基于像素差值的特征描述方法,通过计算图像中不同区域的像素值之和的差异,来捕捉图像中的纹理和形状信息。Haarcascades 模型使用了这些特征来构建级联分类器,以在图像中快速检测人脸或其他目标

- Lbpcascades 使用的是局部二值模式(Local Binary Patterns,LBP)特征的级联分类器。LBP 特征是一种描述图像纹理的方法,通过比较像素点与其邻域像素的灰度值,将其转化为二进制编码。Lbpcascades 模型利用这些二进制编码来构建级联分类器,用于目标检测和识别,例如人脸检测

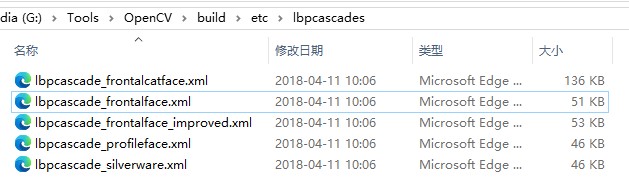

两个文件夹内都提供了多种模型用以识别物体,比如 lbpcascades 文件夹下的 lbpcascade_frontalface.xml 可以用于识别人脸,lbpcascade_frontalcatface.xml 用于识别猫脸:

Windows 版本的 SDK 提供了文档与演示代码,在 opencv\sources\doc\tutorials 目录下,比如 objdetect 就是介绍物体识别的。比如 cascade_classifier.markdown 介绍级联分类器,traincascade.markdown 介绍如何训练模型。当然这些文档都是英文的,如果想查看中文文档,可以去 OpenCV 的中国 Wiki 论坛提供的中文文档,比如级联分类器训练。此外演示代码在 opencv\sources\samples\ 目录下,Android 相关的演示在 android 目录中。

除了使用 OpenCV 提供的级联分类器模型,我们也可以使用 OpenCV 提供的工具自己训练模型,具体的操作方法会在下一节介绍。

编码时 Windows 和 Android SDK 使用的都是 4.1.0 版本。

2、人脸模型训练

OpenCV 识别事务实际上就是对事物进行分类。给 OpenCV 各种样本去学习,使得 OpenCV 学习区分不同类别的事物。以人脸为例,给 OpenCV 的正样本全都是各种人脸,负样本全是与人脸无关的事物,那么 OpenCV 就能识别出什么人脸,什么不是。因此供 OpenCV 学习的样本越多越好。

OpenCV 提供的模型可以识别所有人脸,假如现在有个需求,就是只识别某一个人脸,其他的不识别,该如何实现呢?

这就需要自己训练模型了。假如要求只识别你的人脸,那么在采集图像时,保证摄像头内只有你的脸,通过 OpenCV 识别到人脸,然后将人脸部分转为 24 * 24 的灰度图保存到指定的目录内。用目录内的这些小图片通过 OpenCV 提供的工具进行训练,就可以训练出只识别你的脸的模型。

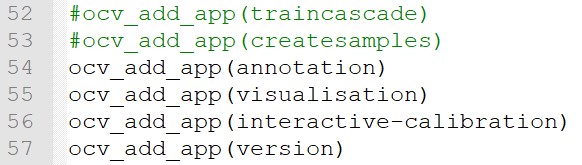

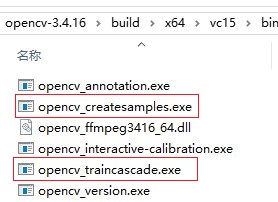

说到 OpenCV 的训练工具,这里要特别说明一下。我们写 Demo 用的是 OpenCV 的 4.1.0 版本,但是在该版本中,训练工具被移除了。在 3.4.X 版本中,这个工具是存在的(如 3.4.6 或 3.4.16 等版本都行):

因此我们需要再下载一个包含训练工具的 OpenCV 版本,然后在 opencv\build\x64\vc15\bin 目录下找到 opencv_createsamples.exe 和 opencv_traincascade.exe 工具,可以将目录添加到环境变量中。

稍微提一下为什么 OpenCV 4.X 版本中移除了训练工具。早期的 OpenCV 提供了 C 和 C++ 两种风格的 API。比如 C 风格的 CvMat、CvVideoCapture,而 C++ 风格 API 对应的就是 Mat、VideoCapture。

从 4.X 版本开始,OpenCV 移除了 C 风格的 API,而训练工具是用 C 写的,因此在源码 /opencv410/sources/app 目录下的 CMakeLists.txt 文件中,你能看到生成两个训练工具的代码被注释掉了:

即便打开注释也无法编译出这两个训练工具,因为 C 的源码已经被移除了,所以才需要再下载一个带有训练工具的 3.4.X 版本,这也是 OpenCV 官方给出的解决方案。

2.1 训练步骤

训练模型需要正样本和负样本:

- 正样本就是与目标模型相关性强的。比如训练只识别你的人脸的模型,那么前面收集的人脸灰度图就是正样本

- 负样本就是与目标模型相关性弱的,甚至没有相关性的。比如训练人脸识别模型,那么负样本就可以是风景图等等

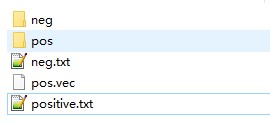

我们将正样本存入 pos 目录,将负样本存入 neg 目录,然后再创建正样本和负样本的描述文件 positive.txt 和 neg.txt:

样本描述文件格式为文件名、人脸数量、每个人脸的起始坐标与宽高范围:

2 个人脸分别为 (100,200) 处为左上角,宽高为 50x50 的范围和 (50,30) 处为左上角,宽高为 25x25 的范围

pos/1.jpg 2 100 200 50 50 50 30 25 25

- 1

- 2

按照上述格式,我们的正样本可以写为:

pos/0.jpg 1 0 0 24 24

pos/1.jpg 1 0 0 24 24

pos/2.jpg 1 0 0 24 24

pos/3.jpg 1 0 0 24 24

pos/4.jpg 1 0 0 24 24

pos/5.jpg 1 0 0 24 24

pos/6.jpg 1 0 0 24 24

中间省略...

pos/61.jpg 1 0 0 24 24

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

负样本也是类似的操作。当然需要注意正负样本的比例最好是 1:3,比如正样本有 100 个,负样本最好就是 300 个。

接下来就使用 OpenCV 提供的工具训练模型:

-

首先运行 opencv_createsamples 命令创建正样本的向量文件:

# -info: 正样本描述文件 # -vec : 输出的正样本向量 # -num : 正样本数量 # -w -h: 输出样本的大小 C:\Users\Desktop\train>opencv_createsamples -info positive.txt -vec pos.vec -num 61 -w 24 -h 24- 1

- 2

- 3

- 4

- 5

如果运行成功则会如上图所示在当前目录下生成 pos.vec 文件,log 会输出:

Create training samples from images collection... Done. Created 61 samples- 1

- 2

如果因为文件路径不匹配,则运行会报错:

Create training samples from images collection... Unable to open image: pos/pos/1.jpg OpenCV: terminate handler is called! The last OpenCV error is: OpenCV(3.4.16) Error: Assertion failed (0 <= roi.x && 0 <= roi.width && roi.x + roi.width <= m.cols && 0 <= roi.y && 0 <= roi.height && roi.y + roi.height <= m.rows) in cv::Mat::Mat, file C:\build\3_4_winpack-build-win64-vc15\opencv\modules\core\src\matrix.cpp, line 751- 1

- 2

- 3

- 4

-

然后运行 opencv_traincascade 进行训练:

# -data : 需要手动创建,训练的模型作为结果会输出到这个目录 # -vec : 正样本 # -bg : 负样本 # -numPos :每级分类器训练时所用到的正样本数目 # -numNeg :每级分类器训练时所用到的负样本数目,可以大于 -bg 数目 # -numStages:训练分类器的级数,如果层数多,分类器的误差就更小,但是检测速度慢。(15-20) # -featureType: 采用 LBP 算法 # -w -h:负样本的宽高可以设置的随意些,只要起始点 + 宽高不超过图片像素范围即可 C:\Users\Desktop\train>opencv_traincascade -data data -vec pos.vec -bg neg.txt -numPos 61 -numNeg 300 -numStages 15 -featureType LBP -w 24 -h 24- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

如果你没有手动创建 data 目录,运行上述命令会报错说无法打开 data/params.xml 文件:

===== TRAINING 0-stage ===== <BEGIN POS count : consumed 61 : 61 NEG count : acceptanceRatio 300 : 1 Precalculation time: 0.026 +----+---------+---------+ | N | HR | FA | +----+---------+---------+ | 1| 1| 0| +----+---------+---------+ END> Parameters can not be written, because file data/params.xml can not be opened.- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

创建 data 后再次运行可能会有如下结果之一:

# 1.训练成功 Training until now has taken 0 days 0 hours 0 minutes 10 seconds. # 2.可以认为该训练阶段是成功的,达到了所需的叶子误报率,并且分支训练已经终止(样本太少,模型质量不行) Required leaf false alarm rate achieved. Branch training terminated. # 3.错误 Bad argument < Can not get new positive sample. The most possible reason is insufficient count of samples in given vec-file.- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

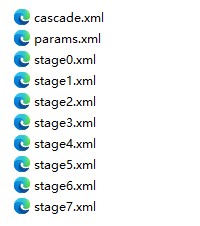

训练成功后会在 data 目录下得到如下文件:

cascade.xml 就是我们训练出的库文件,将其拷贝到手机中,修改代码,用 cascade.xml 替代 OpenCV 提供的 lbpcascade_frontalface.xml:

// 初始化 OpenCV

val path = File(

Environment.getExternalStorageDirectory(),

/*"lbpcascade_frontalface.xml"*/

"cascade.xml"

).absolutePath

mOpenCVJNI.init(path)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

使用 cascade.xml 模型去做人脸识别时,就只会识别训练样本中的人脸,而不会像 OpenCV 提供的 lbpcascade_frontalface.xml 识别所有人脸,这种识别特定人脸的需求与我们上班打卡的机器原理是类似的。

这里简单说下训练样本数量的选取标准。

minHitRate 是分类器的每一级希望得到的最小检测率。当设置为 0.995 时如果正训练样本个数为 100 个,那么其中的 0.5 个就很可能不被检测,第二次选择的时候必须多选择后面的 5 个,按照这种规律我们为后面的每级多增加

numPos*minHitRate个正样本。实际准备的正样本数量应该

(读入 vec 的正样本数) >= numPos + (numStage - 1) * numPos * (1 - minHitRate)按照此公式计算:

x+14*x*0.005 = 1.07*x,也就是正样本数量要大于等于1.07*x而我们正样本是 100,所以 x = 93.45,但是此处传 100 也可以。因为实际的检测率会比 minHitRate 高,所以在设置 numPos 时可以将其设置的稍微再大些,最终的目的是要尽量让所有的正样本都参与到训练中。但是,过大就会出错。

2.2 算法简介

LBP(Local Binary Patterns,局部二值模式)是一种用于纹理分析和模式识别的图像特征描述算法。它于 1994 年由 Ojala 等人提出,并被广泛应用于人脸识别、纹理分类、物体检测和图像检索等领域。

LBP 算法的基本思想是对图像中的每个像素点,根据其周围像素的灰度值进行编码,形成一个局部的二值模式。该编码方法具有旋转不变性和灰度不变性的特点,使得 LBP 特征适用于处理灰度图像。

LBP 算法的步骤如下:

-

对于图像中的每个像素点,选择一个固定大小的邻域窗口(通常为 3 × 3 或 5 × 5 的正方形)。

-

将邻域窗口中心像素的灰度值与邻域窗口中的其他像素逐一比较,若中心像素的灰度值大于或等于相邻像素的灰度值,则该像素点的位置被标记为 1,否则标记为 0。

-

将邻域窗口中的 8 个二值编码按顺时针或逆时针顺序排列,形成一个 8 位二进制数,即得到该像素点的 LBP 编码。

-

遍历图像中的所有像素点,重复步骤 2 和步骤 3,得到整幅图像的 LBP 编码图像。

-

统计 LBP 编码图像中不同 LBP 模式的出现频率,作为图像的 LBP 特征向量。

LBP 算法的主要优点是计算简单、特征表达能力强、对光照变化具有一定的不变性。然而,它也有一些不足之处,例如对噪声和旋转变化敏感。

我们要清楚,人工智能都是基于大数据的。用上万张图片训练出模型用于物体识别。

3、Windows 人脸识别

这一节现在 Windows 上实现人脸识别,因为 Windows 上查看中间结果(灰度图、直方图等等)比较方便。我们在 Visual Studio 中新建项目,驱动电脑的摄像头进行人脸识别。

3.1 代码实现

实现过程大致可分为三步:

- 加载 OpenCV 提供的级联分类器以具备人脸识别能力

- 打开摄像头

- 对摄像头采集到的数据进行灰度化、均衡化处理后进行人脸识别,在识别出人脸的位置画一个矩形

代码如下:

void detect() { // 1.加载级联分类器 if (!face_CascadeClassifier.load("G:/Tools/OpenCV/build/etc/haarcascades/haarcascade_frontalface_alt.xml")) { cout << "级联分类器加载失败!" << endl; } // 2.开启摄像头进行录制 VideoCapture capture; capture.open(0); if (!capture.isOpened()) { cout << "OpenCV 打开摄像头失败!\n" << endl; return; } // 3.处理采集到的图像 Mat frame; // 摄像头彩色图像 Mat gray; // 摄像头灰度图像 while (true) { // 采集到的图像存入 frame capture >> frame; if (frame.empty()) { cout << "OpenCV 读取摄像头图像失败!" << endl; return; } // 灰度化处理,注意 OpenCV 颜色排序为 BGR cvtColor(frame, gray, COLOR_BGR2GRAY); // 直方图均衡化,增强对比度 equalizeHist(gray, gray); // 一张图片可能包含多张人脸,因此保存结果的是一个集合 vector<Rect> faces; // 对灰度图进行人脸识别,识别结果保存在 faces 集合中 face_CascadeClassifier.detectMultiScale(gray, faces); for each (Rect face in faces) { // 在 frame 这张图片的 face 上画一个 BGR 颜色为 (0, 0, 255) 即红色的矩形 rectangle(frame, face, Scalar(0, 0, 255)); // 这种方式来检测相机实时人脸图像非常卡顿!只适合静态图像的检测 } // 显示图像 imshow("摄像头", frame); // wait 30ms,如果按 Esc 键就退出 if (waitKey(30) == 27) { break; } } }

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

人脸识别不需要图片的颜色,正相反,图片的颜色对于识别是一个干扰项,因此在识别之前通常要进行降噪处理,将图片处理成灰度图。

运行起来会发现虽然确实可以识别出人脸,在人脸位置画一个红色矩形,但是图像非常卡顿。这是因为不论是 OpenCV 还是 TensorFlow,检测人脸都是很耗时的,检测一次大概需要 1 ~ 2 秒的时间。因此我们不能向上面这样,对每一帧视频图片都进行检测,而是先检测到人脸,后续采用人脸跟踪。

下面对上述代码进行改造。

3.2 代码优化

上面提到,优化视频画面卡顿的方法是检测第一帧,检测到后,对后续的帧进行人脸跟踪。那么在 OpenCV 中,人脸检测的任务交给主检测适配器,人脸跟踪的任务交给跟踪检测适配器。这两种适配器必须是 DetectionBasedTracker::IDetector 的子类。我们直接使用 OpenCV 提供的代码示例 opencv\sources\samples\android\face-detection\jni\DetectionBasedTracker_jni.cpp 中定义的 CascadeDetectorAdapter 写入 OpenCV.h:

# pragma once #include <iostream> #include <opencv2/opencv.hpp> using namespace std; using namespace cv; CascadeClassifier face_CascadeClassifier; cv::Ptr<DetectionBasedTracker> tracker; class CascadeDetectorAdapter : public DetectionBasedTracker::IDetector { public: CascadeDetectorAdapter(cv::Ptr<cv::CascadeClassifier> detector) : IDetector(), Detector(detector) { CV_Assert(detector); } // 每张 Image 图片中都可能会有多张人脸 objects,因此可能会多次调用 detect 进行识别 void detect(const cv::Mat& Image, std::vector<cv::Rect>& objects) { Detector->detectMultiScale(Image, objects, scaleFactor, minNeighbours, 0, minObjSize, maxObjSize); } virtual ~CascadeDetectorAdapter() { } private: CascadeDetectorAdapter(); cv::Ptr<cv::CascadeClassifier> Detector; };

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

接下来我们通过宏定义的方式在原始代码上进行优化,加入使用跟随策略进行人脸检测的代码:

// 定义此宏则收集人脸图片数据保存到指定位置 #define COLLECT_SAMPLES // 收集的人脸图片编号 int i = 0; // 一次识别,后续跟踪来解决只通过检测的方式的卡顿问题 void track() { // 如果定义了 DETECT 宏,则每一帧都进行检测,否则只检测一帧,后续跟随,这里我们没有定义这个宏 #ifdef DETECT // 1.加载级联分类器,注意路径一定是斜杠而不是反斜杠,否则会加载失败 if (!face_CascadeClassifier.load("G:/Tools/OpenCV/build/etc/haarcascades/haarcascade_frontalface_alt.xml")) { cout << "级联分类器加载失败!" << endl; return; } #else // 2.创建跟踪器并运行 // 2.1 创建主检测适配器 cv::Ptr<CascadeDetectorAdapter> mainDetector = makePtr<CascadeDetectorAdapter>( makePtr<CascadeClassifier>("G:/Tools/OpenCV/build/etc/haarcascades/haarcascade_frontalface_alt.xml")); // 2.2 创建跟踪检测适配器 cv::Ptr<CascadeDetectorAdapter> trackingDetector = makePtr<CascadeDetectorAdapter>( makePtr<CascadeClassifier>("G:/Tools/OpenCV/build/etc/haarcascades/haarcascade_frontalface_alt.xml")); // 2.3 创建跟踪器 DetectionBasedTracker::Parameters DetectorParams; tracker = makePtr<DetectionBasedTracker>(mainDetector, trackingDetector, DetectorParams); // 2.4 开始检测 tracker->run(); #endif // 3.开启摄像头进行录制 VideoCapture capture; capture.open(0); if (!capture.isOpened()) { cout << "OpenCV 打开摄像头失败!\n" << endl; return ; } // 4.处理采集到的图像 Mat frame; // 摄像头彩色图像 Mat gray; // 摄像头灰度图像 while (true) { // 采集到的图像存入 frame capture >> frame; if (frame.empty()) { cout << "OpenCV 读取摄像头图像失败!\n" << endl; return ; } // 灰度化处理,注意 OpenCV 颜色排序为 BGR cvtColor(frame, gray, COLOR_BGR2GRAY); // 直方图均衡化,增强对比度 equalizeHist(gray, gray); // 一张图片可能包含多张人脸,因此要保存在 faces 集合中 vector<Rect> faces; // 如果每帧都识别,则通过 detectMultiScale,否则用 tracker 进行识别 #ifdef DETECT face_CascadeClassifier.detectMultiScale(gray, faces); #else tracker->process(gray); tracker->getObjects(faces); #endif // DETECT for each (Rect face in faces) { // 在 frame 这张图片的 face 上画一个 BGR 颜色为 (0, 0, 255) 即红色的矩形 rectangle(frame, face, Scalar(0, 0, 255)); // 这种方式来检测相机实时人脸图像非常卡顿!只适合静态图像的检测 #ifdef COLLECT_SAMPLES // 采集人脸样本,转换为 24 * 24 的灰度图保存到指定路径的文件中 Mat sample; frame(face).copyTo(sample); resize(sample, sample, Size(24, 24)); cvtColor(sample, sample, COLOR_BGR2GRAY); char p[100]; // 目录需要手动创建,否则不会自动生成 sprintf(p, "D:/opencv/train/face/pos/%d.jpg", i++); //imread 读取文件图像 imwrite(p, sample);//将Mat写入文件 #endif // COLLECT_SAMPLES } // 显示图像 imshow("摄像头", frame); // Esc 键退出 if (waitKey(30) == 27) { break; } } #ifndef DETECT tracker->stop(); #endif // !DETECT }

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

- 88

- 89

- 90

- 91

- 92

- 93

- 94

- 95

- 96

- 97

简要说明:

- 在第 2 步创建跟踪器时,使用了 OpenCV 的智能指针 Ptr 模板类,它采用引用计数型的句柄类实现计数。自动管理对象的释放,Ptr 中调用 release() 会将引用计数器减 1,如果计数器为 0 则会删除该对象。使用 Ptr 声明的对象可以不用手动释放

- 创建的 mainDetector 负责检测,trackingDetector 负责跟随,调用 tracker->run() 会开启一个线程,其内部有一个无限循环,当 tracker->process() 传入灰度图开始检测后,检测到的人脸数据可以通过 tracker->getObjects(faces) 获取,faces 是一个

vector<Rect>类型的入参出参数据,保存着一张图片中的所有人脸 - 我们定义了 COLLECT_SAMPLES 宏用来收集人脸数据,将采集到的人脸图像转成灰度图再把尺寸设置为 24 * 24 保存在指定目录中,这些图片可以帮助我们使用 2.1 节中介绍的方法训练自己的模型

应用以上代码后就可以流畅的识别出人脸了。