热门标签

热门文章

- 1通过pycharm创建Django新项目_pycharm创建django app

- 2GitHub的原理及应用详解(一)

- 3word中装订线位置_Word教程:文档”双面打印“全攻略,解决打印难题!

- 4使用SwitchHosts和GitHub520自动更新 github.com的hosts_switchhosts 自动更新google地址

- 5初阶数据结构之双向链表详解

- 6Android Studio 解决编译报错 Could not download aapt2-windows.jar

- 7堆排序

- 8二分查找最坏查找次数_快速入门二分查找

- 9NLP学习笔记(四) Seq2Seq基本介绍_seq2seq模型说的时间步是什么意思

- 10初学者必须弄懂的一些基本FPGA设计概念(1)_fpga 设计

当前位置: article > 正文

头歌Hadoop 开发环境搭建及HDFS初体验(第2关:配置开发环境 - Hadoop安装与伪分布式集群搭建)_hadoop安装与伪分布式集群搭建头歌_头歌 分布式文件系统hdfs

作者:从前慢现在也慢 | 2024-05-27 21:54:04

赞

踩

头歌 分布式文件系统hdfs

先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

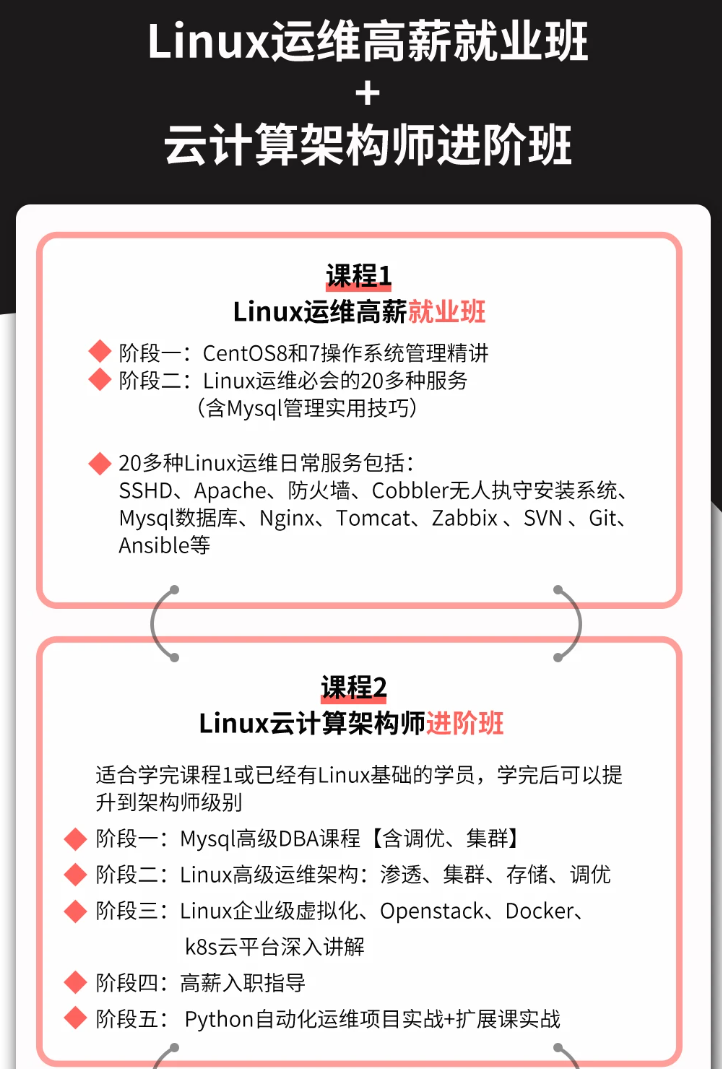

因此收集整理了一份《2024年最新Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上运维知识点,真正体系化!

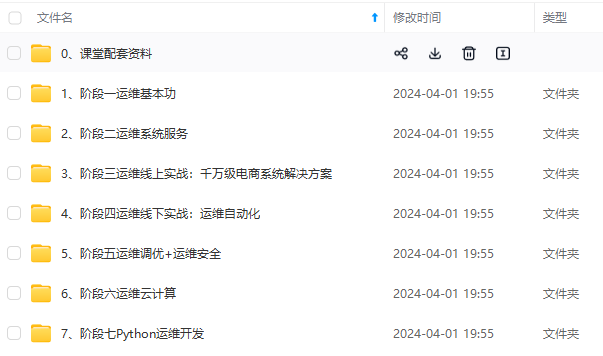

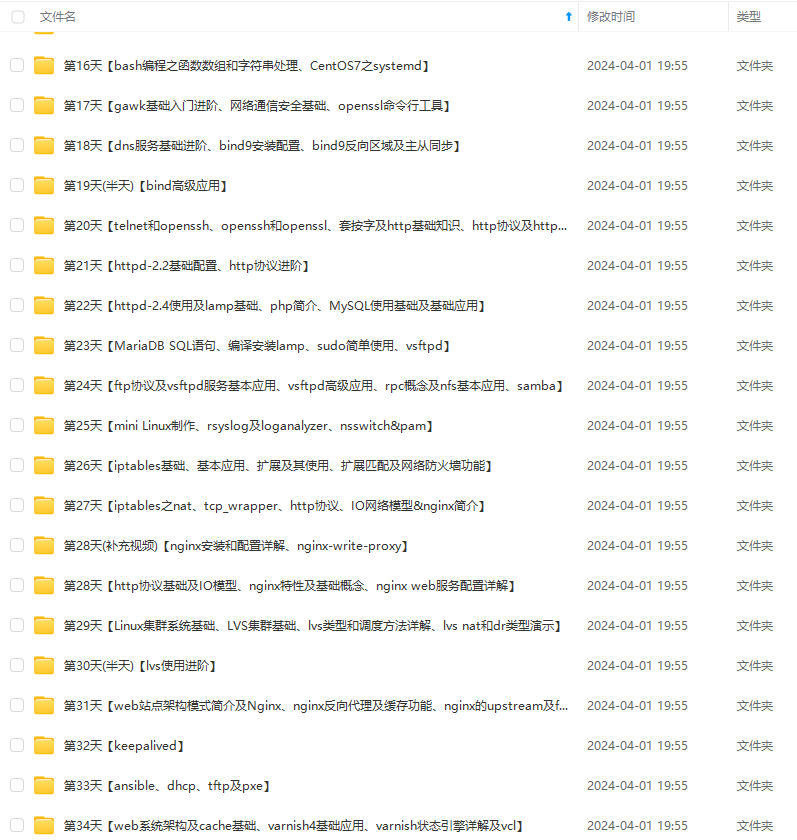

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024b (备注运维)

正文

source /etc/profile

- 1

java -version

- 1

评测!

第2关:配置开发环境 - Hadoop安装与伪分布式集群搭建:

cd /opt ll

tar -zxvf hadoop-3.1.0.tar.gz -C /app

cd /app

mv hadoop-3.1.0/ hadoop3.1

- 1

- 2

- 3

- 4

- 5

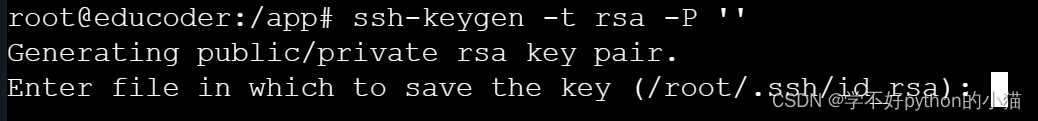

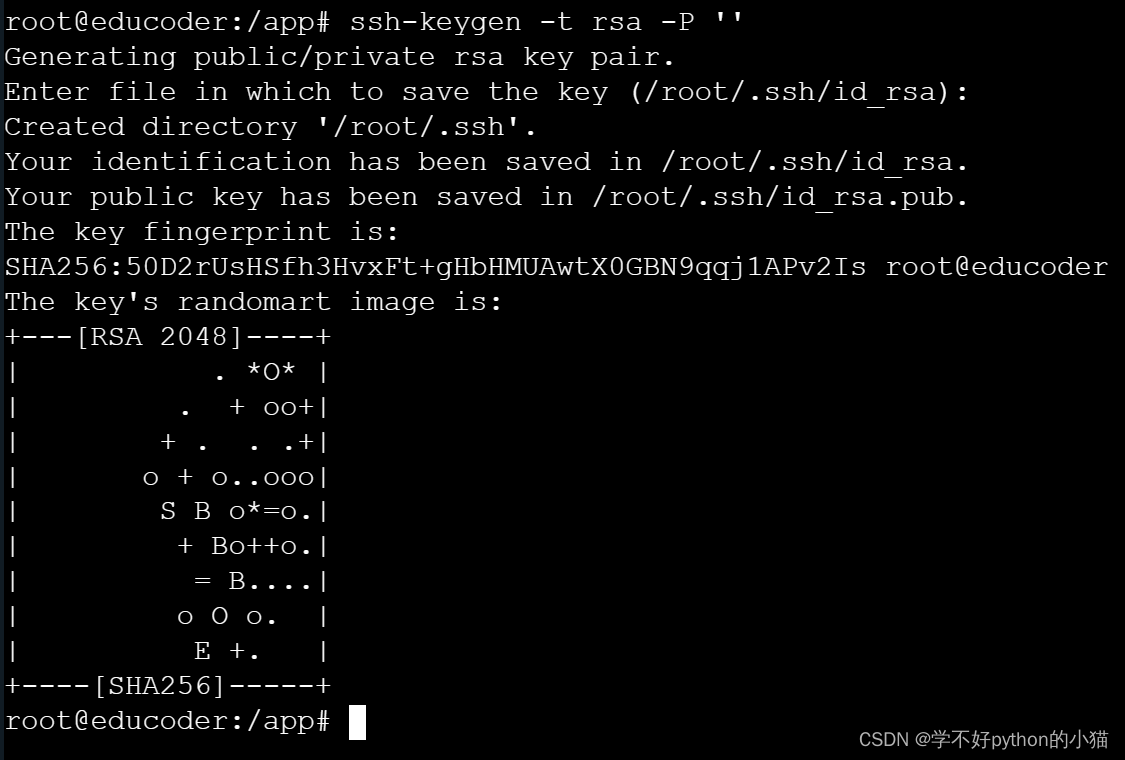

ssh-keygen -t rsa -P ''

#两次回车 图3 图4

- 1

- 2

图3:

图4:

图4:

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 600 ~/.ssh/authorized_keys

- 1

- 2

家人们坚持住,一大波vim即将来袭 !!!

vim /etc/ssh/sshd_config

RSAAuthentication yes # 启用 RSA 认证

PubkeyAuthentication yes # 启用公钥私钥配对认证方式

AuthorizedKeysFile %h/.ssh/authorized_keys # 公钥文件路径

- 1

- 2

- 3

- 4

- 5

- 6

cd /app/hadoop3.1/etc/hadoop

vim hadoop-env.sh

export JAVA_HOME=/app/jdk1.8.0_171

- 1

- 2

- 3

- 4

- 5

vim yarn-env.sh

export JAVA_HOME=/app/jdk1.8.0_171

- 1

- 2

- 3

- 4

又一大波vim飘过~~~

插入的内容放在两个中。如下图:

vim core-site.xml

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

<description>HDFS的URI,文件系统://namenode标识:端口号</description>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/hadoop/tmp</value>

<description>namenode上本地的hadoop临时文件夹</description>

</property>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

vim hdfs-site.xml <property> <name>dfs.name.dir</name> <value>/usr/hadoop/hdfs/name</value> <description>namenode上存储hdfs名字空间元数据 </description> </property> <property> <name>dfs.data.dir</name> <value>/usr/hadoop/hdfs/data</value> <description>datanode上数据块的物理存储位置</description> </property> <property> <name>dfs.replication</name> <value>1</value> </property>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

vim mapred-site.xml

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

vim yarn-site.xml

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>192.168.2.10:8099</value>

<description>这个地址是mr管理界面的</description>

</property>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

最后一波了,挺住!!!

将Hadoop添加到环境变量中并设置root用户可以启动hadoop

mkdir /usr/hadoop

mkdir /usr/hadoop/tmp

mkdir /usr/hadoop/hdfs

mkdir /usr/hadoop/hdfs/data

mkdir /usr/hadoop/hdfs/name

- 1

- 2

- 3

- 4

- 5

vim /etc/profile

# 在文件末尾插入下面代码:

#set Hadoop Environment

export HADOOP_HOME=/app/hadoop3.1

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

- 1

- 2

- 3

- 4

- 5

- 6

- 7

source /etc/profile

- 1

hadoop namenode -format

cd /app/hadoop3.1/sbin

- 1

- 2

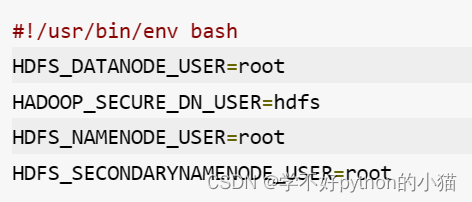

下面的vim均在文件头部插入。如图:

vim start-dfs.sh

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

- 1

- 2

- 3

- 4

- 5

- 6

vim stop-dfs.sh

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

- 1

- 2

- 3

- 4

- 5

- 6

vim start-yarn.sh **网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。** **需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注运维)**  **一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!** n.sh **网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。** **需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注运维)** [外链图片转存中...(img-XmisxYNe-1713552755744)] **一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/从前慢现在也慢/article/detail/634236

推荐阅读

相关标签