- 1CVPR2024满分论文出炉!这些方向爆火!

- 2数码管在c语言中显示时间,用LED数码管显示电脑中的时间

- 3建议收藏|华为项目管理10大模板(可直接套用)

- 4【ACM出版】2024人工智能与自然语言处理国际学术会议(AINLP 2024,7月19-21)_2024年7月计算机类会议

- 5施耐德全新EtherCAT运动控制器M310介绍

- 6Hadoop之WEBUi界面功能介绍及日志配置查看_hadoop web界面

- 7大数据有哪些基本特征,有什么作用和用途?_请列出大数据的特点,并简要叙述大数据有哪些重要领域

- 8SpringBoot学习笔记之使用Druid为数据库密码加密_druid加密数据库密码

- 9org.springframework.validation.BeanPropertyBindingResult

- 10YOLOV8 python 训练模型输出路径更改_yolov8训练保存路径修改

windows11 本地化部署ChatGLM2-6B 安装笔记_windows 部署chatglm miniconda

赞

踩

为了学习大模型计算,最近新装机了一台GTX 4060Ti 16G的电脑,以下记录部署ChatGLM2-6B的全过程。

ChatGLM2-6B安装笔记

1、安装Python

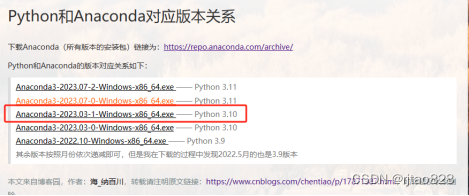

首先要选择一个Python版本,Python版本不能低于3.8,这里建议3.10以上,支持的语法更多(例如match,case,我也是才知道的),且为了后续的升级。

这里安装:Anaconda3

下载网址:Index of /

由于ChatGLM2-6B是2023年7月左右发布的,选一个这之前的Anaconda3版本,例如这个版本:

Anaconda3与Python对应版本关系:

安装时如果没有添加环境变量,参考以下教程:

https://www.jb51.net/article/261224.htm

2、安装Python代码编辑器

这里安装Python专业编辑器pycharm。例如我这里安装的2022.3.3版本。

可以使用激活工具进行激活。

3、部署chatGLM2-6B

Git-hub网址:

GitHub - THUDM/ChatGLM2-6B: ChatGLM2-6B: An Open Bilingual Chat LLM | 开源双语对话语言模型

3.1 首先安装Git,Windows上安装Git步骤

3.1.1下载Git

然后按默认选项安装即可

需要相应设置,打开git bash。输入

- $ git config --global user.name "xxxx"

-

- $ git config --global user.email "xxxx@qq.com"

教程:安装Git - 廖雪峰的官方网站 (liaoxuefeng.com)

3.2 克隆仓库代码

打开git-bash 切换到项目目录:

cd D:/NLP/chatGLM2克隆:

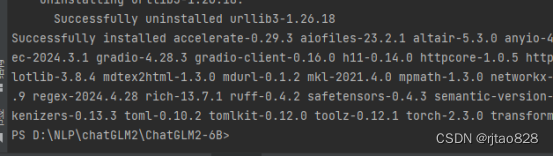

git clone https://github.com/THUDM/ChatGLM2-6B3.3 使用python pip安装依赖库

我们这里使用pycharm中的终端,与Windows CMD一样的效果:输入命令:

- cd ChatGLM2-6B

-

- pip install -r requirements.txt

安装过程中有个报错:

![]()

ERROR: Cannot uninstall 'TBB'. It is a distutils installed project and thus we cannot accurately determine which files belong to it which would lead to only a partial uninstall.

这里有个教程:

简单的解决方法是:

conda uninstall TBB解决完问题再次执行安装依赖库:pip install -r requirements.txt

这一次完全没有报错了。

3.4 本地化下载、部署模型

先下载模型

首先安装:Git LFS

网址:

安装 Git Large File Storage - GitHub 文档

其实就是下载好,双击exe文件安装,再打开Git bash,输入命令:

git lfs install当出现:Git LFS initialized.

就表示安装成功了。

使用Git bash下载模型:

- cd ChatGLM2-6B/

-

- GIT_LFS_SKIP_SMUDGE=1 git clone https://huggingface.co/THUDM/chatglm2-6b

这里会因为网络原因连接失败,我们通过科学上网,来解决这个问题。

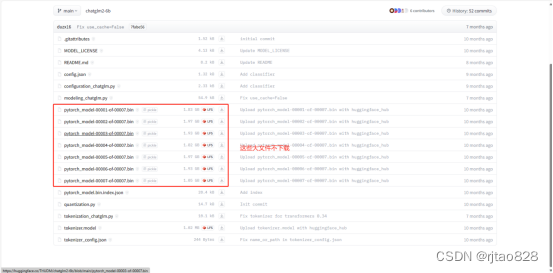

连接VPN还不能下载,我们只能登录网址,将除模型外的其他文件都下载下来:

https://huggingface.co/THUDM/chatglm2-6b/tree/main

然后在这个网址下载模型文件:

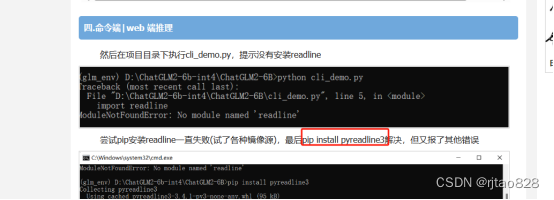

模型文件下载完毕后,我们尝试运行模型,发现报错:

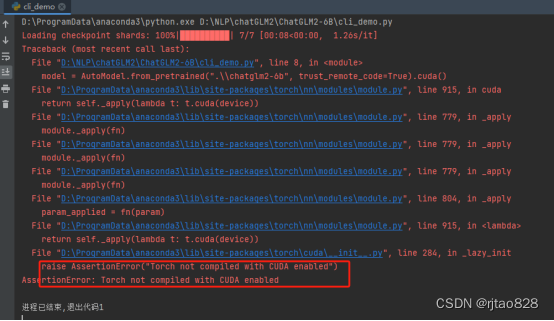

D:\ProgramData\anaconda3\python.exe D:\NLP\chatGLM2\ChatGLM2-6B\cli_demo.py

Traceback (most recent call last):

File "D:\NLP\chatGLM2\ChatGLM2-6B\cli_demo.py", line 5, in <module>

import readline

ModuleNotFoundError: No module named 'readline'

提示缺少模块:'readline'

采用命令:pip install pyreadline3进行解决

再次运行,开始加载模型,但是又开始报错:

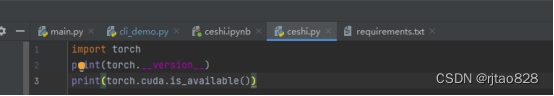

无法启用CUDA进行加速,检查系统是否安装CUDA

发现结果是False,果然没有安装

用nvidia-msi检查系统显卡驱动:

发现是驱动是最新的(但是这里我不知道CUDA到底有没有安装,按照后边的步骤,应该是没有安装),我们这里pytorch安装的是CPU版本的,我们先卸载:

pip uninstall torch首先我尝试了直接安装GPU版本的torch

在https://pytorch.org/get-started/locally/

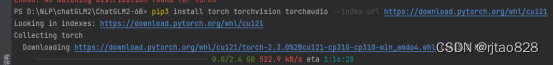

找到相应的命令进行安装:

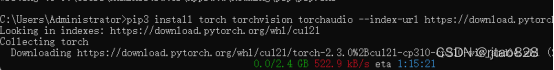

- pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121

-

发现下载非常慢:

我们先添加清华镜像试试,设置全局使用清华镜像源的命令:

pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple好像也没有啥用:

算了,等他慢慢下载吧。等了一个小时,结果还是因为网络原因报错,呜呜呜呜呜呜。

。。。

重新找方法进行安装!!

教程:

https://blog.csdn.net/tianxinyiru/article/details/135777601

使用方法2进行安装。

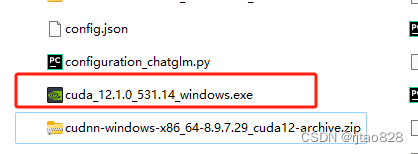

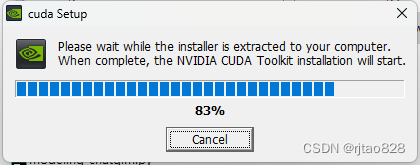

我下载的CUDA12.1(为什么是12.1,因为前面安装torch支持的也是这个版本)下载网速飞起,2分钟下载完毕。直接双击进行安装。

很顺利!

安装好了。

然后安装cuDNN,注册。先注册!?搞半天。

下载最新的版本,解压复制到CUDA的安装目录即可。

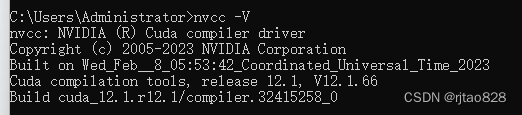

检查CUDA是否安装成功(cuDNN不按照应该也行),输入:

nvcc -V检查CUDA是否安装成功:

安装成功:

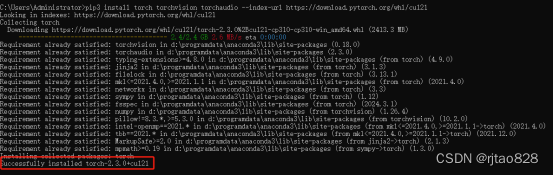

再次安装torch:

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121这次网速起飞,还是下载2.4G,但是很快完成。(这里网速变快了是为什么啊啊)

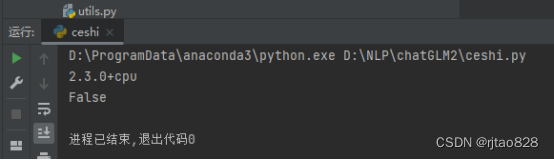

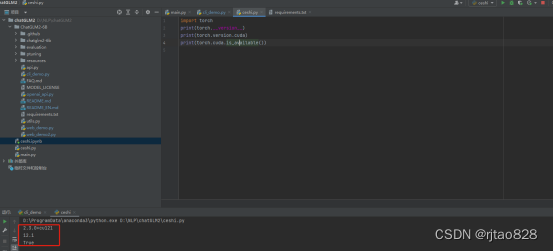

再测试一下是否安装成功:

完美!

4、运行大模型

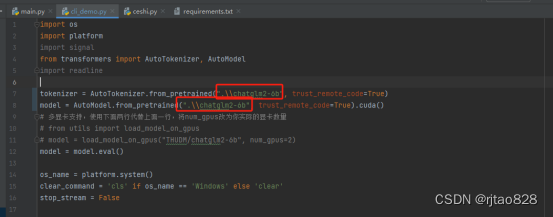

将模型路径修改为本地(前期已经尝试修改这个运行了):

运行模型:

成功启动模型,完成大模型在本地的部署。

可以进行愉快的玩耍了!!