- 1无权图的最短路径JAVA_无权最短路径算法java

- 2万字长文!手把手教你用 AI 整点好玩的...

- 3Spring Cache框架使用教程,通过简单且强大的方式在应用程序中使用缓存提高性能

- 4www.zhsws.com/admin.php,WebShell/DJ团队.asp at master · xl7dev/WebShell · GitHub

- 5proxy connect abort处理方法_Proxy 对象拦截器

- 6开源办公系统:支持在线Office在线编辑、文档协同_开源在线office

- 7时隔26年,微软的人工智能助手终于实现了!地球最强生产力工具Copilot发布

- 8opencv python 常用方法_python opencv

- 9AXURE教程:三级菜单和标签的交互使用_axure教程:三级菜单和标签的交互使用

- 10sqlserver 函数

【OpenMMLab】图片分类发展简史_图像识别分类发展历史

赞

踩

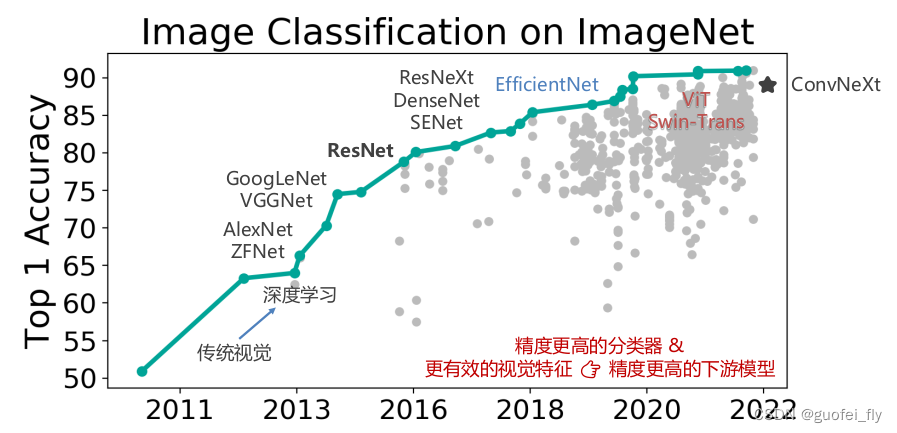

一、发展简述

图片分类是CV领域的基础任务,也是检测、分割、追踪等任务的基石。简而言之,图片分类就是给定一张图片,判断其类别,一般而言所有的候选类别是预设的。

从数学上描述,图片分类就是寻找一个函数,将图片像素值映射为类别。对人类而言,丰富的先验知识让我们可以实下意识的进行判断。而对于计算机,如何根据抽象的像素数值判断其分类并不容易。

在深度学习之前,其典型做法是先人工设计特征,再通过机器学习模型或浅层网络结构进行训练。特征的设计严重依赖于经验和试验,虽然提出了HOG、SIF等特征算子,但在图像分类上的准确率并不理想。

随着神经网络的训练变得可行,人们从繁琐的特征工程中解脱出来,可以让大参数量的模型来自己完成特征的抽取和分类工作。

在 2012 年的竞赛中,来自多伦多大学的团队首次使用深度学习方法, 提出了AlexNet,一举将错误率降低至 15.3% ,而传统视觉算法的性能已经达到瓶颈,2015 年,卷积网络的性能超越人类。

围绕着加大网络深度提升预测效果、降低CNN卷积核参数量、提升模型效率等关键命题,科学家们先后提出了VGG、GoogLeNet、ResNet、EfficientNet等具有里程碑意义的模型。

在2020年之前,绝大多数的图像分类模型均借助于CNN技术,其网络架构也相对固定,包含卷积核、残差、池化单元和线性层等基本模块。

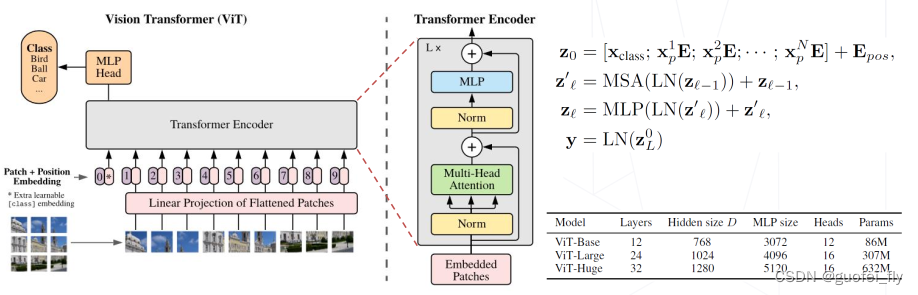

从2020年起,在自然语言处理大放异彩的Transformer模型结构开始被引入CV领域,并凭借其优异的表现迅速风靡CV圈。

另一方面,在CNN时代,绝大部分模型均是建立在ImageNet数据集上,虽然这是个大规模的1000分类数据集,但仍具有其局限性。随着Transformer在CV领域的快速发展,NLP大模型中被广泛采用的自监督、弱监督学习也开始在CV领域发力,诸如MAE(自监督)、SimCLR(对比学习)、CLIP(多模态)这样的工作极大的拓展了CV模型的外延。

二、展望

这是最好的时代,神经网络技术的快速发展极大的提高了AI的能力,让人们期待更好的未来。

这是最坏的时代,AI的发展让从业者们还是思考自己的发展。

但无论如何,历史的浪潮已经来临,无法阻挡,我们唯有去拥抱技术的发展和进步,努力成为这个浪潮里的一颗小水滴。