- 1AI系统性学习05—向量数据库_chroma数据库

- 2java开发实例教程pdf_java项目开发实战入门pdf

- 3gitee - 码云上新建仓库_码云怎么新建仓库

- 42024年Java最全MySQL实战学习之入门基础,夯实你的底层知识,构筑上层建筑,Java高级工程师面试题-字节跳动

- 5宝塔面板安装mysql,使用navicat进行远程连接(解决Navicat报错1045)_宝塔安装mysql要多久

- 6智能交通市场年会|闪马智能:AI赋能新基建,智慧高速如何更聪明_闪马 杭州智慧高速 分享

- 7AntSword:一款强大且易用的Web管理工具

- 8socket通信机制详解_sooketd的收发信息是管道机制吗

- 9CleanMyMac X 4.14.3破解版 必备的Mac系统清理工具

- 10ZYNQ之FPGA学习----Vivado功能仿真_vivado仿真

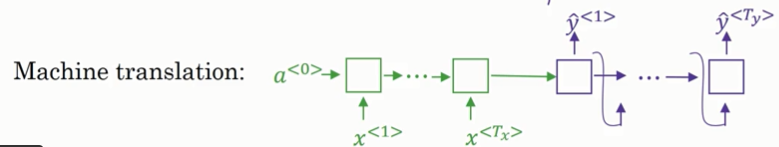

机器翻译 :seq2seq_研究框架如图7所示,由编码和解码两部分构成

赞

踩

seq2seq:

机器翻译的模型与其他语言模型的不同之处在于,机器翻译的模型是由编码器和解码器两部分组成。两个部分都需要进行训练。其中解码器我们有时候也称为特征提取器。seq2seq模型结构如下图所示

其中绿色部分为编码器(特征提取器),紫色部分为解码器。

若有句子 : i like apple 翻译为: 我 喜欢苹果

其中i like apple 的嵌入向量则是编码器的输入。 编码器的输出为解码器的输入。解码器的输出是 “我”, “喜欢” , “苹果”这几个词的概率。

但是这种选择输出单词的方法存在缺陷: 没一时间的输出都为一个n(n为预料库的规模)维概率向量。这样就加大了计算的开销。为了对这种方法进行改进,定向搜索的方法就应运而生了。

定向搜索

集束宽算法,是定向搜索的一种常用算法,不同于上面所描述的贪心算法。 在训练模型时候设置一个集束宽。

假设集束宽设为3,实例如下

图左侧为语料库, 右侧为模型输出

找出

然后将这三个单词的one-hot向量分别作为

重复以上步骤。直到结束。

会输出多段翻译出来的结果,根据以下公式来评价应该选择哪句话

但是由于每个概率都小于1,大量相乘的话,会造成数值溢出。

对这种评价进行了如下的改进

有些还会为评价函数加一个系数为

当选择出,来翻译语句后,再做一下定向搜索误差分析。查看翻译效果。