- 1OpenAI推出GPT-4:功能强过ChatGPT 能玩梗图还能做网页

- 2spring boot单元测试之druid NullPointException问题解决

- 3解决:Idea: caused by noauth authentication required_idea authentication real

- 4【论文精读】AligNeRF_nerf mse损失

- 52023网安最流行的10大工具(附安装包)_2023年最佳10款开源漏洞扫描工具

- 6Recurrent Neural Networks 简述_how to construct deep recurrent neural networks

- 7【大疆DJI】安卓开发实习历程- 0.前期准备到面试(HR电话初面+技术一面+技术二面/终面+OC)_联系大疆hr

- 8【WPF】 免费图表控件的比较 (OxyPlot,LiveChart,ScottPlot,MsChart)_wpf 图表控件

- 9Android JetPack简介

- 10堆栈和缓冲区溢出_ctfmon系统错误堆栈缓冲区溢出

NLP领域任务选择合适预训练模型以及合适的方案【规范建议】【ERNIE模型首选】_nicknlp*:ei5

赞

踩

NLP领域任务如何选择合适预训练模型以及选择合适的方案【规范建议】【ERNIE模型首选】

-----------------------------------------------------------------------------------------------------------------知识蒸馏相关技术【模型蒸馏、数据蒸馏】以ERNIE-Tiny为例

1.常见NLP任务

-

信息抽取:从给定文本中抽取重要的信息,比如时间、地点、人物、事件、原因、结果、数字、日期、货币、专有名词等等。通俗说来,就是要了解谁在什么时候、什么原因、对谁、做了什么事、有什么结果。

-

文本生成:机器像人一样使用自然语言进行表达和写作。依据输入的不同,文本生成技术主要包括数据到文本生成和文本到文本生成。数据到文本生成是指将包含键值对的数据转化为自然语言文本;文本到文本生成对输入文本进行转化和处理从而产生新的文本

-

问答系统:对一个自然语言表达的问题,由问答系统给出一个精准的答案。需要对自然语言查询语句进行某种程度的语义分析,包括实体链接、关系识别,形成逻辑表达式,然后到知识库中查找可能的候选答案并通过一个排序机制找出最佳的答案。

-

对话系统:系统通过一系列的对话,跟用户进行聊天、回答、完成某一项任务。涉及到用户意图理解、通用聊天引擎、问答引擎、对话管理等技术。此外,为了体现上下文相关,要具备多轮对话能力。

-

语音识别和生成:语音识别是将输入计算机的语音符号识别转换成书面语表示。语音生成又称文语转换、语音合成,它是指将书面文本自动转换成对应的语音表征。

-

信息过滤:通过计算机系统自动识别和过滤符合特定条件的文档信息。通常指网络有害信息的自动识别和过滤,主要用于信息安全和防护,网络内容管理等。

-

舆情分析:是指收集和处理海量信息,自动化地对网络舆情进行分析,以实现及时应对网络舆情的目的。

-

信息检索:对大规模的文档进行索引。可简单对文档中的词汇,赋之以不同的权重来建立索引,也可建立更加深层的索引。在查询的时候,对输入的查询表达式比如一个检索词或者一个句子进行分析,然后在索引里面查找匹配的候选文档,再根据一个排序机制把候选文档排序,最后输出排序得分最高的文档。

-

机器翻译:把输入的源语言文本通过自动翻译获得另外一种语言的文本。机器翻译从最早的基于规则的方法到二十年前的基于统计的方法,再到今天的基于神经网络(编码-解码)的方法,逐渐形成了一套比较严谨的方法体系。

-

文本挖掘:包括文本聚类、分类、情感分析以及对挖掘的信息和知识的可视化、交互式的表达界面。目前主流的技术都是基于统计机器学习的。

2.如何将业务问题抽象为已得到很好解决的典型问题

2.1 明确业务的输入与输出

令输入文本用X表示,输出标签用Y表示,则有以下粗略的分类:

2.1.1 如果Y表示某一类的概率,或者是一个定长向量,向量中的每个维度是其属于各个类的概率,且概率之和为1,则可抽象为文本多分类问题。

a.一般X只有一段文本。如下所示

i.如情感分析等任务。

房间 太 小 。 其他 的 都 一般 0

- 1

- 2

b.如果X是2段文本(X1,X2),则是可以抽象为句对分类问题。如下所示 i:如NLI等任务。

大家觉得她好看吗 大家觉得跑男好看吗? 0

- 1

- 2

c.如果的每个类别的概率相互独立,即各类概率之和不为1,可抽象为文本多标签分类问题。如下所示

i:如用户评论分类、黄反识别等任务。

互联网创业就如选秀 需求与服务就是价值 0 1

- 1

- 2

d. 如果X有多段非文本特征输入,如整型、浮点型类型特征。则可抽象为混合特征的分类问题。如下所示

i:如CTR预估等任务。

CTR预估*

CTR预估是推荐中最核心的算法之一。 相关概念:

CTR预估:对每次广告的点击情况做出预测,预测用户是点击还是不点击。

CTR预估的影响因素:比如历史点击率、广告位置、时间、用户等

CTR预估相关介绍

推荐算法之4——CTR预估模型

2.1.2 如果X是2段文本(X1,X2),Y表示二者的相似度,可抽象为文本匹配问题。如下所示

喜欢 打篮球 的 男生 喜欢 什么样 的 女生 爱 打篮球 的 男生 喜欢 什么样 的 女生 1

- 1

- 2

a.如语义相似度、相似问题匹配等任务。

b.文本聚类的问题可以通过文本相似度问题进行处理。

2.1.3 如果X有一段文本,Y是一个与X等长的序列,可抽象为序列标注问题。如下所示

海 钓 比 赛 地 点 在 厦 门 与 金 门 之 间 的 海 域 。 O O O O O O O B-LOC I-LOC O B-LOC I-LOC O O O O O O

- 1

- 2

a.如分词、POS、NER、词槽挖掘等任务。

2.1.4 如果X有一段文本,Y是一个不定长的文本,可抽象为文本生成问题。如下所示

Rachel Pike : The science behind a climate headline Khoa học đằng sau một tiêu đề về khí hậu

- 1

- 2

a.如机器翻译、文本摘要、标题生成等任务。

2.1.5.如果X为一段文本,Y表示文本X作为正常语句出现的概率或者混淆度,则属于语言模型任务。如下所示

<s> but some analysts remain sour on the company but some analysts remain sour on the company <e>

- 1

- 2

a.语言模型任务的子问题是基于上(下)文X预测下(上)一个词出现的概率Y,可以理解为一种特殊的文本分类。

2.1.6如果X是2段文本(X1,X2),分别表示正文篇章和问题,Y是篇章中的一小段文本,表示对应问题的答案,则可抽象为阅读理解问题。

{ "data": [{ "title": "", "paragraphs": [{ "context": "爬行垫根据中间材料的不同可以分为:XPE爬行垫、EPE爬行垫、EVA爬行垫、PVC爬行垫;其中XPE爬行垫、EPE爬行垫都属于PE材料加保鲜膜复合而成,都是无异味的环保材料,但是XPE爬行垫是品质较好的爬行垫,韩国进口爬行垫都是这种爬行垫,而EPE爬行垫是国内厂家为了减低成本,使用EPE(珍珠棉)作为原料生产的一款爬行垫,该材料弹性差,易碎,开孔发泡防水性弱。EVA爬行垫、PVC爬行垫是用EVA或PVC作为原材料与保鲜膜复合的而成的爬行垫,或者把图案转印在原材料上,这两款爬行垫通常有异味,如果是图案转印的爬行垫,油墨外露容易脱落。当时我儿子爬的时候,我们也买了垫子,但是始终有味。最后就没用了,铺的就的薄毯子让他爬。您好,爬行垫一般色彩鲜艳,能吸引宝宝的注意力,当宝宝刚会爬的时候,趴在上面玩,相对比较安全,不存在从床上摔下来的危险。对宝宝的爬行还是很有好处的。还有就是妈妈选择爬行垫时可以选择无害的PE棉,既防潮又隔冷隔热。外有要有一层塑料膜,能隔绝液体进入垫子内部,而且方便清洗。宝宝每次爬行,一定要记得把宝宝的手擦干净。", "qas": [{ "answers": [{ "text": "XPE", "answer_start": 17 }], "id": "DR-single-pre_and_next_paras-181574", "question": "爬行垫什么材质的好" }] }, ..., ] }] }

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

2.1.7 如果Y是以上多种任务的组合,则可以抽象为多标签学习、多任务学习任务。

a.如实体关系抽取任务,实体抽取本属于序列标注、关系抽取本属于文本多分类。

2.2抽象与拆分任务取舍经验

2.2.1优先考虑简单的任务,由易到难循序渐进:

a.文本分类、文本匹配、序列标注、文本生成、阅读理解、多任务学习、强化学习、对抗学习等。

2.2.2 复杂任务可拆分、化简成简单的子任务

a.如实体关系抽取任务,可以拆分为实体识别+关系抽取的pipline进行实现。

b.如文本纠错任务,可以拆分出语言模型、统计机器翻译等多种不同子任务构造复杂的pipline进行实现。

c.如排序任务,输入X为多段文本,输出Y为每段文本的排序位置,可化简成文本分类问题、文本匹配问题进行处理。

2.2.3 有监督学习任务优先于无监督学习任务

a.因为有监督学习更可控,更易于应用最前沿的研究成果。文心目前只覆盖有监督、自监督任务。

b.比如文本关键词抽取,可以有TFIDF之类的无监督解法,但效果控制较困难,不如转换为文本分类问题。

2.2.4 能应用深度学习的任务优于不利用深度学习的任务

a.因为深度学习算法效果一般更好,而且可以应用到最前沿的预训练模型。文心目前只采用深度学习算法。

b.如果文本聚类,可以有LDA之类的解法,但效果一般不如基于深度学习的语义相似度的文本聚类。

3. 明确业务目标与限制条件

3.1典型业务目标与限制条件

1.预测部署性能

a.典型指标:qps

性能指标:QPS、TPS、系统吞吐量理解

2.模型效果

a.以文本分类为例,典型指标:精确率、准确率、召回率、F1值

b.该评估指标应该在训练开始之前基本确定,否则很容易优化偏。

3.硬件采购成本

a.典型指标:钱

b.GPU远贵于CPU,V100贵于P40。

4.训练时间成本(GPU,卡,调参,GPU利用率)

a.典型指标:每一轮训练所需要的时间。

5.数据大小限制

a.由于标注成本较高,很多时候是数据量很少又希望有很好的效果。

6.开发迭代成本

a.搭建环境成本

b.迭代效率:往往是最消耗时间的部分。

3.2 可供选择的方案

- 选择平台版还是工具版

- 选择GPU还是CPU训练,哪一款硬件,单机还是多机,单卡还是多卡,本地还是集群

- 选择怎样的预制网络

- 是否需要预训练模型

- 选择哪一版本的预训练模型

- 训练数据要多少

- batch_size、train_log_step、eval_step、save_model_step选多少

4.根据业务目标与限制条件选择合适的方案

4.1预测部署性能

如果要求qps>1000

a.不适合直接部署ERNIE预训练模型。

b.但可尝试蒸馏策略,模型效果会存在一定损失。

如果要求qps>100

a.如果预算允许使用GPU,可尝试直接部署ERNIE相关预训练模型,推荐尝试ERNIE-tiny系列模型。

b.如果预算只允许使用CPU,可尝试CPU集群部署ERNIE相关预训练模型。

3.如果对部署性能要求不高,可随意尝试各种预训练模型。

4.性能细节请参考:模型预测与部署——预测性能

4.2 模型效果

1.一般来说,复杂的网络优于简单的网络,多样的特征优于单一的特征,有预训练模型的效果优于无预训练模型。

a.从模型复杂度来看,LSTM、GRU、CNN、BOW的复杂度与效果依次递减,速度依次提升。

2.一般来说,在预训练模型中,large优于base优于tiny,新版本的模型优于旧版本的模型,针对具体任务的预训练模型优于通用版预训练模型。

3.一般来说,在不欠拟合的情况下,训练数据越多模型效果越好,标注数据的质量越好效果越好。标注数据的质量优于数据的数量。

4.不同任务适合的网络结构并不相同,具体任务具体分析。

4.3硬件采购成本

1.GPU远贵于CPU,常用训练用GPU型号为V100、P40、K40,价格依次递减。

2.具体成本可参考百度云服务器-BCC-价格计算器

3.如果缺少训练资源,可通过文心平台版的免费共享队列进行训练,资源紧张,且用且珍惜。

4.4训练时间成本

1.GPU还是CPU

a.对于非ERNIE等复杂网络的模型,CPU的训练速度一般也能接受。 如果训练语料过多,数千万条以上,则建议采用CPU集群进行训练。

b.对于ERNIE模型,尽量采用GPU训练,CPU太慢,训练不起来。

- 1

- 2

- 3

2.怎么用好GPU

a.GPU并行训练能提升训练速度,建议优先把一个节点(trainer)的卡数用完,再考虑多机训练。因为单机多卡的GPU利用率更高,更快。而多机训练数据通信时间成本较高,时间更慢。

b.大原则:GPU利用率越高训练越快。

c.还有一点需要注意,多卡训练时是将不同的数据文件送给不同的卡,所以数据文件的个数要大于卡的个数。数据文件建议拆分细一些,这可以提升数据读取的速度。

d.熟练的同学可以尝试GPU多进程单机多卡训练、混合精度训练等方法,提升训练速度。

- 1

- 2

- 3

- 4

- 5

- 6

- 7

3.train_log_step、eval_step、save_model_step

a.分别表示每多少步打印训练日志、每多少步评估一次验证集、每多少步保存一次模型。

b.设置不当也会拖慢训练时间

c.一般建议三者依次放大十倍,如:10、100、1000

- 1

- 2

- 3

- 4

- 5

4.batch_size

a.设置过小容易收敛慢,设置过大容易超过显存极限直接挂掉

b.如果使用ERNIE,batch_size建议小一些,使用large版本建议更小一些,如果输入语句并不是很长可以适当增加batch_size。

c.如果不使用ERNIE,可以大一些。

d.建议使用默认配置,如果想优化可以采用二分查找

- 1

- 2

- 3

- 4

- 5

- 6

- 7

4.5 数据大小限制

1.一般建议标注语料越多越好。

2.非ERNIE模型一般需要几万至几百万条数据能收敛到较好的效果。

3.ERNIE模型一般需要几千至几万条数据即可收敛到较好效果。

a.一般不用ERNIE训练数百万条以上的数据,因为这会极大延长训练时间,增大资源消耗,而对效果的提升并不明显。自己有足够GPU资源的用户除外。

b.对于基线模型,建议在几万条数据上验证策略有效后再尝试增加数据量。

- 1

- 2

- 3

4.如果用ERNIE模型,最少需要多少样本才能取得效果

a.对于文本分类与序列标注,一般来说每个标签覆盖的样本数至少要超过200条才能有一定的效果。也就是说如果要进行50类多分类,就总共至少需要1万条样本。一般分类的类别越多任务越复杂。

4.6开发迭代成本

1.搭建环境成本

a.如果只想训练基线模型验证效果,可以考虑使用文心平台版,免去搭建环境的成本。

b.如果需要不断调试、迭代优化模型,而由于平台版集群资源紧张造成迭代周期过长,可以尝试使用工具版。

i:这会付出搭建环境的成本,但长痛不如短痛。

- 1

- 2

- 3

- 4

- 5

2.迭代效率

a.使用工具版本地调试成功后再上集群训练能极大提升迭代效率。

b.使用预训练模型能提升迭代效率。

c.基线模型,建议在几万条数据上验证策略,提升迭代效率。验证有效后再尝试增加数据量

- 1

- 2

- 3

- 4

- 5

5. 如何高效训练NLP任务

汇总诸多NLP算法同学的建议,我们把高效训练NLP任务的基本流程总结如下:

1.分析业务背景、明确任务输入与输出,将其抽象为已得到很好解决的NLP典型任务。

a.对于复杂任务,需要将其拆分成比较简单的子任务

b.文心已覆盖绝大部分NLP典型任务,可参考文心ERNIE工具版-支持任务。

- 1

- 2

- 3

- 4

2.准备好几千条格式规范的训练数据,快速实现一个NLP模型基线。

a.最快速的方法是通过文心ERNIE平台版或者工具版,采用预制网络和模型无代码训练一个模型基线。

b.本步骤只需要您知道最基本的机器学习概念,划分好训练集、验证集、测试集进行训练即可。

c.评估训练出模型的效果,看是否满足你的业务需求,如果不满足,可考虑进一步优化模型效果。

- 1

- 2

- 3

- 4

- 5

- 6

3.优化模型效果:

a.各优化手段按照投入产出比排序如下

i:进一步分析你的业务背景和需求,分析基线模型的不足,进行更细致的技术选型。

ii:采用工具版进行本地小数据调试,极大地提升迭代效率。

iii:基于预制网络进行调参。

iv:自定义组网并进行调参。

v:基于核心接口进行高度自定义开发。

vi:直接修改文心核心源码进行开发。

b.每一种优化手段都都可以申请vip服务进行支持。

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

如何自我判断采用哪种文心开发方式

典型的训练方式:无代码训练(不调参),无代码训练(自主调参),自定义组网训练,高阶自定义训练。

以上4类训练方式的开发自由度、上手难度、建模的风险、模型效果的上限依次递增,性价比依次递减。本地工具包的调试、迭代效率最高。

6.知识蒸馏相关技术【模型蒸馏、数据蒸馏】以ERNIE-Tiny为例

6.1.任务简介

基于ERNIE预训练模型效果上达到业界领先,但是由于模型比较大,预测性能可能无法满足上线需求。

直接使用ERNIE-Tiny系列轻量模型fine-tune,效果可能不够理想。如果采用数据蒸馏策略,又需要提供海量未标注数据,可能并不具备客观条件。

因此,本专题采用主流的知识蒸馏的方案来压缩模型,在满足用户预测性能、预测效果的需求同时,不依赖海量未标注数据,提升开发效率。

文心提供多种不同大小的基于字粒度的ERNIE-Tiny学生模型,满足不同用户的需求。

注:知识蒸馏(KD)是将复杂模型(teacher)中的dark

knowledge迁移到简单模型(student)中去,teacher具有强大的能力和表现,而student则更为紧凑。通过知识蒸馏,希望student能尽可能逼近亦或是超过teacher,从而用更少的复杂度来获得类似的预测效果。

6.1.1 模型蒸馏原理

知识蒸馏是一种模型压缩常见方法,指的是在teacher-student框架中,将复杂、学习能力强的网络(teacher)学到的特征表示"知识"蒸馏出来,传递给参数量小、学习能力弱的网络(student)。

在训练过程中,往往以最优化训练集的准确率作为训练目标,但真实目标其实应该是最优化模型的泛化能力。显然如果能直接以提升模型的泛化能力为目标进行训练是最好的,但这需要正确的关于泛化能力的信息,而这些信息通常不可用。如果我们使用由大型模型产生的所有类概率作为训练小模型的目标,就可以让小模型得到不输大模型的性能。这种把大模型的知识迁移到小模型的方式就是蒸馏。

基本原理可参考Hinton经典论文:https://arxiv.org/abs/1503.02531

6.1.2 ERNIE-Tiny 模型蒸馏

- 模型蒸馏原理可参考论文 ERNIE-Tiny : A Progressive Distillation Framework for Pretrained Transformer Compression 2021。不同于原论文的实现,为了和开发套件中的通用蒸馏学生模型保持一致,我们将蒸馏loss替换为Attention矩阵的KQ loss和 VV loss,原理可参考论文 MiniLM: Deep Self-Attention Distillation for Task-Agnostic Compression of Pre-Trained Transformers 2020 和 MiniLMv2: Multi-Head Self-Attention Relation Distillation for Compressing Pretrained Transformers 2021。实验表明通用蒸馏阶段和任务蒸馏阶段的蒸馏loss不匹配时,学生模型的效果会受到影响。

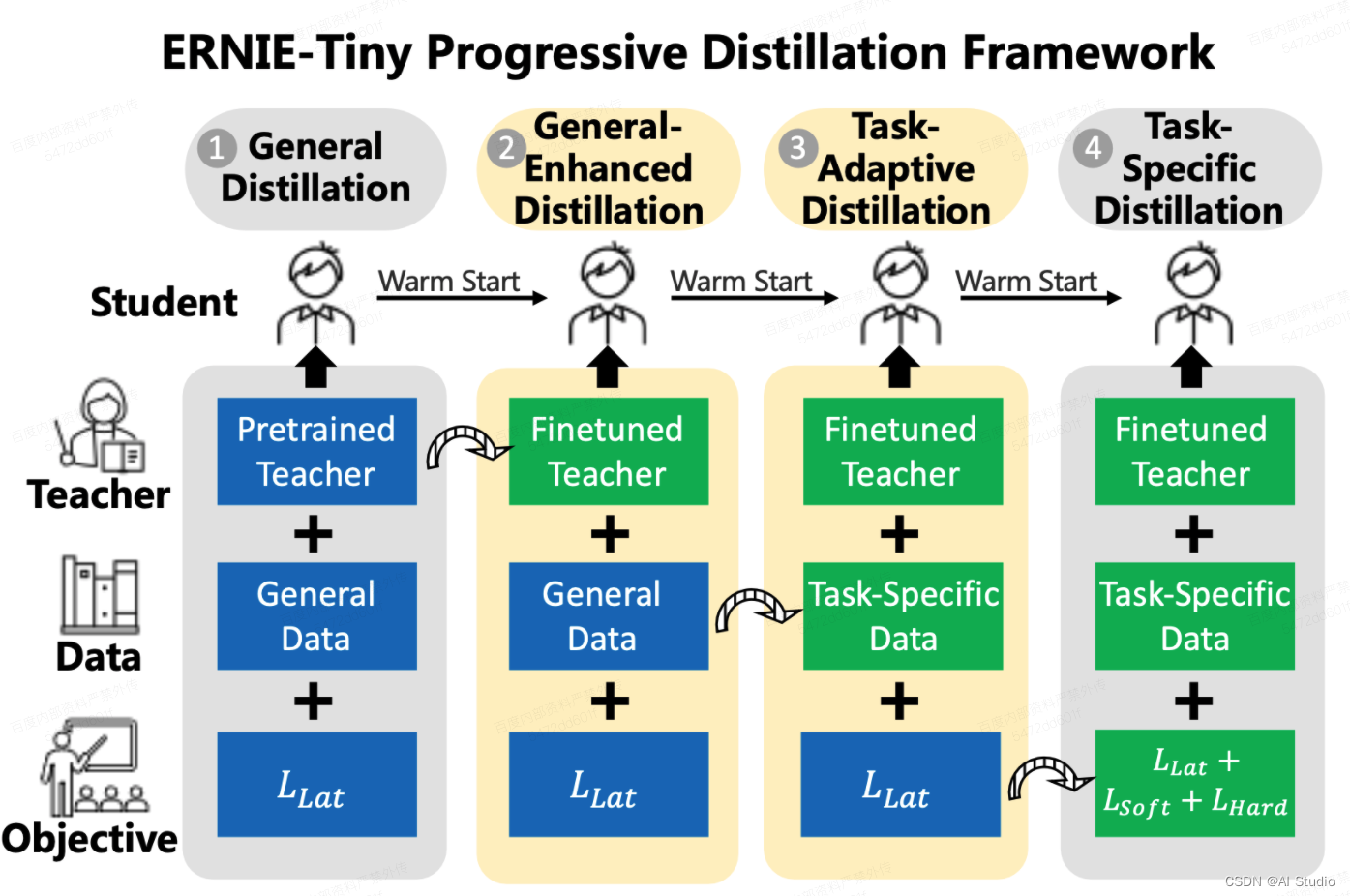

BERT 等预训练语言模型 (PLM) 采用了一种训练范式,首先在一般数据中预训练模型,然后在特定任务数据上微调模型,最近取得了巨大成功。然而,PLM 因其庞大的参数而臭名昭著,并且难以部署在现实生活中的应用程序中。知识蒸馏通过在一组数据上将知识从大老师转移到小得多的学生来解决这个问题。我们认为选择三个关键组成部分,即教师、训练数据和学习目标,对于蒸馏的有效性至关重要。因此,我们提出了一个四阶段渐进式蒸馏框架 ERNIE-Tiny 来压缩 PLM,它将三个组件从一般级别逐渐变化到特定任务级别。具体来说,第一阶段,General Distillation,在预训练的老师、一般数据和潜在蒸馏损失的指导下进行蒸馏。然后,General-Enhanced Distillation 将教师模型从预训练教师转变为微调教师。之后,Task-Adaptive Distillation 将训练数据从一般数据转移到特定于任务的数据。最后,Task-Specific Distillation 在最后阶段增加了两个额外的损失,即 Soft-Label 和 Hard-Label 损失。实证结果证明了我们的框架的有效性和所带来的泛化增益 。实验表明 4 层 ERNIE-Tiny 在 GLUE 基准测试的基础上保持其 12 层教师 BERT 的 98.0% 以上的性能,超过最先进的 (SOTA) 1.0% 的 GLUE 分数相同数量的参数。此外,ERNIE-Tiny 在五个中文 NLP 任务上实现了新的压缩 SOTA,比 BERT 基础的精度高 0.4%,参数减少 7.5 倍,推理速度加快 9.4 倍。

预训练的语言模型(例如,BERT (Devlin et al., 2018) 及其变体)在各种 NLP 任务中取得了显着的成功。然而,这些模型通常包含数亿个参数,由于延迟和容量限制,这给现实应用中的微调和在线服务带来了挑战。在这项工作中,我们提出了一种简单有效的方法来压缩基于大型 Transformer (Vaswani et al., 2017) 的预训练模型,称为深度自注意力蒸馏。小模型(学生)通过深度模仿大模型(老师)的自注意力模块进行训练,该模块在 Transformer 网络中起着至关重要的作用。具体来说,我们建议提炼出教师最后一个 Transformer 层的自注意力模块,这对学生来说既有效又灵活。此外,除了现有作品中使用的注意力分布(即查询和键的缩放点积)之外,我们还引入了自我注意模块中值之间的缩放点积作为新的深度自我注意知识. 此外,我们表明,引入教师助理(Mirzadeh 等人,2019 年)也有助于提炼大型预训练 Transformer 模型。实验结果表明,我们的单语模型在不同参数大小的学生模型中优于最先进的基线。特别是,它使用 50% 的 Transformer 参数和教师模型的计算在 SQuAD 2.0 和几个 GLUE 基准测试任务上保持了 99% 以上的准确率。我们还在将深度自注意力蒸馏应用于多语言预训练模型方面获得了竞争性结果。

我们仅使用自注意力关系蒸馏来对预训练的 Transformer 进行任务不可知的压缩,从而在 MiniLM (Wang et al., 2020) 中推广深度自注意力蒸馏。特别是,我们将多头自注意力关系定义为每个自注意力模块内的查询、键和值向量对之间的缩放点积。然后我们利用上述关系知识来训练学生模型。除了简单统一的原则外,更有利的是,学生的注意力头数没有限制,而之前的大多数工作都必须保证教师和学生之间的头数相同。此外,细粒度的自注意力关系倾向于充分利用 Transformer 学习到的交互知识。此外,我们彻底检查了教师模型的层选择策略,而不是像 MiniLM 中那样仅仅依赖最后一层。我们对压缩单语和多语预训练模型进行了广泛的实验。实验结果表明,我们从基础规模和大型教师(BERT、RoBERTa 和 XLM-R)中提取的模型优于最先进的模型。

-

二阶段蒸馏:

- 通用蒸馏(General Distillation,GD):在预训练阶段训练,使用大规模无监督的数据, 帮助学生网络学习到尚未微调的教师网络中的知识,有利于提高泛化能力。为方便用户使用,我们提供了多种尺寸的通用蒸馏学生模型,可用的通用蒸馏学生模型可参考文档:通用模型 - ERNIE3.0 Tiny。

- 任务蒸馏(Task-specific Distillation,TD):使用具体任务的数据,学习到更多任务相关的具体知识。

-

如果已提供的通用蒸馏学生模型尺寸符合需求,用户可以主要关注接下来的任务蒸馏过程。

6.1.3任务蒸馏步骤

- FT阶段:基于ERNIE 3.0 Large蒸馏模型fine-tune得到教师模型,注意这里用到的教师模型和ERNIE 3.0 Large是两个不同的模型;

- GED阶段(可选):使用fine-tuned教师模型和通用数据继续用通用蒸馏的方式蒸馏学生模型,进一步提升学生模型的效果;

a. 热启动fine-tuned的教师模型和通用学生模型。其中,通用的学生模型由文心平台提供,从bos上下载。

- TD1阶段:蒸馏中间层

a.只对学生模型的最后一层进行蒸馏,将学生模型transformer的attention层的k-q矩阵和v-v矩阵与教师模型的对应矩阵做KLloss,可参考 :MiniLMV2。

b.热启动fine-tuned的教师模型和GED阶段得到的学生模型。其中,通用的学生模型由文心平台提供,从bos上下载,下载链接所在文档:通用模型ERNIE3.0 Tiny,或参考预置的下载脚本:

c. 反向传播阶段只更新学生模型参数,教师模型参数不更新;

- TD2阶段:蒸馏预测层,产出最终的学生模型。

a. 热启动fine-tuned的教师模型和TD1阶段训练的学生模型;

b. loss包括两部分: 1) pred_loss:软标签,学生模型的预测层输出与教师模型的预测层输出的交叉熵; 2)

student_ce_loss:硬标签,学生模型的预测层输出与真实label的交叉熵;c. pred_loss与student_ce_loss之和作为最终loss,进行反向传播;

d. 反向传播阶段只更新学生模型参数,教师模型参数不更新;

注:关于GED阶段使用的通用数据:开发套件中的通用数据是由开源项目 https://github.com/brightmart/nlp_chinese_corpus 中的中文维基百科语料(wiki2019zh)经过预处理得到。该数据只用于demo展示,实际使用时替换为业务无标注数据效果提升更明显。

6.2. 常见问题

问题1:怎么修改学生模型的层数?上面提供了多种不同的学生模型,但每个学生模型的层数、hidden size等都是固定的,如果想更改,需要在哪些地方更改?

文心提供了三种不同结构的预训练学生模型,如果修改层数、hidden size等,会导致预训练学生模型参数无法加载,在此情况下,蒸馏出来的学生模型效果无法保证,建议用户还是使用文心提供的预训练模型,不更改模型结构;如果用户认为更改学生模型的结构非常有必要,需要对文心做以下改动:

- 修改TD1阶段json配置文件的pre_train_model配置项,删除预训练学生模型的加载,只保留微调后的教师模型

"pre_train_model": [

# 热启动fine-tune的teacher模型

{

"name": "finetuned_teacher_model",

"params_path": "./output/cls_ernie_3.0_large_ft/save_checkpoints/checkpoints_step_6000"

}

]

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 将json文件中的"student_embedding"替换为自定义的学生模型

"student_embedding": {

"config_path": "../../models_hub/ernie_3.0_tiny_ch_dir/ernie_config.json"

},

- 1

- 2

- 3

- 4

- 再次强调,上述修改后,由于无法加载预训练学生模型,蒸馏出来的学生模型效果无法保证。(用户训练数据量到百万样本以上可以考虑尝试一下)

6.3.数据蒸馏任务

6.3.1 简介

在ERNIE强大的语义理解能力背后,是需要同样强大的算力才能支撑起如此大规模模型的训练和预测。很多工业应用场景对性能要求较高,若不能有效压缩则无法实际应用。

因此,我们基于数据蒸馏技术构建了数据蒸馏系统。其原理是通过数据作为桥梁,将ERNIE模型的知识迁移至小模型,以达到损失很小的效果却能达到上千倍的预测速度提升的效果。

目录结构

数据蒸馏任务位于 wenxin_appzoo/tasks/data_distillation

├── data │ ├── dev_data │ ├── dict │ ├── download_data.sh │ ├── predict_data │ ├── test_data │ └── train_data ├── distill │ └── chnsenticorp │ ├── student │ └── teacher ├── examples │ ├── cls_bow_ch.json │ ├── cls_cnn_ch.json │ ├── cls_ernie_fc_ch_infer.json │ └── cls_ernie_fc_ch.json ├── inference │ ├── custom_inference.py │ ├── __init__.py ├── model │ ├── base_cls.py │ ├── bow_classification.py │ ├── cnn_classification.py │ ├── ernie_classification.py │ ├── __init__.py ├── run_distill.sh ├── run_infer.py ├── run_trainer.py └── trainer ├── custom_dynamic_trainer.py ├── __init__.py

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

6.3.2 数据准备

目前采用三种数据增强策略策略,对于不用的任务可以特定的比例混合。三种数据增强策略包括:

(1)添加噪声:对原始样本中的词,以一定的概率(如0.1)替换为”UNK”标签

(2)同词性词替换:对原始样本中的所有词,以一定的概率(如0.1)替换为本数据集中随机一个同词性的词

(3)N-sampling:从原始样本中,随机选取位置截取长度为m的片段作为新的样本,其中片段的长度m为0到原始样本长度之间的随机值

数据增强策略可参考数据增强,我们已准备好了采用上述3种增强策略制作的chnsenticorp的增强数据。

6.3.3 离线蒸馏

- 使用预置的ERNIE 2.0 base模型

cd wenxin_appzoo/models_hub

bash download_ernie_2.0_base_ch.sh

- 1

- 2

- 3

- 下载预置的原始数据以及增强数据。

cd wenxin_appzoo/tasks/data_distillation/distill

bash download_data.sh

- 1

- 2

- 3

- 运行以下命令,开始数据蒸馏

cd wenxin_appzoo/tasks/data_distillation

bash run_distill.sh

- 1

- 2

- 3

6.3.3.1蒸馏过程说明

- run_distill.sh脚本会进行前述的三步:

在任务数据上Fine-tune;

加载Fine-tune好的模型对增强数据进行打分;

使用Student模型进行训练。脚本采用hard-label蒸馏,在第二步中将会直接预测出ERNIE标注的label。

- run_distill.sh脚本涉及教师和学生模型的json文件,其中:

./examples/cls_ernie_fc_ch.json负责教师模型的finetune,

./examples/cls_ernie_fc_ch_infer.json 负责教师模型的预测。 ./examples/cls_cnn_ch.json,负责学生模型的训练。

- 事先构造好的增强数据放在./distill/chnsenticorp/student/unsup_train_aug

- 在脚本的第二步中,使用 ./examples/cls_ernie_fc_ch_infer.json 进行预测:脚本从标准输入获取明文输入,并将打分输出到标准输出。用这种方式对数据增强后的无监督训练预料进行标注。最终的标注结果放在 ./distill/chnsenticorp/student/train/part.1文件中。标注结果包含两列, 第一列为明文,第二列为标注label。

- 在第三步开始student模型的训练,其训练数据放在 distill/chnsenticorp/student/train/ 中,part.0 为原监督数据 part.1 为 ERNIE 标注数据。

- 注:如果用户已经拥有了无监督数据,则可以将无监督数据放入distill/chnsenticorp/student/unsup_train_aug 即可。

7总结:需掌握知识

7.1 无代码调参建议具备的相关知识

1.明确以下概念:有监督学习、标签、特征、训练集、验证集、测试集、逻辑回归、过拟合、欠拟合、激活函数、损失函数、神经网络、学习率、正则化、epoch、batch_size、分词、统计词表。

2.知道回归与分类的区别。

3.知道如何通过收敛曲线判断过拟合与欠拟合。

4.知道准确率、召回率、精确度、F1值、宏平均、微平均的概念与区别。

5.知道为什么训练集、验证集、测试集要保证独立同分布。

6.知道什么是神经网络.

7.知道什么是迁移学习、什么是预训练模型、什么是finetune、迁移学习的优点是什么。

7.2 自定义组网建议具备的相关知识

1.前提是已经掌握无代码调参建议具备的相关知识

2.明确以下概念:Sigmoid函数公式、softmax函数公式、交叉熵公式、前向传播、反向传播、SGD、Adam、词向量、embedding、dropout、BOW、CNN、RNN、GRU、LSTM、迁移学习、

3.知道神经网络为什么具有非线性切分能力。

4.知道NLP中一维CNN中的卷积核大小、卷积核的个数各指代什么,时序最大池化层如何操作。

5.知道NLP中CNN与LSTM的区别,各擅长处理哪类文本问题。

6.知道为什么BOW模型无法识别词语顺序关系。

7.知道为什么会梯度爆炸,以及如何解决。

参考书籍:

a.ML特征工程和优化方法

b.周志华《机器学习》前3章

c.迁移学习常见问题

a.CNN常见问题

b.深度学习优化方法

c.花书《深度学习》6-10章

d.《基于深度学习的自然语言处理》整本

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

项目参考链接:https://ai.baidu.com/ai-doc/ERNIE-Ultimate/pl580cszk

https://ai.baidu.com/ai-doc/ERNIE-Ultimate/Hl57xuabm

万字长文综述:给你的数据加上杠杆——文本增强技术的研究进展及应用实践:https://zhuanlan.zhihu.com/p/122445216

- 1

此文章为搬运

原项目链接

- 相关标签

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。