- 1pycharm使用虚拟环境中的环境_退出pycharm的模拟

- 2word2vec&fastText_word2vec输出的是 隐藏层还是输出层

- 3安装VMware Workstation Pro虚拟机步骤

- 4安装Pytorch时出现ERROR: Could not find a version that satisfies the requirement...的解决方法

- 5Kotlin 踩坑日记(三) Android Studio 3.0.0 Canary 编译错误_kotlinyour project may be using a third-party plug

- 6uni-app adb安卓wifi无线调试_无线调试failed to connect to 10.3.4.236:37583

- 7bert-modeling代码学习_modelingbert

- 8对比学习在NLP中应用全面解读_对比学习为什么可以用于情感分析

- 9vue——scss变量全局使用_如何在vue中使用scss全局颜色变量

- 10YOLO v9训练自己数据集_yolov9训练自己的数据集

深度学习笔记(5)_池化层输出的是什么

赞

踩

一、卷积神经网络基础

二维卷积层

常用于处理图像数据

二维互相关运算

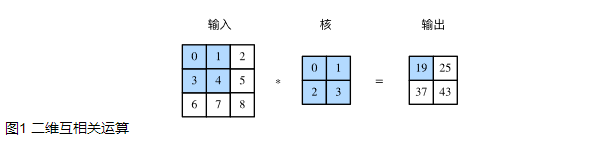

二维互相关(cross-correlation)运算的输入是一个二维输入数组和一个二维核(kernel)数组,输出也是一个二维数组,其中核数组通常称为卷积核或过滤器(filter)。卷积核的尺寸通常小于输入数组,卷积核在输入数组上滑动,在每个位置上,卷积核与该位置处的输入子数组按元素相乘并求和,得到输出数组中相应位置的元素。图1展示了一个互相关运算的例子,阴影部分分别是输入的第一个计算区域、核数组以及对应的输出。

二维卷积层

二维卷积层将输入和卷积核做互相关运算,并加上一个标量偏置来得到输出。卷积层的模型参数包括卷积核和标量偏置。

互相关运算与卷积运算

卷积层得名于卷积运算,但卷积层中用到的并非卷积运算而是互相关运算。将核数组上下翻转、左右翻转,再与输入数组做互相关运算,这一过程就是卷积运算。由于卷积层的核数组是可学习的,所以使用互相关运算与使用卷积运算并无本质区别。

特征图与感受野

二维卷积层输出的二维数组可以看作是输入在空间维度(宽和高)上某一级的表征,也叫特征图(feature map)。影响元素 x 的前向计算的所有可能输入区域(可能大于输入的实际尺寸)叫做 x 的感受野(receptive field)。

以图1为例,输入中阴影部分的四个元素是输出中阴影部分元素的感受野。我们将图中形状为 2×2 的输出记为 Y ,将 Y 与另一个形状为 2×2 的核数组做互相关运算,输出单个元素 z 。那么, z 在 Y 上的感受野包括 Y 的全部四个元素,在输入上的感受野包括其中全部9个元素。可见,我们可以通过更深的卷积神经网络使特征图中单个元素的感受野变得更加广阔,从而捕捉输入上更大尺寸的特征。

填充和步幅

卷积层的两个超参数,即填充和步幅,它们可以对给定形状的输入和卷积核改变输出形状。

填充

步幅

多输入通道和多输出通道

多输入通道

多输出通道

卷积层与全连接层的对比

二维卷积层经常用于处理图像,与此前的全连接层相比,它主要有两个优势:

一是全连接层把图像展平成一个向量,在输入图像上相邻的元素可能因为展平操作不再相邻,网络难以捕捉局部信息。而卷积层的设计,天然地具有提取局部信息的能力。

二是卷积层的参数量更少。不考虑偏置的情况下,一个形状为

(

c

i

,

c

o

,

h

,

w

)

(c_i,c_o,h,w)

(ci,co,h,w) 的卷积核的参数量是

c

i

×

c

o

×

h

×

w

c_i×c_o×h×w

ci×co×h×w ,与输入图像的宽高无关。假如一个卷积层的输入和输出形状分别是

(

c

1

,

h

1

,

w

1

)

和

(

c

2

,

h

2

,

w

2

)

(c_1,h_1,w_1) 和 (c_2,h_2,w_2)

(c1,h1,w1)和(c2,h2,w2) ,如果要用全连接层进行连接,参数数量就是

c

1

×

c

2

×

h

1

×

w

1

×

h

2

×

w

2

c_1×c_2×h_1×w_1×h_2×w_2

c1×c2×h1×w1×h2×w2 。使用卷积层可以以较少的参数数量来处理更大的图像。

池化

二维池化层

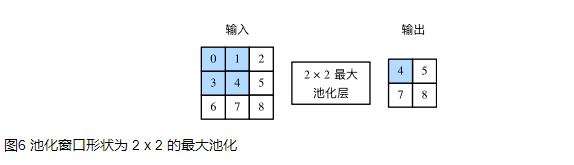

池化层主要用于缓解卷积层对位置的过度敏感性。同卷积层一样,池化层每次对输入数据的一个固定形状窗口(又称池化窗口)中的元素计算输出,池化层直接计算池化窗口内元素的最大值或者平均值,该运算也分别叫做最大池化或平均池化。图6展示了池化窗口形状为 2×2 的最大池化。

二维平均池化的工作原理与二维最大池化类似,但将最大运算符替换成平均运算符。池化窗口形状为 p×q 的池化层称为 p×q 池化层,其中的池化运算叫作 p×q 池化。

池化层也可以在输入的高和宽两侧填充并调整窗口的移动步幅来改变输出形状。池化层填充和步幅与卷积层填充和步幅的工作机制一样。

在处理多通道输入数据时,池化层对每个输入通道分别池化,但不会像卷积层那样将各通道的结果按通道相加。这意味着池化层的输出通道数与输入通道数相等。

二、leNet

全连接层的局限性:

图像在同一列邻近的像素在这个向量中可能相距较远。它们构成的模式可能难以被模型识别。

对于大尺寸的输入图像,使用全连接层容易导致模型过大。

卷积层的优势:

卷积层保留输入形状。

卷积层通过滑动窗口将同一卷积核与不同位置的输入重复计算,从而避免参数尺寸过大。

eNet分为卷积层块和全连接层块两个部分。

卷积神经网络就是含卷积层的网络。 LeNet交替使用卷积层和最大池化层后接全连接层来进行图像分类

三、卷积神经网络进阶

LeNet: 在大的真实数据集上的表现并不尽如⼈意。

1.神经网络计算复杂。

2.还没有⼤量深⼊研究参数初始化和⾮凸优化算法等诸多领域。

机器学习的特征提取:手工定义的特征提取函数

神经网络的特征提取:通过学习得到数据的多级表征,并逐级表⽰越来越抽象的概念或模式。

神经网络发展的限制:数据、硬件

AlexNet特征:

1、8层变换,其中有5层卷积和2层全连接隐藏层,以及1个全连接输出层。

2、将sigmoid激活函数改成了更加简单的ReLU激活函数。

3、用Dropout来控制全连接层的模型复杂度。

4、引入数据增强,如翻转、裁剪和颜色变化,从而进一步扩大数据集来缓解过拟合。

使用重复元素的网络(VGG)

VGG:通过重复使⽤简单的基础块来构建深度模型。

Block:数个相同的填充为1、窗口形状为 3×3 的卷积层,接上一个步幅为2、窗口形状为 2×2 的最大池化层。

卷积层保持输入的高和宽不变,而池化层则对其减半。

⽹络中的⽹络(NiN)

LeNet、AlexNet和VGG:先以由卷积层构成的模块充分抽取 空间特征,再以由全连接层构成的模块来输出分类结果。

NiN:串联多个由卷积层和“全连接”层构成的小⽹络来构建⼀个深层⽹络。

⽤了输出通道数等于标签类别数的NiN块,然后使⽤全局平均池化层对每个通道中所有元素求平均并直接⽤于分类。

GoogLeNet

1、由Inception基础块组成。

2、Inception块相当于⼀个有4条线路的⼦⽹络。它通过不同窗口形状的卷积层和最⼤池化层来并⾏抽取信息,并使⽤1×1卷积层减少通道数从而降低模型复杂度。

3、可以⾃定义的超参数是每个层的输出通道数,以此来控制模型复杂度。

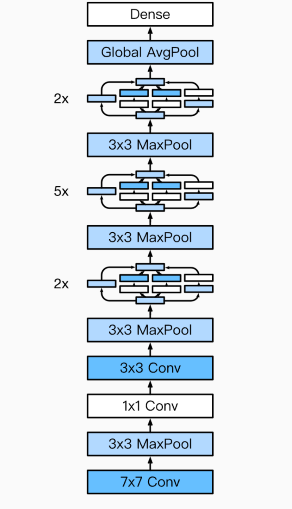

完整模型结构