热门标签

热门文章

- 1Linux 安全指南

- 2FPGA具有什么强大的功能,竟然可以代替CPU和GPU?_fpga芯片可以做cpu和gpu

- 3如何巧妙避开AI文章检测?5大绝招一次get_防ai检测

- 4斯坦福大学NLP课程CS224N课第一次作业第三部分(中)_stanford nlp课后作业答案

- 5GitHub的原理及应用详解(三)

- 6谷歌用Bard打响了Chat GPT的第一枪,百度版Chat GPT 何时出炉?

- 7unity HoloLens2开发,使用Vuforia识别实体 触发交互(二)(有dome)_hololens物体识别

- 8最新!基于autoxjs写的一个猫眼抢票脚本,自动点击_猫眼绕过缺货登记代码

- 9Hadoop大数据简介

- 10【红米K40手机反复重启解决方案】_红米k40开机键下陷自修方法

当前位置: article > 正文

5-SQL注入问题及结局办法、视图、触发器、事务、存储过程(基本使用、三种开发模型、创建存储过程、如何使用存储过程)、mysql函数、流程控制、索引和联合索引_sql注入问题解决及事务隔离性演示结果分析

作者:小丑西瓜9 | 2024-05-30 01:26:11

赞

踩

sql注入问题解决及事务隔离性演示结果分析

一、SQL注入问题

1.问题

import pymysql conn = pymysql.connect( host='localhost', port=3306, user='root', passwd='root', database='db10', charset='utf8', autocommit=True ) cursor = conn.cursor(cursor=pymysql.cursors.DictCursor) username = input('用户名:').strip() password = input('密码:').strip() # 注入问题 sql = "select * from userinfo where username='%s' and password='%s' " % (username, password) print(sql) affect_rows = cursor.execute(sql) res = cursor.fetchone() if res: print('登录成功') else: print('登录失败')

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

2.解决办法

import pymysql conn = pymysql.connect( host='localhost', port=3306, user='root', passwd='root', database='db10', charset='utf8', autocommit=True ) cursor = conn.cursor(cursor=pymysql.cursors.DictCursor) username = input('用户名:').strip() password = input('密码:').strip() # 注入问题 sql = "select * from userinfo where username=%s and password=%s " print(sql) affect_rows = cursor.execute(sql, (username, password)) # 可能有正则过滤 res = cursor.fetchone() if res: print('登录成功') else: print('登录失败') 注意: # 1.只需要用户名也可以登录 username:>>> kevin ' -- ddasfdfsdfdsfsdfsdfsdfdsfsdfsd username:>>> xxx ' or 1=1 # 2.不需要用户名和密码也可以登录 """ SQL注入的原因 是由于特殊符号的组合会产生特殊的效果 实际生活中 尤其是在注册用户名的时候 会非常明显的提示你很多特殊符号不能用 原因也是一样的 结论:设计到敏感数据部分 不要自己拼接 交给现成的方法拼接即可 """ # sql = 'insert into userinfo(name,pwd) values("jason","123"),("kevin","321")' # res = cursor.execute(sql) # print(res) """ 在使用代码进行数据操作的时候 不同操作的级别是不一样的 针对查无所谓 针对增 改 删都需要二次确认 conn.commit() """

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

二、视图

1. 什么是视图? 视图就是通过查询得到一张虚拟表,然后保存下来,下次直接使用即可 2. 为什么要用视图? 如果频繁使用一张虚拟表,可以不用重复查询 3. 如何使用视图? 创建视图 create view teacher2course as select * from teacher inner join course on teacher.tid = course.teacher_id; """ 创建好了之后 验证它的存在navicat验证 cmd终端验证 最后文件验证 得出下面的结论 视图只有表结构数据还是来源于之前的表 delete from teacher2course where id=1; """ 强调注意: 1、在硬盘中,视图只有表结构文件,没有表数据文件 2、视图通常是用于查询,尽量不要修改视图中的数据 删除视图 drop view teacher2course; 4. 思考:开发过程中会不会去使用视图? 不会!视图是mysql的功能,如果你的项目里面大量的使用到了视图,那意味着你后期想要扩张某个功能的时候这个功能恰巧又需要对视图进行修改,意味着你需要先在mysql这边将视图先修改一下,然后再去应用程序中修改对应的sql语句,这就涉及到跨部门沟通的问题,所以通常不会使用视图,而是通过重新修改sql语句来扩展功能

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

三、触发器

1. 什么是触发器? 在满足对某张表数据的增、删、改的情况下,自动触发的功能称之为触发器 2. 为何要用触发器? 触发器专门针对我们对某一张表数据增insert、删delete、改update的行为,这类行为一旦执行,就会触发触发器的执行,即自动运行另外一段sql代码 3. 创建触发器语法 """语法结构 create trigger 触发器的名字 before/after insert/update/delete on 表名 for each row begin sql语句 end """ # 针对插入 create trigger tri_after_insert_t1 after insert on 表名 for each row begin sql代码。。。 end create trigger tri_after_insert_t2 before insert on 表名 for each row begin sql代码。。。 end # 针对删除 create trigger tri_after_delete_t1 after delete on 表名 for each row begin sql代码。。。 end create trigger tri_after_delete_t2 before delete on 表名 for each row begin sql代码。。。 end # 针对修改 create trigger tri_after_update_t1 after update on 表名 for each row begin sql代码。。。 end create trigger tri_after_update_t2 before update on 表名 for each row begin sql代码。。。 end """ 需要注意 在书写sql代码的时候结束符是; 而整个触发器的结束也需要分号; 这就会出现语法冲突 需要我们临时修改结束符号 delimiter $$ delimiter ; 该语法只在当前窗口有效 """ # 案例 CREATE TABLE cmd ( id INT PRIMARY KEY auto_increment, USER CHAR (32), priv CHAR (10), cmd CHAR (64), sub_time datetime, #提交时间 success enum ('yes', 'no') #0代表执行失败 ); CREATE TABLE errlog ( id INT PRIMARY KEY auto_increment, err_cmd CHAR (64), err_time datetime ); delimiter $$ # 将mysql默认的结束符由;换成$$ create trigger tri_after_insert_cmd after insert on cmd for each row begin if NEW.success = 'no' then # 新记录都会被MySQL封装成NEW对象 insert into errlog(err_cmd,err_time) values(NEW.cmd,NEW.sub_time); end if; end $$ delimiter ; # 结束之后记得再改回来,不然后面结束符就都是$$了 #往表cmd中插入记录,触发触发器,根据IF的条件决定是否插入错误日志 INSERT INTO cmd ( USER, priv, cmd, sub_time, success ) VALUES ('egon','0755','ls -l /etc',NOW(),'yes'), ('egon','0755','cat /etc/passwd',NOW(),'no'), ('egon','0755','useradd xxx',NOW(),'no'), ('egon','0755','ps aux',NOW(),'yes'); 查询errlog表记录 select * from errlog; 删除触发器 drop trigger tri_after_insert_cmd;

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

- 88

- 89

- 90

- 91

- 92

- 93

- 94

四、事务

1. 什么是事务? 开启一个事务可以包含一些sql语句,这些sql语句要么同时成功,要么同时失败, 我们称之为事务的原子性。 2. 事务的作用 保证了对数据操作的'数据安全性' 案例:用交行的卡操作建行ATM机给工商的账户转钱 3. 事务应具有4个属性:原子性、一致性、隔离性、持久性。这四个属性通常称为'ACID特性'. 原子性(atomicity)。一个事务是一个不可分割的工作单位,事务中包括的诸操作要么都做,要么都不做。 一致性(consistency)。事务必须是使数据库从一个一致性状态变到另一个一致性状态。一致性与原子性是密切相关的。 隔离性(isolation)。一个事务的执行不能被其他事务干扰。即一个事务内部的操作及使用的数据对并发的其他事务是隔离的,并发执行的各个事务之间不能互相干扰。 持久性(durability)。持久性也称永久性(permanence),指一个事务一旦提交,它对数据库中数据的改变就应该是永久性的。接下来的其他操作或故障不应该对其有任何影响。 4. 如何用 先介绍事务的三个关键字 再去用表实际展示效果 start transaction; 代码... commit; rollback; create table user( id int primary key auto_increment, name char(32), balance int ); insert into user(name,balance) values ('jason',1000), ('egon',1000), ('tank',1000); 修改数据之前先开启事务操作 start transaction; 修改操作 update user set balance=900 where name='jason'; #买支付100元 update user set balance=1010 where name='egon'; #中介拿走10元 update user set balance=1090 where name='tank'; #卖家拿到90元 回滚到上一个状态 rollback; 开启事务之后,只要没有执行commit操作,数据其实都没有真正刷新到硬盘 commit; """开启事务检测操作是否完整,不完整主动回滚到上一个状态,如果完整就应该执行commit操作""" 站在python代码的角度,应该实现的伪代码逻辑, try: update user set balance=900 where name='jason'; #买支付100元 update user set balance=1010 where name='egon'; #中介拿走10元 update user set balance=1090 where name='tank'; #卖家拿到90元 except 异常: rollback; else: commit; 5.那如何检测异常? 事务要尽量少的开 不要写一个SQL语句都写到事务里面去 在MySQL中,可以通过以下方法检测事务的异常: 1. 检查事务的返回状态(Return Status):在执行事务提交或回滚后,可以检查事务的返回状态来确定是否发生了异常。 在MySQL中,如果事务执行成功,则返回状态为`COMMIT`,如果事务执行失败,则返回状态为`ROLLBACK`。 2. 检查数据库错误信息(Error Information):MySQL提供了一些错误信息和错误代码,可以通过检查这些错误信息来判断是否发生了异常。 可以使用`SHOW ENGINE INNODB STATUS`命令来查看最近执行的事务的详细信息,其中包括错误信息和错误代码。 3. 检查事务日志(Transaction Log):MySQL的事务日志记录了所有的事务操作,包括事务的开始、提交、回滚等。 通过检查事务日志,可以确定事务是否已经完成或回滚。 可以使用`SHOW ENGINE INNODB STATUS`命令中的`TRANSACTIONS`部分来查看当前活动的事务信息。 4. 检查数据库表的状态:如果事务异常导致了数据的不一致或冲突,可以检查相关数据库表的状态来确定异常的发生。 例如,检查主键约束、唯一索引、外键关系等是否被破坏,或者检查数据的完整性和一致性。 5. 监控和记录日志:通过在应用程序中添加监控和记录日志的机制,可以及时捕捉和记录事务的异常。 在事务执行过程中,可以记录相关的错误信息、异常堆栈信息以及其他有用的上下文信息,以便后续分析和排查问题。 需要根据具体情况选择合适的方法来检测事务的异常。同时,合理的错误处理和异常处理机制也是保证事务执行的可靠性和一致性的重要手段。 6.事务的隔离级别 事务的隔离级别是指多个并发事务之间的隔离程度,它们定义了一个事务能够看到其他事务所做的更改的方式。MySQL支持四个标准的隔离级别,每个级别都具有不同的特性和影响: 1. 读未提交(Read Uncommitted):最低的隔离级别。在这个级别下,一个事务可以看到其他事务尚未提交的修改。这种隔离级别存在脏读(Dirty Read)的问题,即读取到了未提交的数据。 2. 读已提交(Read Committed):这是MySQL的默认隔离级别。在这个级别下,一个事务只能看到其他已经提交的事务所做的修改。这种隔离级别解决了脏读的问题,但可能会遇到不可重复读(Non-repeatable Read)问题,即在同一个事务中,多次读取同一数据可能得到不同的结果。 3. 可重复读(Repeatable Read):在这个级别下,一个事务在执行期间看到的数据保持一致,即使其他事务对数据做了修改并提交。这种隔离级别解决了不可重复读的问题,但可能会遇到幻读(Phantom Read)问题,即在同一个事务中,多次查询同一范围的数据可能返回不同的行数。 4. 串行化(Serializable):最高的隔离级别。在这个级别下,事务按顺序依次执行,相当于对数据库的读写操作进行了串行化。这种隔离级别可以避免脏读、不可重复读和幻读的问题,但会导致并发性能下降,通常只在特殊情况下使用。 你可以使用以下语句设置事务的隔离级别: SET TRANSACTION ISOLATION LEVEL <isolation_level>; 其中,`<isolation_level>`可以是`READ UNCOMMITTED`、`READ COMMITTED`、`REPEATABLE READ`或`SERIALIZABLE`。 需要注意的是,隔离级别的提升会增加数据库的锁竞争和资源消耗,因此需要根据具体情况选择适当的隔离级别,以平衡数据一致性和性能要求。 脏读是指一个事务读取了另一个事务尚未提交的数据。假设有两个事务,事务 A 在读取数据时,事务 B 修改了这些数据并尚未提交。如果事务 A 读取了事务 B 修改的数据,而后事务 B 回滚或提交失败,那么事务 A 就读取了无效的数据,这就是脏读。 幻读(Phantom Read):幻读是指一个事务在同一范围内多次查询时,得到了不同数量的行。假设有两个事务,事务 A 在查询某个范围内的数据时,事务 B 插入了一些符合该范围的新数据,并提交。当事务 A 再次查询该范围时,会发现有新增的数据出现,就像出现了幻觉一样,因此称为幻读。

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

- 88

- 89

- 90

- 91

- 92

- 93

- 94

- 95

- 96

五、存储过程

1.基本使用

存储过程:存储过程包含了一系列可执行的sql语句,存储过程存放于MySQL中,通过调用它的名字可以执行其内部的一堆sql,类似于python中的自定义函数

delimiter $$

create procedure p1()

begin

select * from user;

end $$

delimiter ;

调用

call p1()

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

2.三种开发模型

1. 第一种

应用程序:只需要开发应用程序的逻辑

mysql:编写好存储过程,以供应用程序调用

优点:开发效率,执行效率都高

缺点:考虑到人为因素、跨部门沟通等问题,会导致扩展性差

- 1

- 2

- 3

- 4

- 5

2. 第二种

应用程序:除了开发应用程序的逻辑,还需要编写原生sql

优点:比方式1,扩展性高(非技术性的)

缺点:

1、开发效率,执行效率都不如方式1

2、编写原生sql太过于复杂,而且需要考虑到sql语句的优化问题

- 1

- 2

- 3

- 4

- 5

- 6

3. 第三种

应用程序:开发应用程序的逻辑,不需要编写原生sql,基于别人编写好的框架来处理数据,ORM

优点:不用再编写纯生sql,这意味着开发效率比方式2高,同时兼容方式2扩展性高的好处

缺点:执行效率连方式2都比不过

- 1

- 2

- 3

- 4

创建存储过程

delimiter $$ create procedure p2( in m int, # in表示这个参数必须只能是传入不能被返回出去 in n int, out res int # out表示这个参数可以被返回出去 ) begin select tname from teacher where tid > m and tid < n; end $$ delimiter ; 注意: 针对res需要先提前定义 set @res = 10; # 定义 res=10 select @res; # 查看 call p2(1, 5, @res) # 调用 select @res # 查看

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

如何使用存储过程

1. 大前提:存储过程在哪个库下面创建的只能在对应的库下面使用!!! 2. 直接在mysql中调用 set @res=10; # res的值是用来判断存储过程是否被执行成功的依据,所以需要先定义一个变量@res存储10 call p1(2,4,10); # 报错 call p1(2,4,@res); 查看结果 select @res; #执行成功,@res变量值发生了变化 3.在Python程序中使用 pymysql连接MySQL 产生的游标cursor.callproc('p1', (2,4,10)) # 内部原理:@_p1_0=2,@_p1_1=4,@_p1_2=10 4.存储过程与事务使用举例 delimiter // create procedure p5( out p_return_code tinyint ) begin declare exit handler for sqlexception begin set p_return_code=1; rollback; end; declare exit handler for sqlexception begin set p_return_code=2; rollback; end; start transaction; update user set balance=900 where id=1; update user set balance=1010 where id=2; update user set balance=1090 where id=3; commit; set p_return_code=0; #0代表执行成功 end // delimiter;

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

六、函数

-注意与存储过程的区别,mysql内置的函数只能在sql语句中使用! CREATE TABLE blog ( id INT PRIMARY KEY auto_increment, NAME CHAR (32), sub_time datetime ); INSERT INTO blog (NAME, sub_time) VALUES ('第1篇','2015-03-01 11:31:21'), ('第2篇','2015-03-11 16:31:21'), ('第3篇','2016-07-01 10:21:31'), ('第4篇','2016-07-22 09:23:21'), ('第5篇','2016-07-23 10:11:11'), ('第6篇','2016-07-25 11:21:31'), ('第7篇','2017-03-01 15:33:21'), ('第8篇','2017-03-01 17:32:21'), ('第9篇','2017-03-01 18:31:21'); select date_format(sub_time,'%Y-%m'),count(id) from blog group by date_format(sub_time,'%Y-%m'); char_length -思路: id | NAME | sub_time | sub_month +----+-------------------------------------+---------------------+------------------+ | 1 | 第1篇 | 2015-03-01 11:31:21 | 2015-03 | 2 | 第2篇 | 2015-03-11 16:31:21 | 2015-03 | 3 | 第3篇 | 2016-07-01 10:21:31 | 2016-07 | 4 | 第4篇 | 2016-07-22 09:23:21 | 2016-07 | 5 | 第5篇 | 2016-07-23 10:11:11 | 2016-07 | 6 | 第6篇 | 2016-07-25 11:21:31 | 2016-07 | 7 | 第7篇 | 2017-03-01 15:33:21 | 2017-03 | 8 | 第8篇 | 2017-03-01 17:32:21 | 2017-03 | 9 | 第9篇 | 2017-03-01 18:31:21 | 2017-03 select count(*), sub_month from blog group by sub_month; 把年月日 时分秒的时间格式转为 年-月的形式,然后在对年-月分组 用到MySQL的内置函数 date_format() 能使用代码操作的尽量使用代码操作,不要过多的使用MySQL的函数

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

七、流程控制

# if条件语句 delimiter // CREATE PROCEDURE proc_if () BEGIN declare i int default 0; if i = 1 THEN SELECT 1; ELSEIF i = 2 THEN SELECT 2; ELSE SELECT 7; END IF; END // delimiter ; ----------------------------------------------------------------------- # while循环 delimiter // CREATE PROCEDURE proc_while () BEGIN DECLARE num INT ; SET num = 0 ; WHILE num < 10 DO SELECT num ; SET num = num + 1 ; END WHILE ; END // delimiter ;

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

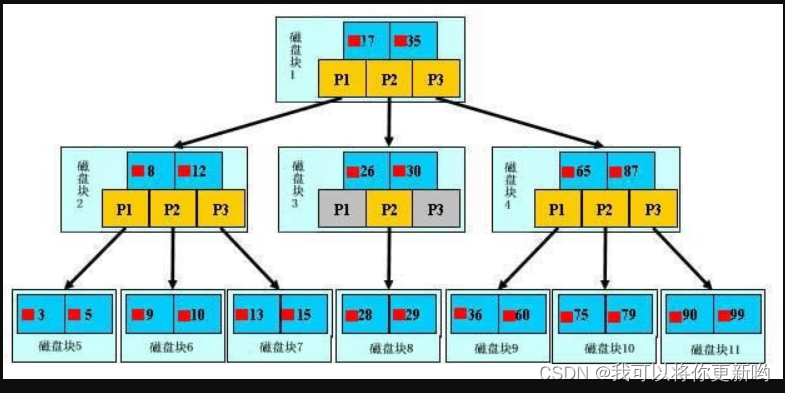

八、索引

数据都是存在硬盘上的,那查询数据不可避免的需要进行IO操作 索引就是一种数据结构,类似于书的目录。意味着以后再查数据应该先找目录再找数据,而不是用翻页的方式查询数据 索引在MySQL中也叫做“键”,是存储引擎用于快速找到记录的一种数据结构。 - primary key - unique key - index key 注意:上面三种key前两种除了有加速查询的效果之外还有额外的约束条件(primary key:非空且唯一,unique key:唯一),而index key没有任何约束功能只会帮你加速查询 本质都是:通过不断地缩小想要获取数据的范围来筛选出最终想要的结果,同时把随机的事件变成顺序的事件,也就是说,有了这种索引机制,我们可以总是用同一种查找方式来锁定数据。 索引的影响: 1.在表中有大量数据的前提下,创建索引速度会很慢 以后实际添加索引的时候,尽量在空表的时候添加,在创建表的时候就添加索引,此时添加索引是最快的 如果表中数据已经有了,还需要添加索引,也可以,只不过创建索引的速度会很慢,不建议这样做 2.在索引创建完毕后,对表的查询性能会大幅度提升,但是写的性能会降低 写的性能影响不是很大,因为在实际中,写的频率很少,大部分操作都是查询 如何添加索引?到底给哪些字段加索引呢? '''没有固定答案,具体给哪个字段加索引,要看你实际的查询条件''' select * from user where name='' and password=''; 索引的使用其实是需要大量的工作经验,才能正确的判断出 '''不要一创建表就加索引,在一张表中,最多最多不要超过15个索引,索引越多,性能就会下降''' 如何数据量比较小,不需要加索引,100w一下一般不用加,mysql针对于1000w一下的数据,性能不会下降太多. 3.b+树 树------>二叉树 平衡树 b树 b+树 b-树... https://images2017.cnblogs.com/blog/1036857/201709/1036857-20170912011123500-158121126.png 只有叶子结点存放真实数据,根和树枝节点存的仅仅是虚拟数据 查询次数由树的层级决定,层级越低次数越少 一个磁盘块儿的大小是一定的,那也就意味着能存的数据量是一定的。如何保证树的层级最低呢?一个磁盘块儿存放占用空间比较小的数据项 以后加索引的时候,尽量给字段中存的是数字的列加,我们使用主键查询速度很快 select * from user where name = '' select * from user where id = '' # 主键查询的更快一些 思考我们应该给我们一张表里面的什么字段字段建立索引能够降低树的层级高度>>> 主键id字段 聚集索引(primary key) 聚集索引其实指的就是表的主键,innodb引擎规定一张表中必须要有主键。先来回顾一下存储引擎。 myisam在建表的时候对应到硬盘有几个文件(三个)? innodb在建表的时候对应到硬盘有几个文件(两个)?frm文件只存放表结构,不可能放索引,也就意味着innodb的索引跟数据都放在idb表数据文件中。 特点:叶子结点放的一条条完整的记录 辅助索引(unique,index) 辅助索引:查询数据的时候不可能都是用id作为筛选条件,也可能会用name,password等字段信息,那么这个时候就无法利用到聚集索引的加速查询效果。就需要给其他字段建立索引,这些索引就叫辅助索引 特点:叶子结点存放的是辅助索引字段对应的那条记录的主键的值(比如:按照name字段创建索引,那么叶子节点存放的是:{name对应的值:name所在的那条记录的主键值}) select name from user where name='jack'; 上述语句叫覆盖索引:只在辅助索引的叶子节点中就已经找到了所有我们想要的数据 select age from user where name='jack'; 上述语句叫非覆盖索引,虽然查询的时候命中了索引字段name,但是要查的是age字段,所以还需要利用主键才去查找

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

测试索引

1. 准备表 create table s1( id int, name varchar(20), gender char(6), email varchar(50) ); select id,name from t1; 2. 创建存储过程,实现批量插入记录 delimiter $$ #声明存储过程的结束符号为$$ create procedure auto_insert1() BEGIN declare i int default 1; while(i<100000)do insert into s1 values(i,'jason','male',concat('jason',i,'@oldboy')); set i=i+1; end while; END$$ #$$结束 delimiter ; #重新声明分号为结束符号 3. 查看存储过程 show create procedure auto_insert1\G 4. 调用存储过程 call auto_insert1();

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

# 表没有任何索引的情况下 select * from s1 where id=1000; # 避免打印带来的时间损耗 select count(id) from s1 where id = 1000000; select count(id) from s1 where id = 1; # 给id做一个主键 alter table s1 add primary key(id); # 速度很慢 select count(id) from s1 where id = 1; # 速度相较于未建索引之前两者差着数量级 select count(id) from s1 where name = 'jason' # 速度仍然很慢 10000000 1000 select * from s1 limit 0,1000; select * from s1 limit 1000,1000; select * from s1 limit 2000,1000; select * from s1 limit 9999000,1000; # 把100000万条数据都查一遍,然后把前99000条丢掉,要最后1000 """ 范围问题 """ # 并不是加了索引,以后查询的时候按照这个字段速度就一定快 select count(id) from s1 where id > 1; # 速度相较于id = 1慢了很多 select count(id) from s1 where id >1 and id < 3; select count(id) from s1 where id > 1 and id < 10000; select count(id) from s1 where id != 3; alter table s1 drop primary key; # 删除主键 单独再来研究name字段 select count(id) from s1 where name = 'jason'; # 又慢了 create index idx_name on s1(name); # 给s1表的name字段创建索引 select count(id) from s1 where name = 'jason' # 仍然很慢!!! """ 再来看b+树的原理,数据需要区分度比较高,而我们这张表全是jason,根本无法区分 那这个树其实就建成了“一根棍子” """ select count(id) from s1 where name = 'xxx'; # 这个会很快,我就是一根棍,第一个不匹配直接不需要再往下走了 select count(id) from s1 where name like 'xxx'; select count(id) from s1 where name like 'xxx%'; select count(id) from s1 where name like '%xxx'; # 慢 最左匹配特性 # 区分度低的字段不能建索引 drop index idx_name on s1; # 给id字段建普通的索引 create index idx_id on s1(id); select count(id) from s1 where id = 3; # 快了 select count(id) from s1 where id*12 = 3; # 慢了 索引的字段一定不要参与计算 drop index idx_id on s1; select count(id) from s1 where name='jason' and gender = 'male' and id = 3 and email = 'xxx'; # 针对上面这种连续多个and的操作,mysql会从左到右先找区分度比较高的索引字段,先将整体范围降下来再去比较其他条件 create index idx_name on s1(name); select count(id) from s1 where name='jason' and gender = 'male' and id = 3 and email = 'xxx'; # 并没有加速 drop index idx_name on s1; # 给name,gender这种区分度不高的字段加上索引并不难加快查询速度 create index idx_id on s1(id); select count(id) from s1 where name='jason' and gender = 'male' and id = 3 and email = 'xxx'; # 快了 先通过id已经讲数据快速锁定成了一条了 select count(id) from s1 where name='jason' and gender = 'male' and id > 3 and email = 'xxx'; # 慢了 基于id查出来的数据仍然很多,然后还要去比较其他字段 drop index idx_id on s1 create index idx_email on s1(email); select count(id) from s1 where name='jason' and gender = 'male' and id > 3 and email = 'xxx'; # 快 通过email字段一剑封喉

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

联合索引

select count(id) from s1 where name='jason' and gender = 'male' and id > 3 and email = 'xxx'; # 如果上述四个字段区分度都很高,那给谁建都能加速查询 # 给email加然而不用email字段 select count(id) from s1 where name='jason' and gender = 'male' and id > 3; # 给name加然而不用name字段 select count(id) from s1 where gender = 'male' and id > 3; # 给gender加然而不用gender字段 select count(id) from s1 where id > 3; where id=1; where name=''; where name='jason' and age=18; where name='jason' and age=18 and gender ='male'; """最左匹配原则""" KEY `index_1` (`name`,`gender`,`email`) # 联合索引 where name = ''; where name='' and gender =''; where name = and gender = and email=; KEY `index_1` (`name`) # KEY `index_1` (`name`,`gender`) KEY `index_1` (`name`,`gender`,`email`) # 带来的问题是所有的字段都建了索引然而都没有用到,还需要花费四次建立的时间 create index idx_all on s1(email,name,gender,id); # 最左匹配原则,区分度高的往左放 select count(id) from s1 where name='jason' and gender = 'male' and id > 3 and email = 'xxx'; # 速度变快

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/小丑西瓜9/article/detail/644750

推荐阅读

相关标签