- 1【知识图谱】Neo4j的基本使用及思知1.4亿三元组数据构建知识图谱_利用neo4j做知识图谱常用函数

- 2nuc970 网络问题排查过程_nuc970 can

- 3Flutter之Android Studio No connected devices found_no android connected device found, and no emulator

- 4【Unity3D】Unity与Android交互_unity安卓支持

- 5开发钉钉小程序_uniapp开发钉钉小程序

- 6ubuntu16.04 pyqt5 eric6 qt5 安装_在eric6中安装pyqt5如何修改到镜像地址

- 7高清人脸数据集汇总 (主要用于人脸生成、分割任务)_ffhq_512.lmdb 百度云

- 8海外社交营销为什么用云手机?不用普通手机?

- 9开源漏洞深度分析 | CVE-2022-22980 Spring Data MongoDB SpEL表达式注入漏洞_spring data mongodb spel表达式注入漏洞(cve-2022-22980)

- 10【鸿蒙开发】HarmonyOS应用开发者基础认证题库

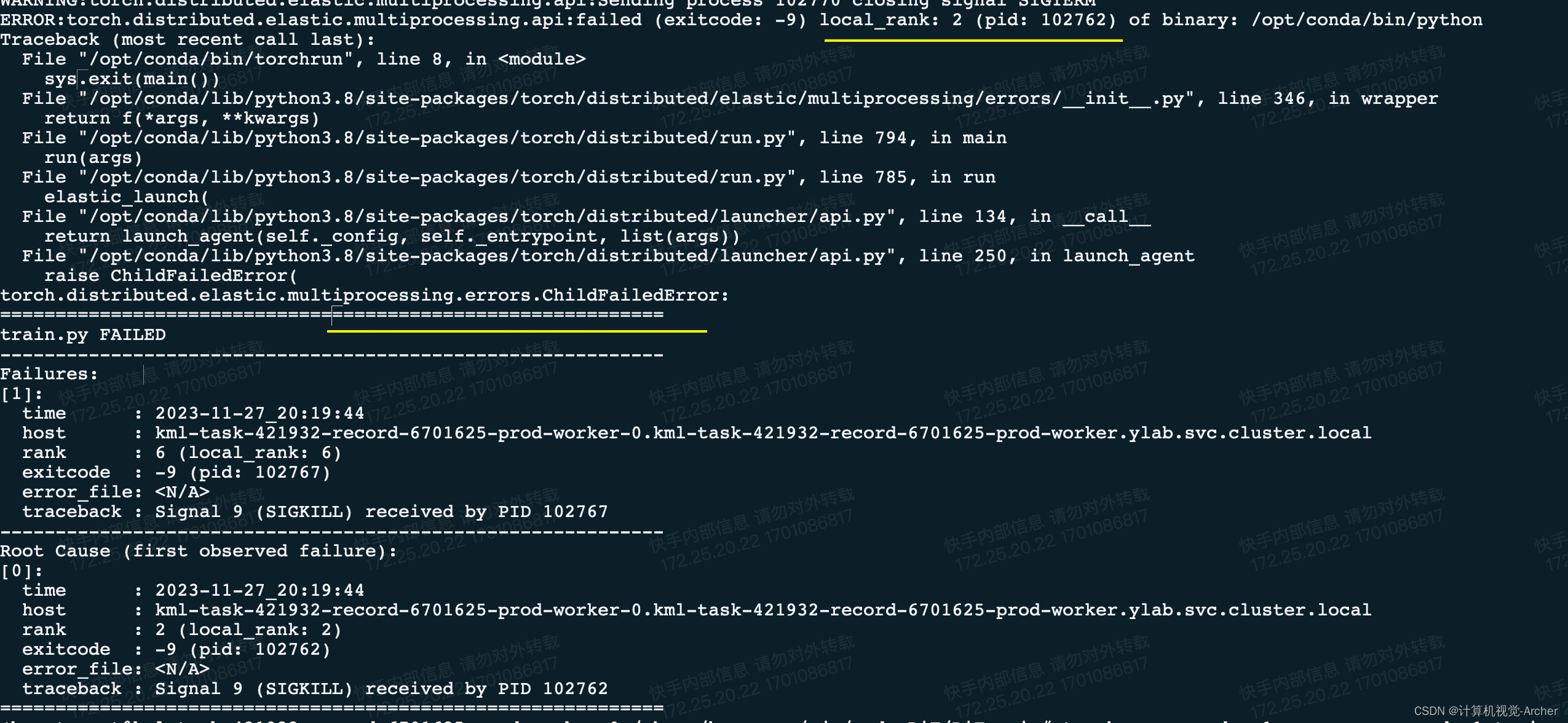

训练DiT报错ERROR:torch.distributed.elastic.multiprocessing.api:failed (exitcode: -9) local_rank: 0

赞

踩

运行Dit时,torchrun --nnodes=1 --nproc_per_node=8 train.py --model DiT-XL/2 --data-path /home/pansiyuan/jupyter/qianyu/data

遇到报错

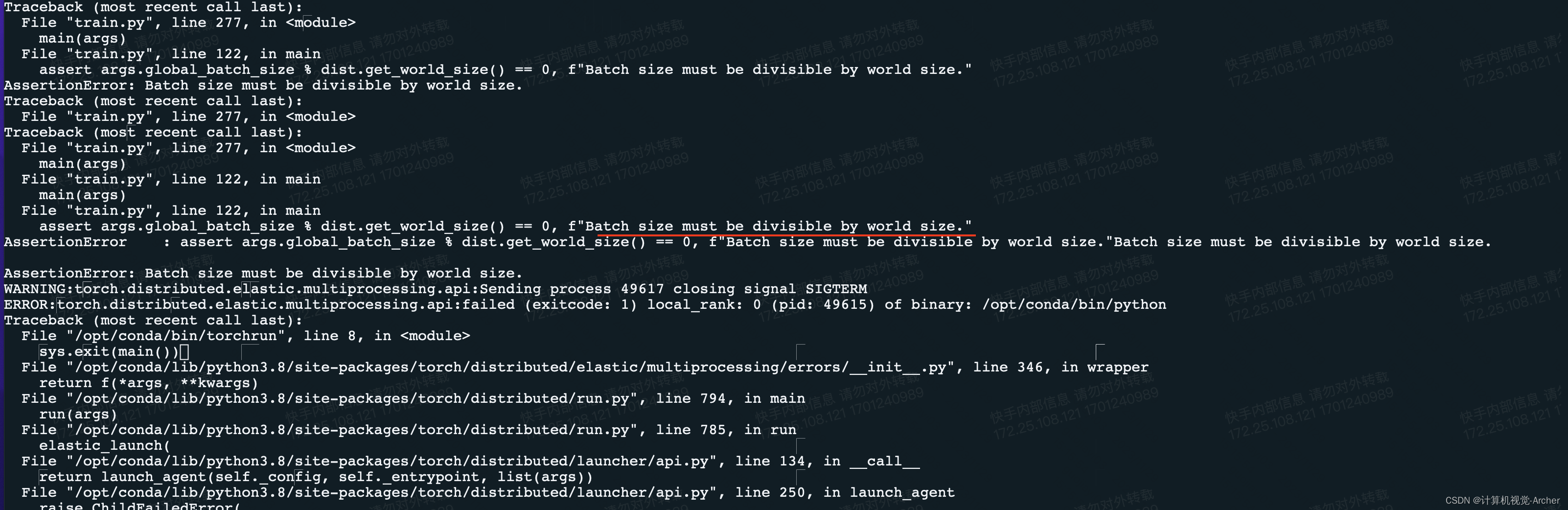

1 完整报错

2 报错关键位置

ERROR:torch.distributed.elastic.multiprocessing.api:failed (exitcode: -9) local_rank: 0 (pid: 83746) of binary: /opt/conda/bin/python Traceback (most recent call last):

torch.distributed.elastic.multiprocessing.errors.ChildFailedError

解决办法:

此时是多卡计算看不到报错信息

采用单卡

torchrun --nnodes=1 --nproc_per_node=1 train.py --model DiT-XL/2 --data-path /home/pansiyuan/jupyter/qianyu/data

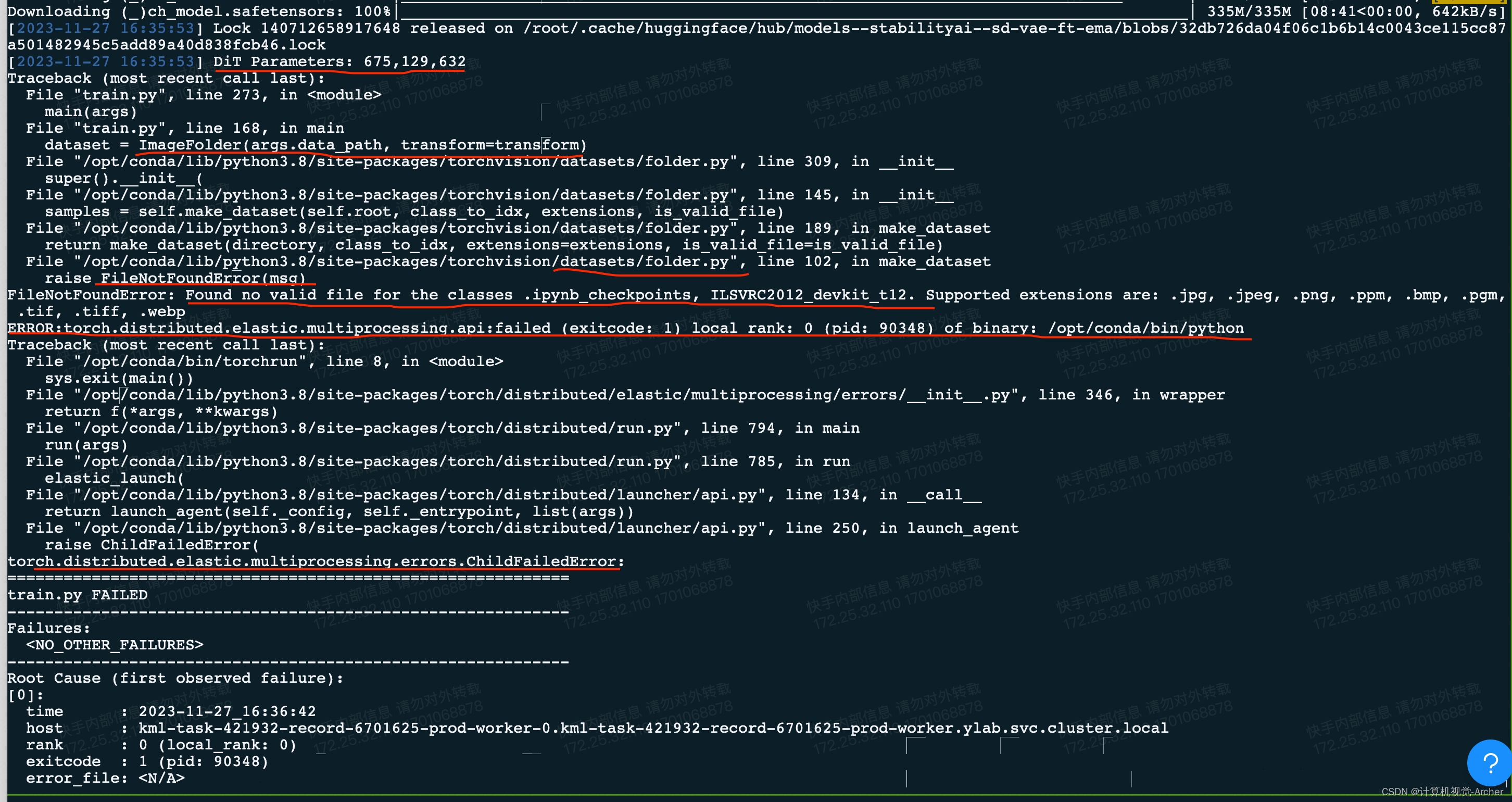

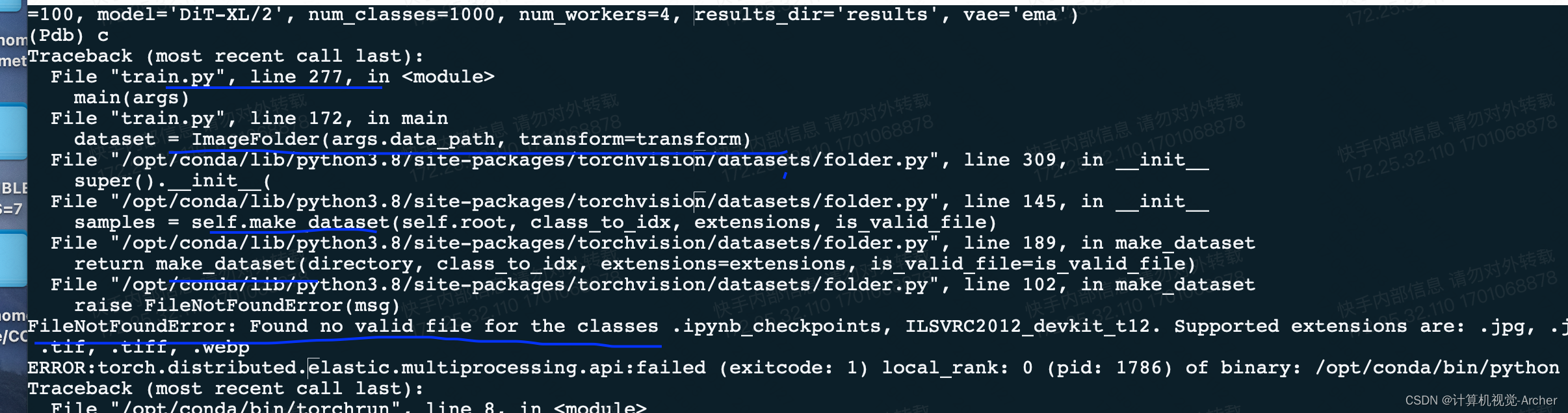

单卡之后报错结果是数据集找不到

没有找到文件args,data_path是不是出问题了

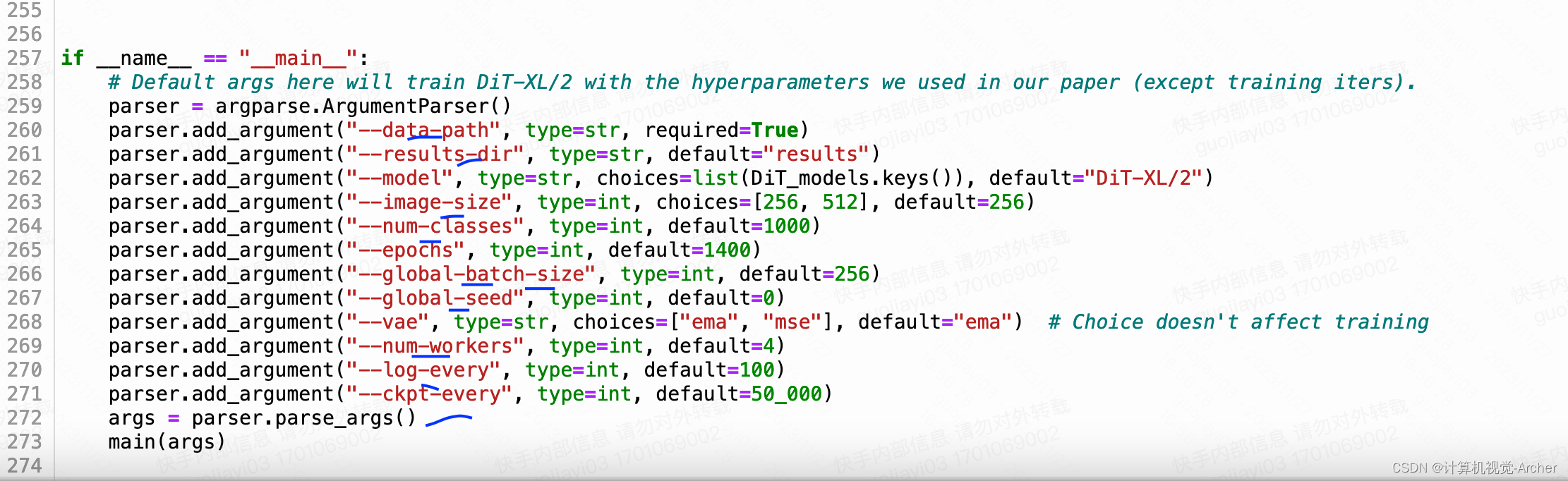

值得注意的是这里的DiT给的路径data_path等等,在train.py文件arg里面都是用的不是下划线

注意这里的指令也需要下划线

torchrun --nnodes=1 --nproc_per_node=8 train.py --model DiT-XL/2 --data-path /home/pansiyuan/jupyter/qianyu/data/train

args.data_path

修改后,再次尝试调小batch就行

如果使用7张卡设置batch size为256就就如下报错,因为无法整除