热门标签

热门文章

- 1git提交代码忽略文件不上传-创建.gitignore文件_gitlab上添加不上传的忽略的文件

- 2vue2 系列:axios 使用_vue2使用axios

- 3Docker(十三):离线安装docker社区版(docker-18.06.3-ce)

- 4github使用教程_guthub上text-censor怎么用

- 5复杂网络研究综述:一种描述复杂关系的结构_复杂网络理论

- 6【华为OD机试考生抽中题 C&D卷】表演赛游戏分组,用 Python 编码,速通

- 7Libevent之 bufferevent 及 bufferevent_sock 详解

- 8KINOdynamic-路径规划_kinodynamic中的kino

- 9MacOS安装python,报错“zsh: command not found: python”_mac zsh: command not found: python

- 10【VictoriaMetrics】VictoriaMetrics单机版批量和单条数据写入(opentsdb格式)_victoriametrics数据格式

当前位置: article > 正文

给Ollama套个WebUI,方便使用

作者:小小林熬夜学编程 | 2024-05-07 08:04:33

赞

踩

给Ollama套个WebUI,方便使用

Ollama

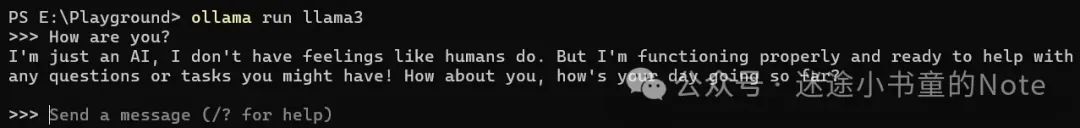

基本的安装使用参考前文 https://xugaoxiang.com/2024/05/01/ollama-offline-deploy/,前文使用的模型是 llama2,本篇将使用 llama3,因此在启动时,命令是 ollama run llama3。

Llama3

Llama3 是 Meta 发布的大语言模型,有两种大小:80亿和700亿参数。这种模型经过大量文本数据的训练,可用于各种任务,包括生成文本、翻译语言、编写不同类型的创意内容以及以信息丰富的方式回答您的问题。Meta 宣称 Llama3 是最好的开放模型之一,但它仍在开发中。这是与 Mistral 和 Gemma 相比的 8B 模型基准。

给Ollama套个WebUI

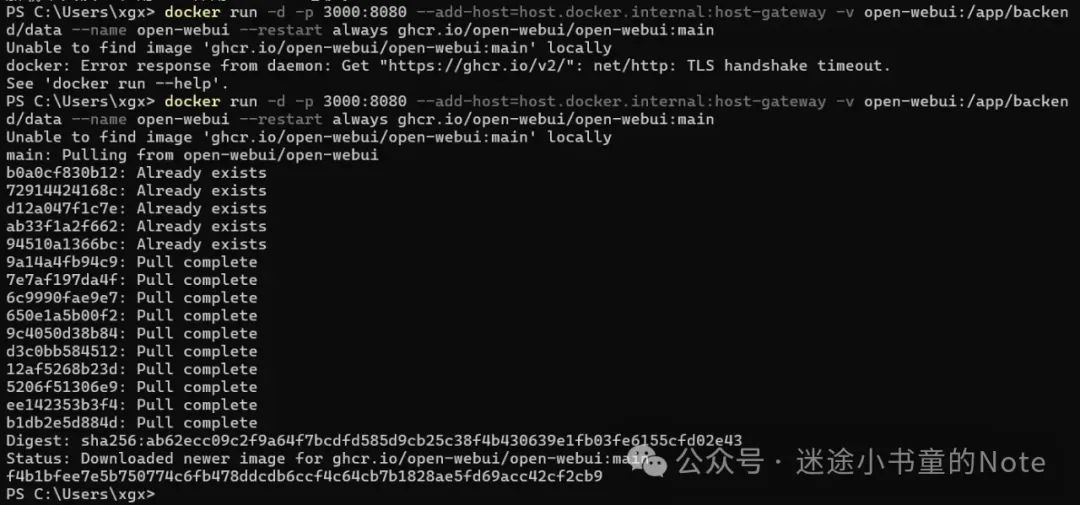

这里使用的是 open-webui,使用 docker 的方式进行。关于 windows 平台如何安装 docker,参考前面的文章 https://xugaoxiang.com/2023/11/16/windows-install-docker/

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

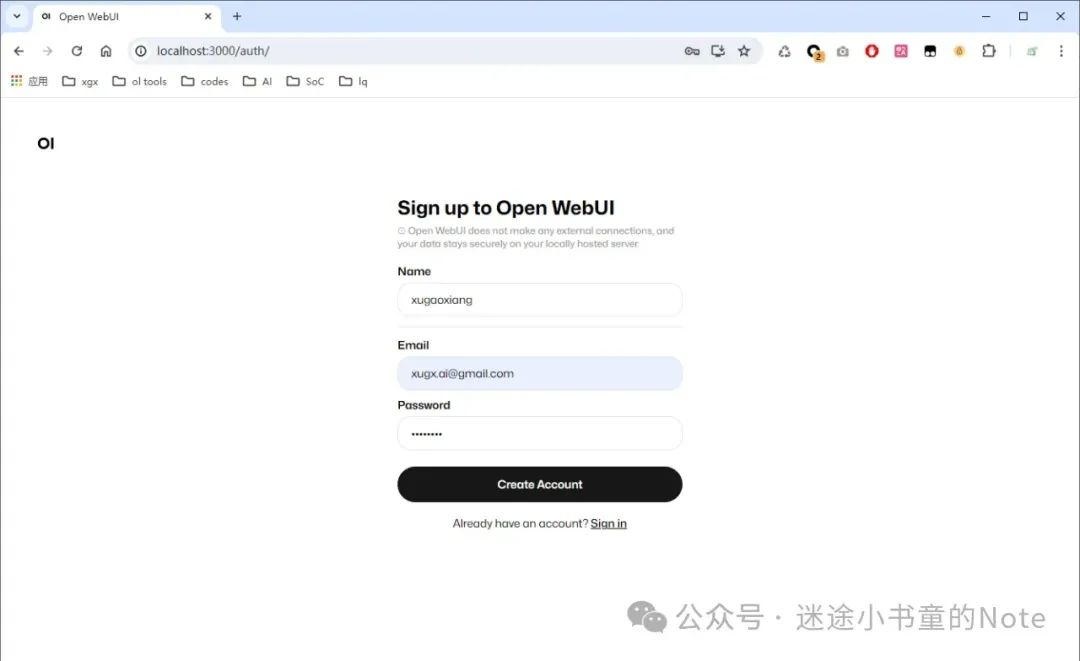

成功后,打开浏览器,输入 http://127.0.0.1:300

注册账号

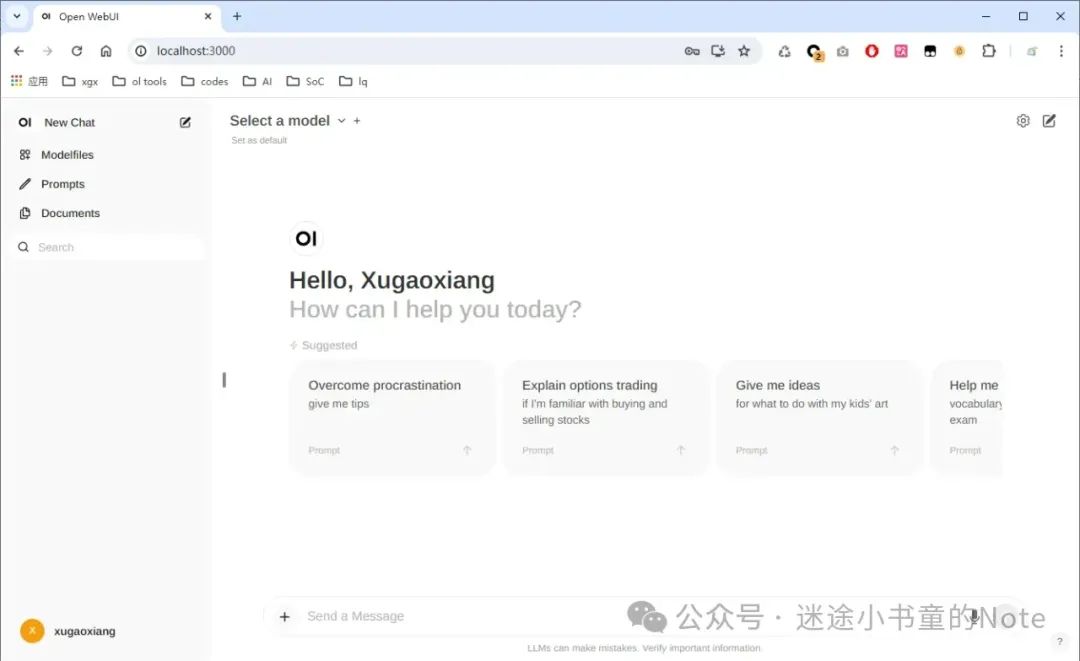

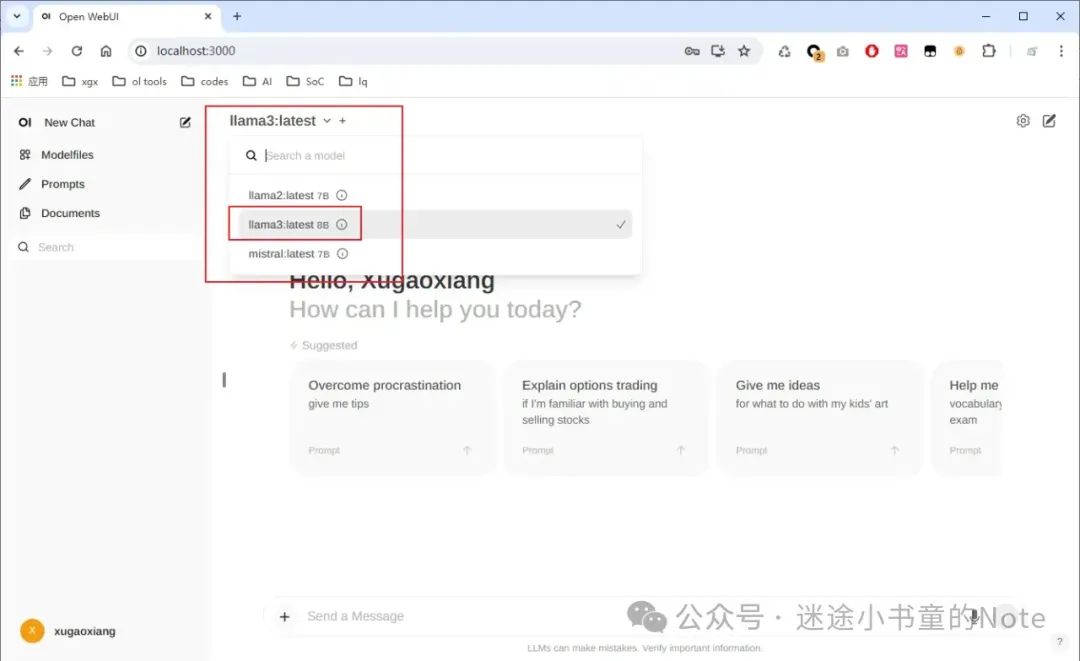

选择使用的模型,这里就 llama3

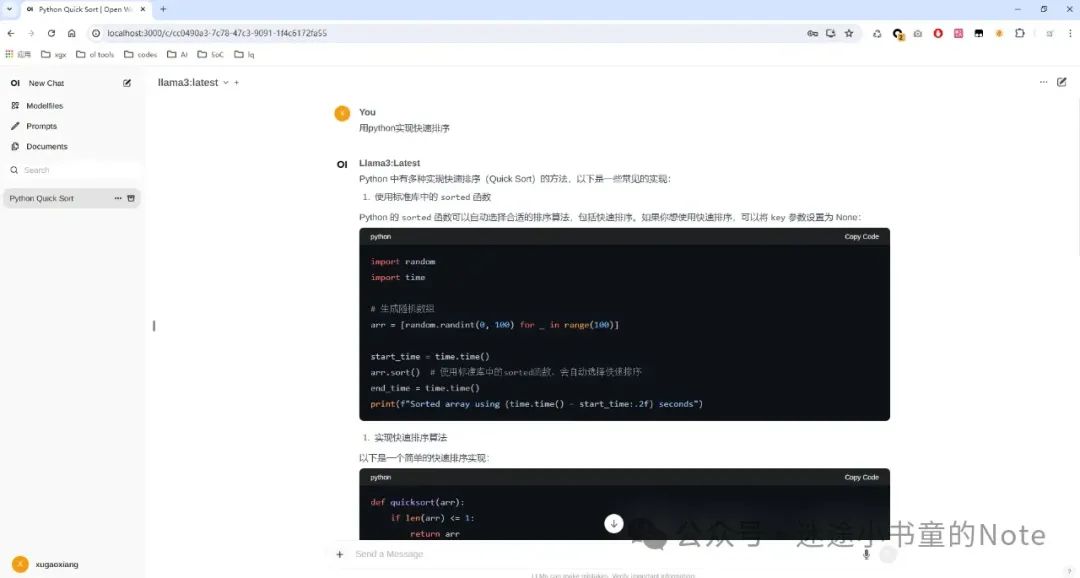

可以向 llama3 提问了

参考资料

https://xugaoxiang.com/2024/05/01/ollama-offline-deploy/

https://github.com/chand1012/openai-cf-workers-ai

https://docs.openwebui.com/

https://github.com/ollama/ollama/blob/main/docs/api.md

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/小小林熬夜学编程/article/detail/548155

推荐阅读

相关标签