热门标签

当前位置: article > 正文

python奇异值分解_python机器学习(七) 奇异值分解-SVD

作者:小小林熬夜学编程 | 2024-06-13 17:01:02

赞

踩

矩阵奇异值分解python中的true和flase是什么意思

降维(Dimensionality Reduction) 是机器学习中的一种重要的特征处理手段,它可以减少计算过程中考虑到的随机变量(即特征)的个数,其被广泛应用于各种机器学习问题中,用于消除噪声、对抗数据稀疏问题。它在尽可能维持原始数据的内在结构的前提下,得到一组描述原数据的,低维度的隐式特征(或称主要特征)。简单来说,在高维数据中筛选出对我们有用的变量,减小计算复杂度提高模型训练效率和准确率,这就是我们要说的降维。

MLlib机器学习库提供了两个常用的降维方法:奇异值分解(Singular Value Decomposition,SVD) 和 主成分分析(Principal Component Analysis,PCA),下面我们将通过实例介绍其具体的使用方法。

一、公式和原理

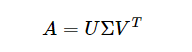

奇异值分解(SVD)将矩阵A分解为三个矩阵:U,Σ和V,如下公式

其中

左奇异矩阵 :,U 为一个标准正交矩阵,也叫实对称矩阵,怎么理解这个概念呢?就是说矩阵A的转置等于其本身,或者说矩阵U的维度为m×m ,用符号表示为

,我们称U 为左奇异矩阵。

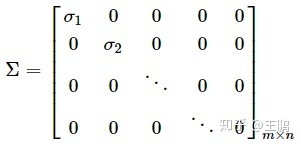

奇异值 : Σ 是一个对角矩阵,仅在主对角线上有值,其它元素均为0,用符合表示为

,我们称Σ为奇异值。

右奇异矩阵 : V也是一个正交矩阵,这会儿知道是啥意思了吧,和U的解释一样,用符号表示为

,我们称 V 为 右奇异矩阵。

奇异值分解 : 就是想要找到一个比较小的值k,保留前k个奇异向量和奇异值,其中 U 的维度从 m×m 变成了 m×k , V 的维度从 n×n 变成了 m×k &#x

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/小小林熬夜学编程/article/detail/713884

推荐阅读

相关标签