- 1Linux系统vim,gcc,g++工具使用及环境配置,动静态库的概念及使用_linux编译环境配置

- 2Python---Pycharm安装各种库(第三方库)_pycharm安装第三方库

- 3【Mac】Lightroom Classic 2024(LrC 2024中文版) v13.1安装教程

- 4实现自动打包py及替换pyinstaller --add-data参数的方法

- 5SparkStreaming 实现黑名单过滤功能_套接字流实现黑名单过滤

- 6智谱AI-算法实习生(知识图谱方向)实习面试记录_智谱ai 知识图谱

- 7SQL中的distinct的使用方法_sql distinct用法

- 8自然语言处理评测汇总(持续更新)_与文本相似,逻辑能力评价,代码生成的质量评价相关的。我们现暂只做这三种模型能力

- 9智能座舱总结_小米舱驾融合

- 10Shell学习15天(流编辑器sed概览)- 09day_实现一个简易行编辑器,根据编辑指令输出最后结果。编辑指令包括以下几种

Llama3相比较前两代的模型(Llama1和Llama2)有哪些升级?几张图简单总结Llama3的训练成本、训练时间、模型架构升级等情况_llama1、2、3结构变化

赞

踩

本文原文来自DataLearnerAI官方网站:Llama3相比较前两代的模型(Llama1和Llama2)有哪些升级?几张图简单总结Llama3的训练成本、训练时间、模型架构升级等情况 | 数据学习者官方网站(Datalearner)![]() https://www.datalearner.com/blog/1051713702716647

https://www.datalearner.com/blog/1051713702716647

Llama3是MetaAI开源的最新一代大语言模型。一发布就引起了全球AI大模型领域的广泛关注。这是MetaAI开源的第三代大语言模型,也是当前最强的开源模型。但相比较第一代和第二代的Llama模型,Llama3的升级之处有哪些?本文以图表的方式总结Llama3的升级之处。

Llama3模型架构的升级

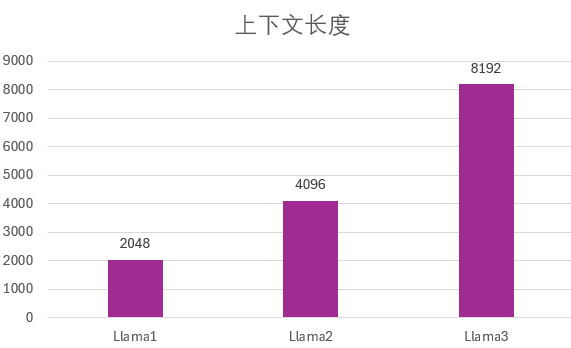

首先是模型架构相关的升级。目前,官方没有公开Llama3的技术报告或者论文细节,在官方博客中只给出了一些简单的指标。这里我们对比的是上下文长度和词汇表。

Llama系列的上下文长度一直在增长

上下文长度每一代都翻倍了,在Llama3中,训练的时候用的就是8K上下文:

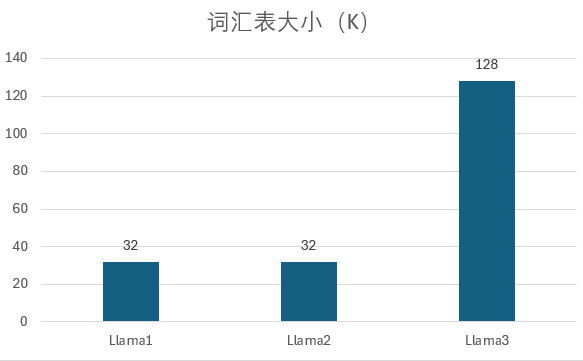

Llama3模型的词汇表大幅提高

在模型架构中另一个值得注意的是词汇表的大幅提高。在Llama1和Llama2中,MetaAI的词汇表都是32K大小,这可能与前两代模型的训练数据差距不大有关。而第三代的Llama3模型的词汇表大小变为128K,也就是说它的tokenizer有了较大的变化。

Llama3模型的训练数据大幅增长

Llama3的训练数据达到了15万亿,比第一代和第二代Llama模型加在一起还多好几倍。如下图所示,第一代的小一点的模型训练数据是1万亿tokens,而较大的650亿规模的模型训练数据是1.4万亿tokens。到了第二代Llama2系列,训练数据都增长到了2万亿tokens。

Llama3模型的训练时长大幅增加

到了Llama3模型这里,训练成本的增长更为恐怖,Llama3-8B模型的训练时长比650亿参数规模的Llama1模型还长。结果如下:

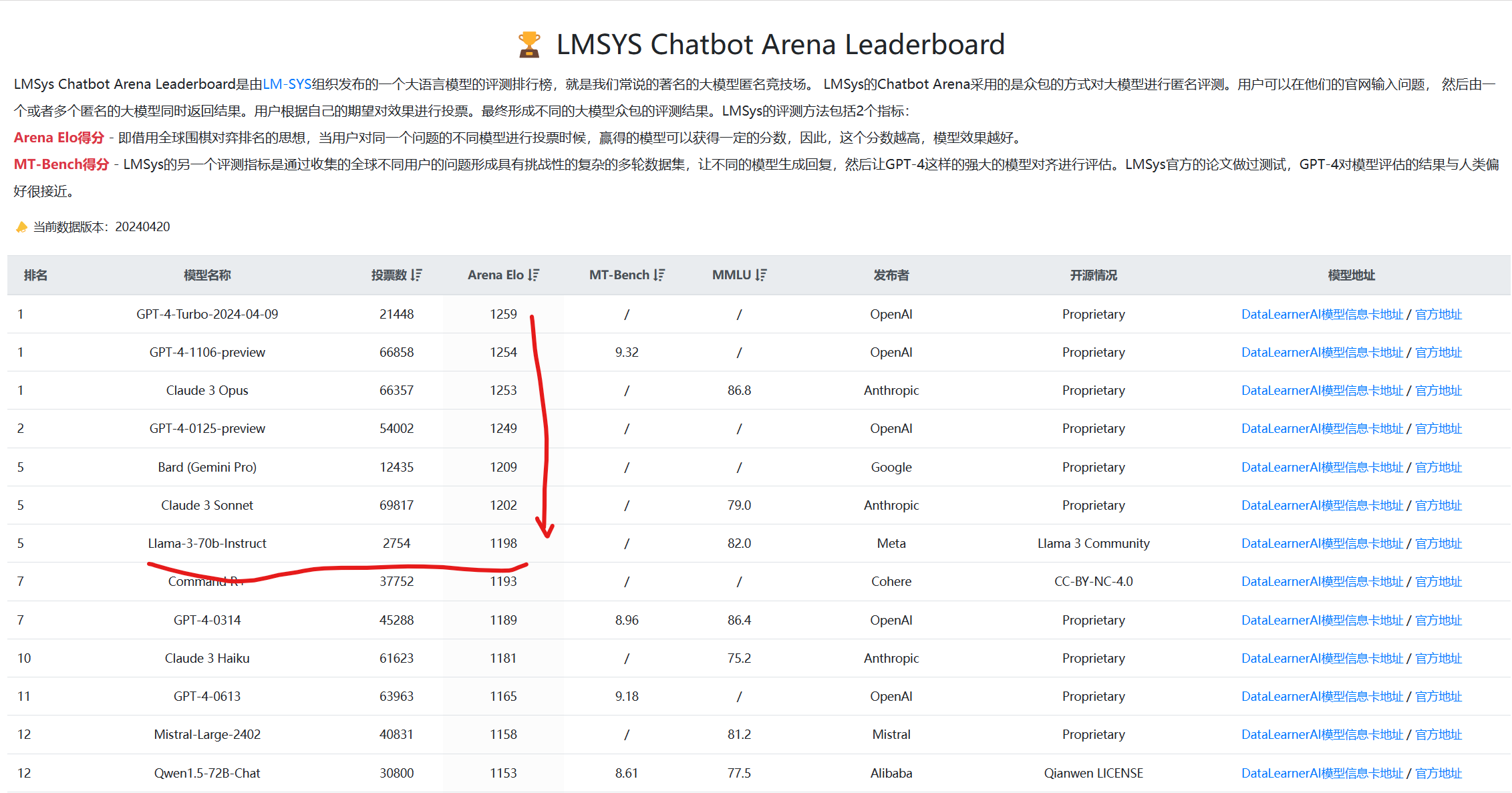

Llama3的评测基准大幅提高

Llama3-70B模型目前已经是Chatbot Arena大模型匿名评分最高的开源模型了。在英文的分项测试甚至超过了Claude-Opus模型,十分强悍。

数据来源:LMSys Chatbot Arena Leaderboard最新AI大模型排行榜与Arena Elo评分、MT-Bench得分(官方数据 - 中国站)| 数据学习 (DataLearner)

未来,如果4000亿参数规模的Llama3-400B也开源的话,那无疑是给闭源模型企业一颗巨大的炸弹。

Llama3的详细介绍参考:开源王者!全球最强的开源大模型Llama3发布!15万亿数据集训练,最高4000亿参数,数学评测超过GPT-4,全球第二! | 数据学习者官方网站(Datalearner)

Llama3在大模型匿名竞技场的得分排行榜:LMSys Chatbot Arena Leaderboard最新AI大模型排行榜与Arena Elo评分、MT-Bench得分(官方数据 - 中国站)| 数据学习 (DataLearner)

Llama3手动部署教程:使用Gradio配合transformers的text streamer实现Llama3-8B-Instruct的网页聊天机器人,流式输出 | 数据学习(DataLearner)