- 1leetcode分类刷题笔记

- 2【Xilinx IP RAM-based Shift Register】延迟说明

- 3自然语言转SQL的应用场景探索_nlptosql

- 42023年“研究生科研素养提升”系列 答案汇总_可以将同一项研究分成几篇论文发表慕课2023

- 5Mysql 5.7.22 $MYSQLD_OPTS (code=exited, status=1/FAILURE)

- 6任意整数分频器设计Verilog代码vivado ego1开发板

- 7el-select 下拉框自定义背景颜色_el-select背景色

- 8【行业】超前瞻深入洞见,中国峰会为您一站式盘点十大行业!

- 9curlopttimeout php,CURLOPT_TIMEOUT根本不工作(php)

- 10数字孪生流域GIS智慧水利Web3D可视化决策系统_智慧水利webgis

快速体验 Llama3 的 4 种方式,本地部署,800 tokens/s 的推理速度真的太快了!_llama3推理速度

赞

踩

北京时间4月19日凌晨,Meta在官网上官宣了Llama-3,作为继Llama1、Llama2和CodeLlama之后的第三代模型,Llama3在多个基准测试中实现了全面领先,性能优于业界同类最先进的模型,你有没有第一时间体验上呢,这篇文章就分享下如何在Groq上以超过 800 tokens/s 的魔鬼推理速度体验Llama3,会同时分享Web端、移动端、API方式以及集成到LangChain中4种体验方案。

我的新书《LangChain编程从入门到实践》 已经开售!推荐正在学习AI应用开发的朋友购买阅读,此书围绕LangChain梳理了AI应用开发的范式转变,除了LangChain,还涉及其他诸如 LIamaIndex、AutoGen、AutoGPT、Semantic Kernel等热门开发框架介绍使用。

本文首发自个人博客 利用 Groq 体验 Llama3 的4种方式,800 tokens/s 的推理速度真的太快了!

Groq 有多快

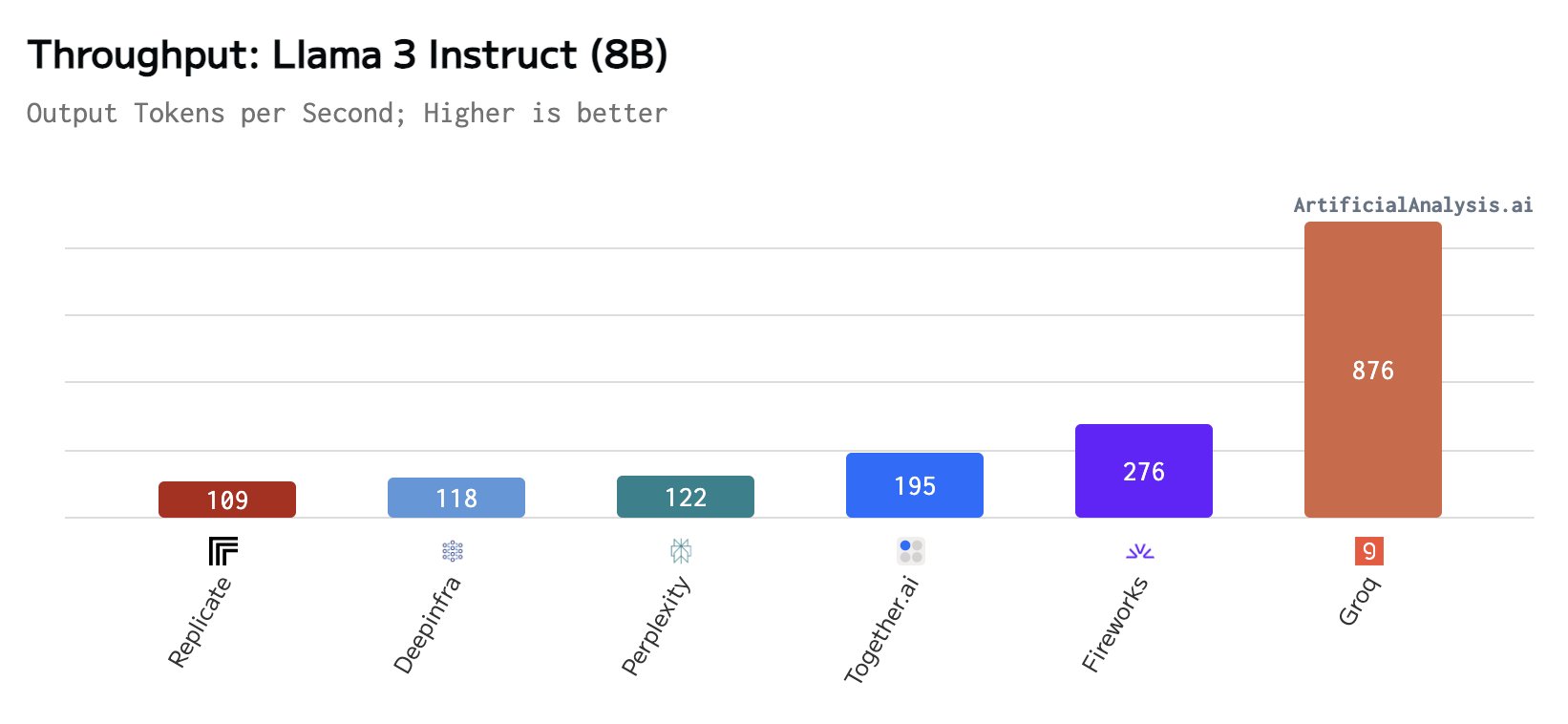

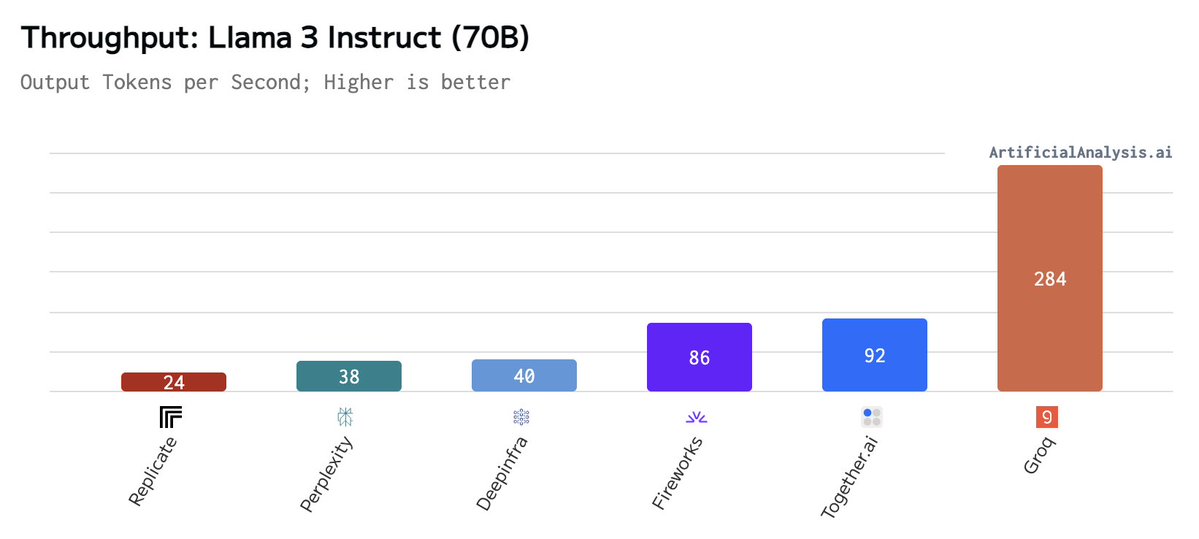

先看两组数据

Llama3 8B 每秒钟 876 tokens 的输出速度,人眼基本跟不上模型的输出速度了,要知道 Llama3 8B 的质量与 GPT-3.5 和 Llama2 70B 相似,可以显著提升一些常见的 AI 应用场景的用户体验;RAG 的性能瓶颈不再是 LLM,而是 Retrieval,什么 HyDE(假设⽂档嵌⼊,利⽤ LLMs ⽣成假设性答案,以增强⽂档检索的准确性)、LLM 重排序器(对检索到的⽂档进⾏重排序,以优先选择最相关和上下⽂适当的信息)不再是 RAG 链路速度瓶颈…

初看数据,我以为是个噱头,本着务实的态度,我自己实际体验了一把,大家自己看

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。