- 1HTTP、Tomcat、Nginx、前后端分离开发_nginx tomcat

- 2实战 | 用Python和OpenCV搭建一个老人跌倒智能监测系统 (步骤 + 源码)_python摔倒检测

- 3电商项目day19(秒杀功能实现)

- 4Python3 df.loc和df.iloc函数用法及提取指定行列位置处数值_df.loc用法

- 5python GUI编程(tkinter)基于adb 编写安卓助手_python tk/ttk制作 安卓群控助手

- 6论文阅读笔记:Hetero-ConvLSTM: A Deep Learning Approach to TrafficAccident Prediction

- 7路径规划-A*(C++实现)_c++实现a*算法

- 8Springboot农产品销售管理系统的设计与实现 57457 (免费领源码、附论文)可做计算机毕业设计JAVA、PHP、爬虫、APP、小程序、C#、C++、python、数据可视化、大数据、全套_基于springboot的农产品展销平台与设计

- 9HTTP协议之post multipart/form-data数据类型实例_httppost multipart/form-data

- 10Python筛选处理Excel的两种方法(openpyxl与pandas)_python按要求过滤excel

归一化 (Normalization)、标准化 (Standardization)和中心/零均值化 (Zero-centered)

赞

踩

目录

4.2、所有情况都应当Standardization或Normalization么

一、概念

1、归一化(Normalization):

(1)将一列数据变化到某个固定区间(范围)中,通常,这个区间是[0, 1] 或者(-1,1)之间的小数。主要是为了数据处理方便提出来的,把数据映射到0~1范围之内处理,更加便捷快速。

(2)把有量纲表达式变成无量纲表达式,便于不同单位或量级的指标能够进行比较和加权。归一化是一种简化计算的方式,即将有量纲的表达式,经过变换,化为无量纲的表达式,成为纯量。

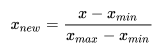

从公式看: 归一化输出范围在0-1之间

该方法实现对原始数据的等比例缩放。通过利用变量取值的最大值和最小值(或者最大值)将原始数据转换为界于某一特定范围的数据,从而消除量纲和数量级影响,改变变量在分析中的权重来解决不同度量的问题。由于极值化方法在对变量无量纲化过程中仅仅与该变量的最大值和最小值这两个极端值有关,而与其他取值无关,这使得该方法在改变各变量权重时过分依赖两个极端取值。

2、标准化(Standardization):

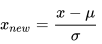

原始数据减均值之后,再除以标准差。将数据变换为均值为0,标准差为1的分布,切记:并非一定是正态的。

虽然该方法在无量纲化过程中利用了所有的数据信息,但是该方法在无量纲化后不仅使得转换后的各变量均值相同,且标准差也相同,即无量纲化的同时还消除了各变量在变异程度上的差异,从而转换后的各变量在聚类分析中的重要性程度是同等看待的。

从公式看:标准化输出范围是负无穷到正无穷

- # python实现

- X -= np.mean(X, axis = 0) # zero-center

- X /= np.std(X, axis = 0) # normalize

在机器学习中,我们可能要处理不同种类的资料,例如,音讯和图片上的像素值,这些资料可能是高维度的,资料标准化后会使每个特征中的数值平均变为0(将每个特征的值都减掉原始资料中该特征的平均)、标准差变为1,这个方法被广泛的使用在许多机器学习算法中(例如:支持向量机、逻辑回归和类神经网络)。

上图中左图是原图可视化,中图是减均值后的可视化,右图是除以标准差后的可视化。

3、中心化/零均值化(zero-centered):

中心化,也叫零均值处理,就是将每个原始数据减去这些数据的均值。因此 中心化后的数据平均值为0,对标准差无要求。

二、联系和差异:

归一化和标准化的区别:

- 归一化是将样本的特征值转换到同一量纲下把数据映射到[0,1]或者[-1, 1]区间内,缩放比例仅由变量的最大、最小极值决定。

- 标准化和整体样本分布相关,与归一化相比,标准化中每个样本点都能对标准化产生影响(通过均值和标准差造成影响)。

- 显而易见,归一化(Normalization)会严格的限定变换后数据的范围,比如按之前最大最小值处理的Normalization,它的范围严格在[0,1]之间;

而标准化(Standardization)就没有严格的区间,变换后的数据没有范围,只是其均值是0 0,标准差为1,变换后数据的范围是负无穷到正无穷。

归一化和标准化的相同点:

- 它们的相同点在于都能取消由于量纲不同引起的误差;本质上都是一种线性变换,因为二者都是不会改变原始数据排列顺序的线性变换,都是对向量X按照比例压缩再进行平移。

标准化和中心化的区别:

- 标准化是原始分数减去平均数然后除以标准差,中心化是原始分数减去平均数。 所以一般流程为先中心化再标准化。

都能实现无量纲:我的理解就是通过某种方法能去掉实际过程中的单位,从而简化计算。

总结:

| 对比点 | 归一化 | 标准化 |

|---|---|---|

| 概念 | 将数值规约到(0,1)或(-1,1)区间 | 将对应数据的分布规约在均值为0,标准差为1的分布上 |

| 侧重点 | 数值的归一,丢失数据的分布信息,对数据之间的距离没有得到较好的保留,但保留了权重 | 数据分布的归一,较好的保留了数据之间的分布,也即保留了样本之间的距离,但丢失了权值 |

| 形式 |  |  |

| 缺点 | 1.丢失样本间的距离信息; 2.鲁棒性较差,当有新的样本加入时最大值与最小值很容易受异常点影响 | 1.丢失样本间的权重信息; |

| 适合场景 | 1.小数据/固定数据的使用; 2.不涉及距离度量、协方差计算、数据不符合正态分布的时候; 3.进行多指标综合评价的时候; | 1.在分类、聚类算法中,需要使用距离来度量相似性; 2.有较好的鲁棒性,有产出取值范围的离散数据或对最大值最小值未知的情况下; |

| 缩放方式 | 先使用最小值平移,后使用最值差缩放 | 先使用均值u平移,之后用标准差进行缩放 |

| 目的 | 便于消除量纲,将各个指标的数据纳入到综合评价中; | 便于后续的梯度下降和激活函数对数据的处理。因为标准化后,数据以0为中心左右分布,而函数sigmoid,Tanh,Softmax等也都以0为中心左右分布; |

三、标准化和归一化的多种方式

广义的说,标准化和归一化同为对数据的线性变化,所以我们没必要规定死,归一化就是必须到[0,1]之间。

1、归一化的最通用模式Normalization,也称线性归一化:

2、Mean normalization:

3、标准化(Standardization),Z-score规范化,也叫标准差标准化 / 零均值标准化

三、为什么要归一化/标准化?

如前文所说,归一化/标准化实质是一种线性变换,线性变换有很多良好的性质,这些性质决定了对数据改变后不会造成“失效”,反而能提高数据的表现,这些性质是归一化/标准化的前提。比如有一个很重要的性质:线性变换不会改变原始数据的数值排序。

3.1、数据的量纲不同;数量级差别很大

经过标准化处理后,原始数据转化为无量纲化指标测评值,各指标值处于同一数量级别,可进行综合测评分析。

如果直接用原始指标值进行分析,就会突出数值较高的指标在综合分析中的作用,相对削弱数值水平较低指标的作用。

3.2、避免数值问题:太大的数会引发数值问题。

3.3、平衡各特征的贡献

一些分类器需要计算样本之间的距离(如欧氏距离),例如KNN。

如果一个特征值域范围非常大,那么距离计算就主要取决于这个特征,从而与实际情况相悖(比如这时实际情况是值域范围小的特征更重要)。

3.4、一些模型求解的需要:加快了梯度下降求最优解的速度

1)在使用梯度下降的方法求解最优化问题时, 归一化/标准化后可以加快梯度下降的求解速度,即提升模型的收敛速度。如左图所示,未归一化/标准化时形成的等高线偏椭圆,迭代时很有可能走“之”字型路线(垂直长轴),从而导致迭代很多次才能收敛。而如右图对两个特征进行了归一化,对应的等高线就会变圆,在梯度下降进行求解时能较快的收敛。

示例分析假设:

theta1 为房间数量,范围可以是 0~10

theta2 为房间面积,范围可以是 0~1000

数据没有归一化的表达式,可以为:

而数据归一化之后,损失函数的表达式可以表示为:

从归一化的公式中可以看到,变量的前面系数几乎一样,则图像的等高线为类似圆形形状,最优解的寻优过程像上图所示。

同时,从上可以看出,数据归一化后,最优解的寻优过程明显会变得平缓,更容易正确的收敛到最优解。

四、什么时候用归一化?什么时候用标准化?

4.1 归一化、标准化使用场景

- 如果对输出结果范围有要求,用归一化。

- 如果数据较为稳定,不存在极端的最大最小值,用归一化。

- 如果数据存在异常值和较多噪音,用标准化,可以间接通过中心化避免异常值和极端值的影响。

某知乎博主分享了他个人经验:一般来说,我个人建议优先使用标准。对于输出有要求时再尝试别的方法,如归一化或者更加复杂的方法。很多方法都可以将输出范围调整到[0, 1],如果我们对于数据的分布有假设的话,更加有效的方法是使用相对应的概率密度函数来转换。

4.2、所有情况都应当Standardization或Normalization么

当原始数据不同维度特征的尺度(量纲)不一致时,需要标准化步骤对数据进行标准化或归一化处理,反之则不需要进行数据标准化。也不是所有的模型都需要做归一的,比如模型算法里面有没关于对距离的衡量,没有关于对变量间标准差的衡量。比如决策树,他采用算法里面没有涉及到任何和距离等有关的,所以在做决策树模型时,通常是不需要将变量做标准化的;另外,概率模型不需要归一化,因为它们不关心变量的值,而是关心变量的分布和变量之间的条件概率。

五、神经网络为什么要进行归一化

5.1 数值问题

归一化/标准化可以避免一些不必要的数值问题。输入变量的数量级有可能会引起数值问题。因为tansig(tanh)的非线性区间大约在[-1.7,1.7]。意味着要使神经元有效,tansig(w1x1 + w2x2 +b) 里的 w1x1 +w2x2 +b 数量级应该在1.7所在的数量级左右。这时如果输入较大,就意味着权值必须较小,一个较大,一个较小,两者相乘,就引起数值问题了。

假如你的输入是421,你也许认为,这并不是一个太大的数,但因为有效权值大概会在1/421左右,结果是1左右,例如0.00243,那么,在matlab里输入 421*0.00243 == 0.421*2.43,会发现不相等,这就是一个数值问题。

5.2 求解需要

a、初始化:在初始化时我们希望每个神经元初始化成有效的状态,tansig函数在[-1.7, 1.7]范围内有较好的非线性,所以我们希望函数的输入和神经元的初始化都能在合理的范围内使得每个神经元在初始时是有效的。(如果权值初始化在[-1,1]且输入没有归一化且过大,会使得神经元饱和)

b、梯度:以输入-隐层-输出这样的三层BP为例,我们知道对于输入-隐层权值的梯度有2ew(1-a^2)*x的形式(e是误差,w是隐层到输出层的权重,a是隐层神经元的值,x是输入),若果输出层的数量级很大,会引起e的数量级很大,同理,w为了将隐层(数量级为1)映身到输出层,w也会很大,再加上x也很大的话,从梯度公式可以看出,三者相乘,梯度就非常大了。这时会给梯度的更新带来数值问题。

c、学习率:由b知,梯度非常大,学习率就必须非常小,因此,学习率(学习率初始值)的选择需要参考输入的范围,不如直接将数据归一化,这样学习率就不必再根据数据范围作调整。 隐层到输出层的权值梯度可以写成 2ea,而输入层到隐层的权值梯度为 2ew(1-a^2)x ,受 x 和 w 的影响,各个梯度的数量级不相同,因此,它们需要的学习率数量级也就不相同。对w1适合的学习率,可能相对于w2来说会太小,若果使用适合w1的学习率,会导致在w2方向上步进非常慢,会消耗非常多的时间,而使用适合w2的学习率,对w1来说又太大,搜索不到适合w1的解。如果使用固定学习率,而数据没归一化,则后果可想而知。

d、搜索轨迹:上面已解释过

另一篇文章: