- 1Vue sass安装

- 2【HarmonyOS】鸿蒙开发之Slider组件——第3.5章

- 31.简述一个Activity跳转到另一个Activity时,两个Activity生命周期方法的执行过程。2.编写一个程序,要求在第一个界面中输入两个数字,在第二个界面显示第一个界面两个数字的和。_编写一个程序,要求第一个界面中输入两个数字,在第二个界面显示第一个界面两个数字

- 4vscode插件开发-右键菜单:获取选中的文件或者目录_vscode打开当前文件的目录

- 5毕设分享 目标重识别车辆检测与追踪(源码+论文)_毕设做车辆检测

- 6SSM框架整合以及运行流程_ssm框架工作流程

- 7linux启动exe程序命令行参数,linux – 通过putty.exe在Windows命令行上运行shell脚本(带参数)...

- 8SpringBoot接口防重复和日志切面_localvariabletableparameternamediscoverer未找到

- 9nginx使用教程,在k8s上的安装部署,代理内网mysql/docker

- 10unity3d插件分享paint in 3d插件的简单使用_unity绘画插件2d3d paint

三种常见的限流算法(漏桶、令牌桶、滑动窗口)_限流算法之漏桶算法、令牌桶算法

赞

踩

在开发高并发系统时,有三把利器用来保护系统:缓存、降级和限流。那么何为限流呢?顾名思义,限流就是限制流量,就像你宽带包了1个G的流量,用完了就没了。通过限流,我们可以很好地控制系统的qps,从而达到保护系统的目的。本篇文章将会介绍一下常用的限流算法以及他们各自的特点。

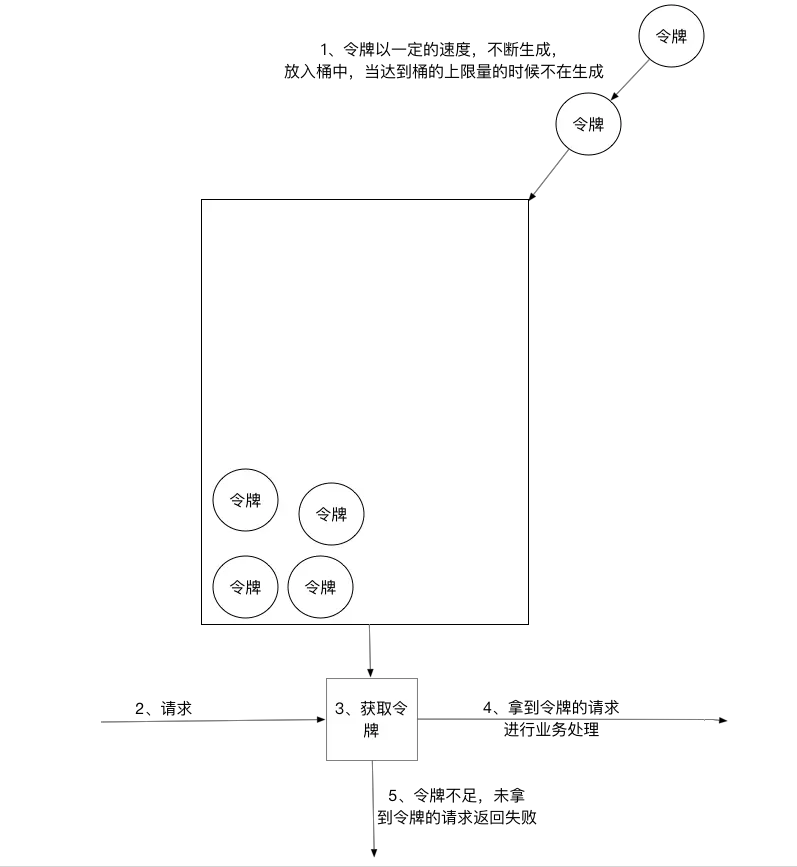

1. 令牌桶算法

令牌桶算法是比较常见的限流算法之一,大概描述如下:

- 所有的请求在处理之前都需要拿到一个可用的令牌才会被处理;

- 根据限流大小,设置按照一定的速率往桶里添加令牌;

- 桶设置最大的放置令牌限制,当桶满时、新添加的令牌就被丢弃或者拒绝;

- 请求达到后首先要获取令牌桶中的令牌,拿着令牌才可以进行其他的业务逻辑,处理完业务逻辑之后,将令牌直接删除;

- 令牌桶有最低限额,当桶中的令牌达到最低限额的时候,请求处理完之后将不会删除令牌,以此保证足够的限流;

实现思路:可以准备一个队列,用来保存令牌,另外通过一个线程池定期生成令牌放到队列中,每来一个请求,就从队列中获取一个令牌,并继续执行。

幸运的是,通过Google开源的guava包,我们可以很轻松的创建一个令牌桶算法的限流器。

- <dependency>

-

- <groupId>com.google.guava</groupId>

-

- <artifactId>guava</artifactId>

-

- <version>18.0</version>

-

- </dependency>

通过RateLimiter类的create方法,创建限流器。

- public class RateLimiterMain {

-

- public static void main(String[] args) {

-

- RateLimiter rateLimiter = RateLimiter.create(10);

-

- for (int i = 0; i < 10; i++) {

-

- new Thread(new Runnable() {

-

- @Override

-

- public void run() {

-

- rateLimiter.acquire()

-

- System.out.println("pass");

-

- }

-

- }).start();

-

- }

-

- }

-

- }

其实Guava提供了多种create方法,方便创建适合各种需求的限流器。在上述例子中,创建了一个每秒生成10个令牌的限流器,即100ms生成一个,并最多保存10个令牌,多余的会被丢弃。

rateLimiter提供了acquire()和tryAcquire()接口 :

- 使用acquire()方法,如果没有可用令牌,会一直阻塞直到有足够的令牌。

- 使用tryAcquire()方法,如果没有可用令牌,就直接返回false。

- 使用tryAcquire()带超时时间的方法,如果没有可用令牌,就会判断在超时时间内是否可以等到令牌,如果不能,就返回false,如果可以,就阻塞等待。

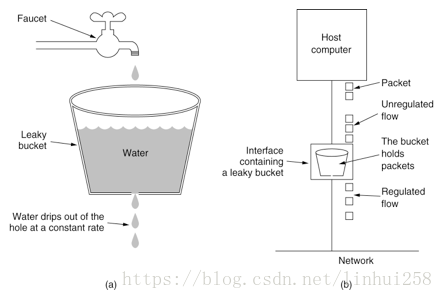

2. 漏桶算法

漏桶算法其实很简单,可以粗略的认为就是注水漏水过程,往桶中以一定速率流出水,以任意速率流入水,当水超过桶流量则丢弃,因为桶容量是不变的,保证了整体的速率。

在算法实现方面,可以准备一个队列,用来保存请求,另外通过一个线程池定期从队列中获取请求并执行,可以一次性获取多个并发执行。

这种算法,在使用过后也存在弊端:无法应对短时间的突发流量。

3. 滑动窗口

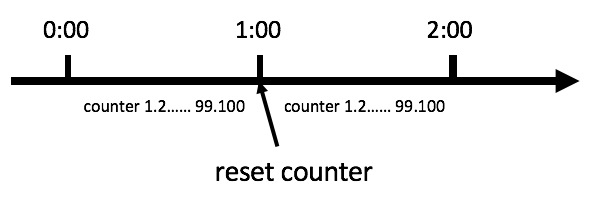

3.1 计数器算法

计数器算法是限流算法里最简单也是最容易实现的一种算法。比如我们规定,对于A接口来说,我们1分钟的访问次数不能超过100个。那么我们可以这么做:在一开 始的时候,我们可以设置一个计数器counter,每当一个请求过来的时候,counter就加1,如果counter的值大于100并且该请求与第一个 请求的间隔时间还在1分钟之内,那么说明请求数过多;如果该请求与第一个请求的间隔时间大于1分钟,且counter的值还在限流范围内,那么就重置 counter,具体算法的示意图如下:

具体的伪代码如下:

- public class CounterTest {

- public long timeStamp = getNowTime();

- public int reqCount = 0;

- public final int limit = 100; // 时间窗口内最大请求数

- public final long interval = 1000; // 时间窗口ms

-

- public boolean grant() {

- long now = getNowTime();

- if (now < timeStamp + interval) {

- // 在时间窗口内

- reqCount++;

- // 判断当前时间窗口内是否超过最大请求控制数

- return reqCount <= limit;

- } else {

- timeStamp = now;

- // 超时后重置

- reqCount = 1;

- return true;

- }

- }

-

- public long getNowTime() {

- return System.currentTimeMillis();

- }

- }

这个算法虽然简单,但是有一个十分致命的问题,那就是临界问题,我们看下图:

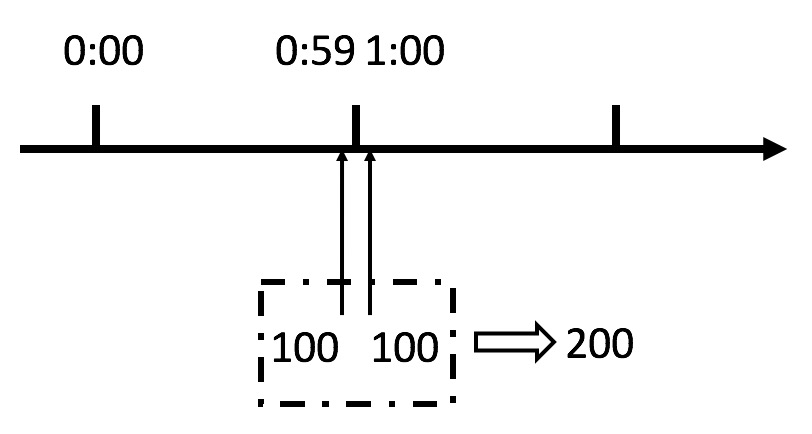

从上图中我们可以看到,假设有一个恶意用户,他在0:59时,瞬间发送了100个请求,并且1:00又瞬间发送了100个请求,那么其实这个用户在 1秒里面,瞬间发送了200个请求。我们刚才规定的是1分钟最多100个请求,也就是每秒钟最多1.7个请求,用户通过在时间窗口的重置节点处突发请求, 可以瞬间超过我们的速率限制。用户有可能通过算法的这个漏洞,瞬间压垮我们的应用。

聪明的朋友可能已经看出来了,刚才的问题其实是因为我们统计的精度太低。那么如何很好地处理这个问题呢?或者说,如何将临界问题的影响降低呢?我们可以看下面的滑动窗口算法。

3.2 滑动窗口算法

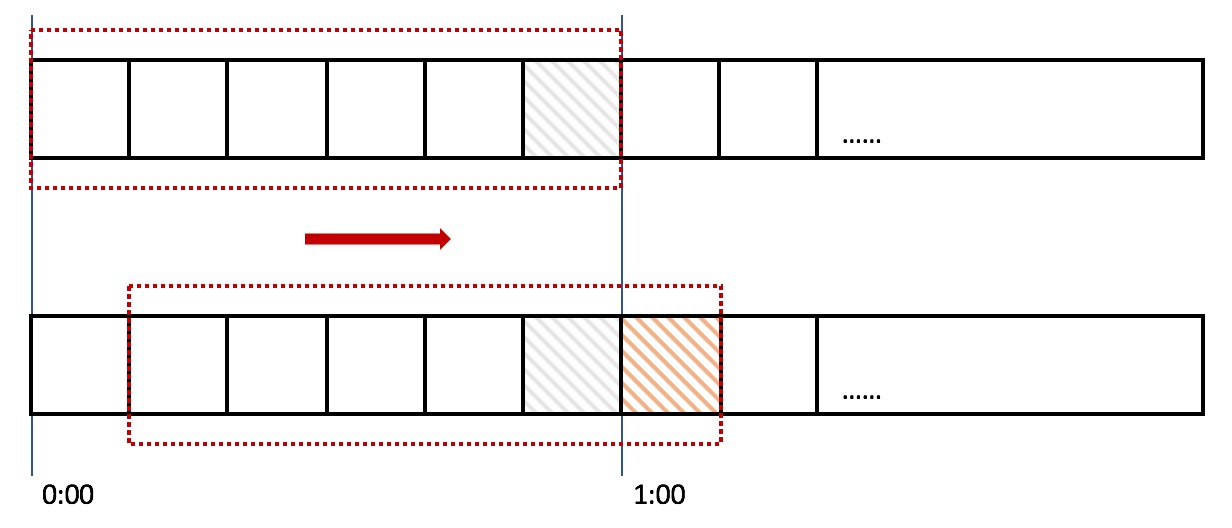

滑动窗口,又称rolling window。为了解决这个问题,我们引入了滑动窗口算法。如果学过TCP网络协议的话,那么一定对滑动窗口这个名词不会陌生。下面这张图,很好地解释了滑动窗口算法:

在上图中,整个红色的矩形框表示一个时间窗口,在我们的例子中,一个时间窗口就是一分钟。然后我们将时间窗口进行划分,比如图中,我们就将滑动窗口 划成了6格,所以每格代表的是10秒钟。每过10秒钟,我们的时间窗口就会往右滑动一格。每一个格子都有自己独立的计数器counter,比如当一个请求 在0:35秒的时候到达,那么0:30~0:39对应的counter就会加1。

那么滑动窗口怎么解决刚才的临界问题的呢?我们可以看上图,0:59到达的100个请求会落在灰色的格子中,而1:00到达的请求会落在橘黄色的格 子中。当时间到达1:00时,我们的窗口会往右移动一格,那么此时时间窗口内的总请求数量一共是200个,超过了限定的100个,所以此时能够检测出来触 发了限流。

我再来回顾一下刚才的计数器算法,我们可以发现,计数器算法其实就是滑动窗口算法。只是它没有对时间窗口做进一步地划分,所以只有1格。

由此可见,当滑动窗口的格子划分的越多,那么滑动窗口的滚动就越平滑,限流的统计就会越精确。