热门标签

热门文章

- 1【AIGC】Stable Diffusion插件安装

- 2DevExpress XAF框架2020新改变!一篇文章带你看完_expressapp framework(xaf)

- 3python打开exe_Win 10 中使用 Python 碰到的奇怪现象

- 4python bs4+多线程爬取一整部小说(小白第一篇博客)_多线程爬取小说

- 5使用eXtplorer本地搭建文件管理器并内网穿透远程访问本地数据

- 6c++视觉检测-----Canny边缘算子_cv::canny

- 7华为ICT大赛网络赛道-安全笔记

- 8安装conda搭建python环境(保姆级教程)_conda创建python虚拟环境

- 9AD域服务器搭建 (图文详解)

- 10Mac安装配置maven - Java项目管理_zsh配置java maven

当前位置: article > 正文

Swish激活 hswish激活

作者:盐析白兔 | 2024-02-28 20:55:17

赞

踩

hswish

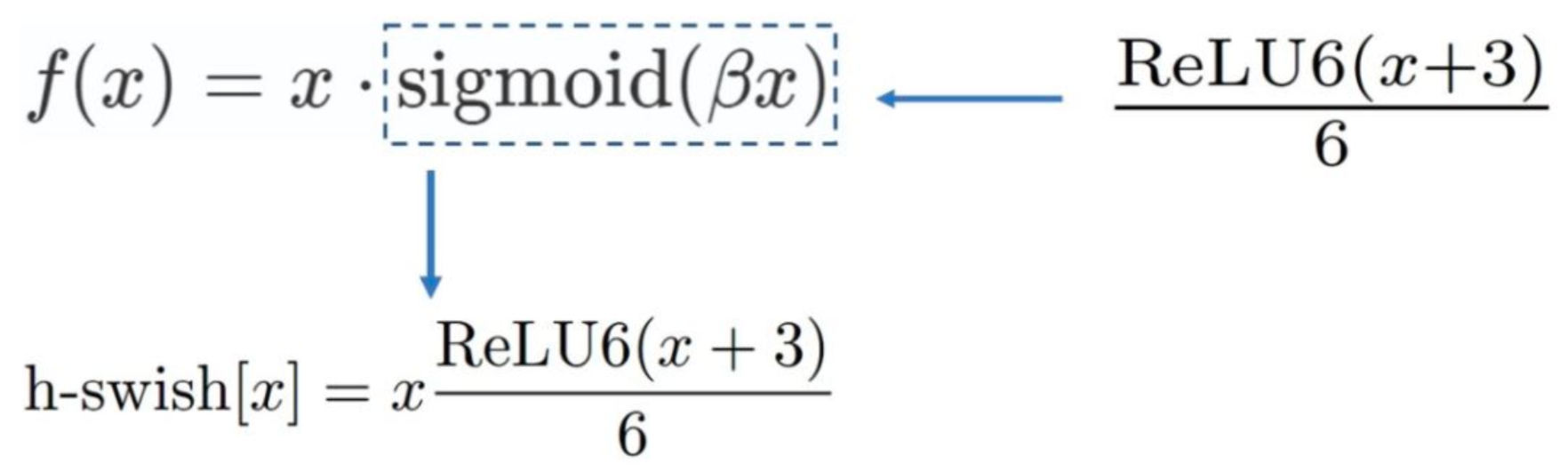

激活函数h-swish是MobileNet V3相较于V2的一个创新,是在谷歌大脑2017年的论文Searching for Activation Functions中swish函数的基础上改进而来,用于替换V2中的部分ReLU6。

swish的作者认为,该函数具有无上界、有下界、平滑、非单调的特点,在深层模型上优于ReLU。但是,由于sigmoid函数计算复杂(sigmoid(x) = (1 + exp(-x))^(-1)),所以V3改用近似函数来逼近swish,这使其变得更硬(hard)。作者选择了ReLU6作为这个近似函数,有两个原因:1、在几乎所有的软件和硬件框架上都可以使用ReLU6的优化实现;2、ReLU6能在特定模式下消除由于近似sigmoid的不同实现而带来的潜在的数值精度损失。

作者认为,随着网络的深入,应用非线性激活函数的成本会降低,能够更好的减少参数

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/盐析白兔/article/detail/161707

推荐阅读

相关标签