- 1《深入浅出LLM基础篇》(一):大模型概念与发展_大模型发展时间线

- 2Hbase在集群中启动时碰到的问题

- 3React--useState_react usestate

- 4教程:利用LLaMA_Factory微调llama3:8b大模型_llama3模型微调保存

- 5【C语言课设】经典植物大战僵尸丨完整开发教程+笔记+源码_植物大战僵尸csdn

- 6Applied soft computing期刊投稿时间线_applied soft computing 需要上传代码吗

- 72024年前端最新2 年前端面试心路历程(字节跳动、YY、虎牙、BIGO),前端基础开发

- 8华为认证 | 华为HCIE认证体系有哪些?考哪个比较好?_华为网络认证体系

- 9微信扫码登录_第三方微信扫码登录

- 1010月华为OD面经整理分享,感谢三位上岸考友分享经验

YOLO改进系列之注意力机制(GAM Attention模型介绍)_注意力模块gam介绍

赞

踩

模型结构

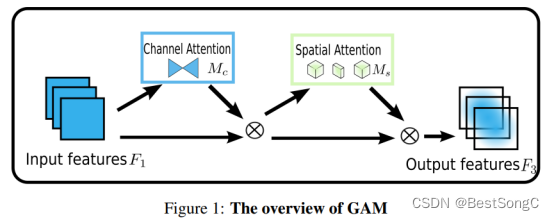

为了提高计算机视觉任务的性能,人们研究了各种注意力机制。然而以往的方法忽略了保留通道和空间方面的信息以增强跨维度交互的重要性。因此,liu提出了一种通过减少信息弥散和放大全局交互表示来提高深度神经网络性能的全局注意力机制。作者的目标是设计一种注意力机制能够在减少信息弥散的情况下也能放大全局维交互特征,采用序贯的通道-空间注意力机制并重新设计了CBAM子模块,GAM Attention的整体结构如下图所示。

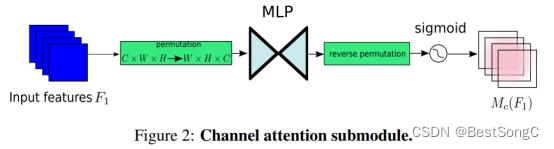

GAM Attention整体包含通道注意力模块和空间注意力这两个模块。通道注意子模块使用三维排列来在三个维度上保留信息。然后,它用一个两层的MLP放大跨维通道-空间依赖性。(MLP是一种编码-解码器结构,与BAM相同,其压缩比为r),通道注意子模块如下图所示。

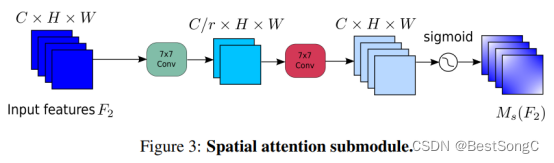

在空间注意力子模块中,为了关注空间信息,使用两个卷积层进行空间信息融合,还从通道注意力子模块中使用了与BAM相同的缩减比r。与此同时,由于最大池化操作减少了信息的使用,产生了消极的影响。这里删除了池化操作以进一步保留特性映射。空间注意力子模块如下图所示。

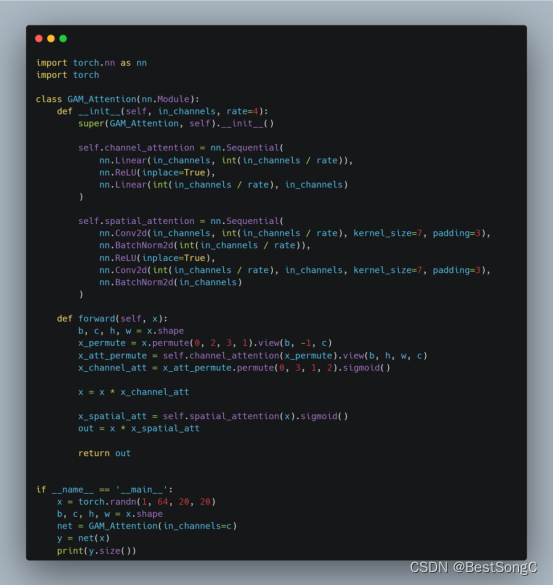

实现代码

GAM Attention的实现代码如下所示:

YOLOv5模型改进

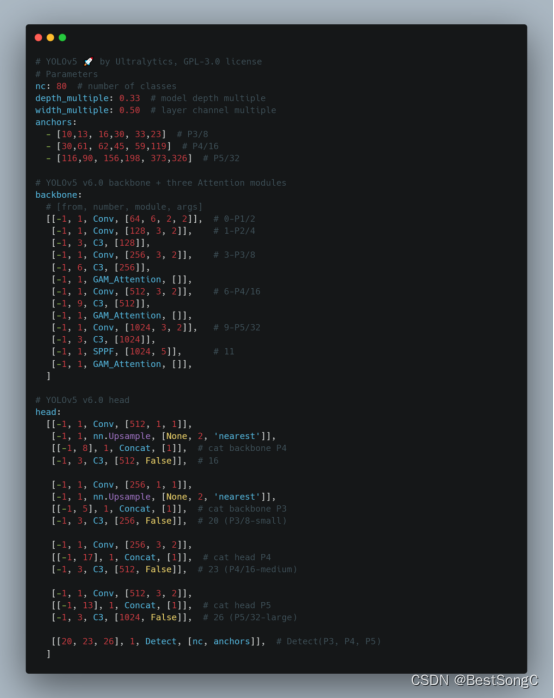

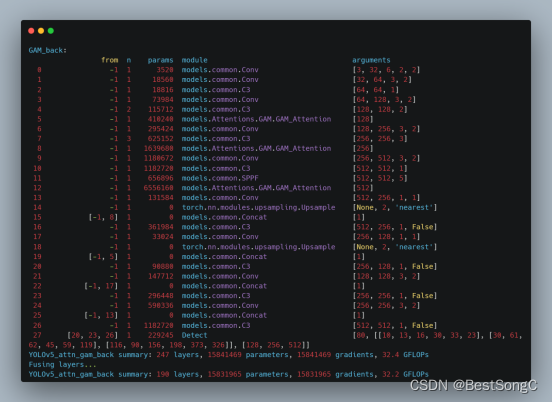

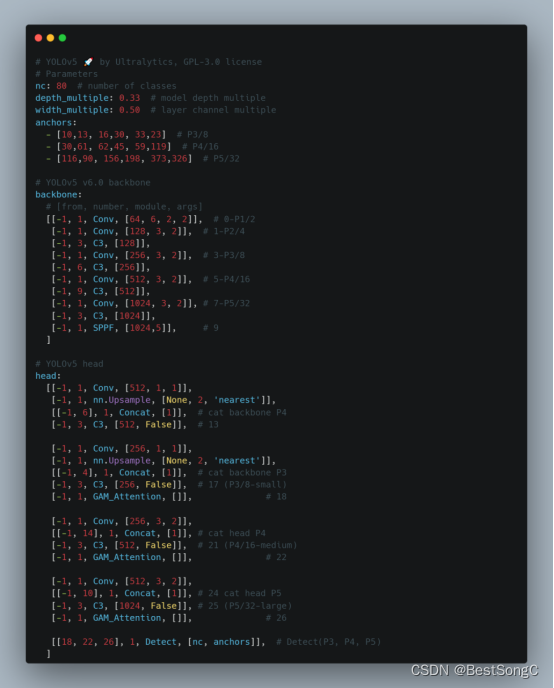

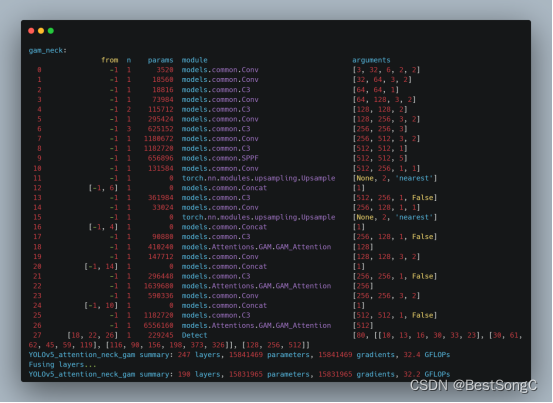

本文在YOLOv5目标检测算法的Backbone和Head部分分别加入GAM Attention来增强目标提取能力,以下分别是在Backbone以及Head中改进的模型结构和参数(以YOLOv5s为例)。

在Backbone部分

在Head部分

总结

GAM Attention提出一种通过减少信息弥散和放大全局交互表示来提高深度神经网络性能的全局注意力机制。此外,CloAttentionGAM Attention可进一步应用于YOLOv7、YOLOv8等模型中,欢迎大家关注本博主的微信公众号 BestSongC,后续更多的资源如模型改进、可视化界面等都会在此发布。另外,本博主最近也在MS COCO数据集上跑了一些YOLOv5的改进模型,实验表明改进后的模型能在MS COCO 2017验证集上分别涨点1-3%,感兴趣的朋友关注后回复YOLOv5改进。