- 1编写mapreduce程序实现对输入文件的词频统计排序_MapReduce编程实例:单词计数

- 2IPsec_需要配置ipsec的感兴趣流吗

- 35月份,京东 Android开发面经分享!,2024年最新大厂测试开发面试题_京东安卓面试题

- 4【Spring Boot】认识 JPA 的接口

- 5大数据分析工程师入门8--Spark基础

- 6一万字教程详解:教会你如何在 SpringBoot 中使用 WebSocket(典藏版)

- 7opencv打开摄像头很慢的解决方法_opencv读取摄像头运行卡死

- 8【深度学习】实践方法论

- 9不要使用mybatisplus_为什么要使用新一代ORM框架sqltoy-orm

- 10swift笔记_weak' must not be applied to non-class-bound 'any

AI大语言模型学习笔记之三:协同深度学习的黑魔法 - GPU与Transformer模型

赞

踩

Transformer模型的崛起标志着人类在自然语言处理(NLP)和其他序列建模任务中取得了显著的突破性进展,而这一成就离不开GPU(图形处理单元)在深度学习中的高效率协同计算和处理。

Transformer模型是由Vaswani等人在2017年提出的,其核心思想是自注意力机制(self-attention mechanism),它在处理序列数据时能够捕捉长距离依赖关系,从而在NLP等任务中取得了优异的性能。

而GPU(图形处理单元)在这一突破性进展中发挥了重要作用。深度学习模型的训练通常需要大量的计算资源,而传统的中央处理单元(CPU)由于硬件架构的差异和并行处理性能的限制,在处理需要大量矩阵乘法和其他张量计算的高度并行深度学习任务时速度较慢。

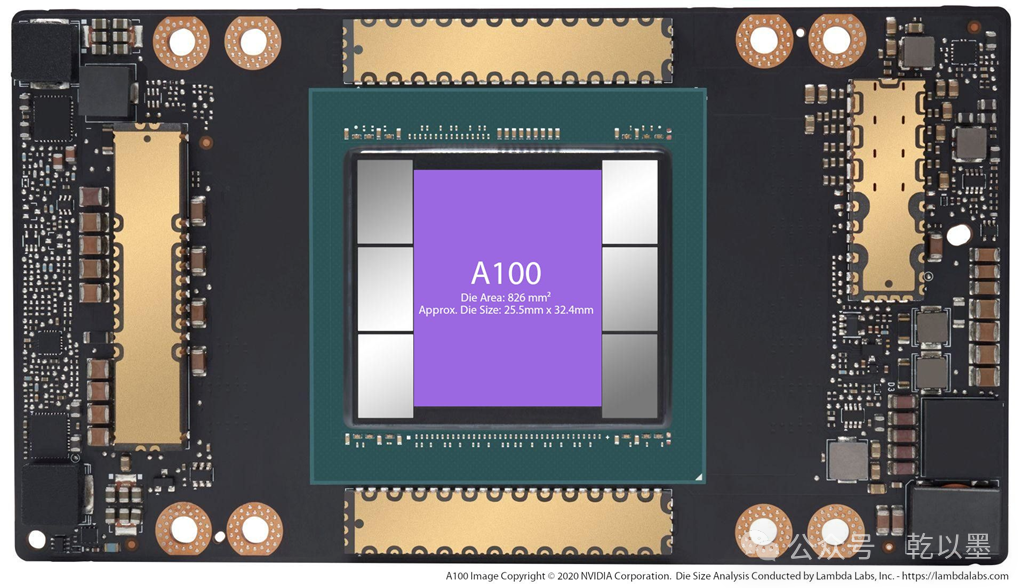

NVIDIA A100 GPU

NVIDIA A100 GPU

而图形处理单元(GPU)是专门设计用于高度并行计算的专用芯片,特别适合加速深度学习任务。由于Transformer模型具有大量的参数,会对大规模的数据进行大量的高速并行计算和训练,GPU的并行处理能力就为大模型的训练提供了巨大的加速,因此更适合深度学习工作负载,使研究人员和工程师能够充分利用GPU的性能进行模型训练。

NVIDIA A100 GPU

NVIDIA A100 GPU

在训练大规模的Transformer模型时,使用GPU可以大幅缩短训练时间,加速模型的研发和部署过程。

因此,Transformer模型在NLP和序列建模任务中的成功与GPU的协同处理密不可分,为深度学习领域的发展和应用带来了显著的影响。

那么,在进行Transformer模型的深度学习任务时,GPU是如何运作的呢?下面我尝试通过一个简单的例子看看是否能够说明各个部件是如何协同工作的。

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。