- 1【C++】手撕vector(vector的模拟实现)_c++手撕vector

- 2UniApp组件:常见的组件及其用法_uniapp uni组件

- 3罗技G29游戏方向盘试玩拆解,带震动力反馈

- 4二期 , 第二章 数据库的实现---- 课后作业--- 创建图书馆管理系统数据库_使用以下命令方式完成一下操作(1)创建图书借阅数据库

- 5吴恩达《深度学习专项》笔记(十三):CNN应用:人脸识别与风格迁移_吴恩达 深度学习 人脸识别

- 6生成模型和判别模型的对比,懂这俩机器学习不在话下 最大熵模型_生成式要label吗

- 7Java必背面试题及答案整理汇总(2023年最新版)_2023 java面试问题大全及答案大全

- 8python列表appendtext_python-默认文本以及列表textvariable Entry小部...

- 9[计算机网络]十二、(网络层)防火墙以及设置防火墙的相关命令-1_绿盟nf防火墙收集信息命令

- 10串行RapidIO(Serial RapidIO,SRIO):协议介绍_srio协议

AI基础知识(2)--决策树,神经网络

赞

踩

1.什么是决策树?

决策树是一类常见的机器学习方法,决策树是基于树的结构来进行决策。决策过程中提出的每一个问题都是对于属性的“测试”,决策的最终结论对应了我们希望的判定结果。一个决策树包含一个根节点,若干个内部节点和若干个叶子节点。其中叶子节点对应于决策结果,其他每一个节点对应于一个属性测试。每个结点对应的样本集合,根据属性测试被划分到子节点中,流程遵循递归“分而治之”(divide-and-conquer)的策略。引用《机器学习》西瓜书的图片:

2. 什么是信息熵(information entropy)?

是度量样本集合纯度(purity)的一种指标,信息熵越小,集合纯度越高。对于集合D的信息熵计算公式如下,其中pk是集合中第k类样本所占的比例:

3.什么是信息增益(information gain)?

信息增益越大,意味着使用属性a所划分获得的纯度提升越大。一般决策树的结点选择当前信息增益最大的属性作为划分结点,公式如下,其中Dv表示D中所有在属性a上取值为av的样本:

4.什么是增益率(gain ratio)?

信息增益对可取值数目较多的属性有所偏好,为了减少这种偏好带来的不利影响。引入了增益率,增益率对可取值数目较少的属性有所偏好。增益率准则使用的时候,先选择高于平均信息增益水平的attribute,然后再从中选择增益率最高的。

5.什么是剪枝(pruning)?

剪枝是决策树解决过拟合的一种方法,通过主动去掉一些分支来解决过拟合的风险。基本策略有预剪枝(pre-pruning)和后剪枝(post-pruning)。预剪枝是基于信息增益准则,我们首先要选择一个信息增益高的结点进行划分,预剪枝要使用性能评估方法对划分前后的泛化性能进行估计。后剪枝是先从训练集生成一棵完整的决策树,然后自底向上对所有结点进行逐一考查,训练时间开销比未剪枝和预剪枝都大。

6.什么是神经网络(neural network)?

神经网络是具有适应性的简单单元组成的广泛并行互联的网络,它的组织能够模拟真实神经系统对现实世界做出的反应,是一个包含很多参数的数学模型。神经网络的学习过程,就是根据训练数据来调整神经元之间的“连接权”(connection weight)以及每一个功能神经元的阈值。

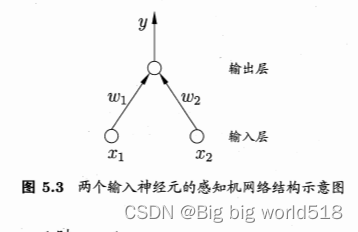

7.什么是感知机(perceptron)?

感知机由输入层神经元和输出层神经元组成,输入层接收外界信号传递给输出层,输出层是M-P神经元。感知机只有输出层是功能神经元(function neuron),即只有输出层用激活函数进行处理。若感知机预测正确则 不修改,否则

按照学习率进行修改

。感知机只能处理线性可分问题(linearly neuron),如果是线性可分问题,那么感知机的学习过程一定会收敛(converge);否则感知机的学习过程会发生振荡(fluctuation),即

不会收敛成为一个稳定的向量。

8.什么是多层前馈神经网络(multi-layer feedforward neural network)?

是一种常见的神经网络,每一层神经元与下一层神经元互连,神经元之间不存在同层连接,也不存在跨层连接。其中输入层接收神经元输入,隐含层(hidden layer)和输出层神经元对信号进行最终加工(激活函数),最终结果由输出层神经元输出。