热门标签

热门文章

- 1IDEA 出现问题:git提交commit时Perform code analysis卡住解决方案_performing code analysis卡住

- 2选择哪种量化方法适合您?(GPTQ vs. GGUF vs. AWQ)_gptq int-4 / int8、awq 和 gguf 权重

- 3java.io.IOException: Too many open files

- 4如何将本地项目上传到gitee

- 5在Ubuntu操作系统和centos7上安装docker环境的详细步骤_ubuntu加入docker公钥

- 6雪花算法生成的ID过长,前端接收精度丢失问题_雪花id长度前端

- 7作为一名程序员这些代码托管工具你都知道吗?

- 8如何在C#中调用Python程序_c# 调用powershell 执行python程序

- 9github创建仓库和拉取代码_idea如何从github上拉取代码

- 10代码托管(二)git(1)介绍

当前位置: article > 正文

深度学习——回归算法Regression

作者:繁依Fanyi0 | 2024-04-11 10:46:09

赞

踩

深度学习——回归算法Regression

同样是监督算法,回归是求解连续值的相关关系,分类是对离散值的划分。

图1

如图1,我们想要模拟离散点的走势。

一、一元线性回归

一元线性回归就是假设拟合曲线是一条直线,现在求解这条直线方程。

假设

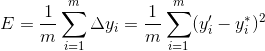

那么如何使得这条曲线拟合,那么就要提出均方误差

二、均方误差

均方误差就是用二次方来衡量真实值和预测值直接的距离,然后再在所有样本上取平均。

公式如下:

为什么是均方误差?

基本假设

- g(x)是f(x)的估计

- r’ = g(x) + ε

- 假设 ε 服从均值为0,方差为σ^2的高斯分布

- 那么显然的g(x) + ε 满足均值为g(x),方差为σ^2的高斯分布

极大似然估计

- 对于估计值的参数值,即求在r’发生的情况下,x的最大似然估计

- 计算样本集上的似然函数

- b部分为常数,不影响最大值点

- 因为p(r|x) ~ N(g(x),σ^2),所以

- 化简出的式子中A为常数,那么最后最大化 L 意味着最大化B部分,也就是最小化 -B,也就是均方误差。

- 如果分布不再是高斯分布,那么均方误差不再管用

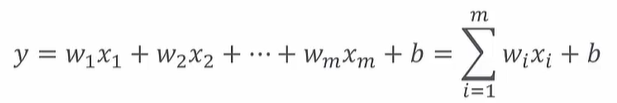

三、多元线性回归

表达式的y仍然是一维,而x变成多维

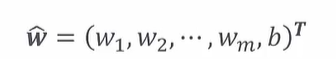

- 矩阵表示

- 然后把x,y都用矩阵表示

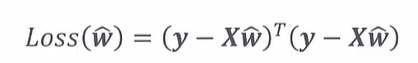

- Loss损失值也要矩阵表示

- 求解Loss的方式如下:

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/繁依Fanyi0/article/detail/404537

推荐阅读

相关标签