- 1/etc目录文件介绍_/etc主要文件介绍

- 2mysql查询缓存打开命令_MySql | 查询缓存笔记

- 3linux 手动编译最新gcc_gcc-multilib和gcc-hppa64-linux-gnu

- 4(java毕业设计源码)基于java银行储蓄管理系统

- 5python web服务器部署_pywebio服务器模式

- 6银河麒麟V10下载安装使用体验(下)之安装VMware_银河麒麟安装vmware

- 7VM虚拟机里安装Linux系统教程详解_vm安装linux系统教程

- 8VMware + Ubuntu设置为服务器,主机Win10设置为客户端 => 网络配置及IDEA SSH配置_win10配置ubuntu虚拟机网络

- 9hdu6602 Longest Subarray(线段树)_线段树 出现次数大于等于k

- 10Python 数据分析三剑客之 Pandas(四):函数应用、映射、排序和层级索引_rank排序函数的下标索引

张量(一):张量基础_单位张量

赞

踩

从今天开始,笔者将会持续更新关于张量的相关知识和最新研究成果。我们这里所说的张量知识主要是关于张量低秩分解,张量补全等算法和应用。在如今神经网络大火的年代,张量补全等算法无疑为预测、去噪等问题提供了新的解决方法和思路。接下来,且听我娓娓道来。

友情提醒:默认读者拥有线性代数的基础。

目录

一、何为张量?

在本科阶段,我们接触到最多的数据结构就是矩阵与向量。一维的向量与二维的矩阵分别能表示数据的一种与两种信息。然而,现实世界里大多数数据都具有多重属性,例如一个人就有姓名、年龄、性别、民族等多种信息,因此单纯的向量或矩阵已无法描述数据的多重属性。

张量即是对向量和矩阵的一种高阶扩展。我们可以将向量看做一维张量,矩阵看做二维张量,当然,遇到的更多的是三维张量、四维张量等。从几何的角度来说,一维张量构成的就是一条线,二维张量是平面上的矩形,而三维张量是立方体,以此类推。

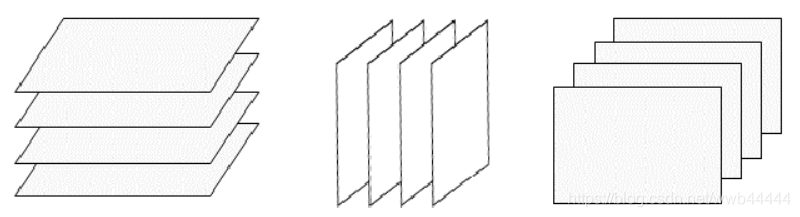

从另一个角度去理解,三维张量可以看做是多个矩阵堆叠而成,不过由于三维张量具有三个维度(表达三种属性),因此堆叠矩阵的方式也必然存在三种,即水平切片、侧向切片和正面切片,如下图:

张量的应用面很广,大多数的数据都可用张量表示,例如一张彩色图片就是一个三维张量,分别由像素矩阵和第三维的RGB颜色通道组成。因此,构成彩色图片的张量大小为N*N*3。

二、张量的相关概念

- 单位张量:单位张量

IϵRN×N×N3 ,它的第一个正面切片是一个单位矩阵,其他的切片为零矩阵。 - 正交张量:若张量

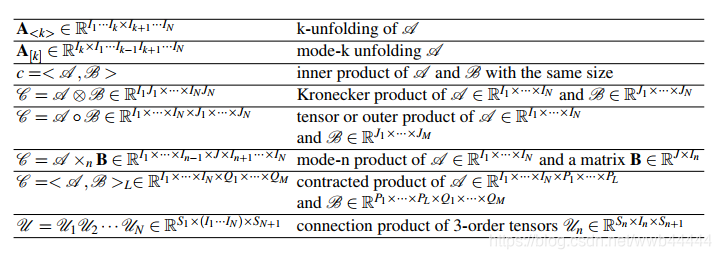

Q 是正交张量,那么满足Q∗QT=QT∗Q=I 。 f -对角张量:若张量的每一个正面切片都是对角矩阵,那么该张量是f -对角化的。- 张量乘积:张量乘积即张量之间的乘积,根据定义的不同,有主要以下几种:

5. 张量秩:对矩阵算法到张量领域的迁移以及现有对张量算法的改进大多围绕着秩定义的修改进行。张量秩的定义目前主要有以下两种,多线性秩和管秩。

- 多线性秩:对张量

A∈RN1×N2×N3 ,多线性秩用向量r表示,维度为N3 。计算方法为张量先做傅里叶变换,然后正面切片,对每片计算秩,依次从上到下放入向量即得到multi-rank。 - 管秩:计算方法为先进行t-SVD分解,对结果中的S(对角管道组成)统计非零管道的数量即为tubal-rank。

6. 张量核范数:定义为傅里叶变换后的张量正面切片的奇异值之和。它是张量multi-rank的

以上各概念将会在张量补全,张量主成分分析等算法中起着重要作用,在此仅做介绍。