- 1阿里云存储oss依赖报错解决方法_com.alibaba.cloud:spring-cloud-alibaba-dependencie

- 2100天精通Python(实用脚本篇)——第118天:基于selenium和ddddocr库实现反反爬策略之验证码识别_python ddddocr

- 3django框架对于templates的模板文件,如何调用其他静态文件,如css,js或加载图片。以及静态文件找不到的问题日志报[log.py:224] [log:log_response]的解决

- 4maya导出fbx没动画_Qualisys应用|用户友好型动画动作捕捉系统

- 5概率机器人学习笔记-第三章_概率机器人课后答案第3章

- 6【网安播报】GitHub上的恶意Visual Studio 项目推送 Keyzetsu 恶意软件

- 7STM32开发板

- 8CentOS 防火墙配置(firewall)

- 9Android背景Shape颜色渐变—放射渐变_android 放射性图实现

- 10区块链钱包开发(Android篇),深入解析android核心组件和应用框架_区块链android

大模型日报-20240122_spin llm

赞

踩

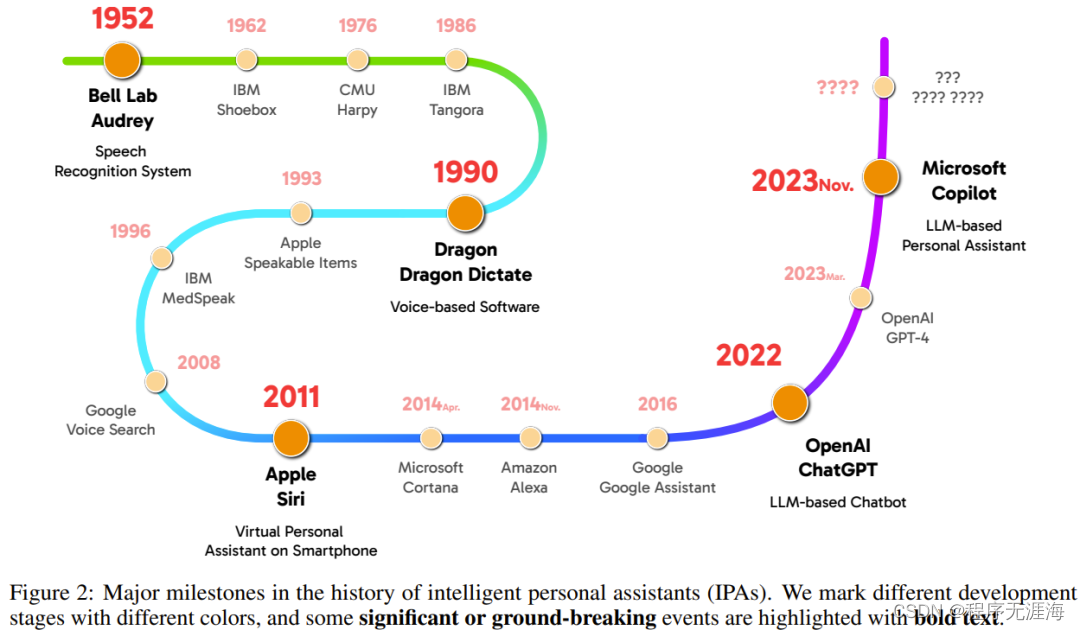

清华、小米、华为、 vivo、理想等多机构联合综述,首提个人LLM智能体、划分5级智能水平

https://mp.weixin.qq.com/s/JYB4BzsXhWF8pEUUkvn_GQ

想必这些唤醒词中至少有一个曾被你的嘴发出并成功呼唤出了一个能给你导航、讲笑话、添加日程、设置闹钟、拨打电话的智能个人助理(IPA)。可以说 IPA 已经成了现代智能手机不可或缺的标配,近期的一篇综述论文更是认为「个人 LLM 智能体会成为 AI 时代个人计算的主要软件范式」。这篇个人 LLM 智能体综述论文来自国内多所高校和企业研究所,包括清华大学、小米、华为、欢太、vivo、云米、理想汽车、北京邮电大学、苏州大学。文中不仅梳理了个人 LLM 智能体所需的能力、效率和安全问题,还收集并整理了领域专家的见解,另外还开创性地提出了个人 LLM 智能体的 5 级智能水平分级法。该团队也在 GitHub 上创建了一个文献库,发布了相关文献,同时也可供 IPA 社区共同维护,更新最新研发进展。

英伟达新对话QA模型准确度超GPT-4,却遭吐槽:无权重代码意义不大

https://mp.weixin.qq.com/s/uLVVfQNau_SLUPptCDQNmw

一年多来,ChatGPT 及后续产品引发了生产和研究社区中构建问答(QA)模型的范式转变。尤其是在实际应用中,QA 模型在以下情况成为首选。近日,在英伟达的一篇论文中,研究者提出了一个具有 GPT-4 级别准确度的白箱对话 QA 模型 ChatQA 70B。他们采用了两阶段指令调优方法以及用于对话 QA 的 RAG 增强检索器、严格的数据管理过程。

罗氏制药和GRCEH团队开发可解释机器学习方法,用于分析治疗性抗体的免疫突触和功能表征

https://mp.weixin.qq.com/s/upntqHl93p_uhFsMaHBjbg

治疗性抗体广泛用于治疗严重疾病。它们中的大多数会改变免疫细胞并在免疫突触内发挥作用。指导体液免疫反应的重要细胞间相互作用。尽管生成并评估了许多抗体设计,但缺乏用于系统抗体表征和功能预测的高通量工具。德国环境健康研究中心(German Research Center for Environmental Health)和罗氏制药(Roche)的研究团队,开发了一个全面的开源框架 scifAI(单细胞成像流式细胞术 AI),用于对成像流式细胞术 (IFC) 数据进行预处理、特征工程和可解释的预测机器学习。

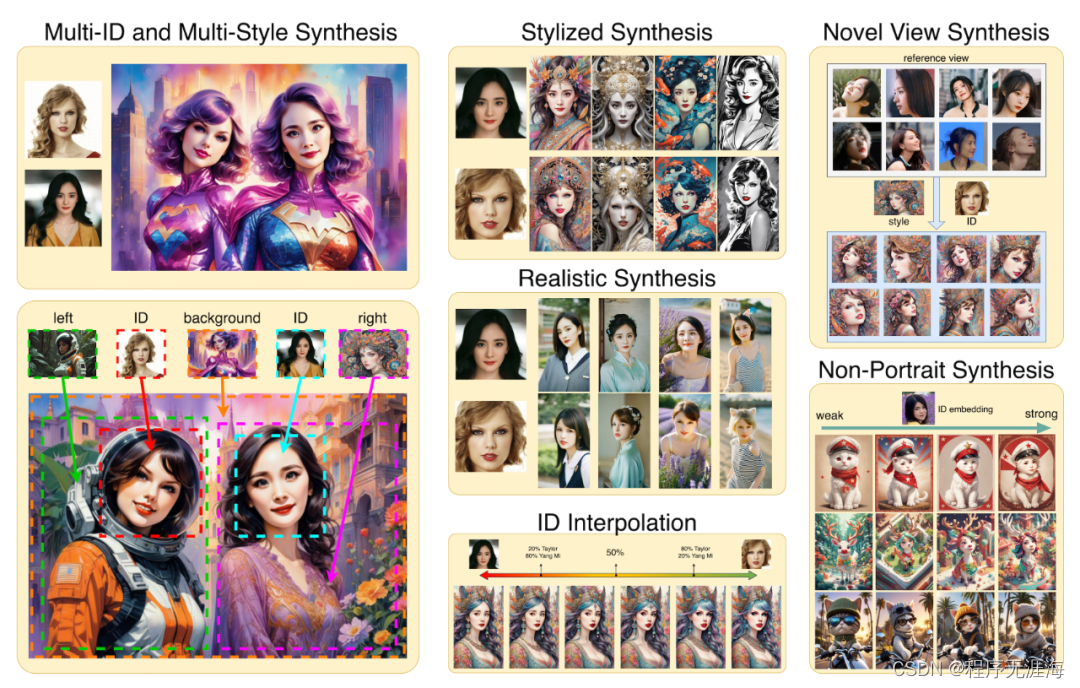

一张照片,为深度学习巨头们定制人像图片

https://mp.weixin.qq.com/s/7d8En7idif4UFSGo_6MFsg

主题驱动的文本到图像生成,通常需要在多张包含该主题(如人物、风格)的数据集上进行训练,这类方法中的代表工作包括 DreamBooth、Textual Inversion、LoRAs 等,但这类方案因为需要更新整个网络或较长时间的定制化训练,往往无法很有效地兼容社区已有的模型,并无法在真实场景中快速且低成本应用。而目前基于单张图片特征进行嵌入的方法(FaceStudio、PhotoMaker、IP-Adapter),要么需要对文生图模型的全参数训练或 PEFT 微调,影响原本模型的泛化性能,缺乏与社区预训练模型的兼容性,要么无法保持高保真度。为了解决这些问题,来自 InstantX 团队的研究人员提出了 InstantID,该模型不训练文生图模型的 UNet 部分,仅训练可插拔模块,在推理过程中无需 test-time tuning,在几乎不影响文本控制能力的情况下,实现高保真 ID 保持。

AI看视频自动找“高能时刻”|字节&中科院自动化所@AAAI 2024

https://mp.weixin.qq.com/s/dFxGrYZbq0uxRs0QwLM8AQ

字节跳动联合中科院自动化研究所提出新方法,用AI快速检测出视频中的高光片段,对输入视频的长度以及期望提取的高光长度都具有极高的灵活性,相关论文已被AAAI 2024收录。

大模型自我奖励:Meta让Llama2自己给自己微调,性能超越了GPT-4

https://mp.weixin.qq.com/s/tBVosNn07shQZxfvtSlaOw

大模型领域中,微调是改进模型性能的重要一步。随着开源大模型逐渐变多,人们总结出了很多种微调方式,其中一些取得了很好的效果。最近,来自 Meta、纽约大学的研究者用「自我奖励方法」,让大模型自己生成自己的微调数据,给人带来了一点新的震撼。在新方法中,作者对 Llama 2 70B 进行了三个迭代的微调,生成的模型在 AlpacaEval 2.0 排行榜上优于一众现有重要大模型,包括 Claude 2、Gemini Pro 和 GPT-4。

奥特曼筹数十亿美元建全球晶圆厂网络,自造AI芯片

https://mp.weixin.qq.com/s/VoPLuWtOQmJE4hoGNvC5QA

据彭博社消息,OpenAI CEO 萨姆・奥特曼(Sam Altman)近日再次为一家人工智能芯片企业筹集了数十亿美元的资金,希望建立一个范围覆盖全球的晶圆厂「企业网络(network of factories)」,并计划与未具名的顶级芯片制造商合作。

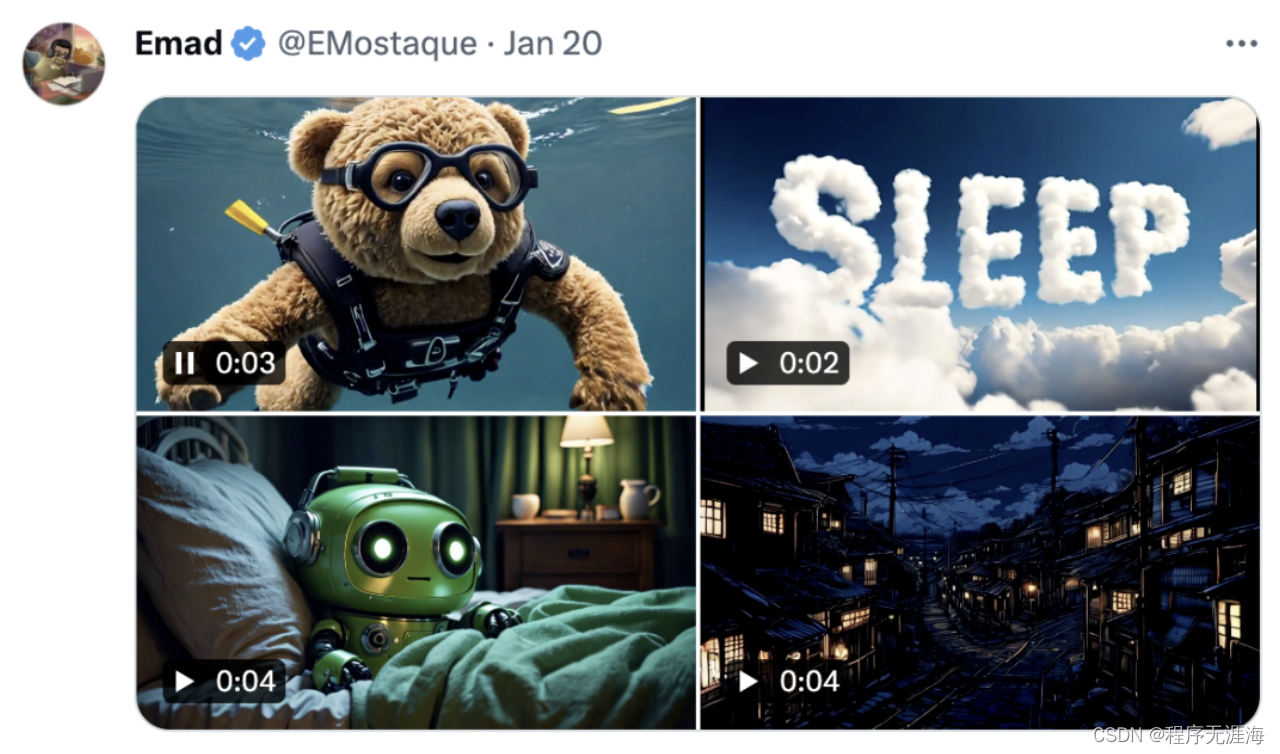

Stability AI杀回来了:视频生成新Demo效果惊人,网友:一致性超群

https://mp.weixin.qq.com/s/Xt3CZ_F3r0_iMG0YjE2GyA

Stable Diffusion要王者归来了?Stability AI CEO Emad Mostaque最新推文,四段视频引人无数遐想。不少网友怀疑,这是Stable Video Diffusion新版本的演示Demo。因为从效果上看,不管是画面清晰度、一致性还是流畅度都十分惊人。

两位 DeepMind 员工离职创立 AI 模型首轮或融 2 亿美金,Flexport 又拿了2.6亿美金

https://mp.weixin.qq.com/s/n_GBvbAkkNa4sn8UdL6vCg

Flexport CEO Ryan Petersen 在 X 上宣称,已经从 Shopify 那里融了 2.6 亿美金的新一轮融资。比较有意思的是,此次融资是一个 uncapped convertible note,也就是一种无估值上限的可转换债券,一般用于早期创业项目的投资,是对创业公司非常有利的一种融资方式。此次在 Flexport 这么后期的公司里采用这种方式,估计是对 Flexport 过去一年面临的各种问题的一个支持,在过去一年,因为疫情其业务量出现大幅下降,导致公司面临一系列的问题,最后 Flexport 经历了两次 20% 的裁员。

Wolf分享datatrove,nanotron:两个用于大规模数据处理和大型模型训练的工具

https://x.com/Thom_Wolf/status/1748664223624781864?s=20

我们刚刚开源了两个用于大规模数据处理和大型模型训练的工具:

•datatrove – 所有关于Web规模数据处理的事务:去重、过滤、分词 – https://github.com/huggingface/datatrove

•nanotron – 所有关于三维并行性的事务:轻量级且快速的大型语言模型训练 – https://github.com/huggingface/nanotron

这两个都是极简的框架,代码行数在5-10千之间,依赖非常有限。

请享用!

•因为它们是站在开源软件巨人的肩膀上的

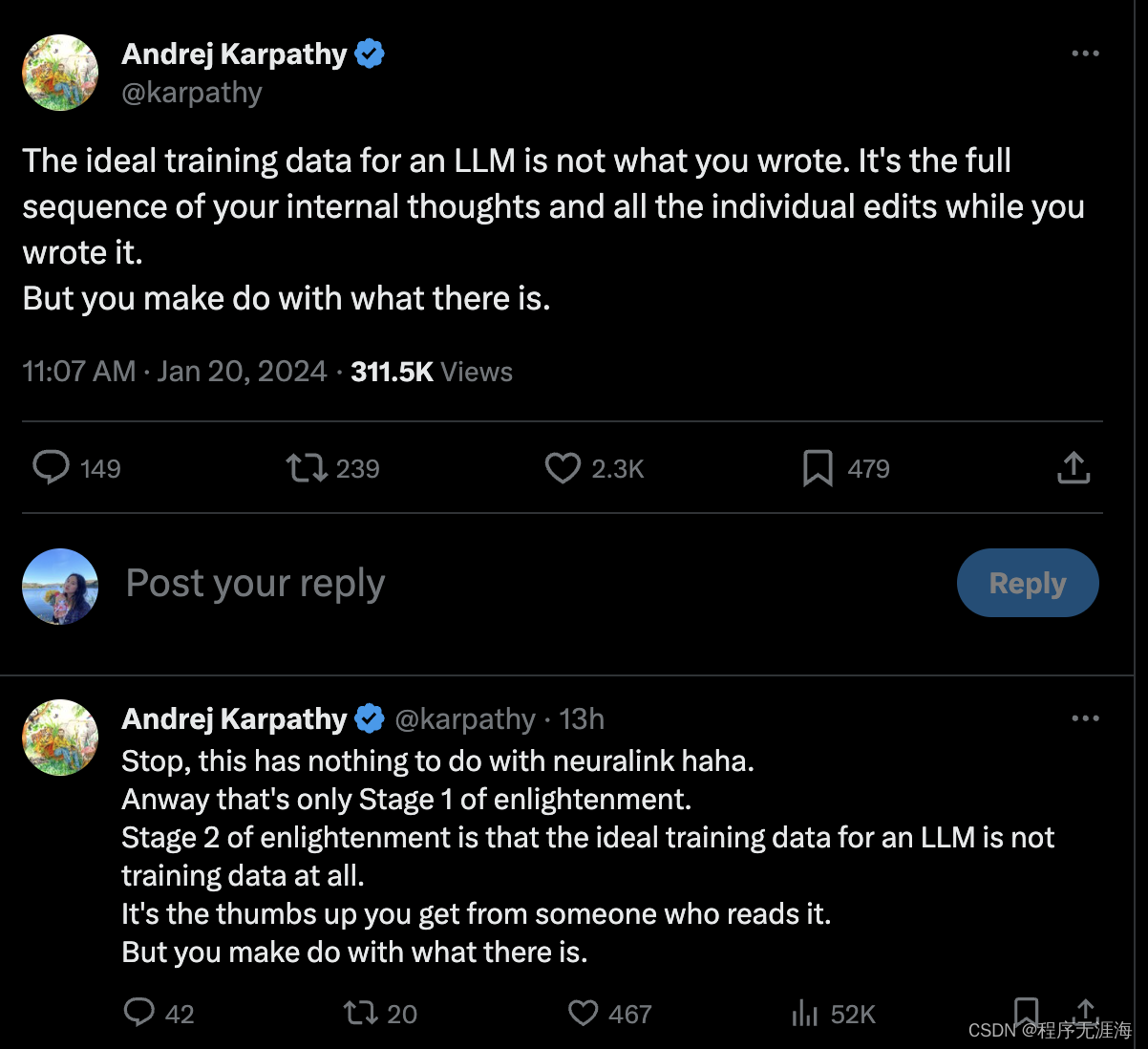

Karpathy:你所写的东西不是LLM理想的训练数据,而是写作时内心思维的完整序列和所有个别的编辑过程

https://x.com/karpathy/status/1748784260318990496?s=20

Karpathy:理想的大型语言模型(LLM)训练数据不是你所写的内容。而是你在写作时内心思维的完整序列和所有个别的编辑过程。

但你得用现有的资料将就。

停,这和神经连接没关系哈哈。

无论如何,这只是启蒙的第一阶段。

启蒙的第二阶段是,理想的大型语言模型训练数据根本就不是训练数据。

而是你从读者那里得到的点赞。

但你得用现有的资料将就。

https://x.com/DrJimFan/status/1748785642950291583?s=20

Jim Fan:这方面的一个近似是GitHub仓库的提交历史。不仅仅要在最终代码上训练,还要在所有的尝试和痕迹上进行训练。

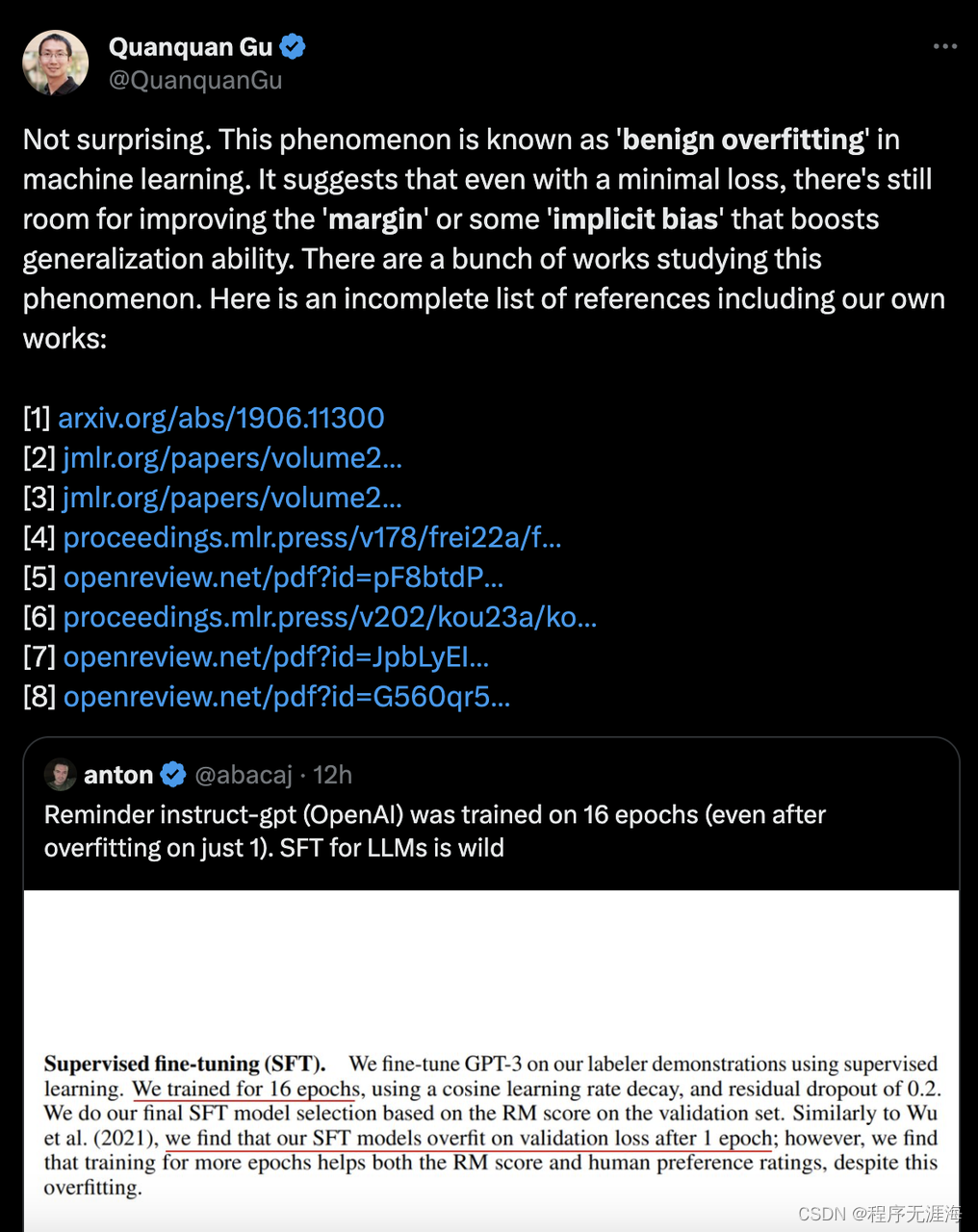

Gu科普instructGPT为什么过拟合后还继续训练:机器学习中被称为“良性过拟合”

https://x.com/QuanquanGu/status/1748846915528311202?s=20

Anton:提醒 instruct-GPT(由OpenAI训练)经过了16个时期的训练(即使在仅训练1个时期后已经过拟合)。用于大型语言模型的SFT是非常疯狂的。

Quanquan Gu回答:这并不奇怪。这种现象在机器学习中被称为“良性过拟合”。它表明,即使在最小损失的情况下,仍有改善“边际”或某些“隐含偏见”的空间,这些偏见可以提升泛化能力。有很多研究这种现象的作品。

Srivastav分享DataTrove:用于处理、过滤和去重大规模文本数据的库

https://x.com/reach_vb/status/1748850216323760609?s=20

Srivastav:介绍DataTrove

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。